Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google n'indexe-t-il jamais l'intégralité d'un site web ?

- □ Pourquoi vos pages restent-elles en 'Découvert - actuellement non indexé' ?

- □ Faut-il vraiment attendre que Google indexe vos pages ?

- □ Comment diagnostiquer les problèmes serveur qui freinent le crawl de Google ?

- □ Les problèmes de serveur ne touchent-ils vraiment que les très gros sites ?

- □ Pourquoi Google refuse-t-il d'indexer vos pages en statut 'Découvert' ?

- □ Google peut-il vraiment ignorer des pans entiers de votre site à cause d'un pattern de faible qualité ?

- □ Le maillage interne suffit-il vraiment à faire indexer vos pages découvertes ?

- □ Faut-il vraiment se préoccuper des pages non indexées par Google ?

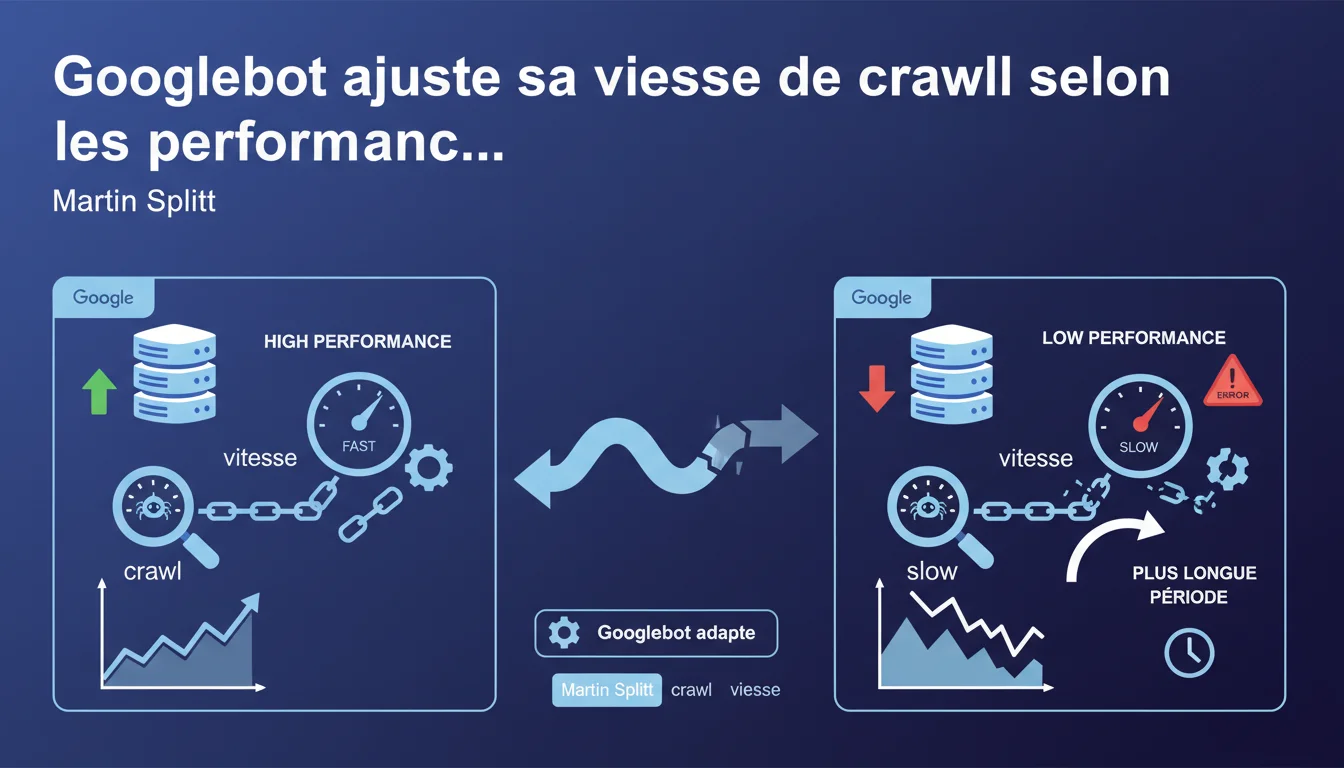

Googlebot ralentit automatiquement son rythme de crawl si votre serveur montre des signes de faiblesse — lenteur ou erreurs. Cette adaptation vise à éviter de surcharger votre infrastructure, mais elle signifie aussi que vos pages seront crawlées moins fréquemment si votre hébergement flanche.

Ce qu'il faut comprendre

Pourquoi Googlebot adapte-t-il sa vitesse de crawl ?

Google ne veut pas planter vos serveurs. Si Googlebot détecte que votre serveur met du temps à répondre ou renvoie des erreurs 5xx, il réduit automatiquement le nombre de requêtes simultanées.

Concrètement, cela signifie que le bot étale son travail sur une période plus longue. Moins de pages crawlées par minute, plus de temps nécessaire pour parcourir l'intégralité du site.

Comment Googlebot mesure-t-il la santé de votre serveur ?

Google surveille plusieurs indicateurs : temps de réponse, taux d'erreurs serveur, timeouts. Dès qu'un seuil critique est atteint, le rythme de crawl est ajusté à la baisse.

Cette logique est censée protéger votre infrastructure, mais elle peut aussi pénaliser votre crawl budget si votre hébergement est chroniquement sous-dimensionné.

Qu'est-ce que cela change pour votre indexation ?

Si Googlebot ralentit, vos nouvelles pages mettent plus de temps à être découvertes et indexées. Les mises à jour de contenu sont également détectées moins rapidement.

Pour un site qui publie fréquemment, c'est un goulot d'étranglement direct. Moins de crawl = moins de fraîcheur aux yeux de Google.

- Googlebot ajuste sa vitesse pour éviter de saturer les serveurs lents ou instables

- Un serveur qui répond mal = moins de pages crawlées par unité de temps

- Cette limitation impacte directement votre capacité à indexer du nouveau contenu rapidement

- Les erreurs 5xx et les timeouts sont les déclencheurs principaux de ces ajustements

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, c'est un mécanisme largement confirmé. Les logs serveur montrent clairement que le rythme de crawl s'effondre après une série d'erreurs 500 ou 503.

Par contre, Google ne précise jamais les seuils exacts ni la durée nécessaire pour récupérer un crawl normal après résolution du problème. [À vérifier] : combien de temps faut-il pour que Googlebot retrouve son rythme initial ? Les retours terrain varient entre quelques jours et plusieurs semaines.

Quelles nuances faut-il apporter à cette affirmation ?

Google parle d'adaptation, mais cette "protection" peut devenir un piège. Si votre hébergement mutualisé est limite, Googlebot va naturellement crawler moins — et vous perdez en visibilité sans forcément le savoir.

De plus, certains sites constatent que même après correction des problèmes serveur, le crawl reste bridé pendant des semaines. Autrement dit, il y a une forme d'inertie dans la réaction de Google.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Les très gros sites (millions de pages) ont parfois des arrangements spécifiques ou des quotas de crawl plus élevés. Mais pour la majorité des sites, cette logique s'applique sans distinction.

Autre cas : si votre serveur est ultra-rapide et ultra-stable, Googlebot peut augmenter son rythme — mais là encore, Google ne garantit rien publiquement sur les plafonds supérieurs.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl ?

D'abord, assurez-vous que votre hébergement tient la charge. Surveillez le temps de réponse serveur (TTFB) et traquez les erreurs 5xx dans vos logs.

Ensuite, vérifiez que vous ne gaspillez pas de crawl budget sur des URLs inutiles. Les facettes de filtres, les paginations infinies, les paramètres de session — autant de gouffres potentiels.

Quelles erreurs éviter absolument ?

Ne laissez jamais des erreurs 503 ou 500 traîner sans réaction. Google considère que c'est un signal de faiblesse structurelle.

Évitez aussi de bloquer Googlebot via robots.txt ou des règles de rate limiting trop agressives — vous pourriez involontairement lui donner l'impression que votre serveur est à la peine.

Comment vérifier que votre site est dans les clous ?

Analysez vos logs serveur pour repérer les pics de crawl et les erreurs. Croisez ces données avec les rapports "Statistiques d'exploration" de la Search Console.

Si vous voyez un effondrement du nombre de pages crawlées par jour sans raison éditoriale, c'est un signal d'alarme.

- Auditez les performances de votre serveur (TTFB, taux d'erreurs 5xx)

- Nettoyez votre site des URLs inutiles qui consomment du crawl budget

- Monitorer les logs serveur et les rapports Search Console en continu

- Testez la montée en charge de votre hébergement avec des outils comme Load Impact

- Documentez les incidents serveur pour corréler avec les baisses de crawl

❓ Questions frequentes

Googlebot prévient-il avant de ralentir son crawl ?

Combien de temps faut-il pour que Googlebot reprenne un rythme normal après correction d'un problème serveur ?

Un CDN peut-il aider à améliorer le crawl budget ?

Les erreurs 429 (Too Many Requests) déclenchent-elles le même mécanisme ?

Peut-on forcer Google à crawler plus vite via la Search Console ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.