Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi l'API Search Console révèle 50 fois plus de données que l'interface standard ?

- □ L'API Search Analytics peut-elle remplacer l'interface Search Console pour piloter votre SEO ?

- □ L'API URL Inspection peut-elle vraiment remplacer les tests manuels d'indexation ?

- □ Comment exploiter l'API URL Inspection pour détecter les écarts entre canonical déclaré et canonical Google ?

- □ L'API URL Inspection dévoile-t-elle enfin le vrai statut d'indexation de vos pages ?

- □ Faut-il surveiller vos sitemaps via l'API dédiée de Google ?

- □ Pourquoi combiner l'API Search Console avec d'autres sources de données SEO ?

- □ L'API Sites de Search Console peut-elle vraiment simplifier la gestion de vos propriétés ?

- □ Faut-il vraiment passer par les bibliothèques clientes pour exploiter l'API Search Console ?

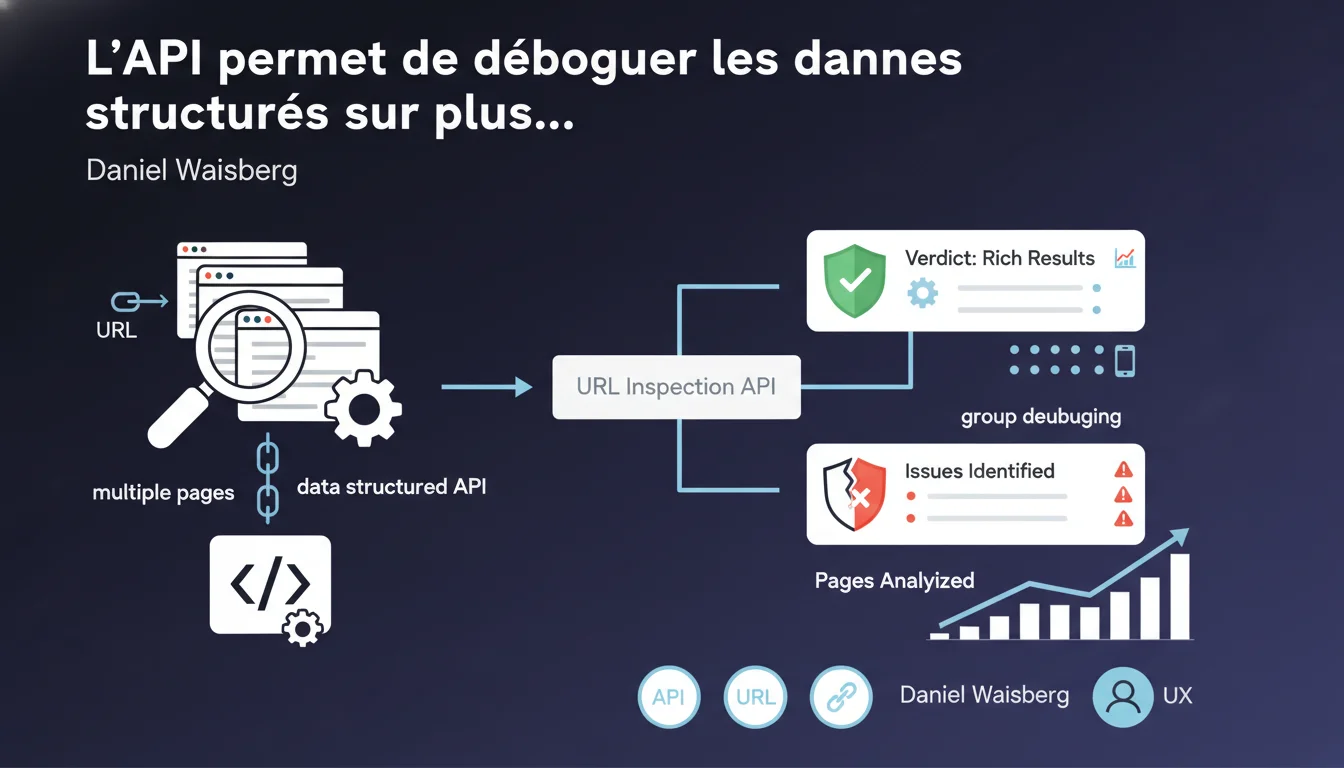

Google confirme que l'API URL Inspection permet de diagnostiquer les problèmes de données structurées sur plusieurs pages simultanément. L'outil délivre un verdict pour chaque type de résultat enrichi, avec une description complète des éléments détectés et des erreurs identifiées. Une solution technique pour automatiser l'audit de centaines d'URLs au lieu de vérifier page par page dans Search Console.

Ce qu'il faut comprendre

En quoi l'API URL Inspection diffère-t-elle de l'outil manuel Search Console ?

L'API URL Inspection permet d'automatiser ce que vous faites manuellement dans Search Console, mais à grande échelle. Au lieu de tester une URL à la fois, vous pouvez soumettre des centaines de requêtes via des scripts et récupérer les diagnostics dans un format structuré.

L'intérêt majeur ? Vous obtenez les mêmes données que Googlebot — validation des données structurées, éligibilité aux résultats enrichis, erreurs détectées — mais de manière programmatique. Fini le copier-coller manuel pour auditer 500 fiches produits.

Quels types de problèmes l'API peut-elle détecter ?

L'API renvoie un verdict pour chaque type de résultat enrichi (Recipe, Product, FAQ, etc.) trouvé sur la page. Elle liste tous les éléments détectés et signale les propriétés manquantes, invalides ou mal formatées.

Concrètement, si votre markup JSON-LD contient une erreur de syntaxe, un champ obligatoire absent ou un format de prix incorrect, l'API le signalera avec une description de l'erreur. C'est exactement ce que vous voyez dans l'onglet "Résultats enrichis" de Search Console, mais accessible par code.

Pourquoi Google précise-t-il cette capacité maintenant ?

Cette déclaration vise à clarifier un cas d'usage spécifique de l'API qui n'est pas toujours évident pour les développeurs. Beaucoup utilisent l'API pour vérifier l'indexation ou forcer un recrawl, mais négligent son potentiel pour le debug massif de structured data.

Google pousse clairement les sites à grande échelle à industrialiser leurs audits. Attendre que les erreurs remontent naturellement dans Search Console prend du temps — l'API permet de tester en amont, avant même l'indexation.

- L'API URL Inspection automatise le diagnostic des données structurées sur des volumes importants d'URLs

- Elle fournit le même niveau de détail que l'outil manuel Search Console

- Chaque type de résultat enrichi reçoit un verdict accompagné de la liste complète des erreurs

- L'usage optimal : détecter les problèmes avant indexation ou après un déploiement massif

- Nécessite une implémentation technique via scripts Python, Node.js ou autre langage supportant les API Google

Avis d'un expert SEO

Cette API tient-elle vraiment ses promesses sur le terrain ?

La théorie est séduisante, mais la réalité terrain est plus nuancée. L'API fonctionne, mais elle est soumise aux mêmes quotas restrictifs que les autres API Search Console — et ça, Google ne le crie pas sur les toits.

Avec un quota de 600 requêtes par minute et 2 000 par jour par propriété, vous ne pourrez pas auditer quotidiennement un site de 50 000 pages. Il faut prioriser, segmenter, échantillonner. L'industrialisation promise se heurte vite aux limites pratiques pour les gros catalogues.

Les verdicts renvoyés sont-ils fiables à 100% ?

Soyons honnêtes : l'API renvoie ce que Googlebot voit lors de son rendering, mais ça ne garantit pas que vos résultats enrichis s'affichent en SERP. Le verdict "Valid" signifie "techniquement conforme", pas "éligible à coup sûr".

Google applique des filtres qualité non documentés qui peuvent écarter des pages pourtant validées. Une recette parfaitement structurée peut ne jamais déclencher de rich snippet si le contenu est jugé trop mince ou dupliqué. [À vérifier] : la corrélation exacte entre verdict API et affichage réel en SERP reste floue — Google ne communique aucune métrique officielle là-dessus.

Dans quels cas cette méthode ne s'applique-t-elle pas ?

L'API ne remplace pas un monitoring continu des performances en production. Elle teste un état instantané de la page, mais ne détecte pas les régressions JavaScript qui apparaissent aléatoirement selon les devices ou les contextes utilisateur.

Si vos données structurées sont injectées dynamiquement côté client avec des conditions complexes (A/B tests, personnalisation), l'API peut renvoyer un résultat différent de ce que certains utilisateurs voient réellement. Et là, vous êtes dans une zone grise que Google n'adresse pas frontalement.

Impact pratique et recommandations

Comment implémenter concrètement cette solution d'audit automatisé ?

Vous aurez besoin d'un script personnalisé qui interroge l'API URL Inspection pour chaque URL cible. Les langages classiques : Python avec la bibliothèque officielle Google API Client, Node.js, ou même Google Apps Script pour des volumes modestes.

Le script doit gérer l'authentification OAuth2, respecter les quotas, stocker les réponses dans un format exploitable (CSV, BDD, Google Sheets) et parser les objets JSON renvoyés pour extraire les verdicts et erreurs. Ce n'est pas trivial si vous débutez avec les API Google.

Quelles erreurs éviter lors de l'utilisation de l'API ?

Premier piège : tester des URLs non indexées ou bloquées par robots.txt. L'API peut refuser d'inspecter ces URLs ou renvoyer des données incomplètes. Vérifiez toujours que vos URLs sont crawlables avant de lancer un audit massif.

Deuxième erreur courante : ignorer les délais entre requêtes. Bombarder l'API sans throttling fait sauter vos quotas en quelques minutes et peut bloquer votre accès temporairement. Implémentez un rate limiting strict (exemple : 10 requêtes/seconde max).

Troisième point critique : ne pas prioriser les URLs. Testez d'abord vos templates clés (fiche produit, article, landing pages stratégiques) avant de dépenser vos quotas sur des pages secondaires ou orphelines.

Que faut-il vérifier après avoir corrigé les erreurs détectées ?

Après correction de vos markup, relancez une inspection sur un échantillon représentatif pour valider que les erreurs ont disparu. Mais ne vous arrêtez pas là — surveillez l'évolution de vos impressions rich snippets dans Search Console (Performance > Apparence dans les résultats).

Si les verdicts passent au vert mais que vos résultats enrichis ne gagnent pas en visibilité sous 2-3 semaines, c'est probablement un signal que Google filtre vos pages pour des raisons qualité ou pertinence. À ce stade, le problème n'est plus technique mais éditorial.

- Configurez l'accès API Search Console et générez vos credentials OAuth2

- Développez ou adaptez un script d'interrogation avec gestion des quotas et rate limiting

- Listez vos URLs prioritaires par template ou typologie de contenu

- Lancez un premier audit sur un échantillon de 50-100 URLs pour valider votre setup

- Analysez les verdicts et erreurs renvoyées, priorisez les corrections par impact SEO

- Implémentez les corrections sur vos templates ou contenus concernés

- Relancez l'inspection post-correction pour validation

- Surveillez l'évolution des impressions rich snippets dans Search Console sur 3-4 semaines

❓ Questions frequentes

L'API URL Inspection remplace-t-elle complètement l'outil manuel Search Console ?

Combien d'URLs peut-on tester par jour avec l'API ?

Un verdict 'Valid' garantit-il l'affichage de résultats enrichis en SERP ?

Peut-on utiliser l'API pour forcer l'indexation après correction des erreurs ?

Quels langages de programmation sont compatibles avec cette API ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.