Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi l'API Search Console révèle 50 fois plus de données que l'interface standard ?

- □ L'API Search Analytics peut-elle remplacer l'interface Search Console pour piloter votre SEO ?

- □ Comment exploiter l'API URL Inspection pour détecter les écarts entre canonical déclaré et canonical Google ?

- □ Peut-on vraiment déboguer les données structurées à grande échelle avec l'API URL Inspection ?

- □ L'API URL Inspection dévoile-t-elle enfin le vrai statut d'indexation de vos pages ?

- □ Faut-il surveiller vos sitemaps via l'API dédiée de Google ?

- □ Pourquoi combiner l'API Search Console avec d'autres sources de données SEO ?

- □ L'API Sites de Search Console peut-elle vraiment simplifier la gestion de vos propriétés ?

- □ Faut-il vraiment passer par les bibliothèques clientes pour exploiter l'API Search Console ?

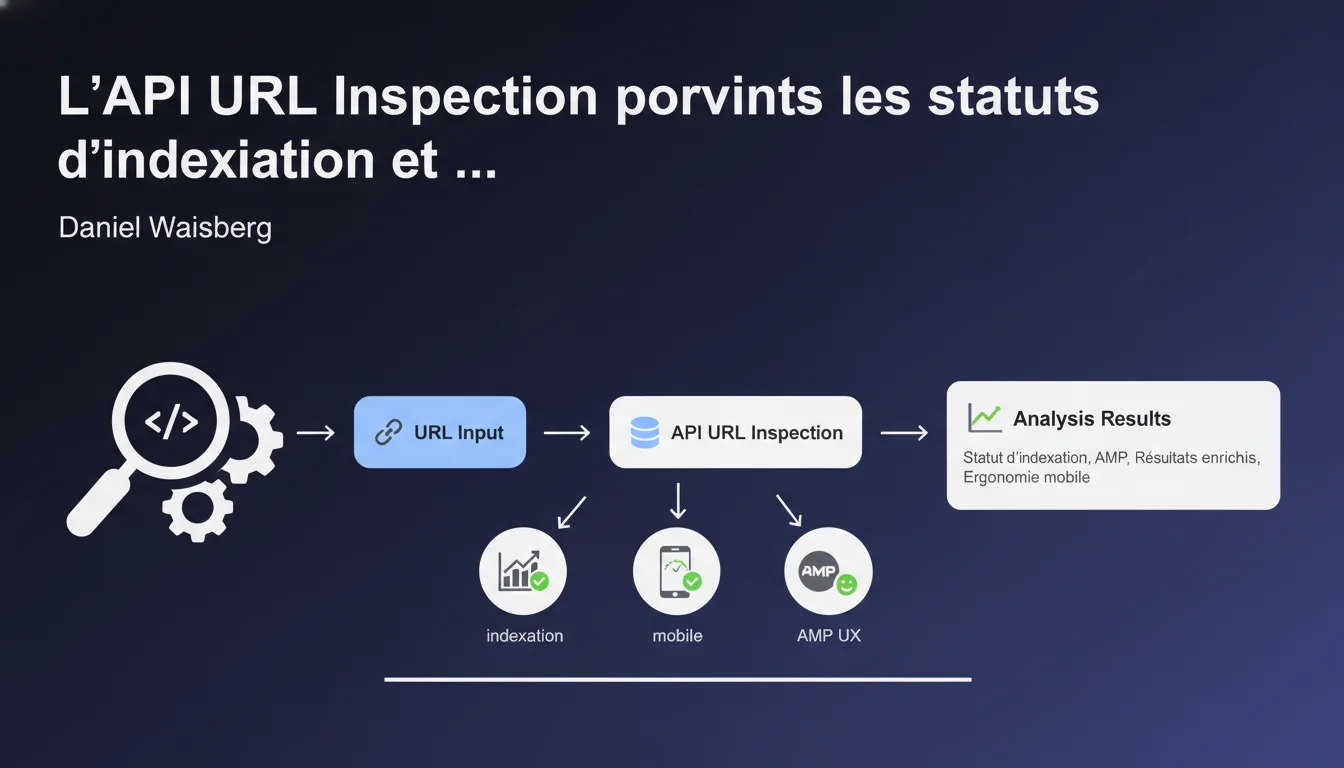

Google propose une API URL Inspection qui donne accès aux mêmes données que l'outil d'inspection d'URL dans la Search Console : statut d'indexation, validité AMP, résultats enrichis et ergonomie mobile. Concrètement, cela permet d'automatiser le débogage et l'optimisation de pages spécifiques à grande échelle, sans passer par l'interface manuelle.

Ce qu'il faut comprendre

Qu'apporte réellement cette API par rapport à l'interface Search Console ?

L'API URL Inspection met à disposition les mêmes informations que l'outil d'inspection d'URL, mais sous forme programmatique. Elle retourne le statut d'indexation d'une page, les erreurs éventuelles liées à l'AMP, la validité des résultats enrichis (structured data), et les problèmes d'ergonomie mobile.

L'intérêt principal ? L'automatisation. Plutôt que de vérifier manuellement chaque URL dans la Search Console, vous pouvez scripter des vérifications en masse, monitorer des migrations ou auditer des milliers de pages programmatiquement. Ça devient un outil de débogage industrialisable.

Dans quels cas concrets cette API devient indispensable ?

Pour les sites de plusieurs milliers de pages, vérifier manuellement le statut d'indexation relève de l'impossible. L'API permet de détecter rapidement les pages bloquées en noindex, les erreurs de canonicalisation ou les problèmes de structured data qui empêchent l'affichage des rich snippets.

Autre cas d'usage : les migrations de sites. Après une refonte, vous pouvez automatiser la vérification que Google indexe bien les nouvelles URLs et ne rencontre pas d'erreurs critiques. Ça évite les mauvaises surprises trois semaines après le go-live.

- Automatisation du monitoring : vérifier le statut d'indexation de centaines d'URLs sans effort manuel

- Débogage technique : identifier les erreurs AMP, structured data ou mobile usability à grande échelle

- Validation post-migration : s'assurer que Google indexe correctement les nouvelles URLs

- Optimisation continue : suivre l'évolution du statut d'indexation dans le temps via des scripts réguliers

Quelles limites faut-il garder en tête ?

L'API repose sur les données Search Console, donc elle hérite de ses limites. Les informations ne sont pas en temps réel — il peut y avoir un décalage entre l'état actuel de votre page et ce que Google remonte. Si vous modifiez une page, l'API ne reflétera pas instantanément le changement.

Autre point : les quotas. Google impose des limites d'utilisation sur les appels API. Pour des sites très volumineux, il faudra gérer ces quotas intelligemment et prioriser les URLs à vérifier. Pas question de tout analyser quotidiennement si vous gérez un site de 100 000 pages.

Avis d'un expert SEO

Cette API change-t-elle vraiment la donne pour les SEO techniques ?

Soyons honnêtes : l'API URL Inspection n'apporte rien de nouveau en termes d'informations — ce sont exactement les mêmes données que l'interface manuelle. La vraie révolution, c'est l'accessibilité programmatique. Pour les équipes qui gèrent des sites complexes ou plusieurs projets, ça devient un gain de temps massif.

Le problème, c'est que Google reste vague sur la fraîcheur des données. Combien de temps entre le crawl d'une page et la mise à jour des infos disponibles via l'API ? [À vérifier] — Google ne documente pas précisément ce délai, ce qui peut poser souci si vous cherchez à déboguer un problème urgent.

Dans quels cas cette API ne suffit-elle pas ?

L'API URL Inspection donne le résultat final : indexée ou non, valide ou non. Mais elle ne remplace pas un audit technique complet. Elle ne vous dira pas pourquoi une page met trois semaines à être indexée, ni si votre architecture de liens internes ralentit le crawl.

Elle ne détecte pas non plus les problèmes de crawl budget ou de profondeur de pages. Si une URL est techniquement valide mais enfouie à 10 clics de la home, l'API vous dira juste « non indexée » sans pointer le vrai souci structurel. Il faut croiser ces données avec d'autres outils — logs serveur, crawlers tiers, analytics.

Les données remontées sont-elles fiables pour prendre des décisions stratégiques ?

Les informations de la Search Console — et donc de l'API — sont parfois incomplètes ou contradictoires. On voit régulièrement des pages marquées comme « non indexées » alors qu'elles apparaissent dans l'index (via une recherche site:). Inversement, des pages signalées comme indexées disparaissent des résultats.

[À vérifier] — Google ne garantit pas la cohérence parfaite entre l'API et l'état réel de l'index. Utilisez ces données comme un indicateur, pas comme une vérité absolue. Croiser avec des tests manuels reste indispensable pour les pages stratégiques.

Impact pratique et recommandations

Que faut-il faire concrètement pour exploiter cette API ?

Première étape : configurer l'accès à l'API via Google Cloud Console. Vous aurez besoin de créer un projet, activer l'API Search Console, et générer des credentials OAuth 2.0. Si votre équipe n'a pas l'habitude de manipuler des APIs Google, prévoyez un temps d'apprentissage — la documentation est complète mais dense.

Ensuite, identifiez les URLs prioritaires à monitorer. Inutile de tout scanner : concentrez-vous sur les pages stratégiques (conversions, trafic SEO élevé), les nouvelles URLs après une publication, ou les sections récemment migrées. Scriptez des vérifications régulières et loggez les résultats pour suivre l'évolution dans le temps.

- Activer l'API URL Inspection dans Google Cloud Console et configurer OAuth 2.0

- Prioriser les URLs à vérifier : pages stratégiques, nouvelles publications, URLs post-migration

- Automatiser les appels API via un script Python, Node.js ou intégrer dans vos workflows CI/CD

- Logger les résultats dans une base de données ou un tableau de bord pour suivre l'évolution temporelle

- Croiser les données API avec les logs serveur et un crawler tiers pour validation

- Mettre en place des alertes automatiques si des URLs stratégiques passent en statut « non indexée »

Quelles erreurs éviter dans l'utilisation de cette API ?

Ne tombez pas dans le piège du surinvestissement technique : si vous gérez un site de 200 pages, l'API n'apporte pas grand-chose par rapport à la vérification manuelle. L'automatisation ne se justifie qu'à partir de plusieurs milliers d'URLs ou dans des contextes de publication fréquente.

Autre erreur classique : se fier aveuglément aux données sans recoupement. Si l'API indique qu'une page est indexée mais qu'elle n'apparaît nulle part dans les SERP (même en recherche exacte), il y a un souci — et ce n'est pas l'API qui vous dira lequel. Validez toujours manuellement les résultats suspects.

Comment intégrer cette API dans un workflow SEO existant ?

L'idéal est de coupler l'API avec vos outils d'audit et de monitoring. Par exemple : votre crawler détecte une nouvelle URL publiée, déclenche un appel API pour vérifier son statut d'indexation quelques jours après, puis alerte si Google ne l'a pas encore indexée. Ça permet de réagir vite si un noindex accidentel bloque la page.

Pour les équipes DevOps, intégrez l'API dans vos pipelines CI/CD : avant chaque déploiement en production, vérifiez un échantillon d'URLs pour détecter les régressions (structured data cassée, erreurs mobile, etc.). Ça évite de découvrir un problème trois semaines après un déploiement raté.

❓ Questions frequentes

L'API URL Inspection donne-t-elle des informations en temps réel ?

Peut-on utiliser cette API pour forcer l'indexation d'une page ?

Quels sont les quotas d'utilisation de l'API ?

L'API détecte-t-elle les problèmes de crawl budget ?

Faut-il avoir des compétences en développement pour utiliser l'API ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.