Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Peut-on publier le même contenu en HTML et PDF sans risque de duplicate content ?

- □ Comment gérer efficacement le contenu dupliqué entre HTML et PDF ?

- □ Google privilégie-t-il vraiment le HTML face au PDF en cas de contenu dupliqué ?

- □ Faut-il vraiment inclure un lien vers son site dans chaque PDF publié ?

- □ Faut-il vraiment choisir entre HTML et PDF selon le support de consultation ?

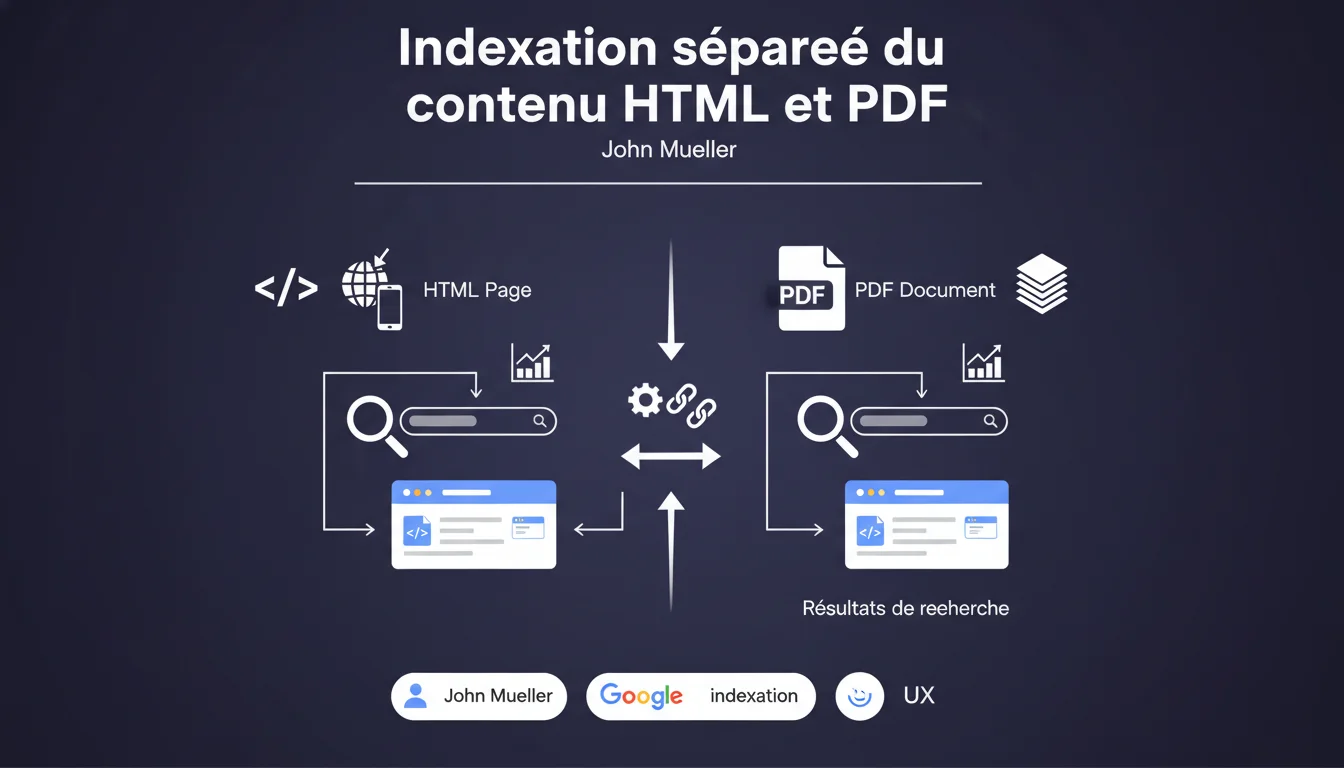

Google peut indexer séparément une page HTML et sa version PDF, même si le contenu textuel est strictement identique. Ces deux formats peuvent cohabiter dans les résultats de recherche sans être considérés comme du contenu dupliqué au sens classique. Pour les praticiens SEO, cela ouvre des questions sur la gestion des signaux de classement et la cannibalisation potentielle.

Ce qu'il faut comprendre

Pourquoi Google traite-t-il différemment HTML et PDF ?

Google considère que les formats de fichiers répondent à des intentions utilisateur distinctes. Un internaute cherchant un guide technique peut préférer un PDF téléchargeable, tandis qu'un autre privilégiera une page web pour lecture rapide.

Les systèmes de Google analysent donc ces deux contenants comme des entités séparées, même si le texte est copié-collé. L'architecture technique diffère : balisage HTML vs structure PDF, vitesse de chargement, expérience mobile, comportement des liens internes.

Cette indexation séparée pose-t-elle un problème de duplication ?

Non, et c'est là toute la nuance. Google ne pénalise pas automatiquement cette cohabitation parce qu'il reconnaît une légitimité fonctionnelle aux deux formats.

Contrairement au duplicate content classique où deux URLs HTML identiques se cannibalisent, ici la différence de format justifie la double présence. Reste que Google devra choisir quelle version afficher selon le contexte de la requête.

Quels signaux de classement s'appliquent à chaque format ?

Les critères d'évaluation divergent fortement. Une page HTML bénéficie de l'optimisation mobile, des Core Web Vitals, du maillage interne structuré, des balises schema.

Un PDF, lui, est évalué sur sa structure documentaire, ses métadonnées (titre, auteur), la qualité du texte extractible, les signaux de confiance du domaine. Les backlinks pointant vers l'un ou l'autre renforcent indépendamment leur autorité.

- Google indexe HTML et PDF comme deux entités distinctes, même avec du texte identique

- Aucune pénalité automatique pour duplication entre formats différents

- Les signaux de classement (vitesse, mobile, backlinks) s'appliquent différemment selon le format

- Le choix d'affichage dépend de l'intention utilisateur et du contexte de recherche

- Cette logique ne s'étend pas aux autres formats (DOCX, PPTX) sans confirmation explicite

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et ce n'est pas nouveau. Depuis des années, on observe des SERPs mixtes où un PDF rankait pour une requête informationnelle longue tandis que la version HTML ressortait sur une recherche plus générique.

Ce qui change, c'est la confirmation officielle. Avant, beaucoup de SEO appliquaient un noindex aux PDF par peur de cannibalisation. Mueller valide qu'on peut laisser cohabiter sans risque technique majeur — mais sans garantir l'absence de cannibalisation stratégique.

Quelles nuances faut-il apporter à cette règle ?

Google dit peut indexer séparément, pas va toujours indexer séparément. Si le PDF n'apporte aucun signal différenciant (pas de backlinks spécifiques, pas de téléchargements, métadonnées vides), Google pourrait choisir de ne favoriser que le HTML.

Autre point : [À vérifier] Mueller ne précise pas si cette logique s'applique aux autres formats bureautiques (DOCX, PPTX). On suppose que oui par analogie, mais aucune donnée officielle ne l'étaye.

Dans quels cas cette approche devient-elle contre-productive ?

Si votre contenu n'a aucune raison fonctionnelle d'exister en PDF (pas de besoin d'impression, pas d'archivage, pas de consultation offline), vous créez un concurrent interne sans avantage.

Pire : un PDF mal optimisé (images scannées, pas de texte sélectionnable, poids excessif) peut nuire à l'expérience utilisateur tout en siphonnant des clics depuis les SERPs. Soyons honnêtes, personne n'aime atterrir sur un PDF de 8 Mo par accident sur mobile.

Impact pratique et recommandations

Que faut-il faire concrètement pour gérer HTML et PDF ?

Première étape : auditer vos contenus dupliqués entre formats. Listez toutes les paires HTML/PDF identiques, puis évaluez si chaque format a une raison d'exister.

Si le PDF apporte une valeur (téléchargement pour consultation offline, impression professionnelle), optimisez ses métadonnées : titre, auteur, mots-clés, description. Assurez-vous que le texte est extractible proprement.

Si le PDF n'a pas d'usage réel, trois options : noindex pour éviter la cohabitation, suppression pure, ou redirection 301 vers le HTML. Ne laissez pas traîner du contenu fantôme juste parce que Google peut l'indexer.

Comment éviter la cannibalisation entre les deux versions ?

Utilisez des canonical tags ? Non, ça ne fonctionne pas entre formats différents. La solution passe par une stratégie de backlinks ciblée : orientez activement les liens externes vers la version que vous voulez prioriser.

En interne, si vous proposez les deux formats, placez le PDF en téléchargement secondaire (bouton "Télécharger en PDF") plutôt qu'en lien équivalent. Cela envoie un signal clair sur la hiérarchie des contenus.

Surveillez la Search Console : si le PDF draine du trafic sur vos requêtes stratégiques au détriment du HTML mieux optimisé, c'est un symptôme de cannibalisation à corriger.

Quelles erreurs techniques éviter absolument ?

Ne bloquez pas le crawl des PDF dans le robots.txt si vous souhaitez les indexer. Vérifiez que vos PDF sont accessibles sans identification — Google ne crawle pas derrière un login.

Évitez les PDF générés dynamiquement avec des URLs à paramètres complexes qui changent à chaque visite. Google les traitera comme des pages différentes, créant un chaos d'indexation.

Bannissez les PDF construits uniquement d'images scannées sans couche texte OCR. Google peut extraire du texte via OCR, mais la qualité est aléatoire et vous perdez tout contrôle sémantique.

- Auditer tous les contenus dupliqués HTML/PDF existants

- Optimiser les métadonnées PDF (titre, auteur, description) si vous les gardez indexables

- Noindexer ou supprimer les PDF sans valeur fonctionnelle claire

- Orienter les backlinks vers la version prioritaire (généralement HTML)

- Placer les PDF en téléchargement secondaire plutôt qu'en lien équivalent

- Surveiller la Search Console pour détecter la cannibalisation de trafic

- Garantir l'accessibilité et le texte extractible de tous les PDF indexés

- Éviter les URLs dynamiques et les PDF image-only

❓ Questions frequentes

Dois-je systématiquement bloquer l'indexation des PDF pour éviter le duplicate content ?

Les backlinks vers un PDF sont-ils aussi efficaces que vers du HTML ?

Cette règle s'applique-t-elle aux fichiers DOCX, PPTX ou autres formats bureautiques ?

Comment savoir si mes PDF cannibalisent mes pages HTML dans les résultats de recherche ?

Faut-il optimiser les métadonnées des PDF comme on le fait pour les balises meta HTML ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/12/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.