Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Faut-il vraiment exclure les URL non-canoniques de votre sitemap XML ?

- □ Le sitemap XML est-il vraiment indispensable pour améliorer le crawl de votre site ?

- □ Faut-il vraiment un sitemap pour être indexé par Google ?

- □ Faut-il vraiment limiter les mises à jour de lastmod dans vos sitemaps XML ?

- □ Quelles sont les limites techniques réelles des fichiers sitemap XML ?

- □ Faut-il vraiment diviser vos sitemaps volumineux en plusieurs fichiers ?

- □ Quels types de contenu faut-il vraiment inclure dans vos sitemaps ?

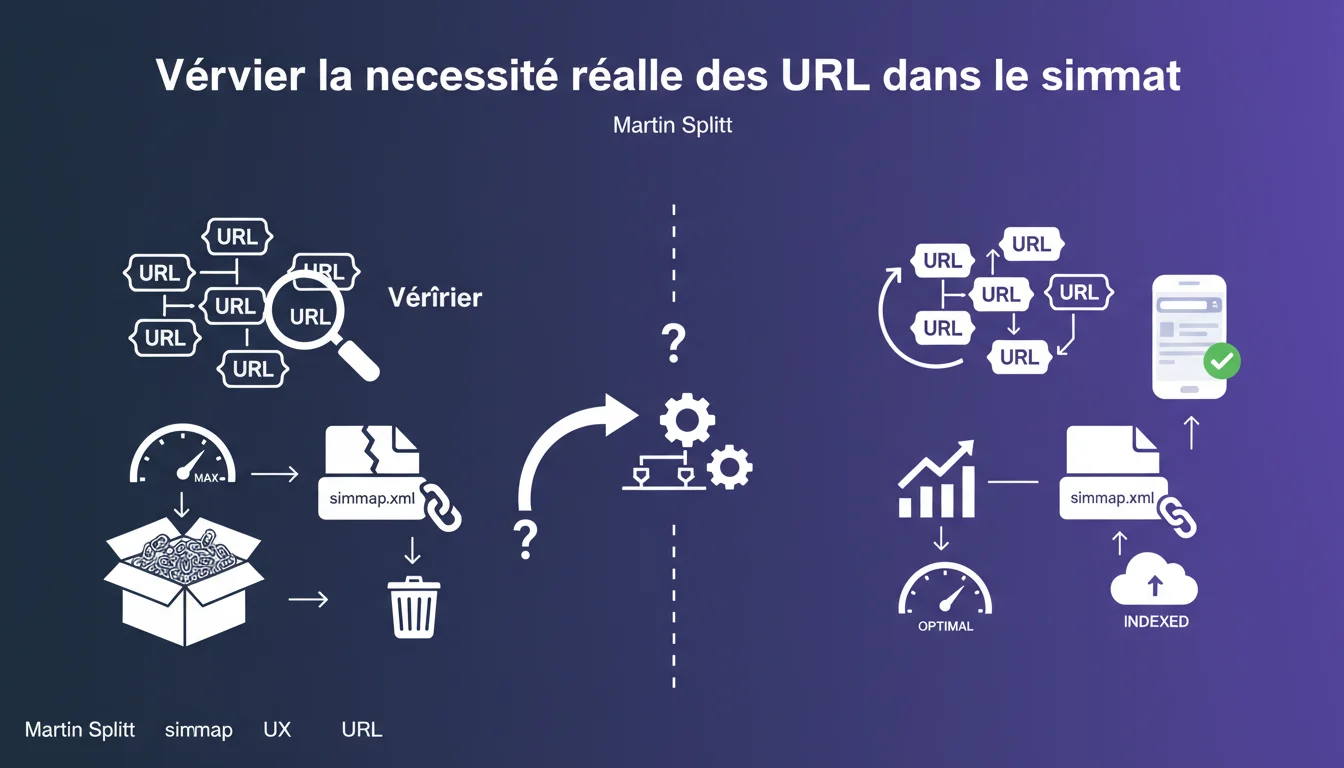

Martin Splitt rappelle une évidence souvent négligée : avant de fractionner un sitemap volumineux, interrogez-vous sur la nécessité réelle d'indexer toutes ces URL. Google ne garantit pas l'indexation de chaque URL soumise, et un sitemap surchargé de pages inutiles dilue le signal envoyé au moteur. Mieux vaut privilégier la qualité à la quantité.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur la sélection des URL dans un sitemap ?

Le sitemap XML sert à signaler à Google les pages importantes que vous souhaitez voir indexées. Ce n'est pas un inventaire exhaustif de toutes vos URL. Pourtant, beaucoup de sites génèrent automatiquement des sitemaps contenant des milliers de pages, dont une partie ne mérite pas d'être indexée.

Google dispose d'un budget de crawl limité pour chaque site. Soumettre des milliers d'URL peu pertinentes — pages dupliquées, variantes de paramètres, contenus minces — revient à gaspiller ce budget et à brouiller le signal sur ce qui compte vraiment.

Qu'est-ce qui déclenche un sitemap trop volumineux ?

Un sitemap peut gonfler artificiellement pour plusieurs raisons : génération automatique non filtrée, indexation de pages paginées ou filtrées, variantes linguistiques mal gérées, ou encore archives historiques sans valeur ajoutée. Dans un contexte e-commerce ou média, il n'est pas rare de voir des sitemaps dépasser les 50 000 URL sans réel discernement.

Le piège ? Croire que plus d'URL signifie plus de visibilité. En réalité, Google indexe ce qu'il juge utile pour les utilisateurs, pas ce que vous lui soumettez aveuglément.

Quelle est la probabilité qu'elles soient toutes indexées ?

La question clé posée par Splitt. Google ne s'engage jamais à indexer l'intégralité d'un sitemap. L'indexation dépend de la qualité du contenu, de la popularité de la page, de la fraîcheur de l'information, et de la capacité du moteur à allouer du crawl budget à votre site.

Si vous soumettez 100 000 URL et que seulement 20 000 sont réellement indexées, vous avez un problème structurel, pas un problème de sitemap. Diviser ce sitemap en 10 fichiers de 10 000 URL ne résoudra rien si 80 % de ces pages ne méritent pas d'être indexées.

- Le sitemap ne garantit pas l'indexation, il signale une intention

- Google priorise les pages à forte valeur ajoutée et forte demande utilisateur

- Un sitemap surchargé dilue le signal et complique le travail des crawlers

- Avant toute division, faites un tri rigoureux des URL à soumettre

Avis d'un expert SEO

Cette approche est-elle cohérente avec les observations terrain ?

Absolument. Les audits SEO révèlent régulièrement des sites où plus de 50 % des URL soumises en sitemap ne sont jamais indexées. Dans certains cas extrêmes, des sites soumettent 200 000 URL pour seulement 30 000 pages effectivement présentes dans l'index Google.

Ce décalage massif traduit souvent une automatisation mal paramétrée — sitemaps générés par un CMS sans filtrage, inclusion de pages de recherche interne, de filtres e-commerce ou de contenus syndiqués. Le conseil de Splitt ne tombe pas du ciel : il répond à une pratique courante et contre-productive.

Quelles nuances faut-il apporter à cette déclaration ?

Splitt reste volontairement flou sur ce qui constitue une URL nécessaire. Il ne donne aucun critère quantitatif ni méthodologie précise. [À vérifier] — combien d'URL non indexées dans un sitemap devient problématique ? Google ne le dit jamais clairement.

La difficulté pour un praticien, c'est d'évaluer cette « probabilité d'indexation ». Sans accès aux métriques internes de Google, on se base sur des proxys : taux d'indexation dans Search Console, vitesse de découverte des nouvelles URL, présence ou absence dans l'index via requêtes site:. Mais aucun signal officiel ne dit « cette page a 10 % de chances d'être indexée ».

Dans quels cas faut-il quand même soumettre largement ?

Pour les sites d'actualité ou de contenu frais, soumettre des volumes importants peut se justifier : la fraîcheur prime sur la profondeur de crawl classique. Les médias, agrégateurs ou plateformes événementielles ont besoin de signaler rapidement des milliers de nouvelles URL chaque jour.

Mais même dans ce cas, le tri reste pertinent : articles vs pages annexes, contenu original vs reprise syndiquée. Si votre site génère 5000 URL par jour dont 4500 sont des variantes ou du contenu recyclé, le conseil de Splitt s'applique tout autant.

Impact pratique et recommandations

Que faut-il faire concrètement avant de diviser un sitemap ?

Première étape : auditer l'indexation réelle de vos URL actuelles. Dans Google Search Console, regardez le ratio pages découvertes / pages indexées. Si vous soumettez 50 000 URL mais que seulement 15 000 sont indexées, vous avez un problème de qualité, pas de volume.

Ensuite, identifiez les catégories de pages qui gonflent artificiellement le sitemap : pages de filtres, archives anciennes, contenus minces, variantes paramétrées. Posez-vous la question : cette page apporte-t-elle une valeur unique ? Si la réponse est non, retirez-la du sitemap.

Quelles erreurs éviter lors du nettoyage du sitemap ?

Ne confondez pas « retirer du sitemap » et « bloquer le crawl ». Une page absente du sitemap peut toujours être découverte et indexée via des liens internes. L'inverse est vrai aussi : une page en sitemap mais bloquée par robots.txt ou noindex ne sera jamais indexée.

Évitez également de retirer des pages qui génèrent du trafic organique, même marginal. Croisez les données Search Console avec vos analytics avant de trancher. Une URL peut être indexée sans que vous le sachiez et capter quelques visites stratégiques.

Comment vérifier que mon site est conforme à cette recommandation ?

Calculez votre taux d'indexation : nombre d'URL indexées / nombre d'URL soumises en sitemap. Si ce ratio descend sous 50 %, vous avez clairement un problème. En dessous de 30 %, c'est critique.

Utilisez les rapports de couverture de Search Console pour identifier les URL découvertes mais non indexées. Google vous donne parfois des raisons explicites : contenu dupliqué, qualité insuffisante, crawl désactivé. Ces signaux vous aident à prioriser le nettoyage.

- Auditer le taux d'indexation actuel via Search Console

- Identifier les catégories de pages non indexées récurrentes

- Retirer du sitemap les URL sans valeur ajoutée unique

- Vérifier que les pages retirées restent accessibles via maillage interne si nécessaire

- Monitorer l'impact post-nettoyage sur le crawl budget et l'indexation

- Mettre en place des filtres automatiques dans la génération du sitemap

❓ Questions frequentes

Combien d'URL maximum doit contenir un sitemap XML ?

Retirer des URL du sitemap peut-il les désindexer ?

Comment savoir si une URL mérite d'être dans le sitemap ?

Faut-il créer plusieurs sitemaps par catégorie ou un seul volumineux ?

Quel impact sur le crawl budget si je réduis mon sitemap de moitié ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 16/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.