Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Faut-il vraiment exclure les URL non-canoniques de votre sitemap XML ?

- □ Faut-il vraiment un sitemap pour être indexé par Google ?

- □ Faut-il vraiment limiter les mises à jour de lastmod dans vos sitemaps XML ?

- □ Quelles sont les limites techniques réelles des fichiers sitemap XML ?

- □ Faut-il vraiment diviser vos sitemaps volumineux en plusieurs fichiers ?

- □ Faut-il vraiment indexer toutes les URL de votre sitemap ?

- □ Quels types de contenu faut-il vraiment inclure dans vos sitemaps ?

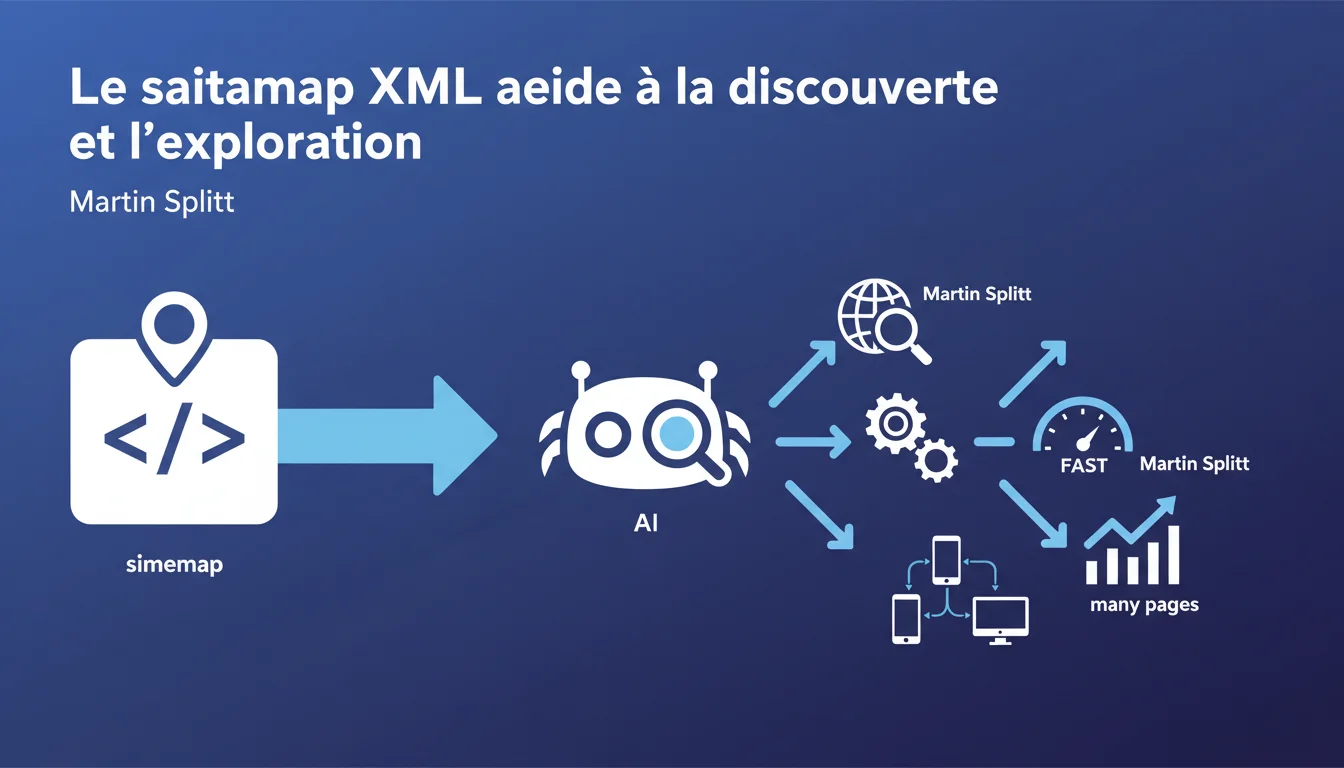

Martin Splitt confirme que le sitemap XML accélère la découverte des pages par Googlebot et optimise l'exploration, surtout sur les sites volumineux. Concrètement, c'est un signal qui facilite le travail du crawler — pas une garantie d'indexation, mais un coup de pouce non négligeable.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il autant sur le sitemap XML ?

Le sitemap XML joue le rôle de plan d'accès privilégié pour les moteurs de recherche. Plutôt que d'attendre que Googlebot découvre vos URLs via le maillage interne ou des backlinks, vous lui servez directement la liste complète des pages importantes.

Pour les sites avec des milliers de pages — e-commerce, médias, annuaires — cette fonction devient critique. Sans sitemap, certaines pages profondes ou mal liées risquent de rester invisibles pendant des semaines, voire des mois.

Qu'entend-on exactement par « exploration plus efficace » ?

L'efficacité ici se mesure en temps de découverte et en priorisation des ressources de crawl. Le sitemap indique à Google quelles pages méritent son attention, avec des métadonnées comme la date de modification ou la fréquence de mise à jour.

Cela dit, un sitemap mal conçu — bourré d'URLs inutiles, de redirections ou de pages en noindex — produit l'effet inverse. Il dilue le signal et gaspille du crawl budget au lieu d'en économiser.

Le sitemap garantit-il l'indexation de toutes mes pages ?

Non. Google le répète en boucle : soumettre une URL via sitemap ne garantit aucune indexation. Le crawler visite, analyse, puis décide selon ses propres critères de qualité et de pertinence.

Le sitemap est un outil de découverte et de suggestion, pas un passe-droit. Si vos contenus sont dupliqués, pauvres ou canonicalisés ailleurs, ils resteront hors index même avec un sitemap parfait.

- Le sitemap XML accélère la découverte des nouvelles pages et des mises à jour importantes.

- Il aide surtout les sites volumineux ou complexes où le maillage interne ne suffit pas.

- Soumettre un sitemap ne garantit aucune indexation — Google reste seul juge de la qualité des contenus.

- Un sitemap mal entretenu (redirections, erreurs 404, pages bloquées) nuit plus qu'il n'aide.

- Les métadonnées (lastmod, changefreq, priority) sont souvent ignorées par Googlebot — ne les surestimez pas.

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment la réalité du terrain ?

Oui, globalement. Les observations montrent que les sites qui soumettent un sitemap propre voient leurs nouvelles pages découvertes beaucoup plus vite que ceux qui s'en passent. Sur un site de plusieurs milliers de pages, la différence se compte en heures ou jours, pas en semaines.

Mais attention : Martin Splitt reste évasif sur la notion « d'exploration plus efficace ». Efficace pour qui ? Pour le site, ou pour Google qui économise du crawl sur des pages mal prioritaires ? [À vérifier] : Google ne donne aucune métrique précise sur le gain réel de crawl budget lié au sitemap.

Dans quels cas le sitemap devient-il carrément inutile ?

Sur un site de 10 pages avec un maillage interne carré, le sitemap n'apporte strictement rien. Googlebot trouvera tout seul en deux passages. Même chose pour un blog de 50 articles bien liés entre eux.

Plus problématique : les sitemaps « fourre-tout » qui incluent des pages admin, des filtres dupliqués, des pages paginées — bref, du bruit. Là, non seulement le sitemap ne sert à rien, mais il embrouille le crawler et dilue les signaux importants.

Que fait-on des métadonnées lastmod, changefreq et priority ?

Google a confirmé à plusieurs reprises que priority est totalement ignoré. Pour changefreq, c'est flou — probablement pris comme un indice, mais sans garantie. Seul lastmod semble avoir un impact, et encore : à condition qu'il soit honnête et fiable.

Si vous mentez sur lastmod pour forcer le recrawl, Google finit par détecter le pattern et ignore le signal. Résultat : vous perdez en crédibilité globale.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son sitemap XML ?

Premièrement, ne listez que les pages indexables : pas de noindex, pas de canonicalisations vers d'autres URLs, pas de redirections. Chaque ligne du sitemap doit pointer vers une page 200 OK que vous voulez voir indexée.

Deuxièmement, segmentez vos sitemaps si votre site dépasse 1 000 URLs. Créez un sitemap index qui pointe vers plusieurs sitemaps thématiques (produits, catégories, articles). Ça aide Google à prioriser et ça facilite la maintenance.

Quelles erreurs éviter absolument ?

L'erreur classique : soumettre un sitemap et ne jamais le mettre à jour. Les pages supprimées restent listées, les nouvelles pages manquent à l'appel — Google perd confiance dans votre signal.

Autre piège : inclure des URLs bloquées par le robots.txt ou protégées par mot de passe. Google les découvre, tente de crawler, échoue, et gaspille du crawl budget pour rien.

Comment vérifier que mon sitemap fonctionne correctement ?

Utilisez la Search Console, section « Sitemaps ». Google vous indique combien d'URLs sont découvertes, combien sont indexées, et surtout combien génèrent des erreurs. Si le taux d'erreur dépasse 5%, il y a un problème structurel.

Ensuite, vérifiez les logs serveur : Googlebot visite-t-il les URLs listées dans le sitemap ? Si non, soit elles sont bloquées, soit Google juge qu'elles ne valent pas le coup. Dans les deux cas, il faut investiguer.

- Lister uniquement les pages indexables (200 OK, sans noindex, sans canonical ailleurs).

- Segmenter les sitemaps au-delà de 1 000 URLs via un sitemap index.

- Mettre à jour le sitemap automatiquement à chaque ajout/suppression de contenu.

- Exclure toute URL bloquée par robots.txt ou protégée par authentification.

- Vérifier régulièrement les erreurs dans la Search Console (section Sitemaps).

- Analyser les logs serveur pour confirmer que Googlebot crawle bien les URLs du sitemap.

- Ne pas mentir sur lastmod : indiquez uniquement les vraies dates de modification.

❓ Questions frequentes

Le sitemap XML garantit-il l'indexation de mes pages ?

Faut-il un sitemap pour un petit site de 20 pages ?

Dois-je inclure les métadonnées lastmod, changefreq et priority ?

Combien d'URLs peut contenir un sitemap XML ?

Que faire si Google détecte beaucoup d'erreurs dans mon sitemap ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 16/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.