Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Pourquoi Google déconseille-t-il l'utilisation du cache et de l'opérateur site: pour déboguer ?

- □ L'outil d'inspection d'URL peut-il vraiment diagnostiquer tous vos problèmes d'indexation ?

- □ Faut-il vraiment demander une exploration manuelle via l'outil d'inspection d'URL ?

- □ Pourquoi Google indexe-t-il parfois une URL différente de celle que vous attendez ?

- □ Pourquoi vérifier le HTML rendu peut-il révéler des erreurs invisibles dans votre code source ?

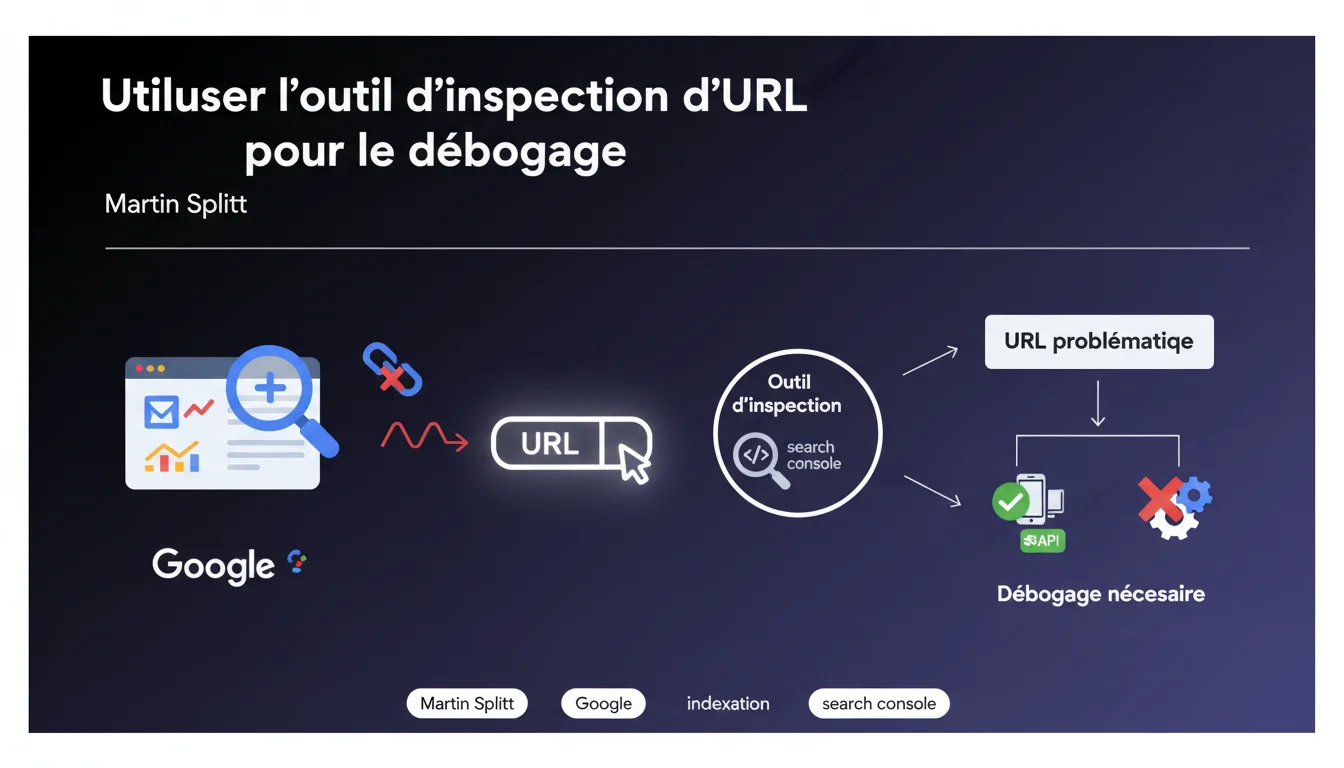

Google recommande l'outil d'inspection d'URL de Search Console comme solution prioritaire pour diagnostiquer les problèmes d'indexation. Martin Splitt positionne cet outil comme le premier réflexe pour comprendre pourquoi une page n'apparaît pas dans les résultats ou ne s'affiche pas comme attendu.

Ce qu'il faut comprendre

L'outil d'inspection d'URL dans Google Search Console permet d'analyser le statut d'indexation d'une page spécifique en temps réel. Il donne accès aux données de crawl, au rendu HTML tel que Googlebot le voit, et aux erreurs éventuelles qui bloquent l'indexation.

Google en fait ici son outil de référence pour le débogage rapide. Ce positionnement n'est pas anodin — il écarte d'autres méthodes comme l'analyse des logs ou les simulateurs externes.

Pourquoi cet outil est-il devenu incontournable ?

L'inspection d'URL agrège plusieurs informations critiques au même endroit : statut d'indexation, dernière exploration, couverture, problèmes de rendu JavaScript, données structurées détectées. Vous obtenez en quelques secondes une vue globale que d'autres outils mettraient plusieurs minutes à reconstituer.

Le test en direct permet aussi de vérifier si une correction récente est bien prise en compte par Googlebot — sans attendre le prochain crawl naturel.

Quelles informations concrètes peut-on en extraire ?

L'outil révèle si la page est indexable selon Google, si le robots.txt bloque l'accès, si une balise noindex est présente, si le rendu JavaScript échoue. Il affiche aussi le HTML tel que Googlebot le voit après exécution JS, ce qui permet de détecter des contenus masqués ou générés dynamiquement.

Vous accédez également aux Core Web Vitals de la page, à la version mobile/desktop, et aux demandes d'indexation prioritaires via le bouton « Demander une indexation ».

- Vue consolidée du statut d'indexation d'une URL précise

- Rendu HTML post-JavaScript pour diagnostiquer les problèmes de contenu dynamique

- Détection des blocages : robots.txt, noindex, erreurs serveur

- Possibilité de tester en direct une URL après correction

- Accès aux données structurées et aux Core Web Vitals

Cette méthode suffit-elle vraiment pour tous les diagnostics ?

Non. L'outil d'inspection d'URL analyse une page à la fois. Si votre problème touche 500 URLs ou un pattern global (template défaillant, pagination cassée), passer chaque URL en revue devient impraticable.

Il manque aussi la dimension temporelle : vous ne voyez qu'un instantané, pas l'historique des crawls ni la fréquence. Les logs serveur restent indispensables pour comprendre le comportement réel de Googlebot sur la durée.

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, en partie. L'outil d'inspection d'URL est effectivement devenu le point d'entrée naturel pour diagnostiquer un problème d'indexation ponctuel. Il centralise des données autrefois éparpillées et gagne du temps sur les diagnostics simples — balise noindex oubliée, erreur 404, blocage robots.txt.

Mais Google survend un peu son outil. Sur des sites complexes avec des milliers d'URLs, des problèmes de crawl budget ou des templates dynamiques, l'inspection URL par URL devient vite un goulot d'étranglement. Les équipes SEO aguerries savent qu'il faut croiser avec les rapports de couverture, les logs serveur et des outils tiers pour avoir une vision complète.

Quelles nuances faut-il apporter à cette déclaration ?

Martin Splitt ne précise pas à quel moment cet outil devient insuffisant. Or c'est rapide : dès qu'un problème touche plus de quelques URLs ou qu'il s'agit d'un bug intermittent, l'outil d'inspection montre ses limites. Il ne détecte pas les problèmes de crawl budget ni les baisses progressives de fréquence d'exploration.

Autre point — l'outil ne remplace pas une analyse approfondie du comportement de Googlebot. Les logs serveur révèlent les pages crawlées mais non indexées, les boucles de redirection, les timeouts. Rien de tout ça n'apparaît dans l'inspection d'URL. [A vérifier] sur les gros sites : l'outil d'inspection peut être trompeur si Googlebot ne crawle la page que tous les 15 jours.

Dans quels cas cette méthode ne suffit-elle absolument pas ?

Quand le problème est structurel plutôt que ponctuel. Exemple : une catégorie entière de produits non indexée parce que le template génère un canonical vers une page hub. Vous ne le verrez qu'en analysant plusieurs URLs du même template — et là, les rapports de couverture ou un crawl Screaming Frog sont plus pertinents.

Autre limite : les problèmes de rendu côté serveur versus JavaScript. L'outil d'inspection montre le rendu final, mais si Googlebot rencontre une erreur JS intermittente, vous ne le détecterez qu'en croisant avec les logs et des outils de monitoring. Soyons honnêtes — l'inspection d'URL est un excellent point de départ, mais elle ne remplace ni l'analyse globale ni le suivi dans le temps.

Impact pratique et recommandations

Que faut-il faire concrètement avec cet outil ?

Prenez l'habitude de l'utiliser en premier réflexe dès qu'une page n'apparaît pas dans l'index ou présente un comportement anormal. Entrez l'URL complète, analysez le statut d'indexation, puis consultez le rendu HTML pour vérifier que le contenu clé est bien visible par Googlebot.

Si le statut indique « URL non indexée », regardez la raison exacte : noindex détecté, blocage robots.txt, erreur 4xx/5xx, redirection imprévue. Corrigez le problème identifié, puis utilisez le test en direct pour valider que la correction est prise en compte avant de demander une réindexation.

Quelles erreurs faut-il absolument éviter ?

Ne vous arrêtez pas à l'outil d'inspection si le problème touche plusieurs pages. Un diagnostic URL par URL sur 50 pages est une perte de temps — utilisez les rapports de couverture ou un crawl complet pour identifier les patterns.

Autre piège : ne pas vérifier le rendu JavaScript. Si votre contenu principal se charge en JS, l'outil d'inspection est indispensable pour confirmer que Googlebot le voit bien. Mais attention — un rendu réussi dans l'outil ne garantit pas que toutes les URLs de votre site se rendent correctement.

Comment vérifier que votre diagnostic est complet ?

Croisez les données de l'outil d'inspection avec les rapports de couverture dans Search Console. Si une catégorie entière d'URLs présente le même problème, c'est souvent un souci de template ou de configuration serveur — pas un bug isolé.

Analysez aussi vos logs serveur sur 15-30 jours pour détecter des anomalies de crawl que l'outil d'inspection ne révèle pas : pages explorées mais non indexées, baisses de fréquence, erreurs serveur intermittentes. Le croisement logs + Search Console + crawl Screaming Frog donne une image fidèle de votre indexabilité réelle.

- Utiliser l'outil d'inspection d'URL comme point d'entrée pour tout diagnostic d'indexation ponctuel

- Vérifier systématiquement le rendu HTML et JavaScript dans l'outil

- Croiser avec les rapports de couverture Search Console pour détecter les problèmes récurrents

- Analyser les logs serveur pour identifier les comportements de crawl non visibles dans l'outil

- Ne jamais se fier uniquement à l'inspection d'URL sur un site de grande taille

- Tester en direct après chaque correction avant de demander une réindexation

L'outil d'inspection d'URL est un excellent point de départ pour diagnostiquer rapidement un problème d'indexation ponctuel. Il centralise des informations clés et permet de tester en temps réel l'impact d'une correction. Mais il ne remplace ni l'analyse globale via les rapports de couverture ni le suivi dans le temps via les logs serveur.

Sur des sites complexes ou de grande taille, ces diagnostics exigent une méthodologie structurée et des outils complémentaires. Si votre équipe manque de ressources ou d'expertise pour croiser ces sources de données et traduire les observations en actions correctives, faire appel à une agence SEO spécialisée peut accélérer considérablement la résolution de vos problèmes d'indexation.

❓ Questions frequentes

L'outil d'inspection d'URL montre-t-il le même rendu que Googlebot voit réellement en production ?

Peut-on utiliser cet outil pour diagnostiquer un problème de crawl budget ?

Faut-il systématiquement demander une indexation après avoir corrigé un problème ?

L'outil d'inspection peut-il détecter des problèmes de contenu dupliqué ?

Si l'outil d'inspection indique que la page est indexable, pourquoi n'apparaît-elle pas dans les résultats ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/12/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.