Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Les exports groupés Search Console vers BigQuery remplacent-ils vraiment l'API Search Analytics ?

- □ L'export groupé Search Console révèle-t-il enfin toutes les métriques de performance ?

- □ Pourquoi la Search Console ne compte-t-elle qu'une seule impression quand deux de vos pages apparaissent dans la même SERP ?

- □ Pourquoi la position 0 dans Search Console désigne-t-elle la position la plus haute ?

- □ Comment la table searchdata_url_impression agrège-t-elle les données de performance dans Google Search Console ?

- □ Pourquoi Google anonymise-t-il certaines URLs dans les données Discover de la Search Console ?

- □ Comment exploiter les champs d'apparence de recherche pour optimiser sa visibilité dans les SERP ?

- □ Faut-il vraiment limiter les requêtes par date dans Search Console pour optimiser ses performances ?

- □ Pourquoi faut-il impérativement filtrer les requêtes anonymisées dans Google Search Console ?

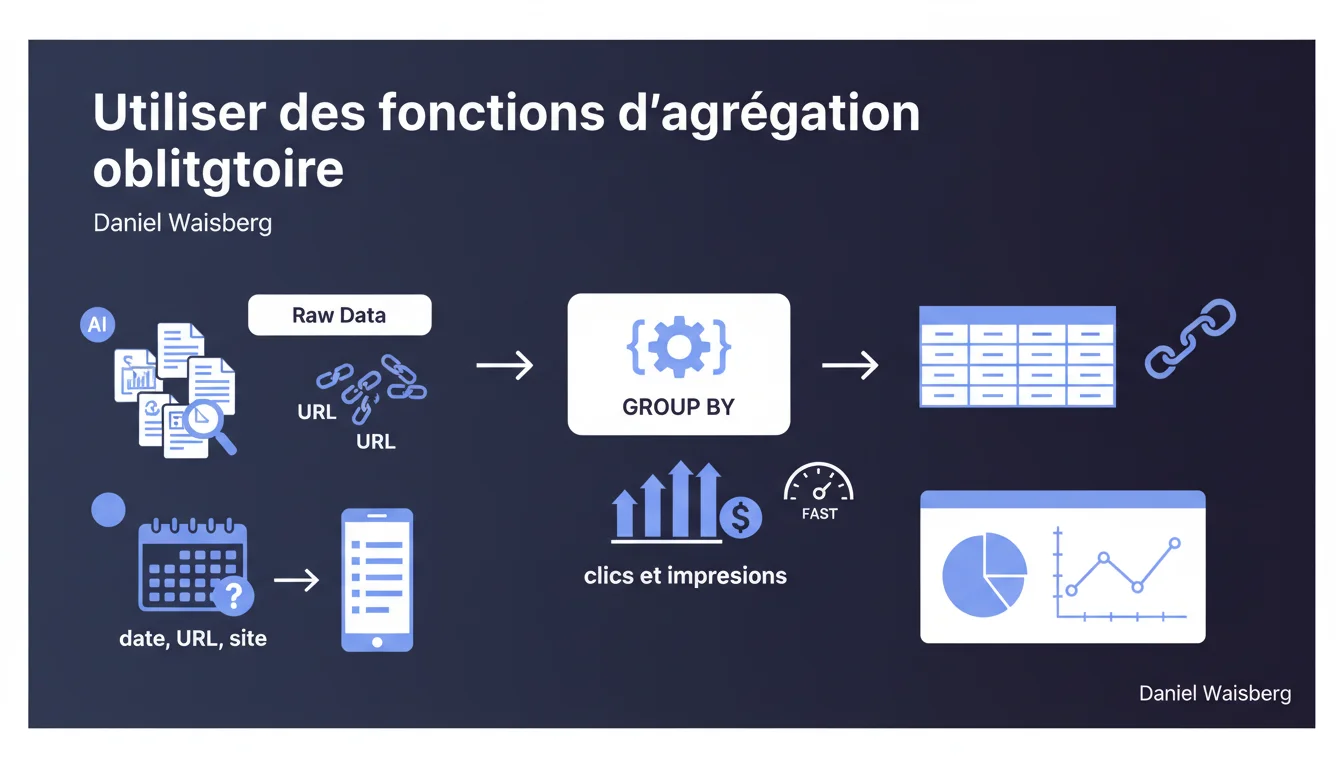

Google confirme que les données Search Console ne sont jamais consolidées par défaut : une même URL peut apparaître plusieurs fois pour la même date. L'utilisation de fonctions d'agrégation (SUM, COUNT) avec GROUP BY est donc obligatoire pour obtenir des totaux fiables de clics et impressions. Ignorer cette règle conduit à des analyses faussées et des décisions SEO erronées.

Ce qu'il faut comprendre

Cette déclaration de Daniel Waisberg porte sur l'exploitation des données de la Google Search Console via API ou exports. Le message est clair : ne jamais présumer que les lignes renvoyées sont déjà agrégées.

Pourquoi les données Search Console ne sont-elles pas consolidées par défaut ?

L'architecture interne de Google stocke les événements de recherche de manière granulaire. Une requête donnée peut générer plusieurs lignes dans la base de données pour la même URL et la même date, notamment si elle a été affichée dans différents contextes (appareil, localisation, type de résultat).

Quand vous extrayez des données brutes, vous obtenez cette granularité native. Google ne pré-agrège rien pour vous — c'est à vous de consolider.

Qu'est-ce qu'une fonction d'agrégation dans ce contexte ?

Il s'agit d'opérations SQL classiques comme SUM(), COUNT(), AVG() combinées avec GROUP BY. Par exemple : SELECT page, SUM(clicks), SUM(impressions) FROM data GROUP BY page.

Sans cette étape, vous risquez de compter plusieurs fois les mêmes clics ou impressions si vous faites simplement un total ligne par ligne.

Quelles sont les conséquences si on ignore cette règle ?

Vous obtenez des données surestimées — parfois spectaculairement. Les tableaux de bord affichent des totaux gonflés, les rapports stratégiques sont faussés, et les décisions SEO prises sur ces bases deviennent contre-productives.

C'est particulièrement critique quand on croise plusieurs dimensions (page + requête + appareil). Plus vous ajoutez de dimensions, plus le risque de duplication augmente.

- Les lignes du tableau Search Console ne sont jamais pré-consolidées par Google

- Une même requête peut apparaître plusieurs fois pour la même date et URL

- L'usage de SUM() et GROUP BY est obligatoire pour des totaux fiables

- Ignorer cette règle conduit à une surestimation systématique des performances

- Plus vous croisez de dimensions, plus le risque de duplication est élevé

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Tout professionnel qui a déjà exploité l'API Search Console a constaté ce comportement. Les exports bruts contiennent effectivement des lignes en apparence redondantes qui nécessitent une consolidation manuelle.

Ce qui est moins évident, c'est que même l'interface Web de la GSC fait ces agrégations en arrière-plan. Vous ne voyez jamais les lignes dupliquées — Google les masque. Mais dès que vous passez par l'API ou les exports BigQuery, vous êtes face à la réalité brute.

Pourquoi Google ne consolide-t-il pas directement ces données ?

La raison technique tient probablement à la scalabilité du système. Stocker des événements granulaires permet une flexibilité maximale pour croiser n'importe quelle dimension ultérieurement.

Pré-agréger toutes les combinaisons possibles (date × URL × requête × appareil × pays × type de résultat...) représenterait un volume de stockage et une complexité calculatoire exponentiels. Google préfère vous laisser agréger selon vos besoins.

Dans quels cas cette règle pose-t-elle le plus de problèmes ?

Les erreurs les plus fréquentes surviennent quand on construit des dashboards automatisés sans compétences SQL solides. Les non-techniciens récupèrent des exports CSV, font un simple SUM() dans Excel sans GROUP BY — et gonflent artificiellement les KPIs.

Autre piège : les outils tiers qui se connectent à l'API GSC. Si leur logique d'agrégation est mal codée, vous héritez de données faussées sans même le savoir. [À vérifier] systématiquement en comparant avec l'interface officielle.

Impact pratique et recommandations

Que faut-il faire concrètement avec les exports Search Console ?

Systématisez l'usage de requêtes SQL avec GROUP BY dès que vous manipulez des données brutes. Que ce soit dans BigQuery, un script Python, ou même Excel avec Power Query — consolidez toujours avant d'analyser.

Exemple type : SELECT date, page, SUM(clicks) AS total_clicks, SUM(impressions) AS total_impressions FROM gsc_data GROUP BY date, page. C'est la base minimale pour des totaux fiables.

Quelles erreurs éviter absolument ?

Ne jamais faire un simple total de colonne sans GROUP BY — c'est la source d'erreur numéro un. Ne jamais présumer qu'un export CSV de la GSC est déjà consolidé — il ne l'est jamais.

Autre piège : croiser trop de dimensions simultanément sans réfléchir à la granularité. Plus vous ajoutez de GROUP BY, plus vous fragmentez les données — mais trop peu de GROUP BY et vous doublez les comptages.

Comment vérifier que mes analyses sont correctes ?

Méthode infaillible : comparez vos totaux agrégés avec ceux affichés dans l'interface Web de Search Console pour la même période et les mêmes filtres. Si les chiffres divergent, c'est que votre agrégation est défectueuse.

Testez avec des cas limites — par exemple une seule URL sur une seule journée. Si vous obtenez plus de clics que ce que montre la GSC, vous avez un problème de consolidation.

- Toujours utiliser SUM() avec GROUP BY sur les données brutes Search Console

- Ne jamais faire de totaux directs sur les exports CSV sans consolidation préalable

- Valider vos agrégations en comparant avec l'interface officielle GSC

- Auditer les outils tiers qui se connectent à l'API pour vérifier leur logique d'agrégation

- Documenter vos requêtes SQL pour assurer la reproductibilité des analyses

- Former les équipes non-techniques aux bases de l'agrégation de données

L'exploitation correcte des données Search Console exige des compétences techniques solides en manipulation de données — SQL, scripting, ou au minimum maîtrise avancée d'Excel. Beaucoup d'entreprises sous-estiment cette complexité et se retrouvent avec des analyses faussées qui coûtent cher en décisions erronées.

Si votre équipe manque de ressources pour mettre en place une infrastructure d'analyse fiable, un accompagnement par une agence SEO spécialisée peut s'avérer judicieux. Au-delà de l'expertise technique, cela garantit des dashboards cohérents et évite les erreurs coûteuses de surestimation de performances.

❓ Questions frequentes

L'interface Web de Search Console agrège-t-elle automatiquement les données ?

Pourquoi une même requête apparaît-elle plusieurs fois pour la même date ?

Peut-on faire confiance aux totaux affichés dans les outils SEO tiers ?

Quelles fonctions d'agrégation utiliser pour les positions moyennes ?

Comment éviter les erreurs d'agrégation dans Excel ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/06/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.