Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Les exports groupés Search Console vers BigQuery remplacent-ils vraiment l'API Search Analytics ?

- □ Pourquoi la Search Console ne compte-t-elle qu'une seule impression quand deux de vos pages apparaissent dans la même SERP ?

- □ Pourquoi la position 0 dans Search Console désigne-t-elle la position la plus haute ?

- □ Comment la table searchdata_url_impression agrège-t-elle les données de performance dans Google Search Console ?

- □ Pourquoi Google anonymise-t-il certaines URLs dans les données Discover de la Search Console ?

- □ Comment exploiter les champs d'apparence de recherche pour optimiser sa visibilité dans les SERP ?

- □ Pourquoi Google impose-t-il l'usage de fonctions d'agrégation dans Search Console ?

- □ Faut-il vraiment limiter les requêtes par date dans Search Console pour optimiser ses performances ?

- □ Pourquoi faut-il impérativement filtrer les requêtes anonymisées dans Google Search Console ?

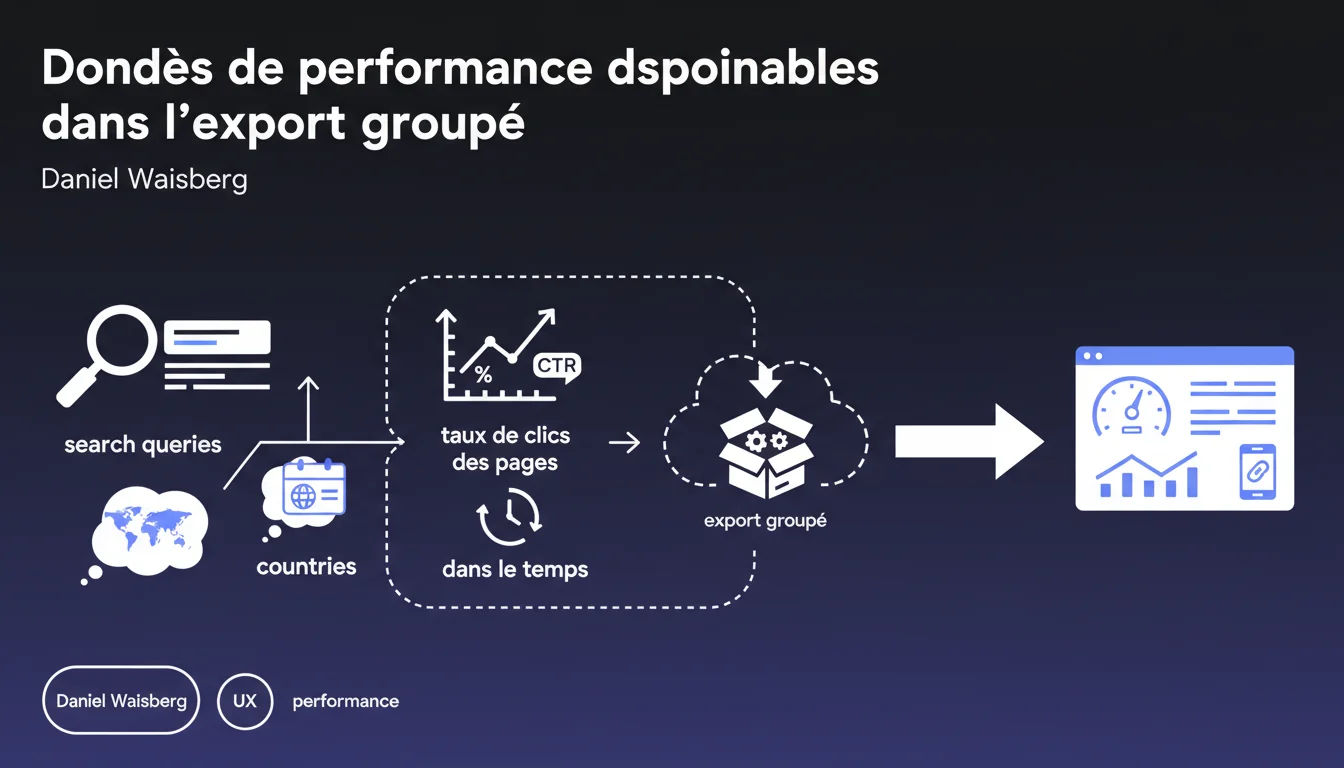

Google annonce l'intégration de données de performance dans l'export groupé Search Console : requêtes, CTR, répartition géographique et évolution temporelle. Une évolution qui centralise enfin plusieurs rapports dispersés dans un seul fichier exploitable à grande échelle.

Ce qu'il faut comprendre

Qu'apporte réellement l'export groupé enrichi de données de performance ?

L'export groupé Search Console permettait jusqu'ici d'extraire certaines données techniques (indexation, couverture), mais restait limité côté performance. Cette mise à jour intègre désormais les requêtes de recherche, le taux de clics par page, la répartition géographique des impressions et l'évolution de ces métriques dans le temps.

Concrètement ? Tu peux croiser ces données avec d'autres sources (Analytics, outils tiers) sans passer par l'interface Search Console — particulièrement utile pour les sites avec des milliers d'URLs ou plusieurs marchés géographiques. Les exports se font via BigQuery, donc exploitables en SQL ou connectés à des outils BI (Looker, Data Studio, Power BI).

Pourquoi Google pousse-t-il autant l'export groupé via BigQuery ?

Deux raisons principales. D'abord, l'interface Search Console classique a des limites strictes : 1 000 lignes max par export manuel, filtres basiques, historique de 16 mois seulement. Pour un site e-commerce multi-pays ou un média avec des centaines de milliers de pages, c'est inutilisable.

Ensuite, Google veut que les SEO manipulent eux-mêmes les données brutes plutôt que de se reposer sur des agrégations simplifiées. Ça correspond aussi à une logique de responsabilisation : si tu ne maitrises pas tes données, tu ne maitrises pas ton SEO. Et accessoirement, ça décharge leurs serveurs des requêtes lourdes côté interface.

Quelles métriques précises sont disponibles dans cet export ?

La déclaration reste floue sur la granularité exacte. On sait que les requêtes de recherche sont incluses (probablement avec impressions, clics, position moyenne), ainsi que le CTR par page et la dimension géographique (pays). L'évolution temporelle suggère un découpage par jour ou semaine.

- Requêtes : mots-clés ayant déclenché une impression, avec métriques associées

- CTR par page : ratio clics/impressions au niveau URL

- Dimension géographique : répartition par pays (probablement pas de granularité ville/région)

- Évolution temporelle : historique probablement complet (pas limité à 16 mois comme l'interface)

- Croisements possibles : requête × page × pays × date, selon la structure des tables BigQuery

Avis d'un expert SEO

Cette annonce change-t-elle vraiment la donne pour un SEO expérimenté ?

Oui et non. Si tu bosses déjà avec l'API Search Console ou des scrapes réguliers de l'interface, tu as probablement déjà ces données — mais de manière fragmentée et chronophage. L'export groupé via BigQuery centralise tout ça dans un pipeline stable, sans limite de lignes, sans risque de ban API.

Soyons honnêtes : pour les petits sites (< 10 000 pages, mono-marché), l'interface classique suffit largement. Mais dès que tu gères plusieurs domaines, plusieurs langues ou que tu veux croiser Search Console avec des données de crawl (Screaming Frog, OnCrawl) ou des conversions Analytics, BigQuery devient indispensable. Le problème, c'est que Google ne précise pas si les données exportées sont exactement les mêmes que celles affichées dans l'interface — historiquement, il y a eu des écarts de comptage.

Quelles limites Google ne mentionne pas dans cette déclaration ?

La communication est volontairement optimiste. Plusieurs points restent flous ou problématiques. D'abord, le seuil d'anonymisation : Google filtre les requêtes à faible volume (généralement < 3 impressions/jour) pour des raisons de confidentialité. Ça veut dire que tu ne verras jamais 100% de tes mots-clés, surtout en longue traîne.

Ensuite, la latence des données. L'export groupé a toujours eu 2-3 jours de retard par rapport à l'interface temps réel. Si tu veux détecter une chute brutale de trafic organique, tu passeras encore par l'interface classique ou Analytics. Enfin, la dimension géographique est probablement limitée au pays — pas de granularité région ou ville, contrairement à ce qu'on peut avoir dans Analytics 4.

Dans quels cas cette fonctionnalité est-elle surestimée ?

Si tu n'as pas de compétences SQL ou BI, BigQuery ne te servira à rien. L'interface Search Console classique reste plus accessible pour 90% des SEO. L'export groupé s'adresse aux équipes structurées (agences, e-commerce à fort volume, médias) avec des data analysts ou des SEO tech à l'aise avec les bases de données.

Et c'est là que ça coince : Google vend cette fonctionnalité comme une évolution majeure, mais elle ne change rien pour ceux qui ont déjà industrialisé leurs reportings. [A vérifier] si les tables exportées incluent réellement toutes les dimensions croisées (requête × page × pays × appareil × date) sans agrégation forcée. Si Google agrège certaines combinaisons, on perd en granularité par rapport à l'API.

Impact pratique et recommandations

Comment exploiter concrètement ces données exportées ?

Premier réflexe : connecte Search Console à un projet Google Cloud et active l'export vers BigQuery. Une fois la liaison établie, les données se synchronisent automatiquement chaque jour. Tu accèdes ensuite aux tables via l'interface BigQuery ou un connecteur (Looker Studio, Power BI, Tableau).

Les cas d'usage les plus fréquents ? Identifier les pages à fort potentiel de CTR (beaucoup d'impressions, peu de clics), détecter les requêtes qui perdent des positions dans le temps, comparer les performances par marché géographique pour prioriser les traductions ou adaptations locales. Tu peux aussi croiser avec des données de crawl pour repérer les pages performantes mais mal maillées, ou avec Analytics pour isoler les requêtes qui convertissent.

Quelles erreurs éviter lors de la mise en place ?

Ne sous-estime pas la complexité de la structure des tables. Google exporte les données dans des tables partitionnées par date, avec une nomenclature pas toujours intuitive. Si tu n'as jamais touché à BigQuery, prévois une phase d'apprentissage — ou fais-toi accompagner.

Autre piège : confondre l'export groupé avec un remplacement total de l'interface Search Console. Certaines fonctionnalités (Inspection d'URL, validations de correctifs, demandes de ré-indexation) restent exclusives à l'interface. L'export sert uniquement à l'analyse et au reporting, pas à l'action opérationnelle.

- Vérifie que ton compte Google Cloud est configuré avec les bonnes permissions (rôle BigQuery Admin minimum)

- Active l'export pour chaque propriété Search Console concernée (domaine principal + sous-domaines si séparés)

- Teste d'abord sur une propriété secondaire avant de déployer à grande échelle

- Surveille les coûts BigQuery dès le premier mois — configure des alertes de budget si nécessaire

- Documente ta structure de tables et tes requêtes SQL pour faciliter la passation en équipe

- Croise systématiquement avec Analytics 4 pour détecter les incohérences de comptage

❓ Questions frequentes

L'export groupé remplace-t-il l'API Search Console ?

Puis-je exporter les données de plusieurs propriétés dans un seul projet BigQuery ?

Les données exportées incluent-elles le type d'appareil (mobile, desktop, tablette) ?

Y a-t-il un délai entre l'interface Search Console et les données BigQuery ?

Combien coûte l'utilisation de BigQuery pour ces exports ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/06/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.