Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Faut-il vraiment optimiser les Core Web Vitals pour ranker sur Google ?

- □ Faut-il vraiment arrêter de sur-optimiser les Core Web Vitals ?

- □ Faut-il vraiment supprimer toutes les redirections de votre site ?

- □ Comment optimiser vos images pour améliorer votre SEO technique ?

- □ La vitesse du site est-elle vraiment un facteur de classement Google ?

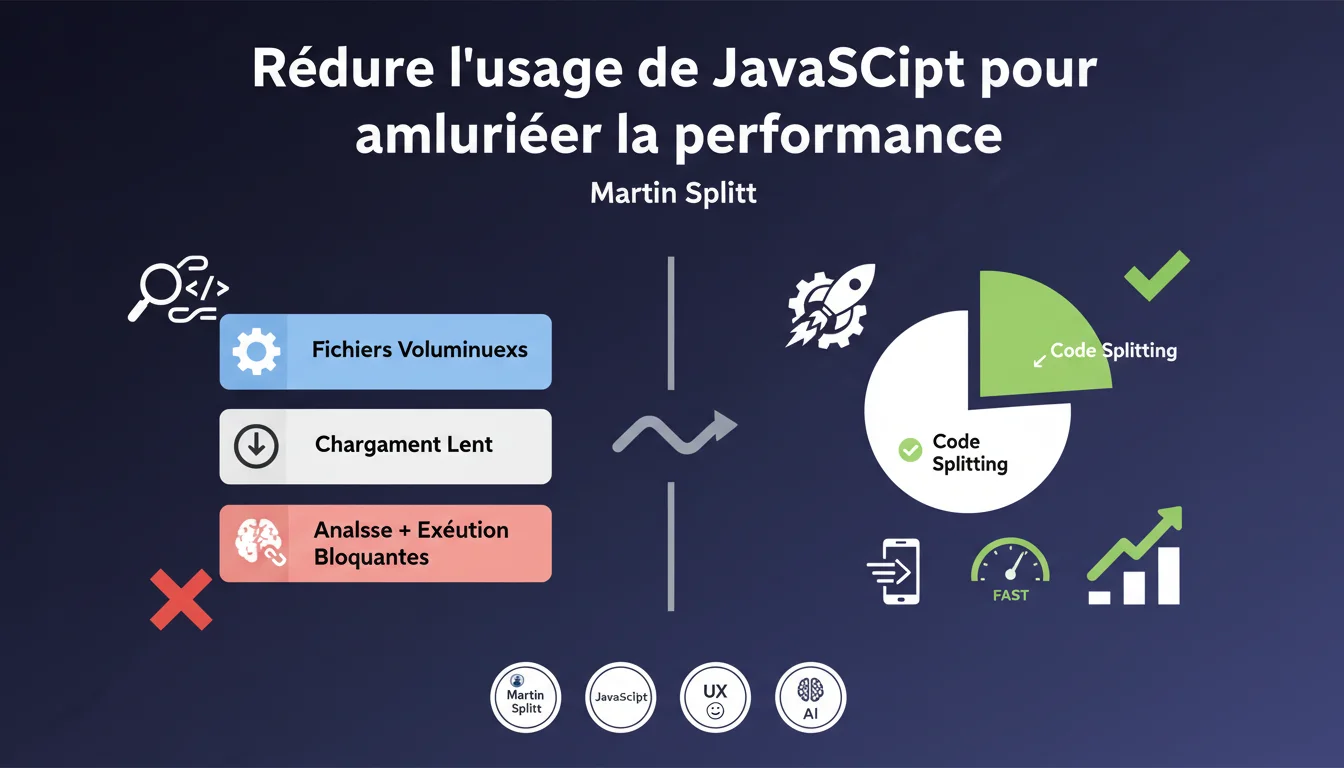

Google recommande officiellement de limiter l'usage de JavaScript car les fichiers volumineux ralentissent le chargement et nécessitent un temps d'analyse et d'exécution supplémentaire. La solution préconisée : le code splitting pour ne charger que le strict nécessaire par page. Une déclaration qui confirme ce que les audits terrain montrent depuis des années.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il autant sur la réduction du JavaScript ?

La raison est double. D'abord, les fichiers JavaScript sont souvent disproportionnellement lourds par rapport à leur utilité réelle pour l'utilisateur. Ensuite, contrairement au HTML ou CSS, le JavaScript nécessite une phase d'analyse syntaxique puis d'exécution par le moteur du navigateur — deux étapes coûteuses en temps processeur.

Pour Googlebot, c'est la même histoire. Le bot doit attendre que le JavaScript s'exécute pour accéder au contenu final de la page. Plus le traitement est lourd, plus le crawl budget est gaspillé, et plus le risque d'indexation partielle augmente.

Qu'est-ce que le code splitting exactement ?

Le code splitting consiste à découper votre application JavaScript en morceaux indépendants (chunks) qui ne se chargent que lorsque c'est nécessaire. Au lieu d'envoyer 500 Ko de JS dès la page d'accueil, vous n'envoyez que les 80 Ko requis pour cette page précise.

Les frameworks modernes (React, Vue, Angular) proposent tous des mécanismes natifs de code splitting. Le principe : lazy loading des composants, routes dynamiques, et imports conditionnels. Concrètement ? Vous réduisez le Time to Interactive et le Total Blocking Time — deux métriques surveillées par Google.

Cette recommandation s'applique-t-elle à tous les sites ?

Non. Un site vitrine avec quelques interactions légères n'a pas les mêmes enjeux qu'une application web complexe (SaaS, marketplace, plateforme e-commerce avancée). Pour un blog WordPress classique, le problème vient souvent des plugins qui injectent du JavaScript inutile, pas d'une architecture applicative.

En revanche, pour les sites qui génèrent leur HTML côté client (Single Page Applications), cette déclaration est un rappel brutal : le rendu côté serveur (SSR) ou la génération statique (SSG) restent des solutions plus SEO-friendly que le pur client-side rendering.

- Le JavaScript ralentit le chargement car il nécessite analyse et exécution, pas juste téléchargement

- Le code splitting permet de charger uniquement le code nécessaire par page

- Googlebot est impacté : plus le JS est lourd, plus le crawl est inefficace

- Les sites vitrines et les SPA n'ont pas les mêmes problématiques JavaScript

- SSR et SSG restent les architectures les plus favorables au SEO

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Les audits techniques révèlent systématiquement que les sites avec des Total Blocking Time élevés (> 600 ms) ont des taux de crawl plus faibles et des problèmes d'indexation. Les tests avec Chrome DevTools montrent que certains sites chargent 2 à 3 Mo de JavaScript dont moins de 30 % est réellement utilisé.

Ce qui est frappant, c'est que Google ne donne aucun seuil quantitatif. Combien de Ko maximum ? Quel TBT limite ? Quel budget d'exécution acceptable ? Rien. On reste dans le flou — et c'est probablement volontaire pour éviter que les sites optimisent uniquement pour un chiffre arbitraire.

Quelles nuances faut-il apporter ?

Réduire le JavaScript, oui, mais pas au détriment de l'expérience utilisateur. Un site qui charge instantanément mais dont les interactions sont cassées ou lentes ne sert à rien. Le code splitting mal implémenté peut introduire des saccades, des temps de latence sur les clics, ou pire : des erreurs d'exécution.

Autre point : cette recommandation s'adresse surtout aux nouveaux projets. Refactoriser une SPA legacy en SSR représente des semaines de développement. Il faut évaluer le ROI. Parfois, des quick wins comme le lazy loading d'images ou la compression Brotli apportent plus de gains pour moins d'efforts.

[A vérifier] : Google ne précise pas comment il pondère la performance JavaScript dans son algorithme de classement. On sait que les Core Web Vitals comptent, mais leur poids exact reste inconnu. Les tests A/B montrent des gains de positions après optimisation, mais les corrélations ne sont jamais linéaires.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Les applications métier (dashboards, CRM, outils internes) n'ont aucun intérêt SEO. Leur optimisation doit viser la productivité utilisateur, pas Googlebot. De même, certaines fonctionnalités avancées (visualisation de données en temps réel, éditeurs WYSIWYG) nécessitent forcément du JavaScript lourd.

Pour les sites e-commerce avec filtres dynamiques complexes, un compromis intelligent consiste à implémenter un rendu hybride : HTML statique pour le contenu crawlable, JavaScript progressif pour les interactions. C'est plus complexe, mais ça évite de sacrifier UX ou SEO.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire l'impact du JavaScript ?

Première étape : auditer ce qui est réellement chargé. Chrome DevTools > Coverage vous montre le pourcentage de code inutilisé. WebPageTest détaille le poids de chaque script et son impact sur le TBT. Identifiez les bibliothèques tierces (analytics, chat, publicité) qui pèsent lourd sans apporter de valeur SEO.

Ensuite, implémentez le code splitting si vous utilisez un bundler moderne (Webpack, Vite, Rollup). Configurez le lazy loading des composants non critiques. Pour les librairies tierces, différez leur chargement avec l'attribut defer ou async, voire chargez-les uniquement après interaction utilisateur.

Enfin, si votre site est une SPA pure, envisagez une migration vers un framework avec SSR natif (Next.js, Nuxt, SvelteKit). Le gain SEO est immédiat : HTML exploitable dès le premier octet reçu, sans attendre l'exécution JavaScript.

Quelles erreurs éviter absolument ?

Ne cassez pas le rendu progressif. Certains sites chargent tout le JavaScript de manière asynchrone, ce qui crée un flash de contenu non stylisé (FOUC) ou des layouts qui sautent. Google pénalise le Cumulative Layout Shift — une optimisation mal pensée peut aggraver le problème.

Évitez aussi de croire qu'un bon score Lighthouse règle tout. Les tests Lighthouse se font en environnement contrôlé. En conditions réelles (réseau mobile 3G, devices bas de gamme), votre site peut rester catastrophique. Testez avec WebPageTest sur différents profils.

Comment vérifier que mon site est conforme aux attentes de Google ?

Utilisez la Google Search Console pour surveiller les Core Web Vitals en données terrain (CrUX). Si plus de 25 % de vos URLs sont en « mauvais » sur mobile, c'est un signal d'alarme. Croisez avec un audit Screaming Frog + Chrome DevTools pour identifier les pages les plus problématiques.

Testez aussi l'indexation réelle avec l'outil d'inspection d'URL. Comparez le HTML brut et le rendu final. Si Googlebot voit une page blanche ou incomplète, c'est que votre JavaScript bloque l'indexation. Dans ce cas, SSR ou pré-rendu statique deviennent indispensables.

- Auditer le code JavaScript inutilisé avec Chrome DevTools Coverage

- Implémenter le code splitting via votre bundler (Webpack, Vite, Rollup)

- Différer les scripts tiers non critiques avec

deferouasync - Envisager une migration SSR pour les Single Page Applications

- Surveiller les Core Web Vitals dans la Search Console (données CrUX)

- Tester le rendu Googlebot avec l'outil d'inspection d'URL

- Vérifier le TBT et le CLS en conditions réelles avec WebPageTest

La réduction du JavaScript n'est pas un caprice de Google, c'est une nécessité technique pour améliorer à la fois l'expérience utilisateur et l'efficacité du crawl. Le code splitting, le lazy loading et le SSR sont des leviers actionnables immédiatement.

Ces optimisations demandent cependant une expertise technique pointue et une vision architecturale claire. Entre refactoring, gestion des dépendances et tests de non-régression, les pièges sont nombreux. Si votre équipe manque de ressources ou de temps, solliciter une agence SEO spécialisée dans les problématiques de performance JavaScript peut accélérer considérablement le chantier et éviter les erreurs coûteuses.

❓ Questions frequentes

Le code splitting est-il compatible avec tous les frameworks JavaScript ?

Googlebot exécute-t-il tout le JavaScript de ma page ?

Un site rapide en Lighthouse peut-il être lent pour Googlebot ?

Faut-il privilégier SSR ou SSG pour le SEO ?

Les scripts tiers (analytics, chat) impactent-ils vraiment le SEO ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/09/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.