Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Faut-il encore utiliser rel=next et rel=prev pour la pagination ?

- □ Faut-il vraiment valider son HTML W3C pour être crawlé par Google ?

- □ Google rend-il vraiment l'intégralité de vos pages JavaScript ?

- □ Le HTML sémantique renforce-t-il vraiment la confiance de Google dans votre contenu ?

- □ Google lit-il vraiment vos retours sur sa documentation SEO ?

- □ Peut-on vraiment faire confiance à la documentation officielle de Google ?

- □ Pourquoi vos scores PageSpeed Insights changent-ils à chaque test ?

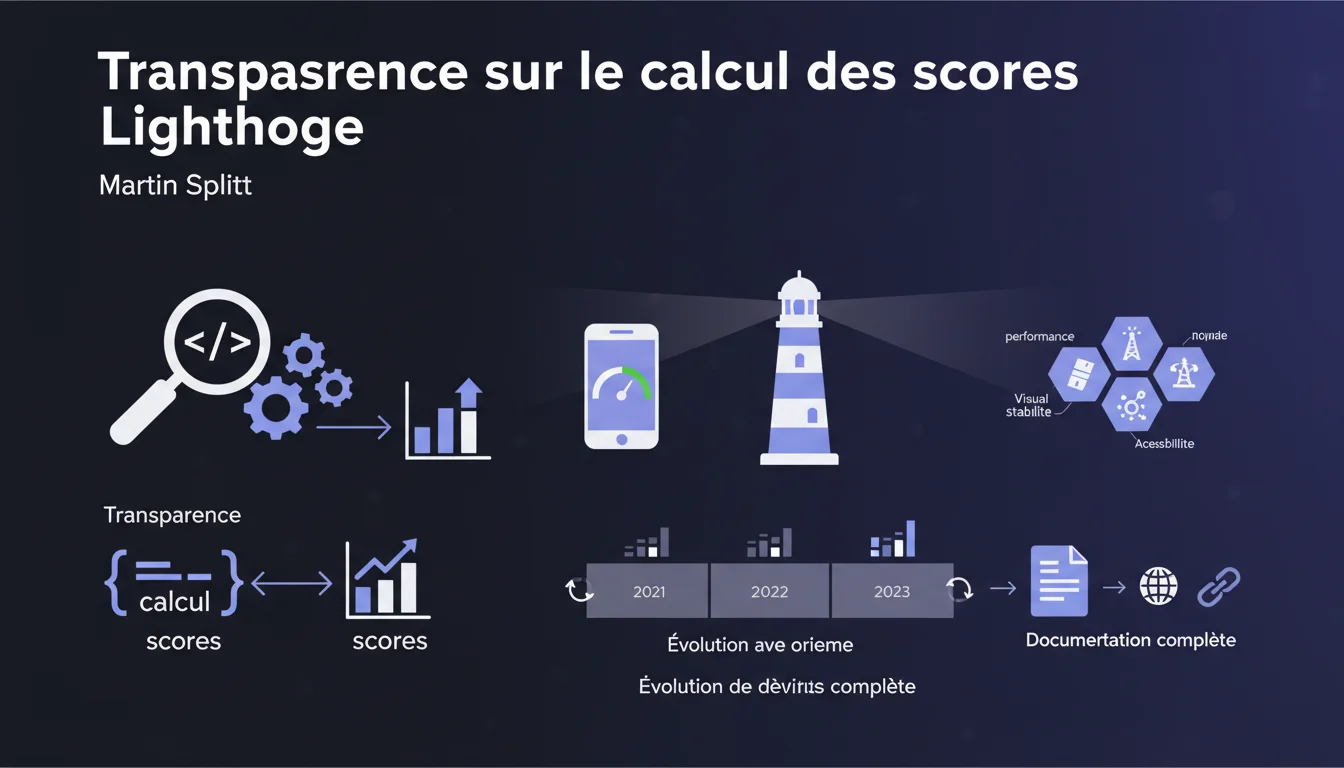

Google affirme que Lighthouse expose en détail ses méthodes de calcul de scores et la pondération des métriques. Cette documentation permettrait aux professionnels SEO de comprendre exactement comment les performances sont évaluées et comment ces critères évoluent. Soyons honnêtes : reste à vérifier si cette transparence est aussi complète qu'annoncée sur le terrain.

Ce qu'il faut comprendre

Que signifie vraiment cette transparence annoncée ?

Google communique sur l'existence d'une documentation détaillée décrivant les algorithmes de calcul des scores Lighthouse. Cette documentation expliquerait non seulement les métriques prises en compte, mais aussi leur pondération respective.

Concrètement, l'équipe Lighthouse met à disposition des ressources techniques permettant de comprendre pourquoi un site obtient tel ou tel score. Les coefficients appliqués à chaque métrique (LCP, FID, CLS, etc.) seraient documentés, avec leurs évolutions dans le temps.

Pourquoi cette évolution de pondération est-elle importante ?

Les poids des différentes métriques ne sont pas figés. L'équipe Lighthouse ajuste régulièrement ces pondérations en fonction de l'évolution du web et des priorités de Google.

Un site peut donc voir son score varier même sans modification technique — simplement parce que les critères d'évaluation ont été réajustés. Cette instabilité complique le pilotage des performances sur le long terme.

Où trouve-t-on cette fameuse documentation ?

La documentation officielle Lighthouse est hébergée sur GitHub et le site web.dev de Google. Elle détaille les formules mathématiques appliquées pour calculer chaque score partiel et le score global.

Les changements de pondération sont généralement annoncés via les release notes de Lighthouse, avec parfois plusieurs mois de préavis avant leur application en production.

- Les scores Lighthouse reposent sur des calculs documentés publiquement

- La pondération des métriques évolue régulièrement selon les priorités Google

- Cette évolution peut faire varier les scores même sans modification du site

- La documentation technique est accessible sur GitHub et web.dev

- Les changements majeurs sont généralement annoncés à l'avance via les release notes

Avis d'un expert SEO

Cette transparence est-elle aussi complète qu'annoncée ?

Sur le papier, la documentation Lighthouse est effectivement fournie. Les formules sont là, les coefficients aussi. Mais — et c'est là que ça coince — la complexité technique rend cette transparence peu exploitable pour la majorité des praticiens.

Les algorithmes de calcul font intervenir des distributions statistiques, des courbes logarithmiques et des ajustements qui nécessitent des compétences pointues en data science pour être véritablement compris. La transparence existe, mais elle reste théorique pour beaucoup. [A vérifier] : est-ce que Google fournit vraiment TOUS les paramètres ou certains restent-ils dans une boîte noire ?

Les évolutions de pondération posent-elles un problème de stabilité ?

Absolument. J'ai observé sur des projets clients des variations de scores de 5 à 15 points sans aucune modification technique du site. Ces fluctuations suivaient simplement des mises à jour de Lighthouse.

Cette instabilité complique le reporting client et le suivi des performances dans le temps. Comment justifier une baisse de score quand c'est l'outil de mesure qui a changé, pas le site ? Google communique sur la transparence, mais la prévisibilité reste un vrai problème.

Peut-on réellement piloter ses optimisations avec ces données ?

Oui, mais avec des réserves. Les métriques individuelles (LCP, CLS, etc.) restent des indicateurs fiables pour identifier les problèmes. C'est le score global synthétique qui pose question.

En pratique, je recommande de suivre les métriques brutes plutôt que le score agrégé. Un LCP à 1,8s a du sens. Un score Lighthouse à 87 reste une abstraction dont l'interprétation varie selon la version de l'outil et ses pondérations du moment.

Impact pratique et recommandations

Que faut-il faire concrètement avec ces informations ?

Première règle : ne pilotez jamais vos optimisations uniquement sur le score Lighthouse global. Concentrez-vous sur les métriques individuelles et leurs valeurs absolues.

Consultez régulièrement la documentation Lighthouse pour anticiper les changements de pondération. Abonnez-vous aux notifications GitHub du projet Lighthouse pour être alerté des évolutions majeures.

Comment interpréter correctement les variations de scores ?

Avant de paniquer devant une baisse de score, vérifiez trois éléments : la version de Lighthouse utilisée, les éventuels changements de pondération récents, et les données CrUX réelles de vos utilisateurs.

Si vos métriques terrain (accessibles via CrUX ou vos propres outils RUM) restent stables, une variation du score Lighthouse lab n'est probablement qu'un artefact méthodologique. Concentrez-vous sur l'expérience utilisateur réelle.

Quelles erreurs éviter dans le suivi des performances ?

Ne comparez jamais des scores issus de versions différentes de Lighthouse. Les pondérations ayant changé, la comparaison n'a aucun sens statistique.

Évitez de fixer des objectifs basés uniquement sur le score global ("atteindre 90+"). Préférez des objectifs sur des métriques précises : LCP < 2,5s, CLS < 0,1, etc.

- Suivre les métriques individuelles plutôt que le score global synthétique

- Documenter la version de Lighthouse utilisée à chaque mesure pour comparaisons valides

- S'abonner aux release notes GitHub de Lighthouse pour anticiper les changements

- Prioriser les données CrUX terrain sur les scores lab pour le pilotage stratégique

- Fixer des objectifs sur des valeurs métriques absolues, pas sur des scores agrégés

- Mettre en place un monitoring RUM pour capturer les performances réelles utilisateurs

- Ne jamais comparer des scores issus de versions différentes de l'outil

❓ Questions frequentes

Les scores Lighthouse ont-ils un impact direct sur le classement Google ?

Pourquoi mon score Lighthouse varie-t-il d'un test à l'autre sans modification du site ?

Quelle version de Lighthouse utilise PageSpeed Insights ?

Faut-il viser un score Lighthouse de 100 ?

Les données CrUX sont-elles plus fiables que les scores Lighthouse ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.