Declaration officielle

Ce qu'il faut comprendre

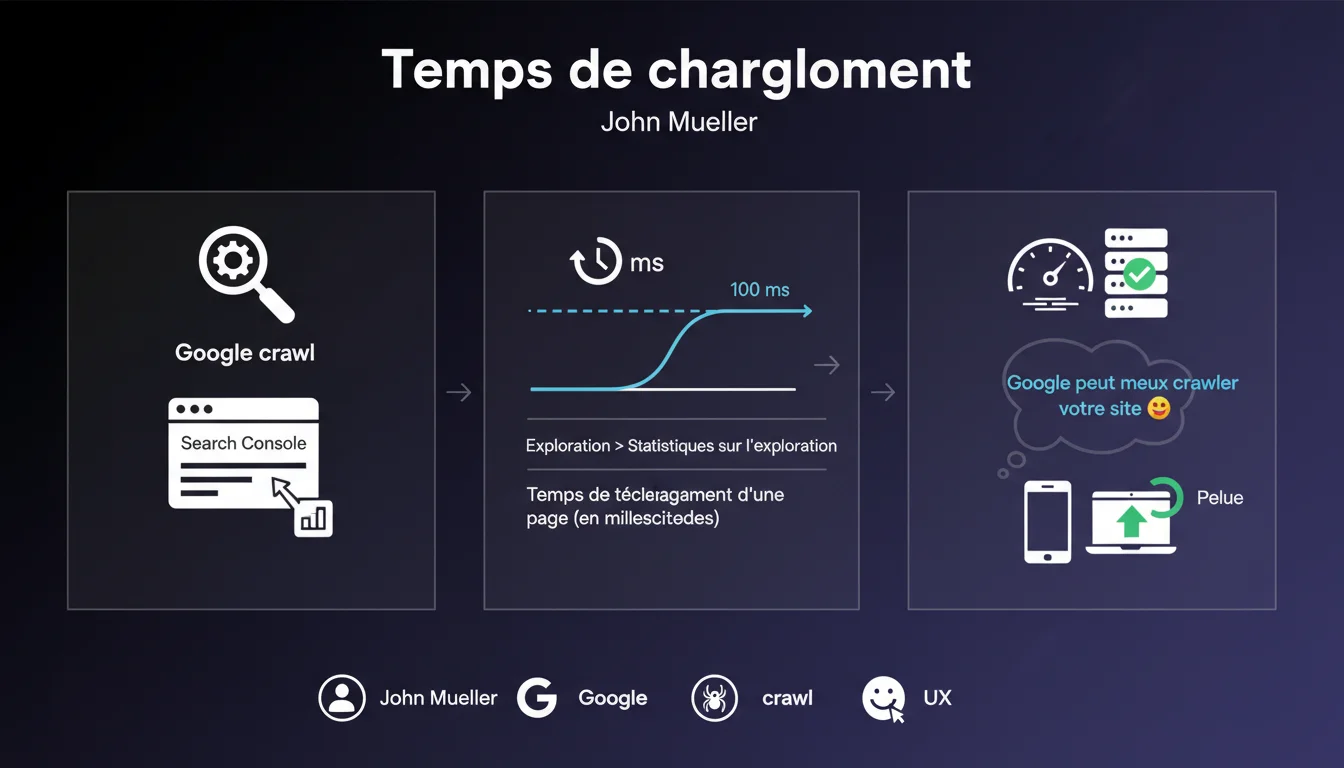

Quelle métrique de temps de chargement Google recommande-t-il de surveiller ?

Google recommande de surveiller attentivement la métrique "Temps de téléchargement d'une page" disponible dans la Search Console, section "Exploration > Statistiques sur l'exploration". Cette métrique mesure le temps nécessaire à Googlebot pour télécharger le contenu HTML de vos pages, exprimé en millisecondes.

L'objectif idéal serait d'atteindre une moyenne oscillant autour de 100 millisecondes. Cette recommandation vise à optimiser l'efficacité du crawl de votre site par les robots de Google.

Quel est le lien entre temps de téléchargement et budget de crawl ?

Plus vos pages se téléchargent rapidement, plus Google peut crawler efficacement votre site. Un temps de téléchargement faible permet à Googlebot d'explorer un plus grand nombre de pages dans le même laps de temps, maximisant ainsi l'utilisation de votre budget de crawl.

Cette optimisation est particulièrement critique pour les sites volumineux comportant des milliers ou millions de pages. Une amélioration de quelques centaines de millisecondes peut se traduire par des milliers de pages supplémentaires crawlées quotidiennement.

Pourquoi cette métrique diffère-t-elle des autres indicateurs de performance ?

Le temps de téléchargement mesuré dans la Search Console se distingue des Core Web Vitals ou des métriques orientées utilisateur. Il mesure uniquement le temps nécessaire pour que Googlebot reçoive le HTML brut, sans exécution JavaScript ni chargement des ressources.

- Métrique server-side : Reflète la performance du serveur et du réseau, pas l'expérience utilisateur

- Focus sur le crawl : Impacte directement l'efficacité de l'exploration par Google

- Indépendante du rendu : Ne prend pas en compte le temps d'affichage ou d'interaction

- Indicateur de santé technique : Révèle des problèmes d'infrastructure ou de configuration serveur

Avis d'un expert SEO

L'objectif de 100 ms est-il réaliste pour la plupart des sites ?

Selon mon expérience avec des centaines de projets SEO, l'objectif de 100 ms reste extrêmement difficile à atteindre et maintenir durablement. La majorité des sites que j'audite affichent des temps de téléchargement entre 300 et 800 millisecondes, sans que cela n'impacte négativement leur visibilité.

Les sites atteignant consistanment 100 ms sont généralement des configurations très optimisées : CDN premium, infrastructure cloud dédiée, pages statiques légères. Pour un site WordPress standard ou une plateforme e-commerce complexe, viser 200-300 ms constitue déjà un excellent objectif.

Cette métrique a-t-elle un impact direct sur le classement SEO ?

Il faut distinguer corrélation et causalité. Un temps de téléchargement rapide améliore le crawl, ce qui peut indirectement favoriser l'indexation de nouvelles pages ou la détection rapide de mises à jour. Cependant, ce n'est pas un facteur de classement direct.

J'ai observé des sites avec des temps supérieurs à 500 ms qui rankent excellemment, tandis que d'autres à 150 ms peinent. La qualité du contenu, l'autorité du domaine et la pertinence restent prioritaires. Cette métrique devient critique uniquement pour les sites avec des problèmes de crawl avérés (pages orphelines, contenu non indexé).

Quels sont les vrais leviers pour améliorer cette métrique ?

Les optimisations les plus efficaces concernent l'infrastructure serveur plutôt que le code. Un serveur sous-dimensionné ou mal configuré peut ajouter 200-400 ms facilement. La compression Gzip/Brotli, la mise en cache serveur et l'optimisation des requêtes base de données sont des gains rapides.

La taille du HTML joue également un rôle majeur. Un document de 200 Ko prendra mécaniquement plus de temps à transférer qu'un de 50 Ko. Évitez le code HTML inutile, les commentaires excessifs et le JavaScript inline volumineux dans le HTML initial.

Impact pratique et recommandations

Comment auditer efficacement les temps de téléchargement de son site ?

Accédez à la Search Console puis naviguez vers "Paramètres > Exploration > Statistiques sur l'exploration". Observez l'évolution de la courbe sur les 90 derniers jours pour identifier les tendances et les pics anormaux.

Comparez cette métrique avec votre volume de pages crawlées quotidiennement. Si vous constatez une corrélation entre hausse des temps de téléchargement et baisse du crawl, vous avez identifié un problème prioritaire à résoudre.

Utilisez également des outils comme Screaming Frog ou Oncrawl pour mesurer les temps de réponse serveur depuis différentes localisations. Croisez ces données avec celles de la Search Console pour une vision complète.

Quelles actions concrètes mettre en place pour réduire ces temps ?

- Activer la compression : Vérifiez que Gzip ou Brotli sont activés sur votre serveur

- Optimiser le serveur : Augmentez les ressources (CPU/RAM) si nécessaire, utilisez PHP 8+ et OPcache

- Implémenter un CDN : Cloudflare, Fastly ou AWS CloudFront pour rapprocher le contenu de Googlebot

- Alléger le HTML : Supprimez le code inutile, minifiez le HTML, différez le JavaScript non-critique

- Optimiser la base de données : Indexez correctement les tables, nettoyez les données obsolètes

- Activer le cache serveur : Varnish, Redis ou solutions équivalentes pour servir du contenu pré-généré

- Monitorer régulièrement : Configurez des alertes pour détecter les dégradations de performance

Quelle priorité accorder à cette optimisation dans votre stratégie SEO ?

Cette métrique mérite une attention modérée dans votre stratégie globale. Priorisez-la si vous rencontrez des problèmes d'indexation, si vous gérez un site de grande envergure (>10 000 pages) ou si votre budget de crawl est visiblement limité.

Pour les sites de taille moyenne avec un bon taux d'indexation, concentrez-vous d'abord sur le contenu de qualité, l'architecture d'information et les Core Web Vitals. Un temps de 300-500 ms reste tout à fait acceptable.

💬 Commentaires (0)

Soyez le premier à commenter.