Declaration officielle

Ce qu'il faut comprendre

Pourquoi Google ne peut-il pas accepter les cookies lors du crawl ?

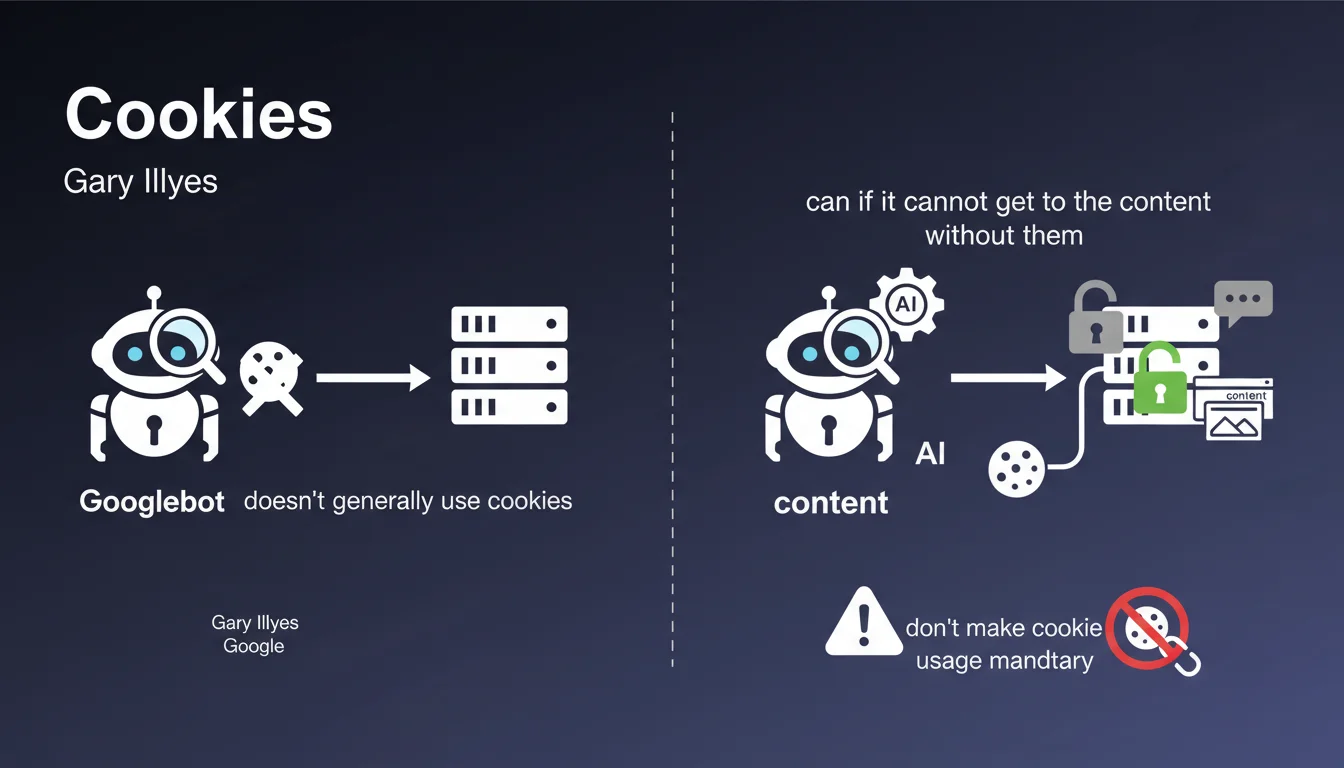

Les robots d'exploration de Google (Googlebot) ne peuvent pas interagir avec les éléments JavaScript nécessitant une action utilisateur comme cliquer sur un bouton. Ils parcourent le web de manière automatisée et ne disposent pas de la capacité de consentir à l'acceptation de cookies.

Lorsqu'une page affiche une bannière de cookies qui bloque l'accès au contenu principal tant que l'utilisateur n'a pas fait son choix, Googlebot se retrouve face à un mur infranchissable. Il ne voit alors qu'une page vide ou partiellement accessible, ce qui compromet gravement l'indexation.

Quelles sont les conséquences concrètes pour l'indexation ?

Si votre contenu est masqué derrière une bannière de cookies bloquante, Google ne pourra pas l'analyser, le comprendre ni le positionner dans ses résultats de recherche. Cela équivaut à rendre vos pages invisibles pour le moteur de recherche.

Cette situation affecte particulièrement les sites qui utilisent des solutions de gestion du consentement mal configurées, où le contenu principal est inaccessible sans interaction préalable. Le risque est une chute drastique du trafic organique.

Comment cette problématique s'inscrit-elle dans le cadre du RGPD ?

Le RGPD impose le consentement explicite des utilisateurs avant de déposer des cookies non essentiels. Cette contrainte légale entre parfois en conflit avec les besoins techniques du SEO si elle est mal implémentée.

La solution réside dans une implémentation intelligente qui respecte à la fois la législation et les exigences du référencement naturel. Il est possible d'être conforme au RGPD tout en restant crawlable.

- Googlebot ne peut pas cliquer sur les bannières de cookies ni accepter les conditions

- Un contenu bloqué par une bannière de consentement devient invisible pour Google

- Cette situation peut entraîner une désindexation progressive des pages affectées

- Le RGPD et le SEO peuvent coexister avec une configuration appropriée

- Les cookies essentiels au fonctionnement du site peuvent être exemptés du consentement

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Sur le terrain, nous observons régulièrement des pertes de visibilité importantes après l'installation de solutions de gestion du consentement mal configurées. Les outils comme Google Search Console révèlent souvent des erreurs de rendu sur ces pages.

Les tests avec l'outil d'inspection d'URL de la Search Console montrent clairement que lorsque le contenu est conditionné à l'acceptation de cookies, Googlebot reçoit une version appauvrie de la page. Cette réalité technique est confirmée par les audits réguliers que nous menons.

Quelles nuances essentielles faut-il apporter à cette règle ?

Il existe une distinction fondamentale entre les bannières qui bloquent l'affichage du contenu (modal overlay) et celles qui se superposent simplement sans empêcher l'accès. Seules les premières posent réellement problème pour le crawl.

De plus, certains cookies dits "techniques" ou "essentiels" au fonctionnement du site ne nécessitent pas de consentement selon le RGPD. Ces cookies peuvent être déposés automatiquement sans compromettre ni la conformité légale ni le référencement naturel.

Dans quels cas spécifiques cette règle nécessite-t-elle une attention particulière ?

Les sites e-commerce sont particulièrement vulnérables car ils utilisent souvent de nombreux cookies pour le tracking, le panier, les recommandations personnalisées. Une mauvaise configuration peut rendre les fiches produits invisibles pour Google.

Les sites médias et éditoriaux qui monétisent via la publicité programmatique sont également concernés. Leur dépendance aux cookies tiers les pousse parfois à mettre en place des bannières très restrictives qui impactent négativement le crawl et l'indexation.

Impact pratique et recommandations

Que faut-il vérifier immédiatement sur votre site ?

Utilisez l'outil d'inspection d'URL de Google Search Console sur vos pages principales pour visualiser exactement ce que Googlebot perçoit. Comparez cette vue avec celle d'un navigateur classique pour identifier les éventuelles différences.

Testez également vos pages en mode navigation privée sans accepter les cookies. Si le contenu principal n'est pas visible ou accessible, vous avez identifié un problème critique à corriger immédiatement.

Quelles sont les bonnes pratiques d'implémentation à suivre ?

Configurez votre bannière de cookies en mode non-bloquant : elle doit s'afficher en overlay (superposition) mais permettre l'accès au contenu sans nécessiter d'action préalable. L'utilisateur peut scroller et lire même si la bannière est présente.

Utilisez un détecteur de bots dans votre CMP pour servir automatiquement aux robots d'exploration une version sans bannière bloquante. La plupart des solutions professionnelles proposent cette fonctionnalité nativement.

Assurez-vous que les cookies strictement nécessaires au fonctionnement technique du site (session, sécurité, équilibrage de charge) sont exemptés du consentement et déposés automatiquement. Cela respecte le RGPD tout en préservant le SEO.

- Tester le rendu de vos pages avec l'outil d'inspection d'URL de Google Search Console

- Vérifier que le contenu principal est accessible sans accepter les cookies

- Configurer votre CMP en mode non-bloquant ou avec détection des robots

- Distinguer clairement les cookies essentiels (exemptés) des cookies non essentiels

- Auditer régulièrement les pages stratégiques pour détecter tout problème d'indexation

- Documenter la configuration de votre solution de gestion du consentement

- Former les équipes techniques aux enjeux SEO liés au RGPD

- Mettre en place un monitoring automatique des erreurs de crawl liées aux cookies

La gestion du consentement aux cookies représente un enjeu technique complexe qui nécessite une expertise croisée en développement web, conformité RGPD et référencement naturel. Une mauvaise configuration peut avoir des conséquences désastreuses sur votre visibilité organique.

L'équilibre entre conformité légale et performance SEO requiert une approche méthodique et des tests rigoureux. Face à la complexité de ces optimisations et aux risques associés, l'accompagnement par une agence SEO spécialisée peut s'avérer judicieux pour sécuriser votre démarche et garantir une implémentation optimale qui préserve à la fois votre conformité et votre référencement.

💬 Commentaires (0)

Soyez le premier à commenter.