Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Google suit-il vraiment tous les codes HTTP ou s'arrête-t-il au premier rencontré ?

- □ Un CDN améliore-t-il vraiment votre classement Google ?

- □ Faut-il bloquer le crawl des endpoints API pour optimiser son budget de crawl ?

- □ Faut-il vraiment bannir le nofollow des liens internes ?

- □ Pourquoi Google préfère-t-il les redirections serveur aux redirections JavaScript ?

- □ Faut-il vraiment différencier les redirections 301 et 302 pour le SEO ?

- □ Faut-il vraiment isoler vos contenus archivés pour améliorer votre SEO ?

- □ Peut-on vraiment forcer l'affichage des sitelinks dans Google ?

- □ Faut-il vraiment abandonner les iframes et les PDF pour indexer du contenu textuel ?

- □ Faut-il vraiment bloquer ou masquer les liens externes pour protéger son PageRank ?

- □ Google favorise-t-il vraiment certaines plateformes CMS pour le référencement ?

- □ Les URLs dans les données structurées sont-elles crawlées par Google ?

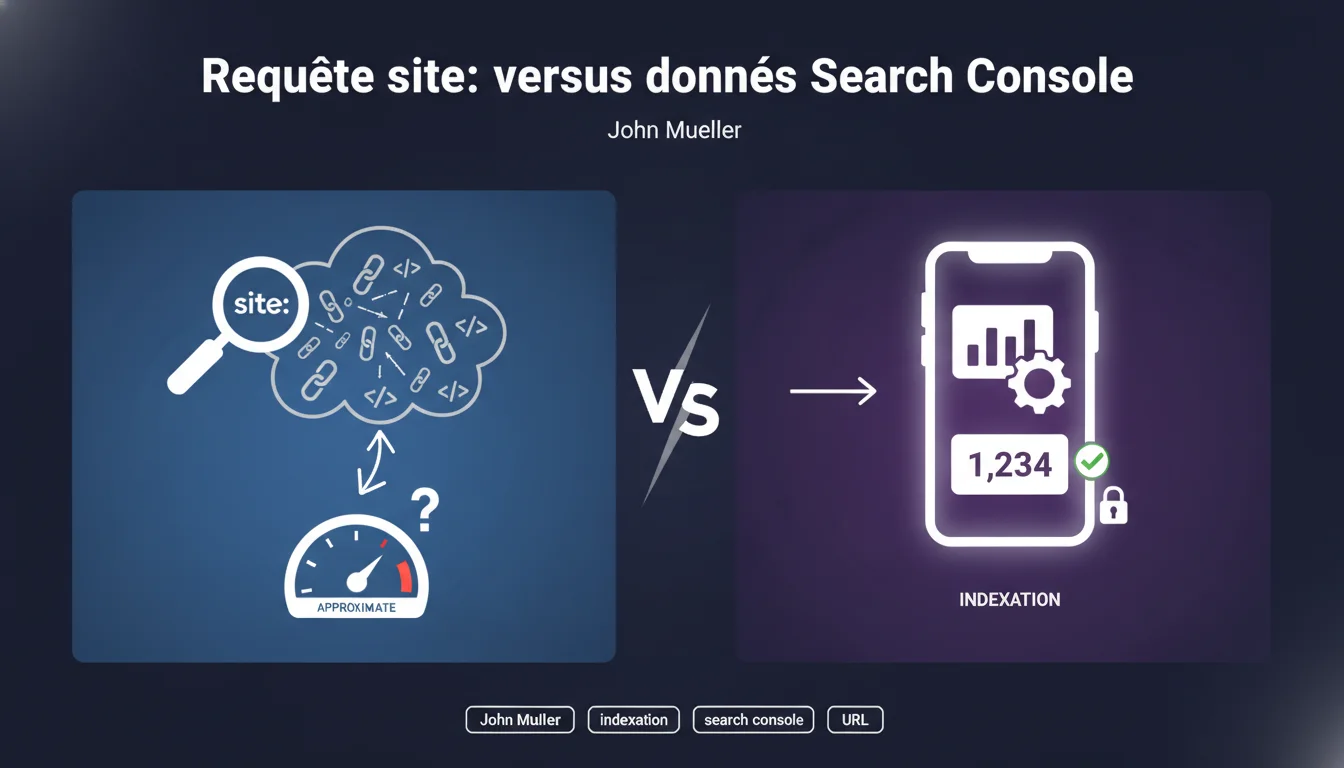

Google confirme que la requête site: affiche un nombre approximatif de pages indexées, inutilisable pour un diagnostic fiable. Le seul outil crédible pour connaître le volume exact d'URLs indexées est le rapport d'indexation de Search Console. Les praticiens SEO doivent abandonner cette commande pour tout audit sérieux.

Ce qu'il faut comprendre

Pourquoi la commande site: est-elle si imprécise ?

La requête site:example.com renvoie une estimation basée sur un échantillonnage rapide des serveurs de Google, pas un décompte exhaustif. Ce chiffre varie selon le datacenter interrogé, le moment de la requête, et les optimisations internes du moteur pour afficher rapidement un résultat.

Google n'a jamais conçu cette commande comme un outil de mesure — c'est un raccourci utilisateur pour explorer grossièrement les pages d'un domaine. L'algorithme privilégie la vitesse au détriment de la précision, d'où les écarts parfois massifs entre deux requêtes identiques à quelques minutes d'intervalle.

Quelle différence avec les données Search Console ?

Le rapport d'indexation de Search Console compile les données directement depuis les systèmes d'indexation de Google. Il reflète l'état réel du cache, avec un historique fiable et des catégories de pages exclues détaillées (erreurs 4xx, bloquées par robots.txt, canonicalisées, etc.).

Là où site: affiche un chiffre rond et fluctuant, Search Console détaille précisément combien de pages sont indexées, combien sont découvertes mais non indexées, et pourquoi. C'est la différence entre une boussole cassée et un GPS.

Quelles sont les implications pour un audit SEO ?

Un audit basé sur site: peut conduire à des diagnostics erronés — panique injustifiée face à une chute apparente d'indexation, ou fausse sécurité quand le chiffre semble stable alors que des milliers de pages sont en réalité exclues.

Les professionnels doivent systématiquement croiser les volumes Search Console avec les sitemaps XML, les logs serveur et les crawls internes. C'est le seul moyen de détecter des anomalies réelles (pagination bloquée, facettes indexées à tort, cannibalisation massive).

- La commande site: est une approximation grossière, jamais un outil de diagnostic

- Search Console fournit le seul décompte fiable et granulaire des URLs indexées

- Les écarts entre site: et GSC peuvent atteindre +/- 30% ou plus sans que cela traduise un problème réel

- Un audit sérieux repose sur GSC, sitemaps, logs et crawls — jamais sur une commande de recherche

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Tous les praticiens expérimentés savent que site: donne des résultats erratiques — un site peut afficher 12 000 pages un jour, 8 500 le lendemain, sans changement structurel. Les clients paniquent, les juniors s'affolent, mais c'est juste du bruit statistique.

Pourtant, cette commande reste omniprésente dans les audits low-cost et les rapports automatisés. Beaucoup de SEO la citent encore comme métrique, faute de mieux ou par habitude. Google met enfin les points sur les i : arrêtez de l'utiliser pour compter.

Quelles limites cette déclaration ne couvre-t-elle pas ?

Mueller ne précise pas pourquoi Google maintient une commande aussi peu fiable en production. Si elle est inutilisable pour le diagnostic, pourquoi ne pas afficher directement un message d'avertissement ou rediriger vers Search Console ? [A vérifier]

Autre zone grise : la commande site: peut révéler des pages indexées absentes de Search Console (cas rares mais documentés, notamment après migration ou refonte). Dans ces situations, quel outil est « exact » ? Google ne répond pas.

Doit-on totalement abandonner la commande site: ?

Non. Elle reste utile pour vérifier rapidement la présence d'une URL spécifique dans l'index (site:example.com/page-test), explorer des facettes de contenu (site:example.com inurl:category), ou détecter du contenu parasite indexé à l'insu du propriétaire.

Mais pour toute analyse quantitative — volume indexé, évolution temporelle, écarts sitemap vs index — Search Console est l'unique source crédible. Point final.

Impact pratique et recommandations

Que faut-il faire concrètement pour auditer l'indexation ?

Bannissez définitivement la commande site: de vos rapports clients et métriques KPI. Remplacez-la par le rapport d'indexation Search Console, qui segmente les pages indexées, exclues, et les raisons d'exclusion (noindex, soft 404, redirection, etc.).

Croisez systématiquement ce rapport avec vos sitemaps XML pour identifier les URLs soumises mais non indexées. Un écart massif (>20%) signale souvent du contenu dupliqué, une pagination mal gérée, ou des balises canoniques conflictuelles.

Comment surveiller l'évolution de l'indexation dans le temps ?

Exportez chaque semaine les données du rapport d'indexation GSC et suivez les tendances dans un tableau de bord (Google Sheets, Data Studio, Looker). Configurez des alertes automatiques si le volume de pages exclues augmente brutalement (+15% en 7 jours).

Complétez avec l'analyse des logs serveur : un décalage entre les pages crawlées par Googlebot et celles indexées révèle des problèmes de qualité (thin content), de structure (profondeur excessive), ou de budget crawl (facettes infinies).

Quelles erreurs éviter dans l'interprétation des données Search Console ?

Ne confondez pas « découvert mais non indexé » avec un problème technique. Google peut légitimement choisir de ne pas indexer des pages de faible valeur ajoutée (pagination redondante, filtres à facettes, archives anciennes).

Méfiez-vous aussi des pics d'indexation artificiels après soumission massive de sitemaps — Google indexe rapidement puis désindexe si le contenu ne tient pas la route. L'indexation durable compte plus que le pic initial.

- Migrez tous vos audits d'indexation vers Search Console, abandonnez site:

- Exportez et archivez les données GSC chaque semaine pour suivre les tendances

- Croisez indexation GSC avec sitemaps XML et logs serveur

- Configurez des alertes automatiques sur les variations brutales (>15% en 7 jours)

- Documentez les écarts sitemap vs index et investiguer les exclusions massives

- Ne paniquez pas face aux fluctuations site: — elles n'ont aucune valeur diagnostique

❓ Questions frequentes

La commande site: peut-elle encore servir à quelque chose en SEO ?

Pourquoi les chiffres site: et Search Console sont-ils parfois très différents ?

Que faire si Search Console affiche moins de pages indexées que mon sitemap ?

Les outils SEO tiers qui utilisent site: sont-ils obsolètes ?

Comment détecter une désindexation massive rapidement ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/06/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.