Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le JavaScript est-il vraiment un frein aux performances SEO de votre site ?

- □ Pourquoi trop de fichiers JavaScript nuisent-ils à vos performances SEO ?

- □ PageSpeed Insights révèle-t-il vraiment les problèmes JavaScript critiques pour votre SEO ?

- □ HTTP/2 rend-il obsolète la concaténation de fichiers JavaScript pour le SEO ?

- □ Faut-il vraiment limiter le nombre de domaines pour charger vos fichiers JavaScript ?

- □ Comment éliminer le JavaScript inefficace qui plombe vos Core Web Vitals ?

- □ Les passive listeners peuvent-ils vraiment booster vos Core Web Vitals ?

- □ Pourquoi le JavaScript non utilisé plombe-t-il vos Core Web Vitals même s'il n'est jamais exécuté ?

- □ Le tree shaking JavaScript est-il vraiment efficace pour améliorer les performances SEO ?

- □ Faut-il vraiment compresser tous vos fichiers JavaScript pour améliorer votre SEO ?

- □ Pourquoi Google insiste-t-il sur les en-têtes de cache pour JavaScript ?

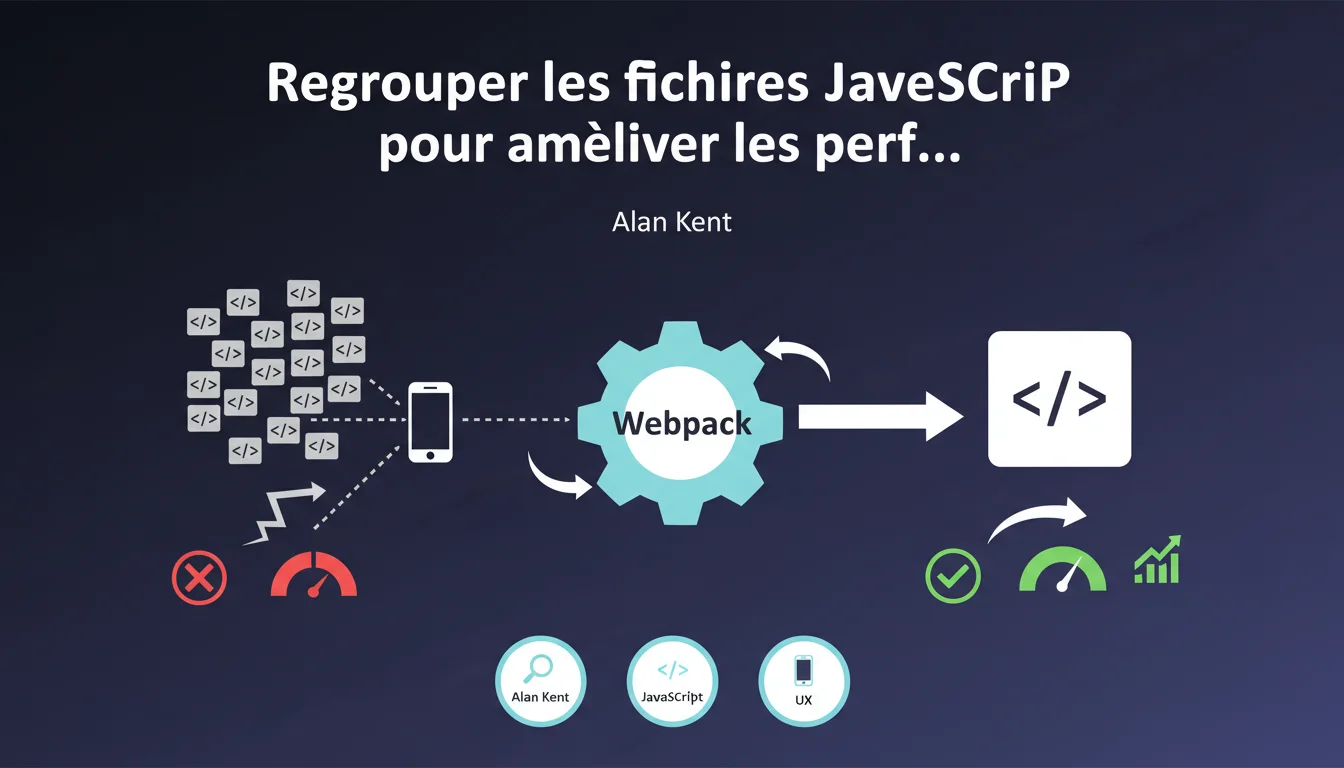

Google recommande de regrouper les petits fichiers JavaScript en un seul fichier plus volumineux ou en quelques fichiers parallélisables. Cette pratique, facilitable via des outils comme Webpack, réduit le nombre de requêtes HTTP et améliore les performances de chargement — un signal pris en compte par les algorithmes de ranking.

Ce qu'il faut comprendre

Pourquoi Google pousse-t-il au regroupement des fichiers JavaScript ?

La déclaration d'Alan Kent s'inscrit dans la logique de réduction des requêtes HTTP. Chaque fichier JavaScript nécessite une connexion réseau distincte : handshake TCP, négociation TLS, latence de round-trip. Multiplier les petits fichiers génère donc un overhead considérable.

En regroupant ces fichiers, on limite ces allers-retours. Un seul fichier de 100 Ko téléchargé d'un bloc sera quasi systématiquement plus rapide que dix fichiers de 10 Ko chacun, surtout sur des connexions mobiles à latence élevée.

Qu'est-ce que le bundling et comment ça fonctionne concrètement ?

Le bundling consiste à concaténer plusieurs fichiers JavaScript en un seul bundle. Des outils comme Webpack, Rollup ou Parcel automatisent ce processus. Ils analysent les dépendances, éliminent le code mort (tree-shaking), et produisent un ou plusieurs fichiers optimisés.

Google mentionne « quelques fichiers téléchargeables en parallèle » : cela fait référence au code-splitting. Plutôt qu'un monolithe unique, on peut générer un bundle principal et des chunks secondaires chargés à la demande (lazy loading). HTTP/2 et HTTP/3 permettent de multiplexer ces requêtes sans overhead majeur.

En quoi cela impacte-t-il le SEO ?

Les Core Web Vitals — notamment le LCP (Largest Contentful Paint) et le FID (First Input Delay) — sont directement influencés par la vitesse de chargement du JavaScript. Un JS fragmenté en 50 fichiers retarde le parsing, l'exécution, et donc l'interactivité de la page.

- Moins de requêtes HTTP = réduction de la latence globale

- Parsing plus rapide si le code est optimisé et dédupliqué

- Amélioration du Time to Interactive (TTI), critère de performance suivi par Google

- Impact indirect sur le taux de rebond et les signaux utilisateurs

- Crawl budget mieux utilisé : moins de ressources bloquantes = crawl plus efficace

Avis d'un expert SEO

Cette recommandation est-elle encore valable avec HTTP/2 et HTTP/3 ?

La question est légitime. HTTP/2 a introduit le multiplexage, permettant de charger plusieurs fichiers en parallèle sur une seule connexion TCP. En théorie, fragmenter le JavaScript ne devrait plus être pénalisant.

Sauf que — et c'est là que ça coince. Le multiplexage ne supprime pas la latence initiale de chaque requête. Sur des connexions mobiles instables ou à forte latence, la différence reste mesurable. Les tests terrain montrent qu'un bundle unique reste souvent plus performant qu'une dizaine de petits fichiers, même en HTTP/2. [A vérifier] : Google ne précise pas à partir de quel seuil de fichiers le regroupement devient critiquement nécessaire.

Quelles sont les limites pratiques de cette approche ?

Regrouper tout le JavaScript en un seul fichier peut devenir contre-productif. Un bundle de 2 Mo force le navigateur à télécharger du code inutile pour la page courante — et pénalise le cache navigateur. Si tu modifies une seule ligne, tout le bundle est invalidé.

Le code-splitting est donc la vraie bonne pratique : un bundle principal minimal, et des chunks chargés à la demande (routes, composants différés). Google le mentionne d'ailleurs : « quelques fichiers téléchargeables en parallèle ». Concrètement ? Trois à cinq bundles stratégiques valent mieux qu'un monolithe ou qu'une fragmentation excessive.

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, largement. Les audits PageSpeed Insights signalent systématiquement les sites avec trop de requêtes JS fragmentées. Les gains mesurables en LCP et TTI sont réels — à condition de ne pas tomber dans l'excès inverse.

Attention toutefois : bundler sans minifier, sans tree-shaking, sans différer le JS non critique… ça ne sert à rien. Le bundling n'est qu'une pièce du puzzle. Et Google reste volontairement flou sur les seuils précis — combien de fichiers ? Quelle taille optimale par bundle ? Aucune donnée chiffrée.

Impact pratique et recommandations

Que faut-il faire concrètement pour regrouper efficacement son JavaScript ?

Première étape : auditer l'existant. Ouvre les DevTools Chrome, onglet Network, filtre sur JS, et recharge la page. Combien de requêtes ? Quelle taille par fichier ? Si tu vois 30+ fichiers de quelques Ko chacun, c'est un signal rouge.

Ensuite, choisis un bundler adapté à ton stack. Webpack reste l'outil le plus complet, mais Vite ou Rollup sont plus rapides pour des projets modernes. Configure le code-splitting : sépare le code vendor (librairies tierces) du code applicatif, génère des chunks par route si ton site est une SPA.

- Auditer le nombre et la taille des fichiers JS actuels

- Installer un bundler (Webpack, Rollup, Vite) et configurer le build

- Activer le tree-shaking pour éliminer le code mort

- Mettre en place le code-splitting stratégique (vendor, routes, lazy)

- Minifier et compresser (gzip/brotli) les bundles générés

- Tester l'impact réel sur les Core Web Vitals via PageSpeed Insights

- Monitorer le cache navigateur : les bundles doivent avoir des hashes de version

Quelles erreurs éviter absolument ?

Erreur classique : tout regrouper en un seul fichier monolithique. Résultat : un bundle de 1,5 Mo qui plombe le FCP et force le téléchargement de code inutilisé. Le cache devient également inefficace : chaque modification invalide tout.

Autre piège : ne pas différer le JS non critique. Même bundlé, un script synchrone bloque le rendering. Utilise defer ou async, et charge les fonctionnalités secondaires (analytics, chat, etc.) en lazy loading.

Comment vérifier que l'optimisation fonctionne ?

Lance un audit Lighthouse (intégré dans Chrome DevTools) avant et après le bundling. Compare les métriques : LCP, TTI, Total Blocking Time. L'amélioration doit être mesurable — si elle ne l'est pas, quelque chose cloche dans ta config.

Vérifie également le waterfall dans l'onglet Network : les fichiers JS doivent se charger rapidement, sans cascade de dépendances bloquantes. Si tu vois toujours des dizaines de requêtes séquentielles, le bundling n'est pas correctement appliqué.

❓ Questions frequentes

Combien de fichiers JavaScript est considéré comme « trop » par Google ?

Le bundling améliore-t-il directement le ranking Google ?

Faut-il privilégier un seul bundle ou plusieurs fichiers parallèles ?

Webpack est-il obligatoire ou existe-t-il des alternatives plus simples ?

Le bundling impacte-t-il le crawl budget de Googlebot ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.