Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le JavaScript est-il vraiment un frein aux performances SEO de votre site ?

- □ PageSpeed Insights révèle-t-il vraiment les problèmes JavaScript critiques pour votre SEO ?

- □ Faut-il vraiment regrouper ses fichiers JavaScript pour améliorer son SEO ?

- □ HTTP/2 rend-il obsolète la concaténation de fichiers JavaScript pour le SEO ?

- □ Faut-il vraiment limiter le nombre de domaines pour charger vos fichiers JavaScript ?

- □ Comment éliminer le JavaScript inefficace qui plombe vos Core Web Vitals ?

- □ Les passive listeners peuvent-ils vraiment booster vos Core Web Vitals ?

- □ Pourquoi le JavaScript non utilisé plombe-t-il vos Core Web Vitals même s'il n'est jamais exécuté ?

- □ Le tree shaking JavaScript est-il vraiment efficace pour améliorer les performances SEO ?

- □ Faut-il vraiment compresser tous vos fichiers JavaScript pour améliorer votre SEO ?

- □ Pourquoi Google insiste-t-il sur les en-têtes de cache pour JavaScript ?

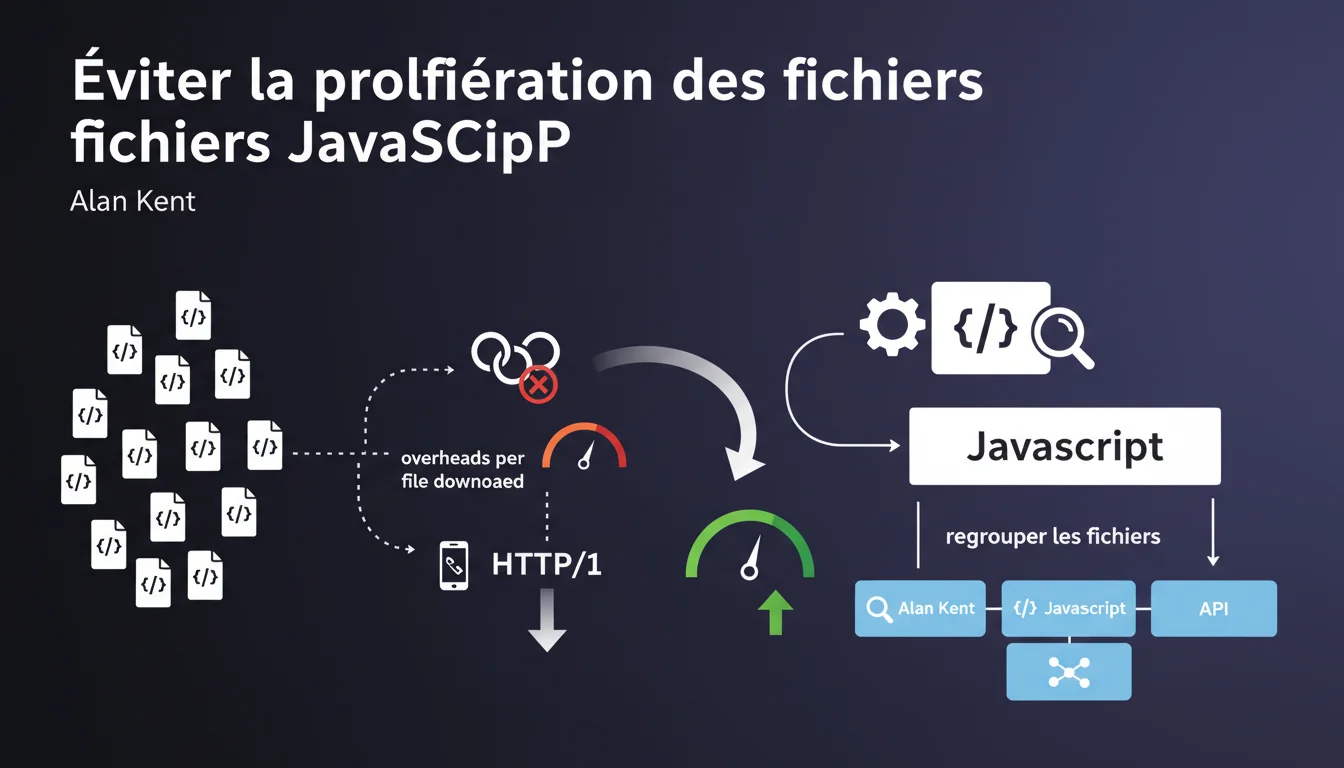

Google recommande de regrouper les fichiers JavaScript plutôt que de les multiplier. Chaque fichier téléchargé génère une surcharge technique, particulièrement sur HTTP/1. Pour un site rapide, moins de fichiers = meilleur crawl et meilleure expérience utilisateur.

Ce qu'il faut comprendre

Pourquoi Google s'inquiète-t-il du nombre de fichiers JavaScript ?

Chaque fichier JavaScript téléchargé implique une requête HTTP distincte. Sur HTTP/1, ces requêtes s'enchaînent avec des limites de connexions parallèles — généralement 6 par domaine. Résultat : un site avec 50 fichiers JS distincts se charge en cascade, chaque fichier attendant son tour.

Les navigateurs doivent aussi parser et exécuter chaque fichier individuellement. Plus il y a de fichiers, plus les temps de traitement s'allongent, même si le code total reste identique. Google le sait, et ses robots de crawl subissent les mêmes ralentissements que vos visiteurs.

Qu'est-ce que cette prolifération change pour le SEO ?

Un site qui met 8 secondes à charger son JavaScript consomme du crawl budget inutilement. Googlebot préfère crawler des pages rapides — il peut en indexer plus dans le même temps. Si votre JS bloque le rendu, Google voit une page vide plus longtemps, ce qui dégrade aussi les Core Web Vitals.

L'impact touche également le Largest Contentful Paint (LCP) et le First Input Delay (FID). Des dizaines de fichiers JS retardent le moment où la page devient interactive. Et ça, Google le mesure directement via les données Chrome.

HTTP/2 règle-t-il vraiment le problème ?

HTTP/2 permet le multiplexage : plusieurs fichiers peuvent transiter simultanément sur une seule connexion. En théorie, la surcharge par fichier diminue. Mais en pratique, regrouper reste recommandé — les overheads de parsing et d'exécution subsistent côté navigateur.

Google mentionne explicitement HTTP/1 parce que beaucoup de sites ne sont pas encore passés à HTTP/2 ou HTTP/3. Mais même sur protocoles modernes, limiter le nombre de fichiers améliore les performances réelles.

- Chaque fichier JS = une requête HTTP supplémentaire, avec latence et surcharge réseau

- Sur HTTP/1, les connexions parallèles sont limitées (environ 6 par domaine)

- Le parsing et l'exécution du code se font fichier par fichier, ralentissant le rendu

- Même sur HTTP/2, regrouper les fichiers réduit les overheads de traitement navigateur

- Google favorise les sites rapides pour le crawl et le classement

Avis d'un expert SEO

Cette recommandation s'applique-t-elle toujours en 2024 ?

Oui, mais avec des nuances. Le code splitting moderne permet de charger uniquement le JS nécessaire à chaque page. Webpack, Rollup ou Vite regroupent intelligemment les modules — tu ne te retrouves pas avec 200 fichiers éparpillés. Mais si ton build génère 50 chunks pour une page d'accueil, tu as un problème.

Les frameworks comme Next.js ou Nuxt gèrent ça nativement avec des stratégies de chunking optimisées. Le risque, c'est quand les devs configurent mal le bundler ou ajoutent des libs externes sans concaténation. Résultat : explosion du nombre de requêtes.

Google donne-t-il assez de détails pour agir ?

Franchement ? Non. [A vérifier] Aucun chiffre précis sur le seuil acceptable de fichiers JS. Aucun benchmark sur l'impact réel par type de site. Alan Kent reste dans le vague — probablement volontaire pour éviter qu'on game le système avec un chiffre magique.

Ce qu'on sait du terrain : au-delà de 10-15 fichiers JS critiques (bloquant le rendu), les Core Web Vitals souffrent visiblement. Mais entre 5 et 50 fichiers non-bloquants en lazy load ? L'impact varie selon la taille des fichiers, la qualité du serveur, le CDN...

Dans quels cas peut-on ignorer cette règle ?

Si ton site tourne déjà sur HTTP/3 avec un CDN performant, que tes fichiers sont < 10 Ko chacun et que tes Core Web Vitals sont au vert, tu n'as pas besoin de tout refondre. La règle vise surtout les architectures legacy avec des dizaines de scripts mal optimisés.

Les SPA (Single Page Applications) bien conçues chargent un bundle initial regroupé, puis du lazy loading par route. Là, pas de prolifération. Le problème surgit avec des CMS mal configurés qui injectent 30 scripts tiers non regroupés.

Impact pratique et recommandations

Que faut-il auditer en priorité sur son site ?

Commence par mesurer le nombre de requêtes JavaScript avec les DevTools (Network > JS). Filtre sur les fichiers bloquant le rendu initial. Si tu vois plus de 15-20 requêtes JS avant le premier paint, c'est un signal rouge.

Utilise aussi Google PageSpeed Insights ou WebPageTest. Cherche les warnings "Reduce unused JavaScript" ou "Minimize main-thread work". Ces outils pointent directement les fichiers inutilement fragmentés.

Comment regrouper efficacement ses fichiers JavaScript ?

Si tu utilises un bundler moderne (Webpack, Rollup, Vite), configure les points d'entrée pour limiter les chunks. Par exemple, un bundle commun pour les libs partagées (React, jQuery), un bundle par page critique, et du lazy loading pour le reste.

Pour les sites sous WordPress ou autre CMS, active les plugins de minification et concaténation (WP Rocket, Autoptimize). Teste ensuite — certains scripts ne supportent pas la concaténation et cassent les fonctionnalités.

Quelles erreurs éviter absolument ?

Ne regroupe pas tous les scripts tiers (analytics, CRM, chat) dans un seul bundle avec ton code métier. Les scripts externes évoluent indépendamment — tu risques des cache busts permanents. Garde-les séparés mais charge-les en async/defer.

Évite aussi de créer un méga-bundle monolithique si ton site a 50 pages différentes. Le code splitting par route reste pertinent — mais limite le nombre de chunks critiques sur chaque page.

- Audite le nombre de fichiers JS avec Chrome DevTools (onglet Network)

- Identifie les fichiers bloquant le rendu avec PageSpeed Insights

- Configure ton bundler pour limiter les chunks à 5-10 fichiers critiques maximum

- Regroupe les librairies communes (frameworks, utilitaires) dans un bundle partagé

- Utilise le lazy loading pour les composants non-critiques

- Teste systématiquement après modification — certains scripts cassent en concaténation

- Surveille l'évolution des Core Web Vitals après chaque changement de build

- Priorise HTTP/2 ou HTTP/3 pour réduire la latence réseau par fichier

❓ Questions frequentes

Combien de fichiers JavaScript est-ce trop pour Google ?

HTTP/2 rend-il le regroupement de fichiers JS inutile ?

Faut-il tout regrouper dans un seul fichier JavaScript ?

Comment savoir si mon site souffre de cette prolifération ?

Les scripts tiers (analytics, ads) doivent-ils être regroupés aussi ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.