Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il supprimer les données structurées HowTo de vos pages après l'arrêt des résultats enrichis ?

- □ Faut-il abandonner le balisage FAQ sur votre site après la restriction de Google ?

- □ Faut-il vraiment laisser votre CMS gérer vos données structurées ?

- □ Combien de fois Google déploie-t-il vraiment ses core updates ?

- □ Le système de contenu utile mesure-t-il vraiment la qualité à l'échelle du site ?

- □ Pourquoi Google vous renvoie-t-il vers sa documentation après une chute de classement ?

- □ Faut-il s'abonner au Search Status Dashboard de Google pour anticiper les mises à jour ?

- □ Les noms de sites multilingues s'affichent-ils automatiquement dans Google ?

- □ Google filtre-t-il vraiment vos pages par langue pour chaque requête ?

- □ Google indexe-t-il vraiment vos fichiers CSV et faut-il s'en préoccuper ?

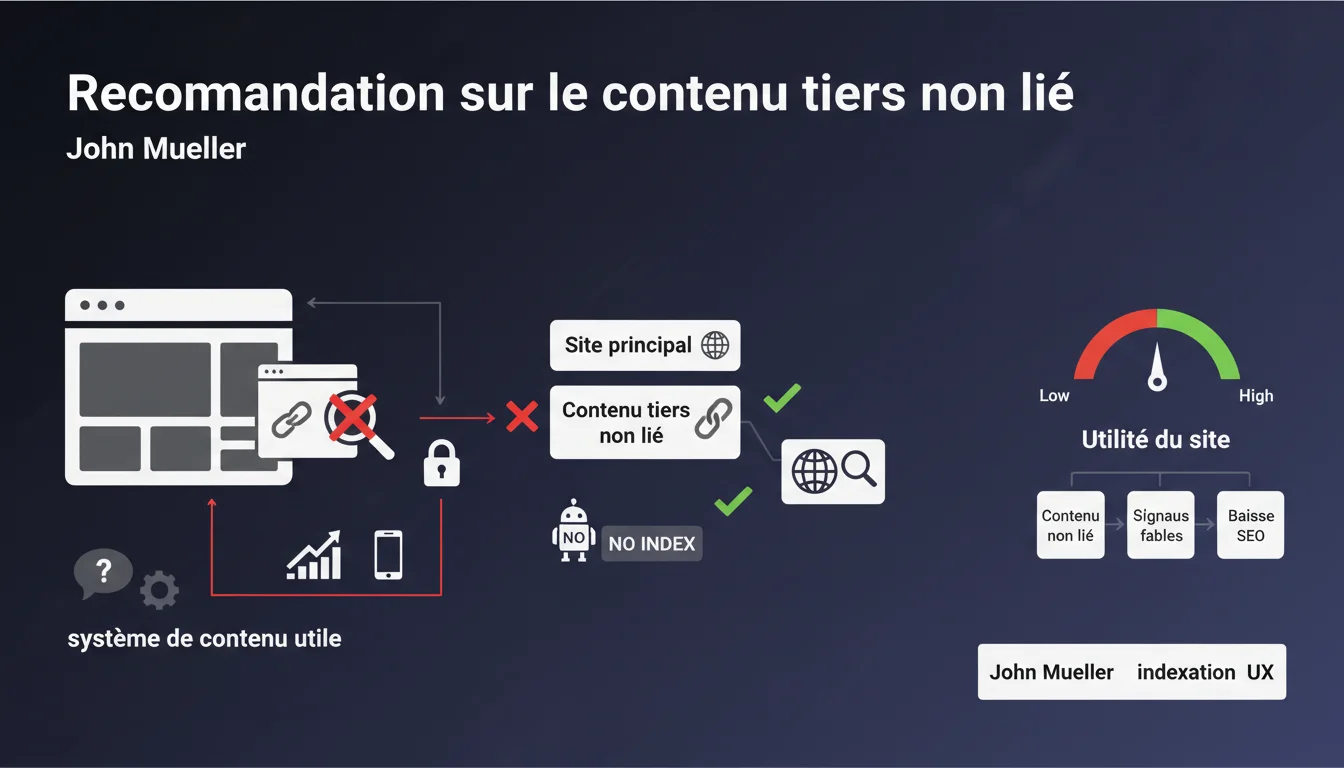

Google recommande de bloquer l'indexation des contenus tiers non liés à l'objectif principal d'un site, car le système Helpful Content analyse des signaux à l'échelle du domaine entier. Un contenu tiers mal supervisé peut contaminer la réputation globale du site et déclencher un déclassement. Cette déclaration confirme que Google ne segmente pas son évaluation par section, mais juge le site dans sa globalité.

Ce qu'il faut comprendre

Mueller délivre ici une consigne technique qui confirme une hypothèse débattue depuis le lancement du Helpful Content Update. Le système ne discrimine pas entre différentes sections d'un site — il agrège des signaux pour produire un score global.

Qu'est-ce qu'un contenu tiers non lié concrètement ?

On parle de contenus hébergés sur votre domaine mais sans rapport direct avec votre thématique principale : forums généralistes sur un site e-commerce spécialisé, blogs invités hors-sujet, sections de petites annonces non supervisées, plateformes UGC (User Generated Content) ouvertes à tous les sujets.

Le problème ? Ces zones génèrent souvent du contenu de qualité médiocre, du spam ou des pages indexées sans valeur ajoutée. Google voit cela comme un signal de dilution thématique.

Pourquoi le système Helpful Content évalue-t-il le site entier ?

Contrairement à Panda qui pouvait cibler des sections spécifiques, le Helpful Content fonctionne sur des signaux comportementaux et qualitatifs globaux. Si 30% de vos pages indexées sont du bruit, cela impacte la confiance accordée aux 70% restants.

Google utilise des métriques d'engagement agrégées : taux de rebond moyen, temps de session, navigation récurrente. Un bloc de pages faibles tire l'ensemble vers le bas.

- Le Helpful Content ne segmente pas : il juge le domaine comme une entité unique

- Contenu tiers = risque de contamination : une zone non supervisée peut polluer la réputation globale

- Bloquer l'indexation via robots.txt ou noindex protège le reste du site

- Implication étroite exigée : si vous hébergez du contenu tiers, il doit être modéré et aligné thématiquement

Que signifie « implication étroite » dans cette directive ?

Google oppose deux modèles : le site qui héberge passivement du contenu externe versus celui qui modère, édite et sélectionne activement. L'implication étroite implique un contrôle éditorial réel.

Si vous ne pouvez pas garantir la qualité et la pertinence thématique, le blocage devient la seule option sûre. C'est un choix binaire : supervision rigoureuse ou désindexation complète.

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les observations terrain ?

Absolument. Depuis le Helpful Content Update de septembre 2022, on observe des déclassements massifs sur des domaines qui hébergent des forums mal modérés ou des sections UGC sans rapport avec le cœur de métier.

Des sites d'autorité ont perdu 40-60% de trafic organique parce qu'une portion minoritaire du site (blogs invités, forums) générait du contenu faible massivement indexé. Le signal : Google ne fait pas de distinction entre votre contenu premium et le bruit hébergé sur le même domaine.

Quelles zones grises subsistent dans cette directive ?

Mueller reste délibérément flou sur le seuil de tolérance. À partir de quel pourcentage de pages faibles le système déclenche-t-il une pénalité globale ? [À vérifier] — aucune donnée officielle.

Autre problème : la notion d'« implication étroite » n'a pas de définition technique. Faut-il modérer chaque publication ? Suffit-il d'approuver les contributeurs ? Google ne donne aucun critère mesurable.

Dans quels cas peut-on ignorer cette recommandation ?

Si votre contenu tiers est thématiquement aligné et activement supervisé, il n'est pas nécessaire de bloquer. Exemple : un site de recettes qui héberge des recettes d'utilisateurs modérées et vérifiées.

Le risque est nul si le volume reste marginal (moins de 10% des pages indexées) et que la qualité est contrôlée. Mais dès que le ratio s'inverse ou que la modération devient impossible, le blocage devient impératif.

Impact pratique et recommandations

Comment identifier le contenu tiers à risque sur mon site ?

Commencez par un audit d'indexation segmenté. Utilisez Google Search Console pour isoler les sections du site : forums, blogs contributeurs, UGC, petites annonces. Analysez le taux d'impression et de clics par segment.

Si une section représente 20% des pages indexées mais génère moins de 2% du trafic organique, c'est un signal de faible pertinence. Croisez avec les données Analytics : temps de session, taux de rebond, pages par session.

- Listez toutes les sections hébergeant du contenu externe ou utilisateur

- Calculez le ratio pages indexées / trafic généré pour chaque section

- Identifiez les zones avec fort volume d'indexation et faible engagement

- Vérifiez la cohérence thématique : le sujet est-il lié au cœur de métier ?

- Auditez la qualité éditoriale : y a-t-il modération, relecture, validation ?

Quelle méthode de blocage privilégier : robots.txt ou noindex ?

Cela dépend de l'objectif. robots.txt bloque le crawl mais ne garantit pas la désindexation des URLs déjà connues. Si les pages sont déjà indexées, utilisez la balise noindex en priorité.

Pour une section entière, combinez les deux : noindex pour désindexer progressivement, puis robots.txt pour économiser le crawl budget une fois la désindexation confirmée. Surveillez la baisse d'indexation via Search Console.

Quelles erreurs éviter lors de la mise en œuvre ?

Ne bloquez pas une section sans analyser les backlinks entrants. Si du contenu tiers capte des liens de qualité, sa suppression de l'index peut impacter le PageRank interne. Évaluez d'abord le profil de liens via Ahrefs ou Majestic.

Autre erreur : bloquer du contenu utilisateur qui génère de la longue traîne qualifiée. Certains forums de niche ou Q&A bien modérés apportent un trafic précieux. Le critère de Mueller n'est pas binaire — c'est le rapport qualité/volume qui compte.

- Ne bloquez pas sans auditer le profil de backlinks de la section concernée

- Vérifiez que le contenu tiers ne génère pas de conversions indirectes

- Testez d'abord sur une sous-section limitée avant un blocage massif

- Surveillez l'évolution du trafic global pendant 30 jours post-blocage

- Conservez une trace des URLs bloquées pour réindexer si nécessaire

Cette directive de Mueller impose un arbitrage stratégique : soit vous assumez une supervision éditoriale stricte du contenu tiers, soit vous le désindexez pour protéger le reste du domaine. Il n'y a pas de demi-mesure acceptable aux yeux du Helpful Content.

La mise en œuvre demande une analyse technique fine — segmentation d'indexation, audit de backlinks, tests progressifs — et une surveillance continue des impacts. Si cette complexité dépasse vos ressources internes ou si vous gérez un site de grande envergure avec plusieurs zones à risque, l'accompagnement d'une agence SEO spécialisée peut vous éviter des erreurs coûteuses et accélérer le retour à une situation saine.

❓ Questions frequentes

Le blocage d'une section entière via noindex impacte-t-il le crawl budget ?

Un blog de contributeurs externes est-il considéré comme du contenu tiers à risque ?

Combien de temps faut-il pour observer un impact positif après blocage ?

Peut-on héberger du contenu tiers sur un sous-domaine pour isoler le risque ?

Le Helpful Content pénalise-t-il uniquement le contenu faible ou aussi le hors-sujet de qualité ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/10/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.