Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il supprimer les données structurées HowTo de vos pages après l'arrêt des résultats enrichis ?

- □ Faut-il abandonner le balisage FAQ sur votre site après la restriction de Google ?

- □ Faut-il vraiment laisser votre CMS gérer vos données structurées ?

- □ Combien de fois Google déploie-t-il vraiment ses core updates ?

- □ Faut-il bloquer le contenu tiers de l'indexation pour éviter les pénalités du Helpful Content ?

- □ Pourquoi Google vous renvoie-t-il vers sa documentation après une chute de classement ?

- □ Faut-il s'abonner au Search Status Dashboard de Google pour anticiper les mises à jour ?

- □ Les noms de sites multilingues s'affichent-ils automatiquement dans Google ?

- □ Google filtre-t-il vraiment vos pages par langue pour chaque requête ?

- □ Google indexe-t-il vraiment vos fichiers CSV et faut-il s'en préoccuper ?

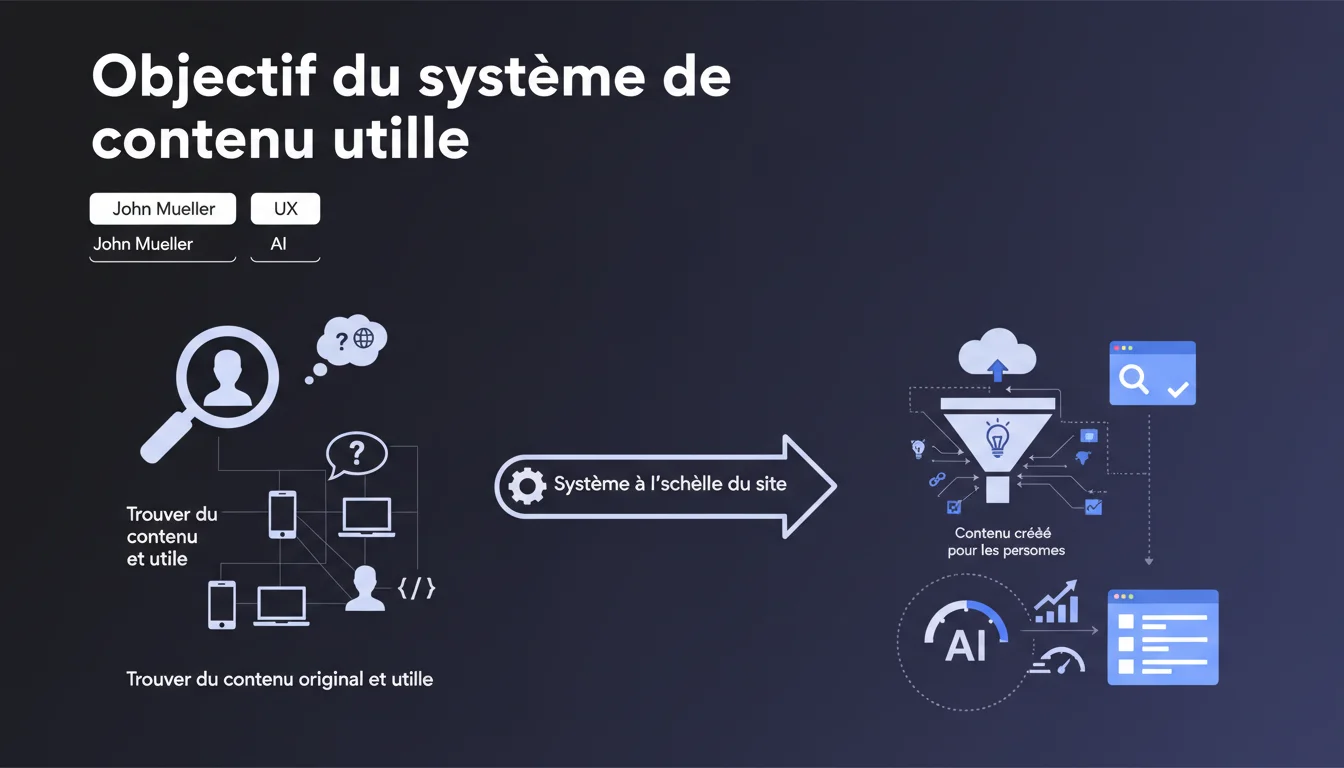

Google affirme que son système de contenu utile privilégie les contenus originaux créés pour les utilisateurs plutôt que pour les moteurs. Le point crucial : ce système applique des signaux au niveau du site entier, pas page par page. Un site marqué négativement verra l'ensemble de ses pages pénalisées, même celles de qualité.

Ce qu'il faut comprendre

Que cible précisément ce système ?

Le système de contenu utile (Helpful Content System) cherche à identifier les sites qui produisent du contenu principalement pour ranker, plutôt que pour répondre à un besoin réel. Google veut détecter les fermes de contenu, les sites gonflés d'articles SEO creux, les pages générées en masse sans valeur ajoutée.

L'originalité et l'utilité sont les deux critères mis en avant. Concrètement, Google mesure si votre contenu apporte quelque chose que l'utilisateur ne trouve pas ailleurs, et s'il répond vraiment à son intention de recherche.

Pourquoi parler de signaux « à l'échelle du site » ?

C'est là que ça change tout. Contrairement à Panda qui pouvait cibler des sections spécifiques, ce système évalue le site dans son ensemble. Si Google détecte un ratio important de contenu faible ou opportuniste, tout le domaine peut être déclassé.

Un site avec 80% de contenu solide mais 20% de pages spam générées pour capter du trafic long-tail risque d'être sanctionné globalement. La logique : un site fiable ne publierait pas massivement du contenu sans valeur.

Comment Google mesure-t-il « l'utilité » d'un contenu ?

Google reste volontairement flou sur les métriques exactes. On suppose un mix de signaux comportementaux (taux de rebond, temps passé, pogosticking), d'analyse sémantique, et de patterns détectés via machine learning.

Soyons honnêtes : personne ne sait exactement comment Google quantifie « l'originalité » ou « l'utilité » à grande échelle. Les recommandations officielles restent vagues — du type « écrivez pour les utilisateurs, pas pour les moteurs » — ce qui n'aide pas franchement les praticiens.

- Évaluation globale : le signal s'applique au site entier, pas page par page

- Critères doubles : originalité ET utilité, pas l'un sans l'autre

- Cible prioritaire : contenus créés principalement pour ranker, sans valeur réelle

- Impact cumulatif : un volume important de contenu faible peut contaminer tout le domaine

- Flou méthodologique : Google ne révèle pas les signaux techniques utilisés

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. On observe effectivement depuis l'arrivée de ce système des chutes brutales de visibilité sur des sites à contenu générique ou opportuniste. Les niches gonflées d'articles « Top 10 » ou de contenus reformulés ont pris cher.

Mais — et c'est là que ça coince — on voit aussi des sites de qualité touchés, simplement parce qu'ils publient beaucoup. Le volume devient suspect pour Google. [À vérifier] : la capacité réelle de l'algorithme à distinguer un média légitime qui publie 50 articles/mois d'un content farm qui fait la même chose.

Quelles nuances faut-il apporter à cette affirmation ?

L'idée de signaux « à l'échelle du site » pose un problème de granularité. Un e-commerce avec 10 000 fiches produits solides et 500 articles de blog moyens peut-il être pénalisé globalement ? Les retours terrain suggèrent que oui, dans certains cas.

Google parle « d'originalité », mais son système semble surtout détecter la duplication sémantique et les patterns de rédaction IA. Un contenu peut être utile sans être totalement original — pensez aux comparatifs produits, aux tutoriels techniques qui reprennent forcément les mêmes étapes.

Dans quels cas ce système peut-il dysfonctionner ?

Les faux positifs existent. J'ai vu des sites d'actualité légitimes perdre 40% de leur trafic après une mise à jour Helpful Content, simplement parce qu'ils couvraient massivement des sujets tendance. Google interprète parfois la réactivité éditoriale comme de l'opportunisme SEO.

Autre cas problématique : les sites multilingues ou multi-régionaux. Traduire du contenu est-il considéré comme « non original » ? Adapter un article pour différents marchés locaux déclenche-t-il des alertes ? [À vérifier] : le comportement exact de l'algorithme face aux contenus traduits ou localisés.

Impact pratique et recommandations

Que faut-il faire concrètement pour s'aligner avec ce système ?

Première étape : auditer votre contenu existant. Identifiez les pages qui génèrent peu d'engagement, ont un temps de visite faible, ou ne rankent sur aucune requête après plusieurs mois. Ces pages sont des boulets potentiels.

Ensuite, posez-vous LA question pour chaque contenu : « Est-ce qu'un utilisateur qui tombe sur cette page trouve une réponse qu'il ne trouverait pas mieux ailleurs ? » Si la réponse est non, vous avez trois options : améliorer radicalement, fusionner avec une page existante, ou supprimer.

Quelles erreurs éviter absolument ?

Ne tombez pas dans le piège du volume pour le volume. Publier 200 articles génériques vaut moins que 20 contenus vraiment différenciants. Google a clairement changé son fusil d'épaule : la quantité ne compense plus la médiocrité.

Évitez aussi les contenus purement SEO — ces pages qui n'existent que parce qu'un outil de keyword research vous a dit « 2900 recherches/mois ». Si personne ne lirait naturellement votre article hors contexte SEO, c'est un signal rouge.

Comment vérifier que mon site respecte ces critères ?

Utilisez les métriques d'engagement dans Google Analytics ou votre outil de mesure : temps moyen sur page, taux de rebond, scroll depth. Un contenu utile retient l'utilisateur. Croisez avec les données Search Console : un CTR élevé mais un temps de visite faible signale souvent un contenu décevant.

Testez aussi la méthode du lecteur naïf : faites lire vos contenus à quelqu'un hors SEO. Si cette personne trouve l'article utile et bien écrit sans contexte préalable, vous êtes probablement safe. Si elle décroche au bout de deux paragraphes, Google le détectera aussi.

- Auditer l'ensemble du contenu existant avec des métriques d'engagement

- Supprimer ou améliorer les pages à faible valeur ajoutée (no-index ne suffit pas)

- Arrêter la production de contenu opportuniste basé uniquement sur le volume de recherche

- Privilégier la profondeur et l'expertise sur des sujets choisis plutôt que la couverture large

- Mesurer systématiquement l'engagement réel des utilisateurs sur les nouveaux contenus

- Documenter l'expertise de vos rédacteurs (bio auteur, expérience terrain, credentials)

- Éviter les patterns IA détectables : structure trop uniforme, tournures génériques, absence de point de vue

❓ Questions frequentes

Le système de contenu utile est-il une pénalité manuelle ?

Combien de temps faut-il pour récupérer après avoir été impacté ?

Peut-on utiliser l'IA pour créer du contenu sans être pénalisé ?

Le no-index suffit-il pour isoler du contenu faible ?

Comment savoir si mon site est touché par ce système ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/10/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.