Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Google indexe-t-il vraiment tout le contenu de votre site ?

- □ Pourquoi Googlebot ignore-t-il vos liens JavaScript si vous n'utilisez pas de balises <a> ?

- □ Google a-t-il vraiment abandonné l'idée d'un score SEO global ?

- □ Peut-on créer des liens vers des sites HTTP sans risque SEO ?

- □ Faut-il vraiment écrire « naturellement » pour ranker sur Google ?

- □ Faut-il vraiment supprimer son fichier de désaveu de liens ?

- □ Faut-il vraiment éviter d'implémenter le Schema markup via Google Tag Manager ?

- □ Robots.txt vs meta robots : pourquoi bloquer le crawl peut-il nuire à la désindexation ?

- □ Peut-on dupliquer la même URL dans plusieurs fichiers sitemap sans risque SEO ?

- □ Comment indexer le contenu d'une iframe sans indexer la page source ?

- □ HSTS et preload list : une fausse piste pour le référencement ?

- □ Pourquoi un nom de domaine descriptif ne garantit-il pas votre classement sur sa requête ?

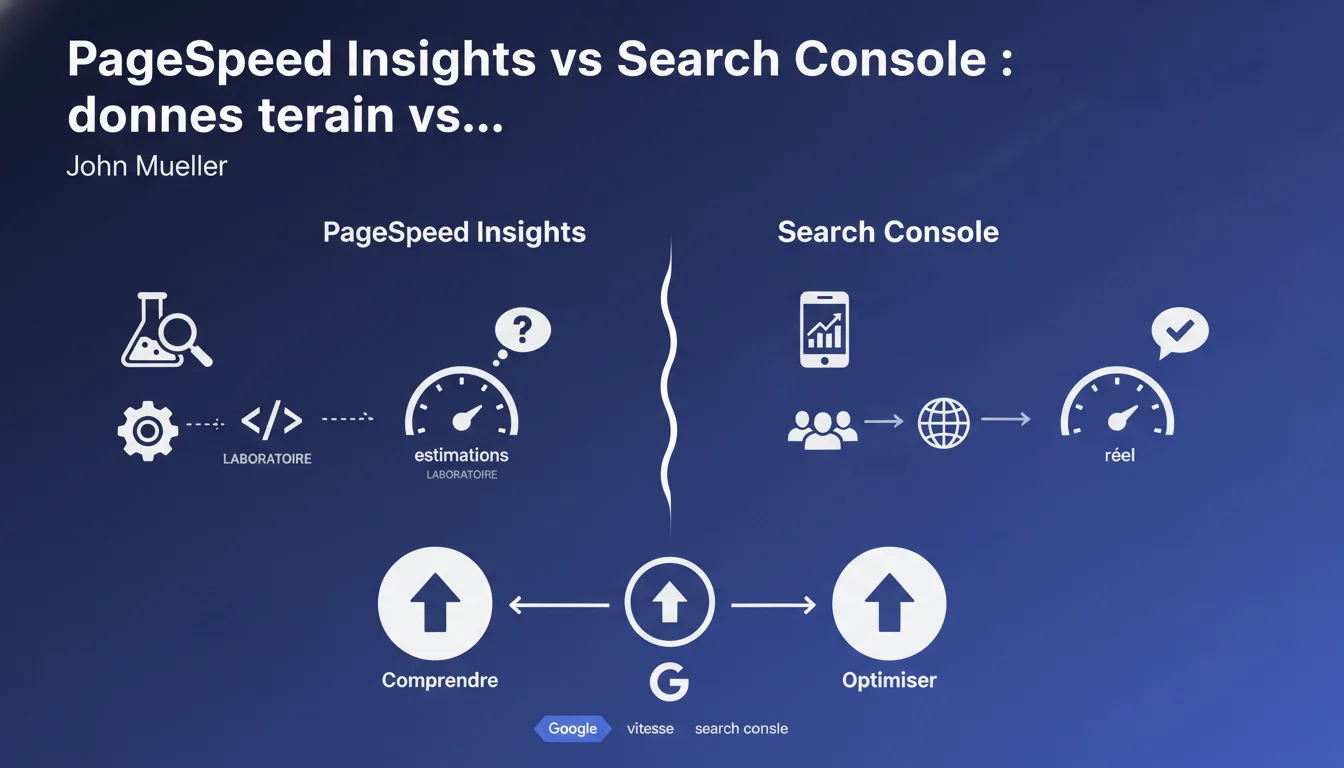

Google distingue deux types de données de vitesse : les données de laboratoire de PageSpeed Insights (estimations basées sur des hypothèses) et les données terrain de la Search Console (expérience utilisateur réelle). La recommandation officielle : privilégier la Search Console pour diagnostiquer la situation actuelle, utiliser les données labo pour optimiser.

Ce qu'il faut comprendre

Pourquoi cette distinction entre données de laboratoire et données terrain ?

PageSpeed Insights simule le chargement d'une page dans un environnement contrôlé — connexion standardisée, appareil de référence, cache vide. C'est une estimation théorique qui isole les facteurs techniques de votre site. Les données terrain de la Search Console, elles, agrègent ce que vos visiteurs réels subissent : connexions 4G fluctuantes, Wi-Fi saturés, appareils vieillissants.

Le problème ? Ces deux indicateurs peuvent diverger radicalement. Un site peut scorer 95 en labo et planter à 40 en conditions réelles parce que ses visiteurs viennent majoritairement de zones à faible débit. L'inverse existe aussi : un score labo médiocre peut masquer une expérience terrain correcte si votre audience dispose d'une infrastructure solide.

Quelle métrique Google utilise-t-il pour le ranking ?

Les Core Web Vitals qui impactent le classement proviennent du Chrome User Experience Report (CrUX) — autrement dit, des données terrain. C'est ce que la Search Console vous restitue dans son rapport dédié. PageSpeed Insights affiche aussi ces données CrUX quand elles existent, mais les recommandations d'optimisation reposent sur l'analyse labo via Lighthouse.

Concrètement : si votre URL n'a pas assez de trafic pour générer des données CrUX, Google ne l'évaluera pas sur les Core Web Vitals. Le score labo n'a alors aucun impact direct sur votre positionnement, même s'il reste utile pour détecter les failles techniques.

Comment interpréter l'absence de « chiffre absolument correct » ?

Mueller insiste : il n'y a pas de seuil magique. Un LCP de 2,4 secondes n'est pas systématiquement meilleur qu'un 2,6. Les seuils officiels (bon / à améliorer / mauvais) sont des repères, pas des barrières étanches. Google évalue la vitesse relativement à votre niche et pondère ce signal avec 200+ autres critères.

Cette nuance est rarement comprise : deux sites avec des métriques identiques peuvent subir des impacts ranking différents selon leur contexte concurrentiel et la pertinence de leur contenu.

- Données labo : reproductibles, contrôlées, idéales pour tester des hypothèses d'optimisation avant déploiement

- Données terrain : reflètent l'expérience utilisateur réelle, servent de base au calcul des Core Web Vitals pour le ranking

- Les seuils de performance ne sont pas des absolus mais des indicateurs relatifs au contexte de chaque site

- Une URL sans données CrUX (trafic insuffisant) n'est pas évaluée sur les Core Web Vitals dans l'algorithme

Avis d'un expert SEO

Cette distinction reflète-t-elle vraiment la pratique terrain ?

Oui, et c'est un point rarement explicité par Google avec autant de clarté. Dans 80% des audits que je réalise, l'écart labo/terrain s'explique par trois facteurs : la géographie de l'audience, la qualité des connexions mobiles, et la présence de scripts tiers non détectés en environnement contrôlé. Les données CrUX capturent ces variables — pas Lighthouse.

Mais attention : la Search Console agrège sur 28 jours glissants. Si vous déployez une optimisation majeure, vous ne verrez l'impact complet qu'au bout d'un mois. Les données labo, elles, reflètent l'amélioration immédiatement. D'où la complémentarité que Mueller souligne.

Quelles limites faut-il garder en tête ?

Première limite : [À vérifier] Google n'a jamais documenté précisément le seuil de trafic nécessaire pour générer des données CrUX. Les observations empiriques suggèrent qu'il faut plusieurs centaines de visiteurs Chrome mensuels, mais aucun chiffre officiel n'existe. Résultat : des milliers de sites optimisent leur vitesse sans savoir s'ils atteignent ce seuil.

Deuxième limite : les données terrain sont moyennes agrégées. Si 70% de vos visiteurs ont une expérience excellente mais 30% catastrophique (connexion satellite, par exemple), vous pouvez basculer dans le rouge alors que la majorité de votre audience est satisfaite. PageSpeed Insights ne vous montrera pas cette distribution — il faut creuser dans CrUX via BigQuery pour l'obtenir.

Troisième point — et c'est là que le discours de Google devient évasif : quel poids exact la vitesse a-t-elle dans le ranking ? Mueller parle d'un signal parmi tant d'autres, mais refuse de quantifier. Les tests A/B que j'ai menés sur des sites e-commerce montrent qu'améliorer le LCP de 4s à 2s génère rarement plus de 5% de gain de positions organiques si le contenu reste moyen. La vitesse est un différenciateur à compétence égale, pas un ascenseur magique.

Impact pratique et recommandations

Quelle méthodologie adopter concrètement ?

Étape 1 : Connectez-vous à la Search Console, section Core Web Vitals. Si vous avez des données, concentrez-vous sur les URLs « À améliorer » et « Médiocres ». Ce sont elles qui plombent potentiellement votre ranking. Ignorez PageSpeed Insights pour le diagnostic initial — vous risquez de corriger des problèmes théoriques qui n'affectent pas vos visiteurs réels.

Étape 2 : Une fois les URLs problématiques identifiées, basculez sur PageSpeed Insights et lancez l'analyse labo. Les recommandations Lighthouse vous donneront des pistes d'optimisation précises : compression d'images, élimination du JavaScript bloquant, mise en cache. Testez ces modifications en staging avant déploiement.

Étape 3 : Après déploiement, attendez 4 à 6 semaines avant de juger l'impact. Les données CrUX se rafraîchissent lentement. Suivez l'évolution dans la Search Console, pas dans PageSpeed Insights — ce dernier reflétera l'amélioration immédiatement mais ne prédit pas l'impact ranking.

Quelles erreurs éviter absolument ?

Erreur n°1 : optimiser pour le score labo au détriment de l'expérience réelle. J'ai vu des sites retirer Google Analytics, les pixels de tracking publicitaires ou les chatbots pour grappiller 10 points Lighthouse. Résultat : score parfait, conversions en chute libre. Les données labo sont un guide, pas un objectif.

Erreur n°2 : ignorer la segmentation. Si votre trafic provient à 60% du mobile en Asie du Sud-Est et 40% du desktop en Europe, vous avez deux problématiques distinctes. La Search Console agrège tout — creusez dans CrUX via BigQuery pour isoler les segments critiques.

Erreur n°3 : sous-estimer l'impact des ressources tierces. Les scripts publicitaires, widgets sociaux et solutions de tracking échappent souvent à votre contrôle mais plombent vos métriques. Utilisez un tag manager pour charger ces ressources de manière asynchrone et conditionnelle.

Comment vérifier que les optimisations fonctionnent ?

- Configurez un suivi hebdomadaire des données CrUX dans la Search Console — exportez les rapports pour détecter les tendances

- Comparez les scores labo avant/après déploiement pour valider que les corrections techniques ont bien été appliquées

- Surveillez les métriques business (taux de rebond, conversions) en parallèle des Core Web Vitals — une amélioration technique qui dégrade le business est un échec

- Si vous manquez de données CrUX, utilisez des outils RUM (Real User Monitoring) comme SpeedCurve ou Cloudflare Web Analytics pour capturer vos propres données terrain

- Documentez chaque modification et son impact — créez un référentiel interne pour capitaliser sur vos apprentissages

❓ Questions frequentes

Les données de PageSpeed Insights influencent-elles directement mon classement Google ?

Que se passe-t-il si mon site n'a pas assez de trafic pour générer des données CrUX ?

Pourquoi mon score PageSpeed Insights est excellent alors que la Search Console signale des problèmes ?

Combien de temps faut-il pour voir l'impact d'une optimisation de vitesse dans la Search Console ?

Faut-il viser un score de 100 sur PageSpeed Insights ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/07/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.