Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Le balisage Local Business doit-il vraiment se limiter à une seule ville ?

- □ Faut-il vraiment migrer 1:1 sans rien changer lors d'un changement de domaine ?

- □ Schema.org : pourquoi Google ignore-t-il une partie de vos balises structurées ?

- □ Faut-il vraiment rédiger du texte descriptif autour de vos illustrations pour ranker dans Google Images ?

- □ Faut-il publier tous les jours pour améliorer son référencement Google ?

- □ Le nombre de mots est-il vraiment sans importance pour le référencement ?

- □ Les mots-clés dans les URLs ont-ils encore un impact en SEO ?

- □ Les images consomment-elles vraiment du budget de crawl au détriment de vos pages stratégiques ?

- □ Peut-on vraiment lancer deux sites quasi-identiques sans risquer de pénalité Google ?

- □ Pourquoi vos liens JavaScript doivent absolument utiliser des balises A avec href valide ?

- □ L'audio sur une page influence-t-il réellement le classement Google ?

- □ Les mises à jour algorithmiques de Google sont-elles vraiment différentes des pénalités ?

- □ Pourquoi Google ne communique-t-il que sur une fraction de ses mises à jour d'algorithme ?

- □ Les données structurées améliorent-elles vraiment votre classement dans Google ?

- □ Faut-il vraiment éviter d'utiliser noindex et canonical sur la même page ?

- □ Les données structurées vidéo servent-elles uniquement à l'indexation ?

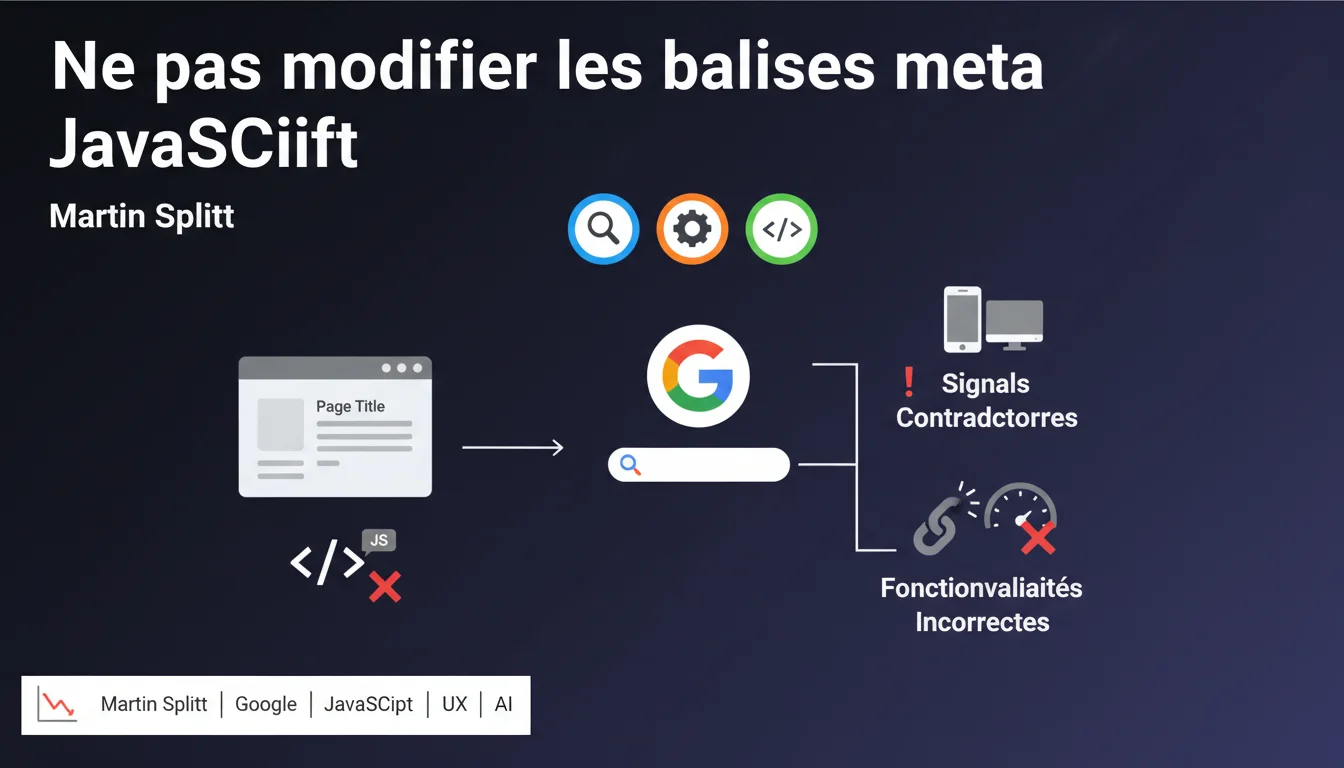

Google déconseille formellement de modifier les balises meta via JavaScript, car cela peut générer des signaux contradictoires pour le moteur de recherche. Certaines fonctionnalités de Google peuvent ne pas détecter ces changements ou afficher des informations erronées. Mieux vaut intégrer les balises meta directement dans le HTML côté serveur.

Ce qu'il faut comprendre

Pourquoi Google déconseille-t-il la manipulation JavaScript des balises meta ?

La déclaration de Martin Splitt vise un problème technique précis : le timing de l'exécution JavaScript. Quand Googlebot analyse une page, il peut récupérer le HTML initial avant que le JavaScript n'ait modifié les balises meta. Résultat ? Le moteur capte une version, tandis que l'utilisateur en voit une autre.

Ce décalage crée une incohérence de données entre ce que Google indexe et ce que vous pensiez avoir implémenté. Les rich snippets, le Knowledge Graph, les aperçus sociaux — tous ces systèmes peuvent se retrouver avec des métadonnées obsolètes ou contradictoires.

Quelles balises meta sont concernées par cette recommandation ?

Toutes les balises insérées dans le <head> : title, meta description, canonical, robots, hreflang, Open Graph, Twitter Cards, Schema.org. Bref, tout ce qui influence l'indexation, l'affichage dans les SERP ou le partage social.

Le risque varie selon la balise. Modifier un canonical via JS peut carrément perturber l'indexation. Changer une meta description affectera surtout l'affichage dans les résultats de recherche — mais Google peut ignorer la version modifiée.

Cette limitation s'applique-t-elle aussi aux frameworks JavaScript modernes ?

Oui, même avec React, Vue, Angular ou Next.js. Si votre application génère les balises meta uniquement côté client, vous tombez dans ce travers. La solution ? Le Server-Side Rendering (SSR) ou la génération statique (SSG), qui injectent les balises dans le HTML initial avant l'envoi au navigateur.

Les frameworks modernes proposent justement ces mécanismes — Next.js avec getServerSideProps, Nuxt avec asyncData, Angular Universal. L'enjeu est de configurer correctement votre stack technique pour que les métadonnées soient présentes dès le premier octet de HTML reçu.

- Le timing d'exécution JavaScript crée un décalage entre HTML initial et version finale

- Les systèmes Google (snippets, Knowledge Graph) peuvent récupérer des données obsolètes

- Toutes les balises meta sont concernées : title, description, canonical, robots, hreflang, OG, etc.

- Les frameworks JS modernes nécessitent du SSR ou SSG pour injecter les balises côté serveur

- Le risque varie : un canonical JS peut casser l'indexation, une description sera juste ignorée

Avis d'un expert SEO

Cette recommandation reflète-t-elle vraiment le comportement observé de Googlebot ?

Oui et non. Googlebot exécute bel et bien JavaScript depuis des années, et dans beaucoup de cas, il détecte correctement les balises modifiées dynamiquement. Mais le mot-clé ici, c'est "dans beaucoup de cas" — pas tous.

Le problème surgit quand le JS met du temps à s'exécuter, quand il y a des erreurs non détectées, ou quand Google crawle la page avec un budget limité et n'attend pas la fin du rendu. J'ai vu des sites où le canonical JS était bien pris en compte... et d'autres où Google indexait la mauvaise URL. [A vérifier] sur chaque projet, donc.

Dans quels scénarios cette règle peut-elle être contournée sans risque ?

Soyons francs : si vous maîtrisez le SSR et que vos balises sont injectées avant l'hydratation JS, techniquement vous ne "modifiez" rien avec JavaScript — vous générez le HTML côté serveur avec du code JS, nuance. Google reçoit un HTML complet, point.

Autre cas : les métadonnées non critiques pour l'indexation. Modifier une balise Open Graph côté client pour un partage social dynamique ? Le risque SEO est quasi nul, puisque Google n'utilise pas OG pour le classement. Mais attention — les scrapers sociaux (Facebook, LinkedIn) peuvent eux aussi rater le changement.

Pourquoi Google reste-t-il flou sur les "certaines fonctionnalités" mentionnées ?

Classique. Google adore les formulations vagues qui lui laissent une marge de manœuvre. "Certaines fonctionnalités peuvent ne pas détecter" — lesquelles ? Combien de temps faut-il attendre avant que le JS soit exécuté ? Aucune donnée chiffrée.

Mon interprétation : Google sait que son infrastructure est complexe et hétérogène. Tous les systèmes n'exécutent pas le JS de la même façon, certains pipelines de traitement ignorent carrément le rendu dynamique. Plutôt que de documenter chaque exception, ils balancent un "évitez, c'est plus sûr". Pratique pour eux, frustrant pour nous.

Impact pratique et recommandations

Que faut-il faire concrètement pour se conformer à cette recommandation ?

Première étape : auditer vos templates. Identifiez toutes les balises meta générées ou modifiées par JavaScript. Utilisez "View Page Source" (Ctrl+U) pour voir le HTML brut reçu par le serveur, puis comparez avec l'inspecteur d'éléments (F12) qui affiche le DOM après exécution JS.

Si vous trouvez des différences sur des balises critiques (title, canonical, robots), vous avez un problème. La solution dépend de votre stack : soit vous passez au SSR/SSG, soit vous réécrivez la logique pour injecter les balises côté serveur dès le rendu initial.

Quelles erreurs éviter absolument dans l'implémentation ?

Ne vous contentez pas de "ça marche chez moi". Testez avec les outils Google : URL Inspection Tool dans la Search Console, qui montre exactement ce que Googlebot voit. Si vos balises modifiées par JS n'apparaissent pas dans le rendu de l'outil, elles ne sont probablement pas prises en compte.

Autre piège : croire que "Google crawle le JS" signifie "Google crawle instantanément le JS". Non. Il peut y avoir un délai entre le crawl du HTML brut et le rendu JS, parfois de plusieurs jours. Pendant ce laps de temps, Google utilise les anciennes métadonnées.

Comment vérifier que mon site respecte cette directive ?

Voici une checklist concrète pour valider votre implémentation :

- Comparer le HTML source (Ctrl+U) et le DOM rendu (F12) : les balises meta doivent être identiques

- Tester chaque template clé avec l'URL Inspection Tool de la Search Console

- Vérifier que les balises title, canonical, robots, hreflang sont présentes avant tout script

- Si vous utilisez un framework JS, activer le SSR (Next.js, Nuxt) ou la génération statique

- Monitorer les rapports de couverture d'index pour détecter les canonicals ignorés ou les pages désindexées

- Tester les snippets enrichis avec le Rich Results Test de Google

- Documenter clairement dans votre code où et comment chaque balise meta est générée

❓ Questions frequentes

Google détecte-t-il vraiment toutes les modifications JavaScript des balises meta ?

Puis-je utiliser JavaScript pour modifier les balises Open Graph sans risque SEO ?

Le Server-Side Rendering (SSR) résout-il complètement ce problème ?

Comment savoir si Google a bien pris en compte mes balises meta ?

Peut-on modifier le canonical avec JavaScript en toute sécurité ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/09/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.