Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- 3:25 Pourquoi des rich results valides ne garantissent-ils pas l'affichage dans Job Search ?

- 5:14 Le champ employmentType dans les données structurées JobPosting influence-t-il le matching des requêtes ?

- 7:19 Peut-on agréger les avis d'autres sites dans ses données structurées Rating ?

- 10:28 Faut-il vraiment avoir un contenu strictement identique entre mobile et desktop pour le Mobile-First Indexing ?

- 10:28 Pourquoi masquer du contenu mobile en CSS sabote-t-il votre indexation Mobile-First ?

- 19:07 Le contenu masqué dans des accordéons et des onglets est-il vraiment indexé par Google ?

- 19:07 Google Office Hours : pourquoi votre question SEO ne recevra-t-elle peut-être jamais de réponse ?

- 24:24 Pourquoi le nombre d'URLs dans Web Vitals de Search Console varie-t-il chaque mois ?

- 25:24 Pourquoi vos métriques Page Experience fluctuent-elles alors que vous n'avez rien changé ?

- 31:07 Les redirections géolocalisées par cookies sont-elles considérées comme du cloaking par Google ?

- 31:07 Faut-il vraiment abandonner les redirections géolocalisées au profit du hreflang ?

- 31:07 Les redirections IP bloquent-elles vraiment l'indexation de vos contenus multilingues ?

- 48:33 Les tests A/B posent-ils un risque de cloaking aux yeux de Google ?

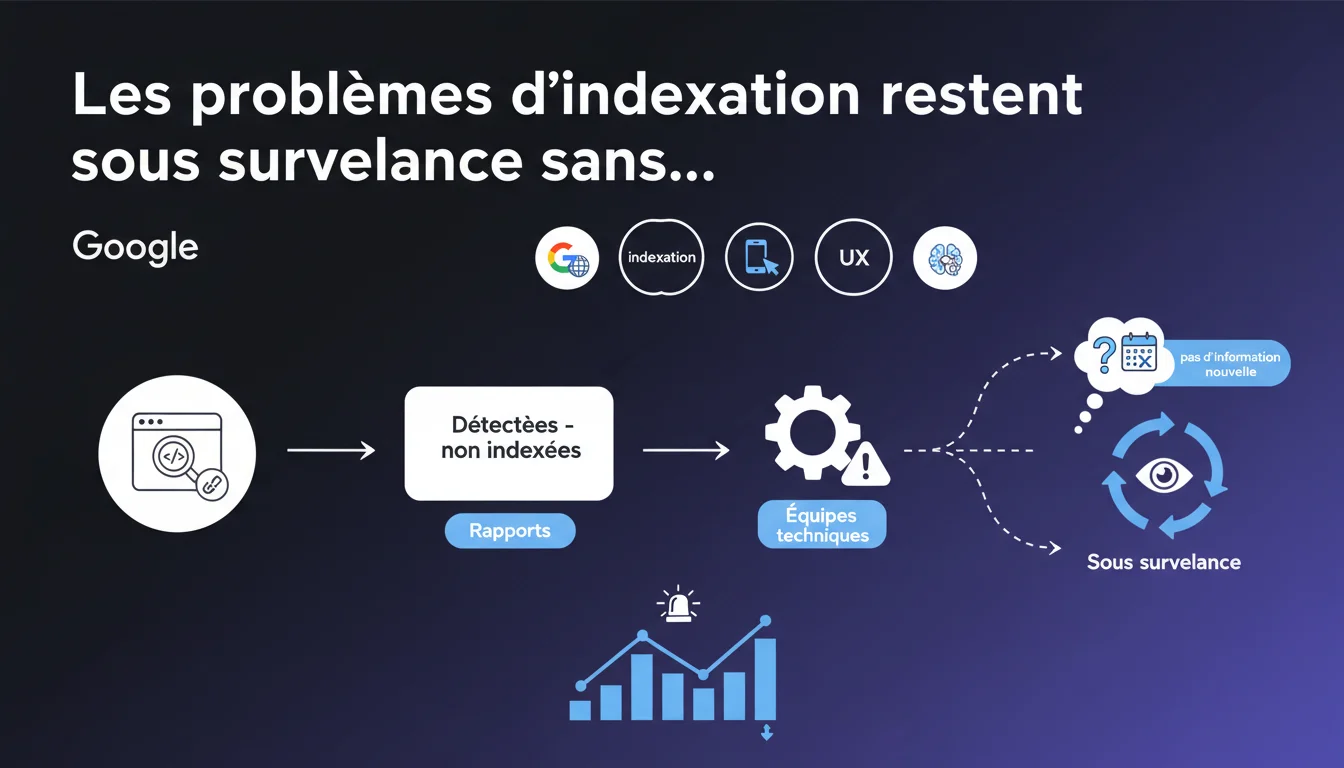

Google continue de recevoir des signalements concernant les pages 'Détectées - non indexées' mais n'a aucune mise à jour à communiquer. Les équipes techniques sont au courant, mais aucun délai de résolution n'est annoncé. Le silence prolongé interroge sur l'ampleur réelle du problème.

Ce qu'il faut comprendre

Que signifie ce statut 'Détectées - non indexées' ?

Lorsque Google découvre une URL via le crawl ou via un sitemap, mais décide de ne pas l'ajouter à son index, elle apparaît avec ce statut dans la Search Console. Contrairement à une exclusion pour cause technique (robots.txt, noindex), ces pages sont techniquement accessibles mais Google choisit de ne pas les indexer.

Ce statut peut concerner quelques pages sur un site — ce qui est normal — ou des milliers d'URLs, ce qui pose un vrai problème de visibilité. La différence entre les deux cas tient à l'ampleur et à la récurrence du phénomène.

Pourquoi Google parle-t-il de 'rapports transmis aux équipes techniques' ?

Cette formulation suggère que le problème n'est pas isolé. Google reconnaît recevoir suffisamment de signalements pour que le sujet remonte en interne, sans pour autant admettre un bug ou un dysfonctionnement généralisé.

L'absence de calendrier ou de diagnostic précis laisse planer le doute : s'agit-il d'un filtre de qualité plus strict, d'une limitation de ressources de crawl, ou d'un véritable problème technique ?

Que cache l'absence d'information nouvelle ?

Soit Google n'a vraiment rien identifié de concret à partager, soit l'équipe préfère ne pas communiquer sur un sujet sensible. Ce silence prolongé devient lui-même un signal pour les SEO : il faut apprendre à vivre avec ce statut et optimiser différemment.

- Le statut 'Détectées - non indexées' peut être temporaire ou permanent selon les cas

- Google ne considère pas forcément ce phénomène comme un bug à corriger

- Les rapports remontent en interne sans garantie de résolution rapide

- Aucune métrique ou seuil officiel n'est communiqué pour distinguer un cas normal d'un problème réel

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Beaucoup de sites voient effectivement exploser le nombre de pages dans ce statut depuis plusieurs mois, sans explication claire. Certains secteurs sont plus touchés que d'autres — e-commerce, médias, sites multilingues — ce qui suggère que Google applique des critères sélectifs, pas un filtre uniforme.

Mais le fait que Google continue de dire « on transmet » sans jamais préciser si c'est un comportement attendu ou un dysfonctionnement, c'est frustrant. [A vérifier] : est-ce que l'équipe a vraiment des données de régression, ou considère-t-elle que c'est le nouvel équilibre normal ? Rien dans cette déclaration ne permet de trancher.

Quelles nuances faut-il apporter à ce statut ?

Toutes les pages 'Détectées - non indexées' ne se valent pas. Une page orpheline, sans lien interne, découverte uniquement via un sitemap XML, n'a pas la même légitimité qu'une page de catégorie bien maillée, avec du trafic référent et des backlinks.

Le problème, c'est que Google mélange tout dans le même statut. Résultat : impossible de savoir si c'est un signal d'alarme ou du bruit. Il faut croiser avec d'autres données — logs serveur, maillage interne, profondeur de clic — pour diagnostiquer la vraie cause.

Dans quels cas ce phénomène mérite-t-il vraiment de s'inquiéter ?

Si le volume de pages 'Détectées - non indexées' augmente brusquement sans raison évidente — pas de migration, pas de changement structurel — et que ça touche des URLs à fort potentiel de trafic, là oui, il faut creuser. Surtout si ces pages étaient indexées auparavant et ont disparu sans explication.

Impact pratique et recommandations

Que faire concrètement avec ces pages non indexées ?

D'abord, segmenter les URLs concernées : sont-elles stratégiques ou secondaires ? Ont-elles du trafic organique dans le passé ? Sont-elles maillées correctement ? Cette analyse permet de prioriser les actions.

Ensuite, vérifier que ces pages ne sont pas orphelines. Si elles ne reçoivent aucun lien interne depuis des pages crawlées régulièrement, Google n'a aucune raison de les considérer comme importantes. Renforcer le maillage interne reste l'action la plus efficace à court terme.

Pour les pages stratégiques toujours ignorées malgré un bon maillage, tester l'inspection d'URL avec demande d'indexation peut débloquer certains cas — mais sans garantie. Si ça ne fonctionne pas, il faut retravailler le contenu, améliorer les signaux de pertinence, ou accepter que Google juge la page non prioritaire.

Quelles erreurs éviter face à ce statut ?

Ne pas paniquer et soumettre massivement toutes les URLs via l'API Indexing. Cette API est réservée aux contenus urgents (offres d'emploi, livestreams) et son utilisation abusive peut entraîner une suspension d'accès.

Éviter aussi de bourrer le sitemap XML avec des milliers d'URLs de faible qualité en espérant forcer l'indexation. Google crawle le sitemap, mais ça ne garantit rien si les pages ne respectent pas ses critères de qualité.

Comment surveiller l'évolution de ce problème ?

Mettre en place un suivi hebdomadaire du nombre de pages 'Détectées - non indexées' via la Search Console. Exporter régulièrement les listes d'URLs pour comparer et identifier les patterns — types de pages, profondeur, thématiques.

- Segmenter les URLs non indexées par typologie (produits, catégories, articles, pages techniques)

- Vérifier le maillage interne de ces pages et leur profondeur de clic depuis la home

- Analyser les logs serveur pour savoir si Googlebot visite réellement ces URLs

- Tester l'inspection d'URL sur un échantillon de pages stratégiques

- Améliorer les signaux de pertinence : titres, métas, contenu unique, backlinks internes

- Éviter de soumettre massivement via l'API Indexing ou de surcharger le sitemap

- Suivre l'évolution du statut dans le temps pour détecter les régressions ou améliorations

❓ Questions frequentes

Le statut 'Détectées - non indexées' signifie-t-il que Google pénalise mon site ?

Combien de temps faut-il attendre avant que Google indexe ces pages ?

Peut-on forcer l'indexation via l'API Indexing ?

Faut-il retirer ces URLs du sitemap XML ?

Ce problème touche-t-il tous les sites de la même manière ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.