Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Peut-on vraiment forcer Google à ré-indexer un site entier d'un coup ?

- □ Google réindexe-t-il automatiquement les changements majeurs sur un site ?

- □ Pourquoi une simple redirection 301 peut-elle faire toute la différence lors d'une refonte ?

- □ Faut-il vraiment utiliser un code 404 ou 410 pour les pages supprimées ?

- □ Pourquoi lier vos nouvelles pages depuis le site existant est-il crucial pour l'indexation Google ?

- □ Faut-il vraiment lier ses nouvelles pages depuis les pages importantes pour accélérer l'indexation ?

- □ Pourquoi Google recommande-t-il d'afficher les changements critiques sur les pages existantes plutôt que de créer de nouvelles pages ?

- □ Les sitemaps XML sont-ils vraiment indispensables pour l'indexation de votre site ?

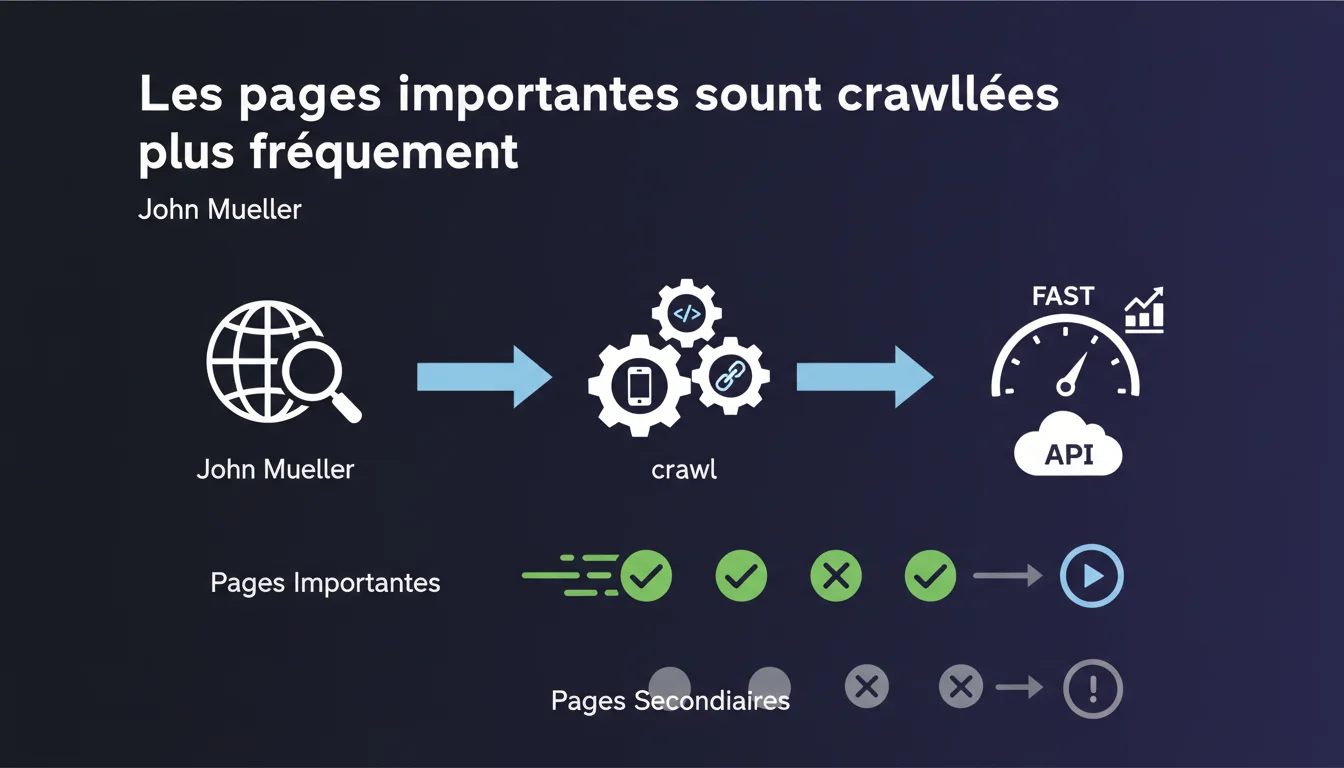

Google privilégie le crawl des pages qu'il juge importantes, qui seront donc indexées et mises à jour plus rapidement. L'enjeu pour un SEO : comprendre comment Google évalue cette « importance » et optimiser les signaux qui déclenchent un crawl fréquent. Sauf que Mueller reste volontairement flou sur les critères précis.

Ce qu'il faut comprendre

Comment Google détermine-t-il qu'une page est « importante » ?

La déclaration de Mueller repose sur un constat simple : tous les contenus ne se valent pas aux yeux de Googlebot. Le moteur alloue son temps de crawl en fonction d'une hiérarchie qu'il établit lui-même.

Concrètement, plusieurs facteurs entrent en jeu : le volume de trafic vers la page, la fréquence de mise à jour du contenu, la qualité du maillage interne, et la présence de backlinks pointant vers elle. Une page qui génère des clics réguliers depuis la SERP, qui est liée depuis la homepage ou qui reçoit des liens externes de qualité envoie un signal fort à Google.

Mais attention : Google ne publie aucune grille de scoring officielle. On en est réduit à observer les corrélations terrain.

Qu'est-ce que cela change pour le crawl budget ?

Le crawl budget est la quantité de pages que Googlebot accepte d'explorer sur un site dans un laps de temps donné. Si vos ressources de crawl sont monopolisées par des pages secondaires — filtres à facettes, archives paginées infinies, contenus dupliqués — vos pages stratégiques risquent d'être crawlées moins souvent.

Mueller confirme ici que Google fait un tri. Les sites volumineux (e-commerce, médias) sont particulièrement concernés : sans une architecture optimisée, les nouvelles pages importantes peuvent rester invisibles pendant des jours, voire des semaines.

Quels sont les indicateurs concrets que Google utilise pour prioriser ?

Google ne donne jamais une liste exhaustive — et c'est là que ça coince. On sait que certains critères comptent plus que d'autres, mais leur pondération exacte reste opaque.

- Fréquence de mise à jour : une page modifiée régulièrement sera vérifiée plus souvent

- Profondeur dans l'arborescence : plus une URL est accessible en peu de clics depuis la homepage, mieux c'est

- Signaux d'engagement : pages qui génèrent du trafic organique, des clics depuis la SERP, du temps de visite

- Autorité externe : backlinks de qualité, mentions sur des sites de référence

- Performance technique : vitesse de chargement, stabilité du serveur, absence d'erreurs 5xx

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, globalement. Les logs serveur confirment que Google crawle de manière différenciée. Sur un site e-commerce de 50 000 produits, les fiches best-sellers sont visitées plusieurs fois par jour, tandis que les références en rupture de stock depuis des mois ne sont même plus explorées.

Mais Mueller botte en touche sur la partie la plus actionnable : comment influencer cette priorisation ? Il dit « les pages importantes sont crawlées plus souvent », sans préciser si c'est une conséquence (Google détecte l'importance) ou un levier (on peut forcer la main). [À vérifier]

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : la « rapidité de mise à jour » n'est pas synonyme de meilleur classement. Une page peut être crawlée tous les jours et stagner en page 3 si son contenu est médiocre. Le crawl fréquent n'est qu'un prérequis — pas une garantie de visibilité.

Deuxième nuance : certains sites ont un crawl budget si limité que même leurs pages stratégiques sont sous-crawlées. Typiquement, un site technique bancal (temps de réponse > 2 secondes, redirections en chaîne, erreurs intermittentes) peut voir Googlebot réduire drastiquement sa fréquence de visite, peu importe l'importance théorique des pages.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Les sites de niche avec peu de pages (< 500 URLs) ne sont généralement pas concernés par ces problématiques de priorisation. Google crawle l'ensemble du site régulièrement, sauf blocage technique majeur.

Autre exception : les actualités. Google News dispose de mécanismes spécifiques pour détecter les nouveaux contenus en temps quasi réel. Un article publié sur un média d'info peut être crawlé en quelques minutes, indépendamment de la « hiérarchie d'importance » classique.

Impact pratique et recommandations

Que faut-il faire concrètement pour favoriser le crawl des pages stratégiques ?

D'abord, identifier quelles pages méritent réellement un crawl fréquent. Pas besoin que vos CGU soient visitées tous les jours. Concentrez vos efforts sur les contenus générateurs de trafic ou de conversions : fiches produits phares, articles de blog à fort potentiel, pages catégories principales.

Ensuite, optimisez votre maillage interne pour pousser ces pages stratégiques vers le haut de la hiérarchie. Liez-les depuis la homepage, le menu principal, ou des hubs thématiques bien positionnés. Plus une page est accessible en peu de clics, plus Google la considère comme importante.

Enfin, surveillez vos logs serveur pour vérifier la réalité du crawl. Une page théoriquement stratégique mais visitée 1 fois par mois par Googlebot révèle un problème structurel.

Quelles erreurs éviter absolument ?

Ne pas gaspiller le crawl budget sur des pages inutiles. Blocage robots.txt des filtres à facettes, pagination infinie, URLs paramétrées sans valeur ajoutée — tout ce qui dilue l'attention de Googlebot sur du contenu non stratégique.

Autre piège : croire qu'un sitemap XML suffit. Google l'utilise comme un indice, pas comme une directive. Si vos pages listées dans le sitemap sont enfouies à 8 clics de profondeur et n'ont aucun backlink, elles ne seront pas crawlées fréquemment.

Comment vérifier que mon site est conforme à ces bonnes pratiques ?

- Analysez vos logs serveur pour identifier les pages crawlées fréquemment vs celles ignorées par Googlebot

- Vérifiez que vos pages stratégiques sont accessibles en moins de 3 clics depuis la homepage

- Auditez votre maillage interne : les pages importantes doivent recevoir des liens depuis d'autres sections du site

- Contrôlez la vitesse de chargement et la stabilité technique — un serveur lent réduit drastiquement le crawl budget

- Utilisez la Search Console pour repérer les URLs « découvertes mais non explorées » : c'est souvent le signe d'un problème de priorisation

- Bloquez via robots.txt ou noindex les zones non stratégiques (filtres, recherches internes, archives)

❓ Questions frequentes

Est-ce que soumettre une URL via la Search Console accélère son crawl ?

Le sitemap XML influence-t-il vraiment la fréquence de crawl ?

Comment savoir si mon crawl budget est saturé ?

Les backlinks influencent-ils directement la fréquence de crawl ?

Faut-il modifier régulièrement une page pour qu'elle soit crawlée plus souvent ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 23/01/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.