Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Google favorisait-il vraiment le HTML au détriment du JavaScript pour l'indexation ?

- □ Les spinners de chargement peuvent-ils vraiment bloquer l'indexation de vos pages JavaScript ?

- □ Pourquoi l'indexation JavaScript prend-elle 3 à 6 mois après le crawl ?

- □ Pourquoi vos liens JavaScript ralentissent-ils la découverte de vos pages par Google ?

- □ Le JavaScript peut-il vraiment être indexé plus vite que l'HTML ?

- □ Comment vérifier si Google rend vraiment votre JavaScript avec la méthode du honeypot ?

- □ Tous les frameworks JavaScript sont-ils vraiment égaux face au crawl de Google ?

- □ Faut-il vraiment corriger la technique avant de miser sur le contenu et les backlinks ?

- □ Pourquoi Google recommande-t-il de tester en conditions réelles plutôt que de croire la documentation ?

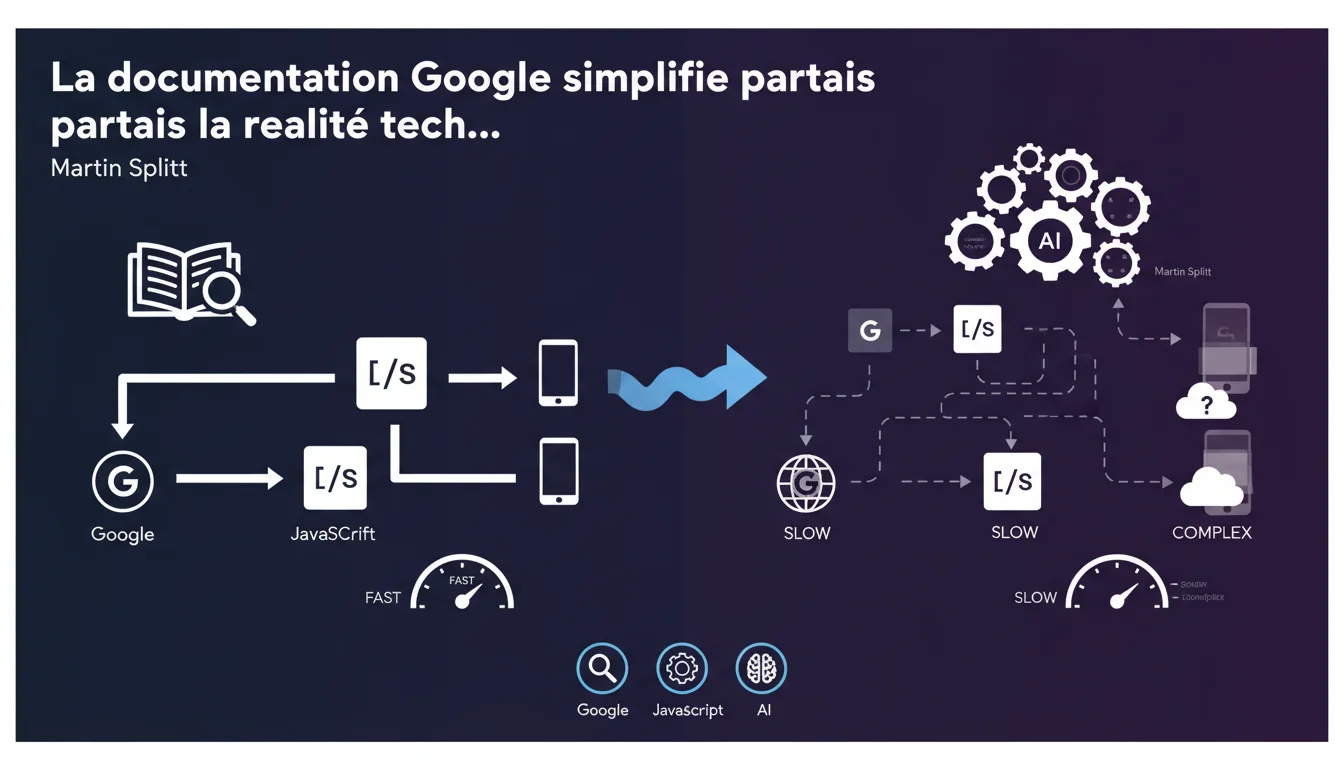

Martin Splitt admet que les affirmations officielles de Google sur le JavaScript — notamment « Google rend le JS comme un navigateur moderne » — sont des simplifications volontaires. La réalité technique est plus nuancée, avec des limitations que Google ne documente pas toujours. Pour les praticiens SEO, cela signifie qu'il ne faut jamais prendre les communications officielles au pied de la lettre.

Ce qu'il faut comprendre

Pourquoi Google simplifie-t-il ses messages publics ?

Google communique pour un public large — du débutant au praticien confirmé. Détailler chaque contrainte technique rendrait la documentation indigeste et contre-productive.

Le problème, c'est que cette simplification crée un décalage entre perception et réalité. Beaucoup de sites misent tout sur du JavaScript lourd en croyant que Googlebot « rend comme Chrome ». Sauf que ce n'est pas strictement vrai.

Quelles sont les nuances que Google omet ?

Googlebot utilise une version de Chromium, mais pas la dernière. Les délais de rendu diffèrent d'un navigateur classique. Certaines API modernes ne sont pas supportées. Les ressources bloquées par robots.txt ne sont jamais chargées, même si elles sont critiques pour le rendu.

Le budget crawl intervient aussi : si une page met trop de temps à rendre son contenu final, Googlebot peut indexer une version partielle. Ces détails ne figurent pas dans les guides officiels.

- Version de Chromium : pas toujours à jour avec la dernière stable

- Timeout de rendu : Google impose des limites non documentées

- Ressources bloquées : même critiques, elles ne sont jamais chargées

- Budget crawl : une page JS trop lente peut être indexée incomplète

- APIs modernes : certaines ne sont tout simplement pas disponibles

Comment cette simplification impacte-t-elle les stratégies SEO ?

Un site qui fonctionne parfaitement dans Chrome peut ne pas être correctement indexé par Google. Les équipes techniques se fient aux messages officiels et négligent les tests avec Search Console ou des outils comme Screaming Frog en mode JavaScript.

Résultat : des pages orphelines dans l'index, du contenu manquant, des liens internes non suivis. La confiance aveugle dans la doc Google mène à des décisions risquées.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. Depuis des années, on constate des écarts entre ce que Google affirme et ce qu'il fait réellement. Les tests avec le Mobile-Friendly Test, le Rich Results Test et l'Inspection d'URL montrent régulièrement des différences de rendu.

Certains sites voient leur contenu principal invisible dans le HTML source indexé sans problème — mais d'autres, avec une stack JS identique, rencontrent des difficultés. Les variables non documentées (vitesse serveur, historique du domaine, budget crawl) jouent un rôle que Google ne détaille jamais.

Faut-il remettre en question toute la documentation officielle ?

Non, mais il faut l'interpréter avec un regard critique. Les affirmations de Google sont rarement fausses — elles sont incomplètes. Quand Google dit « nous rendons le JavaScript », c'est vrai. Ce qu'il ne dit pas, c'est dans quelles conditions, avec quelles limites, et avec quel délai.

[A vérifier] : Google ne publie jamais de benchmarks précis sur les timeouts de rendu, les versions exactes de Chromium utilisées, ou les seuils de budget crawl. Ces zones d'ombre obligent les SEO à tester eux-mêmes, site par site.

Quelles sont les conséquences pour les audits SEO ?

Auditer un site JavaScript demande désormais une double vérification : ce que le navigateur affiche, et ce que Googlebot indexe réellement. Les outils classiques (Screaming Frog, Oncrawl, Botify) doivent être configurés pour rendre le JS, mais même là, ils ne reproduisent pas exactement le comportement de Google.

Les équipes SEO doivent croiser plusieurs sources : logs serveur, données Search Console, tests manuels d'URL, crawls JS et non-JS. C'est chronophage, mais c'est la seule façon de repérer les angles morts créés par les simplifications de Google.

Impact pratique et recommandations

Que faut-il faire concrètement pour sécuriser un site JavaScript ?

D'abord, ne jamais supposer que « si ça marche dans Chrome, ça marche pour Google ». Teste chaque page stratégique avec l'outil Inspection d'URL de Search Console et compare le rendu HTML source avec le rendu final.

Ensuite, vérifie que les ressources critiques (CSS, JS, fonts) ne sont pas bloquées par robots.txt. Utilise un crawler configuré en mode JavaScript ET en mode HTML brut pour identifier les écarts de contenu.

- Tester les pages clés avec l'Inspection d'URL (Search Console)

- Comparer le HTML source et le rendu JS final

- Vérifier que robots.txt n'empêche pas le chargement de ressources essentielles

- Crawler le site en mode JS et non-JS pour repérer les différences

- Monitorer les logs pour détecter des timeouts ou des erreurs de rendu

- Préférer le SSR (Server-Side Rendering) ou le prerendering si possible

- Limiter la profondeur des interactions JS pour accéder au contenu principal

Quelles erreurs faut-il absolument éviter ?

Ne jamais déployer une SPA (Single Page Application) sans avoir testé l'indexation en conditions réelles. Les frameworks modernes (React, Vue, Angular) sont séduisants côté développement, mais ils créent des risques SEO si mal configurés.

Évite aussi de faire confiance aux messages rassurants de Google sans validation terrain. Si ton site perd du trafic après une refonte JS, ce n'est pas un bug — c'est probablement un problème de rendu non détecté avant mise en prod.

Comment s'assurer que les modifications restent efficaces dans la durée ?

Mets en place un monitoring continu : alertes Search Console sur les erreurs d'indexation, crawls hebdomadaires automatisés, suivi des Core Web Vitals. Les mises à jour de Googlebot peuvent introduire de nouvelles limitations sans préavis.

❓ Questions frequentes

Google ment-il volontairement dans sa documentation ?

Googlebot utilise-t-il vraiment la dernière version de Chrome ?

Peut-on faire confiance aux tests de Google (Mobile-Friendly Test, Rich Results Test) ?

Faut-il abandonner le JavaScript côté client pour le SEO ?

Comment savoir si mon site JavaScript est correctement indexé ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/02/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.