Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ La fréquence de crawl influence-t-elle réellement le classement SEO ?

- □ Pourquoi Google ignore-t-il la balise lastmod de vos sitemaps ?

- □ IndexNow et Google : faut-il vraiment soumettre vos URLs pour accélérer l'indexation ?

- □ Faut-il vraiment pinger votre sitemap à chaque publication ?

- □ Google est-il vraiment en panne plus souvent qu'avant ?

- □ HTTPS et vitesse de chargement : faut-il vraiment s'en préoccuper pour l'indexation ?

- □ Pourquoi Google a-t-il décidé de refondre entièrement ses Webmaster Guidelines ?

- □ Le cloaking géographique est-il vraiment toléré par Google ?

- □ Le dynamic rendering est-il vraiment sans risque pour Google ?

- □ Les sites multi-locaux sont-ils des doorway pages ou une stratégie SEO légitime ?

- □ Les signaux de Page Experience desktop vont-ils changer la donne pour votre référencement ?

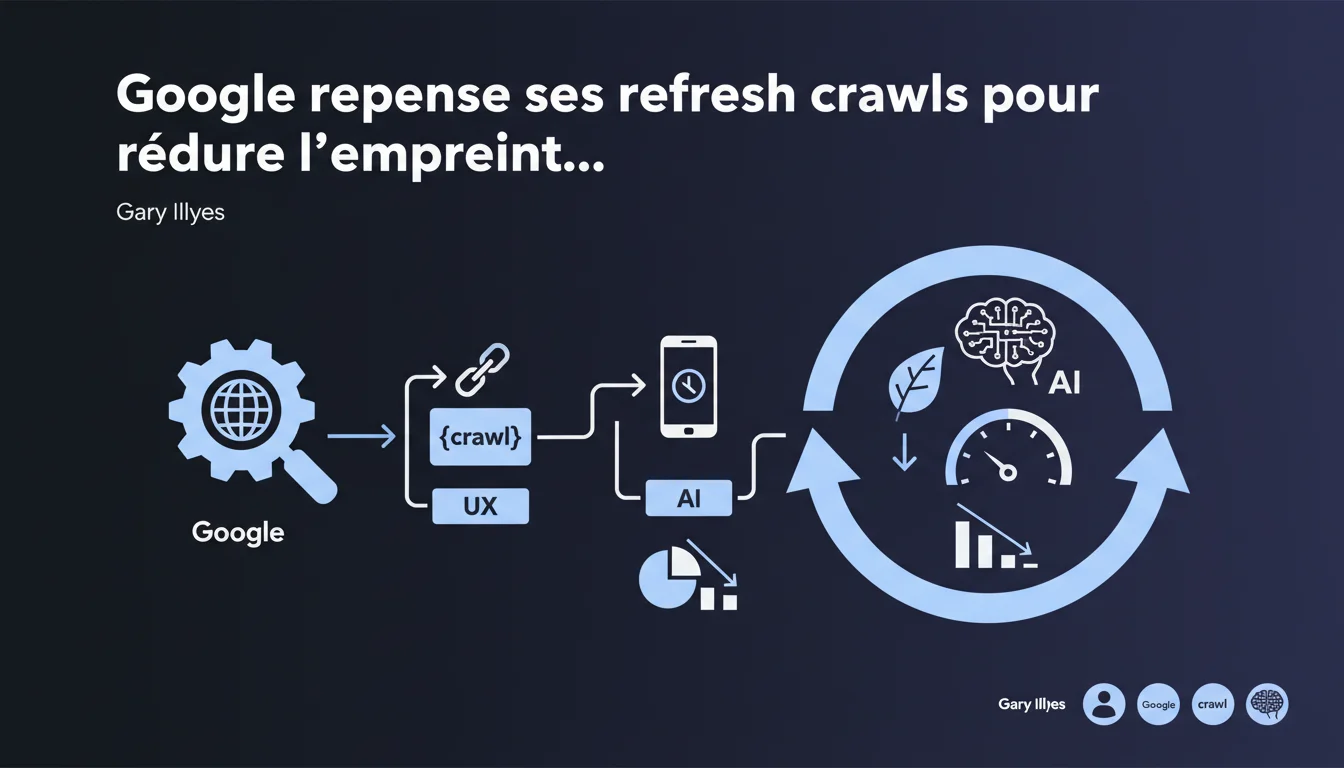

Google optimise la fréquence de ses refresh crawls pour réduire son empreinte carbone. Concrètement, le moteur ajuste ses re-visites en fonction de la fréquence réelle de mise à jour de vos pages. Les sites qui actualisent peu leur contenu pourraient voir leurs crawls espacés.

Ce qu'il faut comprendre

Que sont exactement les refresh crawls ?

Les refresh crawls désignent les passages répétés de Googlebot sur des URLs déjà découvertes et indexées. Contrairement au crawl initial qui découvre une nouvelle page, le refresh crawl vérifie si son contenu a changé.

Cette distinction est capitale : Google ne parle pas ici de réduire la découverte de nouvelles pages, mais bien de rationaliser les re-visites sur des URLs connues. L'algorithme tente de prédire quand une page sera modifiée pour éviter de crawler inutilement du contenu stable.

Pourquoi cette optimisation maintenant ?

La justification officielle est environnementale : réduire l'empreinte carbone liée aux infrastructures de crawl. Google ne cache pas que ses datacenters consomment énormément d'énergie.

Mais soyons honnêtes — cette démarche sert aussi les intérêts économiques du moteur. Moins crawler signifie moins de ressources mobilisées, moins de coûts. L'écologie devient ici un argument commode pour justifier une optimisation qui arrange Google sur plusieurs tableaux.

Comment Google estime-t-il la fréquence de mise à jour ?

Google analyse l'historique des modifications de chaque URL : si une page change tous les jours, elle sera crawlée fréquemment. Si elle reste stable pendant des mois, les visites s'espaceront.

Le moteur utilise probablement des signaux comme les dates de dernière modification, les patterns de changement observés, et peut-être même des indicateurs comportementaux (engagement utilisateur, fraîcheur attendue selon le type de contenu).

- Refresh crawls = re-visites d'URLs déjà connues pour détecter les changements

- L'objectif affiché : réduire l'impact environnemental du crawl

- La méthode : ajuster la fréquence selon les patterns réels de mise à jour

- Impact potentiel : sites statiques crawlés moins souvent

- Aucun chiffre précis sur la réduction de fréquence annoncée

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Depuis plusieurs années, on constate effectivement que Google espace ses crawls sur les contenus peu mis à jour. Ce n'est pas nouveau — la déclaration officialise simplement une pratique déjà en place.

Ce qui intrigue, c'est le timing de cette communication. Pourquoi annoncer publiquement une optimisation technique qui existe déjà partiellement ? Soit Google intensifie cette logique et prépare le terrain, soit l'argument écologique sert à justifier des restrictions budgétaires sur le crawl. [À vérifier] : quelle est la part réelle de réduction de crawl liée à cette initiative ?

Quelles nuances Gary Illyes ne mentionne-t-il pas ?

La déclaration reste floue sur les critères précis. Qu'est-ce qu'une « fréquence de mise à jour réelle » ? Une modification du contenu visible ? Un changement dans le DOM même mineur ? Une mise à jour des métadonnées ?

Et c'est là que ça coince. Si Google détecte qu'un site publie rarement, il crawlera moins — mais comment ce site peut-il signaler qu'il vient justement de publier du nouveau contenu ? Le serpent se mord la queue : moins de crawl = détection plus lente des mises à jour = cercle vicieux pour les sites peu actifs qui tentent de relancer leur dynamique éditoriale.

Autre point absent : l'impact sur les sites à forte saisonnalité. Un e-commerce qui met à jour massivement ses fiches produits en novembre-décembre puis reste stable le reste de l'année — comment Google s'adapte-t-il à ce pattern irrégulier ?

Dans quels cas cette logique pourrait-elle pénaliser injustement ?

Les sites qui migrent ou relancent leur stratégie de contenu après une longue période de stagnation risquent de souffrir. Google aura « appris » que le site ne bouge pas, espacera ses visites, et mettra plus de temps à découvrir les nouveaux contenus.

Les blogs et médias à publication irrégulière sont aussi concernés. Si vous publiez un article par mois mais de qualité exceptionnelle, Google pourrait sous-estimer votre rythme et crawler trop rarement pour capter rapidement vos nouvelles publications.

Impact pratique et recommandations

Que faut-il faire concrètement pour s'adapter ?

Première chose : maintenir une cadence éditoriale cohérente, même modeste. Mieux vaut publier un contenu par semaine régulièrement que 10 articles en janvier puis silence radio jusqu'en juin. Google apprend vos patterns — donnez-lui une régularité exploitable.

Ensuite, exploitez tous les canaux de notification proactive. Le sitemap XML avec des balises <lastmod> et <changefreq> correctement renseignées reste un signal faible mais utile. IndexNow, supporté par Microsoft et Yandex (pas encore officiellement par Google, mais les tests continuent), permet de notifier instantanément une mise à jour.

Enfin, surveillez votre crawl budget via Google Search Console. Si vous constatez une baisse du nombre de pages crawlées par jour alors que vous avez augmenté votre rythme de publication, c'est le signe que Google n'a pas encore ajusté sa fréquence à votre nouvelle dynamique.

Quelles erreurs éviter absolument ?

Ne modifiez pas artificiellement vos pages juste pour « faire croire » à Google qu'elles bougent. Changer la date de publication, ajouter un widget dynamique qui affiche l'heure, ou faire des micro-ajustements invisibles — Google détecte ces manipulations et elles peuvent dégrader votre crédibilité.

Évitez aussi de négliger vos contenus evergreen sous prétexte qu'ils n'évoluent pas. Une page qui reste pertinente doit être actualisée périodiquement avec des données fraîches, des exemples récents, des liens à jour. Sinon, elle sortira progressivement du radar de Google.

Dernier piège : compter uniquement sur le crawl organique. Si votre site dépend d'une indexation rapide (actualités, e-commerce avec stocks volatils), vous devez activer des mécanismes de push actif vers Google, pas simplement attendre que Googlebot passe.

Comment vérifier que votre site reste bien crawlé ?

Analysez les statistiques d'exploration dans Google Search Console. Regardez l'évolution du nombre de pages crawlées par jour sur les 90 derniers jours. Une chute progressive alors que vous publiez régulièrement ? Problème.

Vérifiez aussi le délai entre publication et indexation. Utilisez l'outil d'inspection d'URL pour voir quand Googlebot a visité vos dernières pages. Si ce délai s'allonge anormalement, c'est que Google espace ses refresh crawls sur votre domaine.

Croisez ces données avec votre log serveur. Les logs vous montrent exactement quand et quelles pages Googlebot visite. Comparez avec votre rythme de publication pour détecter des décalages. Si Googlebot visite surtout des vieilles URLs et ignore vos nouveautés, ajustez votre stratégie de maillage interne et de sitemaps.

- Établir une cadence éditoriale régulière et prévisible

- Renseigner correctement les balises

<lastmod>dans le sitemap XML - Tester IndexNow pour notifier proactivement les mises à jour

- Surveiller les statistiques d'exploration dans Search Console

- Actualiser périodiquement les contenus evergreen avec des données fraîches

- Analyser les logs serveur pour identifier les patterns de crawl réels

- Ne jamais manipuler artificiellement les dates ou contenus pour forcer le crawl

- Optimiser le maillage interne pour pousser les nouvelles publications

❓ Questions frequentes

Google va-t-il crawler mon site moins souvent après cette annonce ?

Est-ce que cette optimisation affecte l'indexation des nouvelles pages ?

Comment forcer Google à crawler plus souvent malgré cette logique ?

Les gros sites sont-ils avantagés par cette logique ?

Dois-je modifier artificiellement mes pages pour maintenir le crawl ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.