Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google va-t-il moins crawler votre site au nom de l'écologie ?

- □ Pourquoi Google ignore-t-il la balise lastmod de vos sitemaps ?

- □ IndexNow et Google : faut-il vraiment soumettre vos URLs pour accélérer l'indexation ?

- □ Faut-il vraiment pinger votre sitemap à chaque publication ?

- □ Google est-il vraiment en panne plus souvent qu'avant ?

- □ HTTPS et vitesse de chargement : faut-il vraiment s'en préoccuper pour l'indexation ?

- □ Pourquoi Google a-t-il décidé de refondre entièrement ses Webmaster Guidelines ?

- □ Le cloaking géographique est-il vraiment toléré par Google ?

- □ Le dynamic rendering est-il vraiment sans risque pour Google ?

- □ Les sites multi-locaux sont-ils des doorway pages ou une stratégie SEO légitime ?

- □ Les signaux de Page Experience desktop vont-ils changer la donne pour votre référencement ?

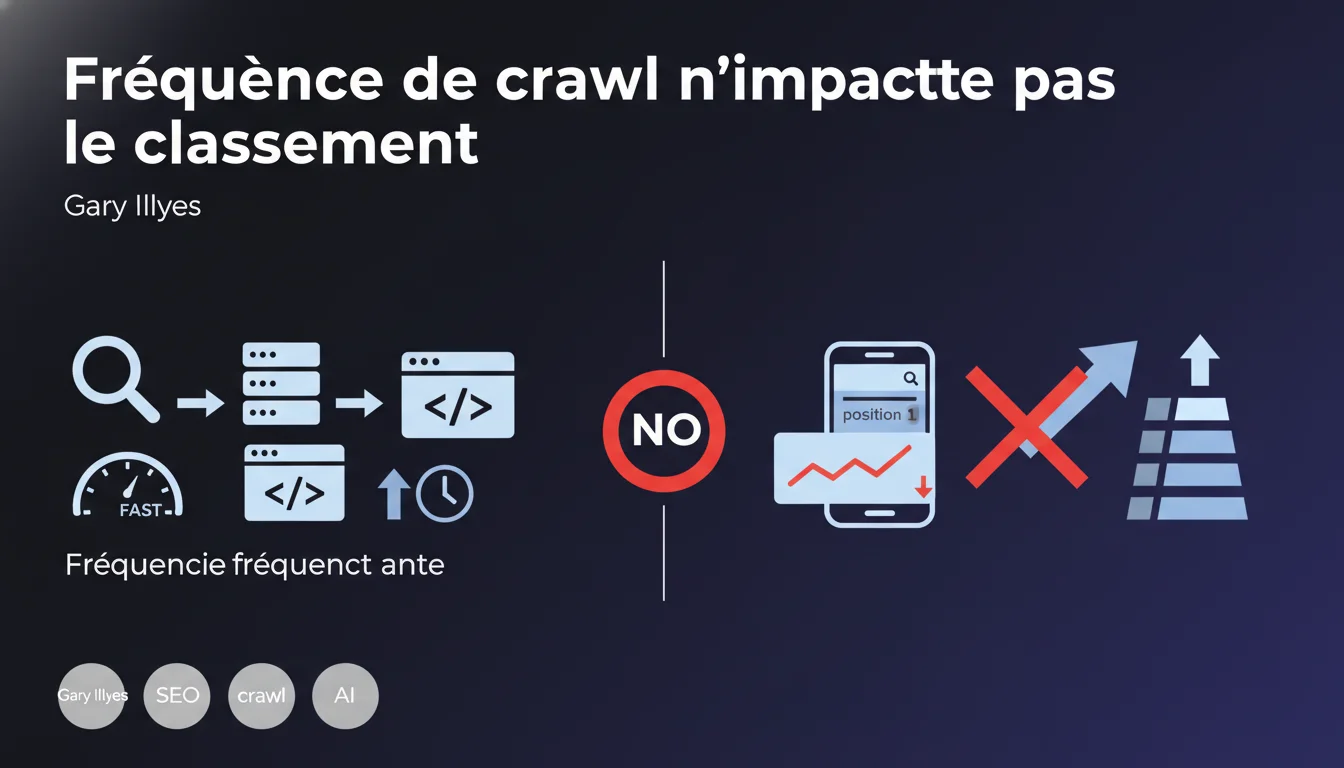

Google affirme que crawler une page plus souvent n'améliore pas son positionnement. Augmenter artificiellement la fréquence de crawl sur du contenu statique est inutile — ce qui compte, c'est la qualité et la fraîcheur réelle du contenu, pas la cadence des visites de Googlebot.

Ce qu'il faut comprendre

Pourquoi cette confusion persiste-t-elle chez les SEO ?

L'idée qu'une page fréquemment crawlée serait mieux classée vient d'une confusion entre corrélation et causalité. Les sites à forte autorité sont effectivement crawlés plus souvent — mais c'est la conséquence de leur performance, pas la cause.

Google ajuste le crawl budget en fonction de signaux comme la popularité, la fraîcheur du contenu, la structure technique. Une page qui change régulièrement attirera naturellement Googlebot plus fréquemment. Inverser la logique — forcer le crawl sans modifier le contenu — ne trompe personne.

Quelle est la différence entre crawl et indexation ?

Crawler une page, c'est simplement la visiter. L'indexer, c'est l'analyser, la stocker et décider de son potentiel de classement. Une page peut être crawlée chaque jour sans jamais être correctement indexée si elle n'apporte aucune valeur différenciée.

Le classement dépend de centaines de signaux : pertinence sémantique, autorité, expérience utilisateur, signaux comportementaux. La fréquence de passage de Googlebot n'en fait pas partie — elle reflète juste l'activité éditoriale réelle du site.

Dans quels cas la fréquence de crawl devient-elle un enjeu ?

Pour les sites avec des milliers de pages dynamiques (e-commerce, petites annonces, actualités), le crawl budget est une ressource limitée. Si Googlebot gaspille ses passages sur des URLs inutiles, il manquera les pages stratégiques.

Mais augmenter artificiellement le crawl sur ces pages ne résout rien. Il faut plutôt optimiser l'allocation du budget : bloquer les URLs parasites, prioriser les contenus frais, nettoyer les boucles de redirection.

- Le crawl fréquent est un effet de la qualité, pas une cause de bon classement

- Forcer le crawl sur du contenu statique ne sert à rien

- Le vrai enjeu est l'optimisation du crawl budget pour les gros sites

- Google ajuste automatiquement le crawl selon l'activité éditoriale réelle

- Crawl ≠ indexation ≠ classement — trois processus distincts

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, complètement. On observe régulièrement des sites avec un crawl budget dérisoire qui se classent excellemment parce que leur contenu est solide. À l'inverse, des sites sur-optimisés pour attirer Googlebot (sitemaps XML actualisés toutes les heures, ping constants) stagnent si le fond n'y est pas.

La nuance — et Gary Illyes ne la développe pas ici — c'est que pour certains secteurs (actualités, bourse, météo), la fraîcheur est un signal de classement. Mais même dans ce cas, ce n'est pas la fréquence de crawl qui compte : c'est la mise à jour réelle du contenu. Si tu republies la même page à l'identique, même crawlée 10 fois par jour, elle ne gagnera rien.

Quelles sont les pratiques inutiles à abandonner ?

Certains SEO s'acharnent à soumettre manuellement des URLs via la Search Console plusieurs fois par jour, espérant un boost. D'autres génèrent des micro-variations de contenu (date de mise à jour, horodatage) juste pour simuler de la fraîcheur. Google n'est pas dupe.

Le piège classique : croire qu'ajouter "Mis à jour le [DATE]" sur une page inchangée va tromper l'algorithme. Googlebot analyse le contenu sémantique réel, pas juste les métadonnées de date. Si rien n'a changé, il le sait.

Dans quels cas la fréquence de crawl pose-t-elle vraiment problème ?

Sur les très gros sites (500k+ pages), un crawl budget mal géré peut bloquer l'indexation de nouvelles pages stratégiques. Googlebot passe son temps sur des facettes inutiles, des archives paginées à l'infini, des URLs de tracking — pendant que les vraies pages produits attendent.

Là, le problème n'est pas de "crawl trop lent", c'est de crawl mal orienté. La solution passe par le robots.txt, les balises canonical, le noindex tactique, la gestion des paramètres dans la Search Console. [À vérifier] : Google ne communique jamais précisément sur les seuils de crawl budget ni sur les critères d'ajustement dynamique — on travaille à l'aveugle sur ce point.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl ?

Arrête de chercher à "forcer" le crawl. Concentre-toi sur ce qui génère un crawl naturel et pertinent : publier du contenu frais et pertinent, obtenir des backlinks vers tes nouvelles pages, maintenir une architecture technique propre.

Pour les gros sites, l'enjeu est d'allouer intelligemment le budget disponible. Identifie les sections qui gaspillent du crawl (logs serveur, Search Console) et bloque-les. Priorise les pages à forte valeur ajoutée dans ton sitemap XML.

Quelles erreurs éviter absolument ?

Ne soumets pas manuellement les mêmes URLs en boucle via la Search Console. Google finit par ignorer les demandes répétitives s'il détecte qu'aucun changement substantiel n'a eu lieu.

Évite les "fake updates" : modifier uniquement la date de publication ou ajouter un paragraphe creux juste pour simuler de la fraîcheur. Google analyse le delta sémantique réel — s'il est nul, l'impact aussi.

Comment vérifier que ton site utilise bien son crawl budget ?

Analyse tes logs serveur : quelles pages Googlebot visite-t-il ? À quelle fréquence ? Compare avec tes pages stratégiques. Si Googlebot passe 80% de son temps sur des URLs inutiles, tu as un problème d'architecture.

Dans la Search Console, section "Statistiques d'exploration", surveille le nombre de pages crawlées par jour et le temps de réponse. Un effondrement du crawl peut signaler un problème technique (serveur lent, erreurs 5xx) — mais une hausse artificielle sans contenu neuf ne servira à rien.

- Audite tes logs serveur pour identifier le crawl gaspillé

- Bloque les sections inutiles via robots.txt ou noindex

- Priorise les pages stratégiques dans ton sitemap XML

- Publie du contenu réellement nouveau pour attirer Googlebot naturellement

- Optimise le temps de réponse serveur pour faciliter le crawl

- Nettoie les redirections en chaîne et les erreurs 404

- Surveille les pics de crawl anormaux (bots malveillants)

❓ Questions frequentes

Soumettre une page via la Search Console accélère-t-il son indexation ?

Faut-il mettre à jour régulièrement une page pour qu'elle soit mieux classée ?

Un sitemap XML fréquemment actualisé booste-t-il le SEO ?

Comment savoir si mon crawl budget est bien utilisé ?

Le nombre de pages crawlées par jour indique-t-il la santé SEO du site ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.