Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ La fréquence de crawl influence-t-elle réellement le classement SEO ?

- □ Google va-t-il moins crawler votre site au nom de l'écologie ?

- □ Pourquoi Google ignore-t-il la balise lastmod de vos sitemaps ?

- □ IndexNow et Google : faut-il vraiment soumettre vos URLs pour accélérer l'indexation ?

- □ Faut-il vraiment pinger votre sitemap à chaque publication ?

- □ Google est-il vraiment en panne plus souvent qu'avant ?

- □ HTTPS et vitesse de chargement : faut-il vraiment s'en préoccuper pour l'indexation ?

- □ Pourquoi Google a-t-il décidé de refondre entièrement ses Webmaster Guidelines ?

- □ Le cloaking géographique est-il vraiment toléré par Google ?

- □ Les sites multi-locaux sont-ils des doorway pages ou une stratégie SEO légitime ?

- □ Les signaux de Page Experience desktop vont-ils changer la donne pour votre référencement ?

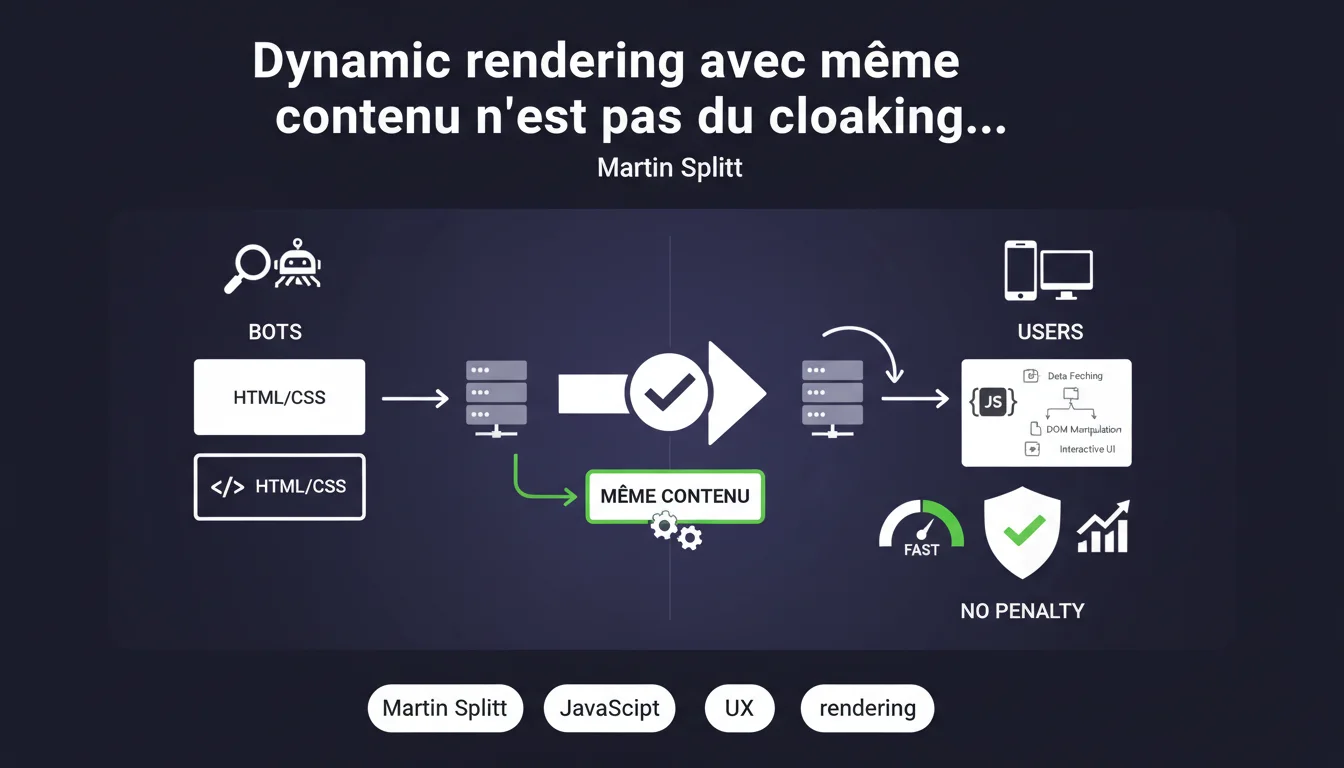

Google confirme que le dynamic rendering — servir du HTML statique aux bots et du JavaScript dynamique aux utilisateurs — n'est pas considéré comme du cloaking manipulateur tant que le contenu reste identique. Cette pratique ne sera pas pénalisée, ce qui clarifie une zone grise pour les sites JavaScript-heavy qui peinent à être crawlés efficacement.

Ce qu'il faut comprendre

Pourquoi cette clarification sur le dynamic rendering arrive-t-elle maintenant ?

Le dynamic rendering s'est imposé comme solution de contournement pour les sites JavaScript-heavy qui ne sont pas correctement indexés par Googlebot. Pendant des années, cette technique a circulé dans les limbes : officiellement tolérée, mais jamais totalement validée.

La crainte ? Que Google y voie une forme de cloaking — cette pratique historiquement sanctionnée qui consiste à servir du contenu différent aux bots et aux utilisateurs pour manipuler le classement. Splitt tranche : si le contenu est identique, c'est OK.

Qu'est-ce que le dynamic rendering, concrètement ?

On parle ici d'une architecture où le serveur détecte le user-agent du visiteur. Si c'est Googlebot, il sert une version pré-rendue du HTML (via Puppeteer, Rendertron ou un CDN moderne). Si c'est un utilisateur classique, il envoie l'application JavaScript qui se charge côté client.

L'objectif : contourner les limites du crawl budget et du JavaScript rendering de Google, qui reste imparfait malgré les progrès. Concrètement, cette approche permet d'accélérer l'indexation sans sacrifier l'expérience utilisateur.

Quelle est la limite entre dynamic rendering et cloaking manipulateur ?

La frontière est simple sur le papier : le contenu doit être identique. Pas de texte caché pour les bots, pas de liens supplémentaires invisibles aux utilisateurs, pas de données structurées uniquement servies à Googlebot.

Dans les faits, cette équivalence peut être plus difficile à maintenir qu'on ne le pense. Une seule divergence — un titre qui change, un paragraphe qui diffère — et vous basculez dans le cloaking. Google ne donne aucune tolérance chiffrée ici.

- Le dynamic rendering est autorisé si le contenu rendu est identique pour les bots et les utilisateurs

- Cette pratique ne constitue pas du cloaking manipulateur et ne sera pas pénalisée

- L'équivalence stricte du contenu est le seul critère de validation — aucune marge d'erreur tolérée

- Le dynamic rendering reste une solution de contournement, pas une architecture optimale à long terme

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui et non. Sur des milliers de sites audités, ceux qui utilisent le dynamic rendering sans divergence de contenu ne subissent effectivement aucune pénalité manuelle visible. Par contre, les cas de cloaking involontaire sont fréquents : un composant React qui ne s'affiche pas en SSR, une balise canonical différente, un bloc de texte généré côté client qui manque dans la version bot.

Google détecte ces écarts, mais la sanction n'est pas toujours frontale. Parfois, c'est une perte de positionnement silencieuse, un crawl qui ralentit, ou pire : une indexation partielle sans alerte Search Console. [À vérifier] : Google ne communique jamais sur les seuils de tolérance exacts.

Dans quels cas cette règle ne s'applique-t-elle plus ?

Dès qu'il y a manipulation. Si vous servez aux bots un contenu enrichi avec des mots-clés supplémentaires, des liens cachés, ou des données structurées absentes de la version utilisateur, vous sortez du cadre. Splitt parle de contenu identique, mais ne précise pas si cela inclut les microformats, les balises meta, ou les attributs alt.

Autre zone grise : les sites qui ajustent dynamiquement le contenu en fonction de la géolocalisation ou du device. Si Googlebot voit une version desktop US et que vos utilisateurs français voient du mobile localisé, êtes-vous dans le cloaking ? La déclaration ne tranche pas.

Quelles nuances faut-il apporter à cette position officielle ?

Splitt ne parle que de la non-pénalisation. Il ne dit pas que le dynamic rendering améliore vos performances SEO. En pratique, un site en SSR natif aura toujours un avantage : meilleur contrôle du rendering, moins de risques de divergence, Core Web Vitals optimisés.

L'autre point non adressé : la charge serveur. Pré-rendre chaque page pour Googlebot peut vite devenir coûteux en ressources, surtout sur des sites à forte volumétrie. Cette dette technique n'est jamais mentionnée dans les communications Google.

Impact pratique et recommandations

Que faut-il faire concrètement si vous utilisez déjà le dynamic rendering ?

Première étape : valider l'équivalence stricte entre la version bot et la version utilisateur. Utilisez l'outil d'inspection d'URL de Search Console pour comparer le HTML rendu avec ce que voit un navigateur classique. Ne vous fiez pas à un simple diff visuel — vérifiez le DOM, les balises meta, les données structurées.

Ensuite, automatisez cette vérification. Mettez en place des tests de non-régression qui comparent régulièrement les deux versions. Un déploiement qui introduit une divergence peut passer inaperçu pendant des semaines avant de provoquer une chute de trafic.

Quelles erreurs éviter pour ne pas basculer dans le cloaking ?

Ne jouez pas avec les zones grises. N'ajoutez jamais de contenu invisible aux utilisateurs, même si c'est « pour aider Google à mieux comprendre ». Pas de texte blanc sur fond blanc, pas de blocs CSS display:none uniquement pour les bots, pas de liens cachés dans le footer.

Autre erreur classique : servir une version bot « sur-optimisée » avec des titres H1 bourrés de mots-clés alors que la version utilisateur privilégie l'expérience. Google le détecte, et même sans action manuelle, l'algorithme peut déprioriser vos pages.

Comment vérifier que votre implémentation est conforme ?

Comparez systématiquement le rendu Search Console avec un crawl Screaming Frog ou OnCrawl en mode « utilisateur standard ». Les écarts doivent être nuls sur les éléments structurants : titres, meta descriptions, contenu textuel, maillage interne, données structurées.

Si vous détectez des divergences, deux options : corriger l'implémentation dynamic rendering pour garantir l'équivalence, ou migrer vers une architecture SSR/SSG plus fiable. La seconde option est souvent préférable à moyen terme.

- Comparer régulièrement le rendu Googlebot (Search Console) avec le rendu utilisateur (navigateur classique)

- Automatiser des tests de non-régression pour détecter toute divergence après chaque déploiement

- Ne jamais ajouter de contenu invisible aux utilisateurs, même « pour aider Google »

- Vérifier l'équivalence stricte des données structurées, meta, titres, maillage interne

- Considérer une migration vers SSR/SSG si le dynamic rendering devient trop complexe à maintenir

❓ Questions frequentes

Le dynamic rendering est-il recommandé par Google comme solution SEO ?

Comment savoir si mon site fait du cloaking involontaire avec le dynamic rendering ?

Puis-je servir une version mobile aux utilisateurs et une version desktop à Googlebot ?

Les données structurées doivent-elles aussi être identiques entre les deux versions ?

Le dynamic rendering affecte-t-il les Core Web Vitals ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.