Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le Dynamic Rendering et pourquoi cette mise à jour ?

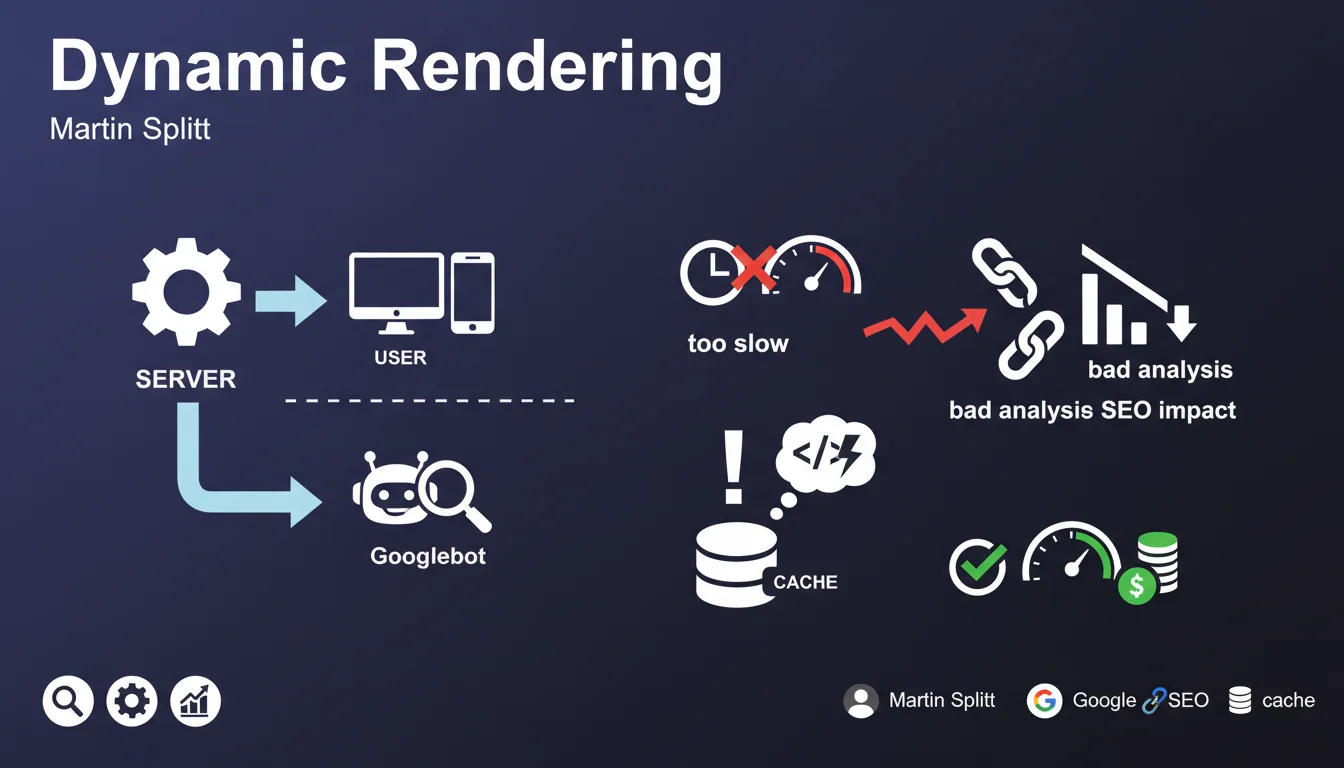

Le Dynamic Rendering est une technique qui consiste à servir du contenu prérendu statique aux robots d'exploration (comme Googlebot) tout en conservant une version JavaScript complète pour les utilisateurs. Cette approche a longtemps été considérée comme un compromis acceptable pour les sites JavaScript riches.

Google clarifie désormais sa position : cette solution n'est qu'un palliatif temporaire et non une architecture recommandée à long terme. La firme encourage les développeurs à privilégier des solutions natives plus pérennes.

Pourquoi Google décourage-t-il cette approche maintenant ?

L'évolution des capacités de Googlebot à traiter JavaScript rend le Dynamic Rendering de moins en moins nécessaire. Le moteur peut désormais indexer efficacement du contenu généré côté client dans la plupart des cas.

Maintenir deux versions distinctes d'un site crée également une dette technique et des risques de divergence entre ce que voient les utilisateurs et les moteurs de recherche, ce qui peut être interprété comme du cloaking involontaire.

- Googlebot gère mieux JavaScript qu'auparavant, réduisant le besoin de contournements

- Le Dynamic Rendering génère une complexité technique et des coûts de maintenance élevés

- Risque de désynchronisation entre versions utilisateur et bot

- Google privilégie le rendu côté serveur (SSR) ou la génération statique (SSG)

Quelles sont les alternatives recommandées par Google ?

Google oriente clairement vers des solutions d'architecture modernes : le Server-Side Rendering (SSR), la Static Site Generation (SSG) ou l'approche hybride. Ces méthodes génèrent du HTML complet dès le serveur.

Les frameworks modernes comme Next.js, Nuxt.js ou Angular Universal facilitent ces implémentations. L'objectif est d'envoyer du contenu directement exploitable sans dépendre d'une couche intermédiaire de rendu dynamique.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Depuis 2019-2020, on observe une amélioration constante du traitement JavaScript par Googlebot. Les tests montrent que les sites bien conçus en JavaScript pur s'indexent correctement, même sans Dynamic Rendering.

Cependant, la réalité du terrain révèle des nuances importantes. Les sites très lourds, avec des dépendances complexes ou des temps de chargement longs, rencontrent encore des problèmes d'indexation. Le Dynamic Rendering reste parfois la seule option viable à court terme pour certains projets legacy.

Dans quels cas le Dynamic Rendering reste-t-il encore justifié temporairement ?

Pour les applications monolithiques complexes développées en React, Vue ou Angular sans SSR, une refonte complète peut nécessiter 6 à 18 mois. Le Dynamic Rendering permet de maintenir la visibilité pendant cette transition.

Les sites avec des contraintes techniques lourdes (systèmes legacy, limitations d'infrastructure, budgets serrés) peuvent également justifier son maintien temporaire. L'essentiel est d'avoir un plan de migration clair.

Quels risques réels encourez-vous en conservant le Dynamic Rendering ?

Le risque principal n'est pas une pénalité immédiate de Google, mais une obsolescence progressive. Google pourrait à terme considérer cette technique comme du cloaking si les versions divergent trop.

Plus concrètement, vous accumulez une dette technique croissante : coûts de maintenance élevés, difficulté à recruter des développeurs familiers avec cette approche, et performances potentiellement dégradées par rapport aux solutions modernes.

Impact pratique et recommandations

Que faut-il faire concrètement si votre site utilise le Dynamic Rendering ?

Commencez par un audit technique complet pour évaluer la faisabilité d'une migration vers SSR, SSG ou une solution hybride. Testez l'indexation actuelle de votre contenu JavaScript sans Dynamic Rendering sur des pages non critiques.

Établissez un plan de migration progressif sur 6 à 18 mois selon la complexité de votre site. Priorisez les sections critiques pour le SEO (pages catégories, fiches produits, landing pages stratégiques).

- Réaliser un audit d'indexation JavaScript via Search Console et des tests de rendu

- Évaluer les frameworks modernes compatibles avec votre stack technique (Next.js, Nuxt, etc.)

- Tester le SSR/SSG sur un sous-ensemble de pages non critiques d'abord

- Mesurer l'impact sur les Core Web Vitals et les métriques de crawl

- Former les équipes de développement aux nouvelles architectures

- Documenter les différences de comportement entre anciennes et nouvelles versions

Quelles erreurs éviter lors de la transition ?

Ne supprimez jamais le Dynamic Rendering sans validation préalable que Googlebot indexe correctement votre contenu JavaScript. Utilisez l'outil d'inspection d'URL de Search Console pour vérifier le rendu réel.

Évitez également de migrer tout votre site d'un coup. Une approche progressive par sections permet d'identifier et corriger les problèmes sans impacter l'ensemble de votre visibilité organique.

Comment vérifier que votre nouvelle architecture est SEO-friendly ?

Utilisez des outils comme Screaming Frog en mode JavaScript, Oncrawl ou Botify pour comparer le contenu visible avec et sans JS activé. Le contenu critique doit être identique dans les deux cas.

Surveillez vos métriques Search Console pendant au moins 3 mois post-migration : taux d'indexation, temps de crawl, couverture des pages, et performances de positionnement. Tout écart significatif nécessite une investigation immédiate.

💬 Commentaires (0)

Soyez le premier à commenter.