Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ E-A-T n'est-il vraiment pas un facteur de classement Google ?

- □ Avoir plusieurs URLs pour un même contenu entraîne-t-il vraiment une pénalité Google ?

- □ Faut-il adopter une démarche expérimentale pour optimiser son référencement naturel ?

- □ Faut-il avouer qu'on ne sait pas tout en SEO ?

- □ Faut-il vraiment éliminer toutes les chaînes de redirections pour préserver son crawl budget ?

- □ La matrice impact/effort est-elle vraiment la clé pour prioriser vos tâches SEO ?

- □ Faut-il imposer des solutions techniques aux développeurs ou simplement exposer les problèmes SEO ?

- □ Faut-il vraiment distinguer les redirections 301 et 302 pour le SEO ?

- □ Pourquoi développer du contenu invisible dans les moteurs de recherche revient-il à travailler pour rien ?

- □ Google déploie-t-il vraiment des mises à jour algorithme chaque minute ?

- □ Faut-il vraiment intégrer le SEO dès la phase de développement pour éviter les corrections coûteuses ?

- □ Les pages SEO sans valeur utilisateur peuvent-elles encore se classer dans Google ?

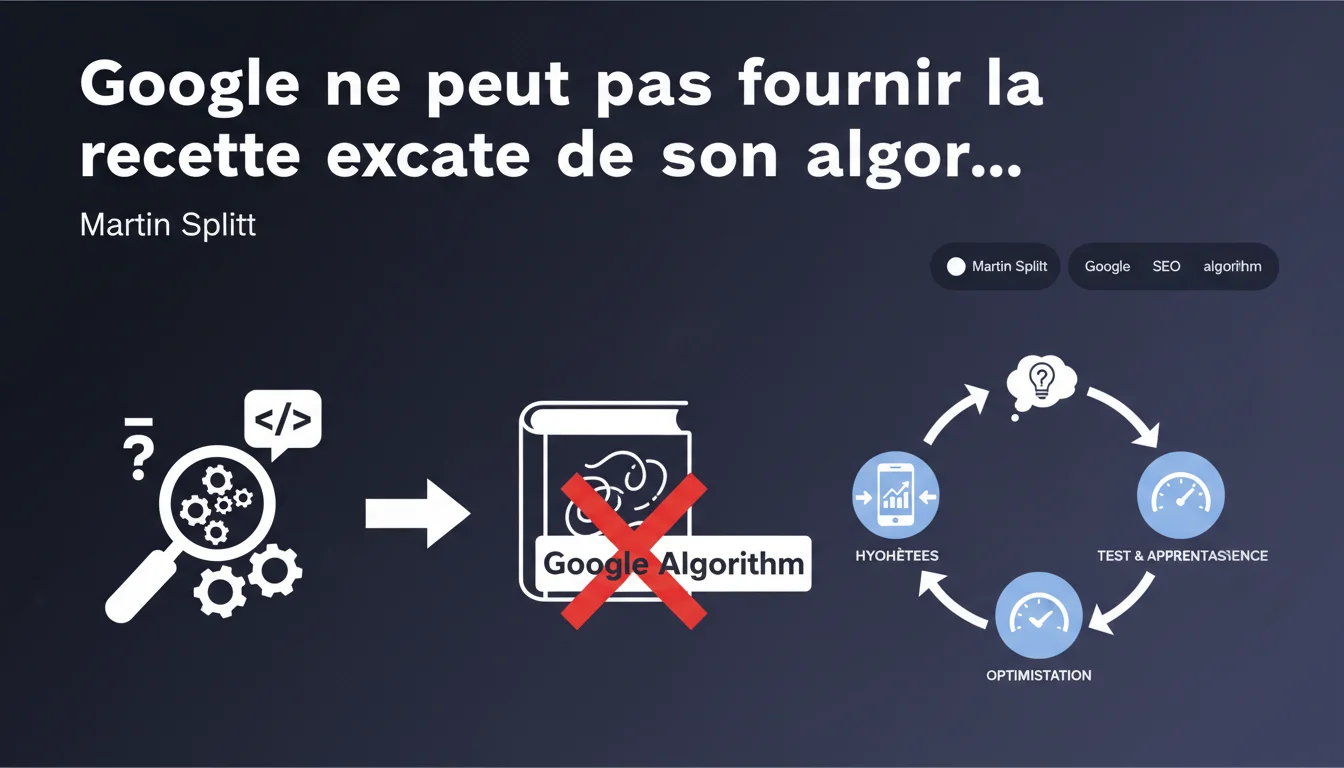

Google confirme officiellement qu'il ne partagera jamais la formule exacte de son algorithme de classement. Les praticiens SEO doivent donc construire leur stratégie sur des hypothèses validées par l'expérimentation terrain, en adoptant une méthodologie rigoureuse de test & learn.

Ce qu'il faut comprendre

Google dissimule-t-il vraiment l'intégralité de son algorithme ?

La réponse est oui, sans ambiguïté. Martin Splitt et Jenn Mathews l'ont réaffirmé : Google ne communiquera jamais l'intégralité des facteurs de classement, ni leur pondération exacte. Cette opacité n'est pas nouvelle, mais la confirmation officielle coupe court aux illusions.

Contrairement aux brevets publics ou aux guidelines fragmentaires, la mécanique interne reste un secret industriel. Les algorithmes de machine learning évoluent continuellement, et même certains ingénieurs Google ne maîtrisent pas tous les rouages du système.

Pourquoi cette opacité est-elle maintenue ?

Trois raisons principales. D'abord, la protection concurrentielle — dévoiler l'algorithme faciliterait la manipulation des résultats. Ensuite, la complexité technique : avec des milliers de signaux interagissant via du ML, il n'existe pas de « formule » linéaire à partager.

Enfin, une stratégie de contrôle. En restant flou, Google garde la main sur l'évolution de son écosystème et décourage les tactiques de sur-optimisation.

- Google ne révélera jamais la pondération exacte de chaque signal de classement

- Les algorithmes de ML créent des interactions non-linéaires difficiles à résumer

- Cette opacité protège contre les manipulations industrielles des SERP

- Même en interne, personne ne détient la vision exhaustive du système

Quelle marge de manœuvre reste-t-il aux SEO ?

L'approche empirique devient incontournable. Les professionnels doivent formuler des hypothèses, les tester sur des corpus de pages significatifs, mesurer les résultats, et ajuster. C'est une démarche scientifique appliquée au référencement.

Google fournit tout de même des indications directionnelles : Search Quality Guidelines, Core Updates annoncés, documentation Search Central. Mais entre ces grandes lignes et la réalité opérationnelle, il y a un fossé que seule l'expérimentation comble.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Sur le terrain, on constate depuis des années que deux sites peuvent appliquer les mêmes « bonnes pratiques » et obtenir des résultats divergents. Les facteurs contextuels — autorité du domaine, historique, verticale, intention utilisateur — créent des combinaisons uniques.

Les corrélations observées dans les études SEO ne sont jamais des causalités directes. Un site peut ranker malgré un temps de chargement médiocre si son contenu est jugé exceptionnellement pertinent. Il n'y a pas de recette universelle, et Google l'assume enfin publiquement.

Quelles nuances faut-il apporter à cette position ?

Google communique quand même sur certains signaux confirmés : backlinks, HTTPS, E-E-A-T, Core Web Vitals, mobile-first indexing. Ce ne sont pas des secrets. Mais leur poids relatif et leurs interactions restent opaques. [À vérifier] : la part réelle de CWV dans le ranking global n'a jamais été chiffrée officiellement.

Autre nuance — cette opacité favorise parfois la désinformation. Des « experts » vendent des formules magiques basées sur des corrélations douteuses. L'absence de transparence totale ouvre un espace pour les charlatans, ce que Google ne mentionne jamais dans ses communications.

Dans quels cas cette règle connaît-elle des exceptions ?

Lors des Core Updates majeurs, Google fournit parfois des indications post-déploiement. Par exemple, l'accent mis sur l'E-E-A-T dans les contenus YMYL. Ce ne sont pas des formules, mais des orientations stratégiques suffisamment précises pour guider l'optimisation.

De même, certains pénalités algorithmiques sont documentées : duplicate content, cloaking, link schemes. Dans ces cas, Google est explicite sur ce qu'il sanctionne, même si les seuils de déclenchement restent secrets.

Impact pratique et recommandations

Que faut-il faire concrètement face à cette opacité ?

Adopter une méthodologie expérimentale rigoureuse. Identifie des segments de pages homogènes, formule une hypothèse d'optimisation, applique-la sur un échantillon contrôlé, mesure l'impact sur 4-8 semaines, puis déploie ou abandonne.

Investis dans des outils d'analytics avancés capables de corréler les modifications on-page avec les fluctuations de trafic organique. Google Search Console, combiné à un tracker de positions et un outil de crawl, forme le socle minimal.

Ne mise jamais tout sur un seul levier. La diversification — contenu expert, UX irréprochable, netlinking qualitatif, technique solide — réduit le risque lié à l'incertitude algorithmique.

Quelles erreurs éviter dans ce contexte ?

Ne cherche pas la formule magique. Les « 200 facteurs de ranking » listés dans certains guides sont souvent des reconstructions spéculatives. Concentre-toi sur les signaux confirmés et sur l'expérience utilisateur globale.

Évite de sur-interpréter les déclarations officielles. Quand Google dit « le contenu de qualité est important », ça ne définit pas ce qu'est la qualité. Teste tes propres critères plutôt que de singer les interprétations d'autrui.

Méfie-toi des corrélations sans causalité. Ce n'est pas parce que 80% des pages top 3 ont un certain nombre de mots que ce volume génère le ranking. Le contexte prime toujours.

Comment structurer une approche SEO efficace sans connaître l'algorithme ?

Pars des fondamentaux confirmés : architecture technique propre, contenus répondant précisément à l'intention de recherche, signaux d'autorité cohérents, expérience utilisateur fluide. Ces piliers fonctionnent quel que soit le poids exact des signaux.

Ensuite, itère par micro-optimisations testables. Change un élément à la fois, mesure, ajuste. Cette approche incrémentale limite les risques et permet d'isoler les leviers efficaces dans ton contexte spécifique.

- Mettre en place un environnement de test avec segments de pages contrôlés

- Documenter chaque hypothèse et chaque modification dans un registre d'expérimentations

- Utiliser GSC, un tracker de positions et un crawler pour mesurer l'impact

- Ne jamais déployer une optimisation globale sans validation sur échantillon réduit

- Consulter régulièrement la documentation officielle Google Search Central pour capter les évolutions

- Diversifier les leviers SEO pour réduire la dépendance à un signal unique

- Former l'équipe à une culture data-driven plutôt qu'à l'application mécanique de recettes

❓ Questions frequentes

Google divulguera-t-il un jour la formule complète de son algorithme ?

Comment optimiser mon site sans connaître l'algorithme précis ?

Les 200 facteurs de ranking listés dans certains guides sont-ils fiables ?

Peut-on encore faire du SEO efficacement malgré cette opacité ?

Pourquoi Google garde-t-il son algorithme secret ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.