Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Le système de contenu utile de Google peut-il vraiment distinguer l'intention éditoriale ?

- □ Faut-il vraiment lire les guidelines Google pour comprendre leurs critères de qualité ?

- □ Le robots.txt suffit-il vraiment à contrôler le crawl de zones spécifiques de votre site ?

- □ Comment Google Extended permet-il de bloquer l'indexation pour Bard et Vertex AI ?

- □ Le robots.txt est-il vraiment respecté par tous les crawlers ?

- □ Les robots meta tags permettent-ils vraiment un contrôle précis de l'indexation ?

- □ Les CMS intègrent-ils vraiment les nouvelles options SEO aussi rapidement que Google le prétend ?

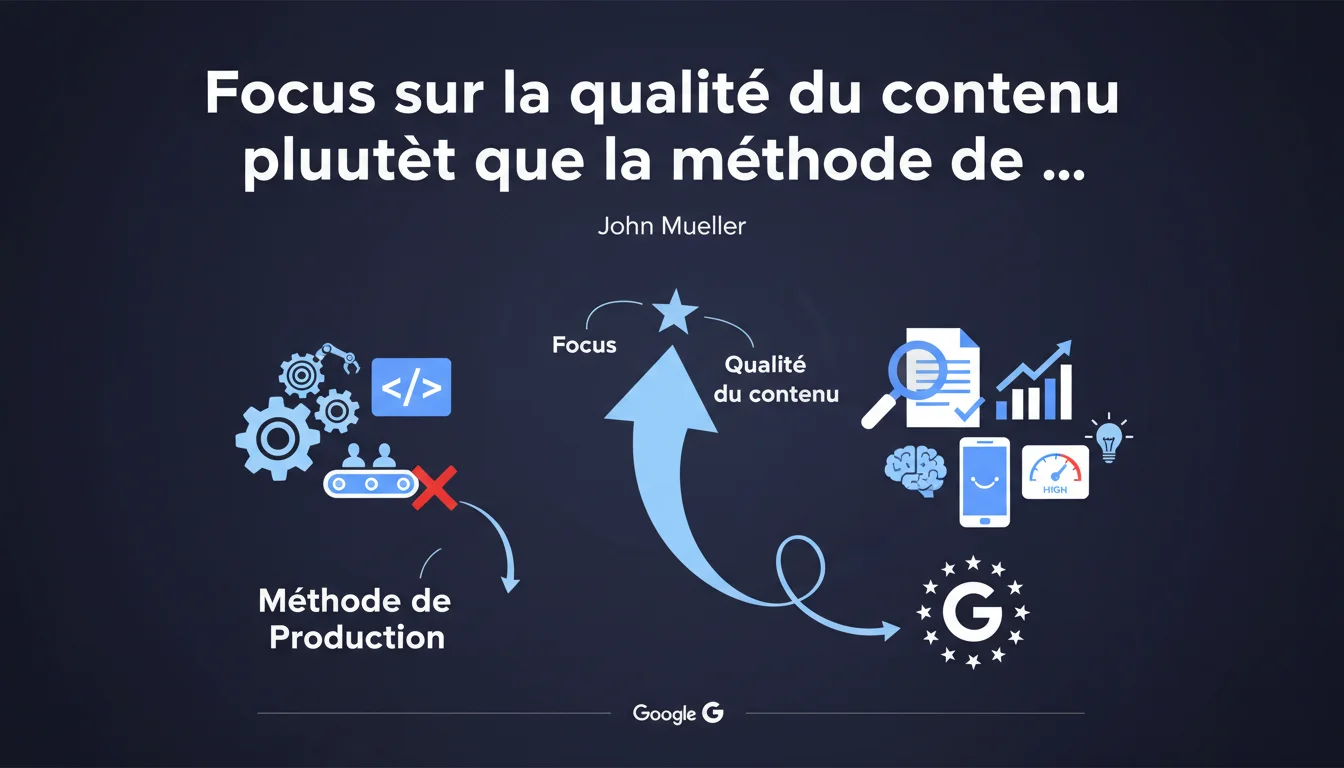

Google affirme se concentrer uniquement sur la qualité du contenu, pas sur sa méthode de production — y compris pour l'IA générative. Cette position officielle valide l'usage d'outils automatisés tant que le résultat final respecte les critères de qualité E-E-A-T. Concrètement : peu importe comment vous produisez, seul le résultat compte.

Ce qu'il faut comprendre

Google abandonne-t-il vraiment tout contrôle sur la méthode de production ?

Cette déclaration marque un tournant stratégique dans la communication de Google. Historiquement, le moteur sanctionnait le contenu automatisé de mauvaise qualité via des filtres comme Panda. Aujourd'hui, Mueller affirme que la méthode importe peu — seul le résultat final compte.

Ce changement de discours coïncide avec l'explosion des outils d'IA générative. Google se positionne ainsi : si votre contenu IA respecte les standards de qualité, il sera traité comme n'importe quel autre contenu. Pas de pénalité automatique, pas de bonus non plus.

Quels sont les critères de qualité que Google évalue réellement ?

Mueller ne détaille pas les métriques précises — et c'est là que ça coince. Google évoque constamment E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) sans jamais donner de seuils mesurables. On reste dans le flou artistique.

En pratique, les signaux incluent probablement : profondeur de l'analyse, citations de sources fiables, absence de généralités creuses, apport de valeur unique. Mais comment Google détecte-t-il automatiquement ces éléments ? Mystère. Les Quality Raters évaluent manuellement, mais à quelle échelle ?

Cette philosophie s'applique-t-elle uniformément à tous les secteurs ?

Non. Et Mueller ne le précise pas, ce qui pose problème. Les secteurs YMYL (Your Money Your Life) — santé, finance, juridique — subissent un filtrage bien plus strict. Un contenu médical généré par IA sans validation par des professionnels certifiés sera probablement déclassé, peu importe sa « qualité » apparente.

Les requêtes informationnelles génériques ? Là, effectivement, Google semble plus permissif. Mais affirmer que la méthode ne compte jamais est une simplification dangereuse pour les praticiens.

- La qualité prime officiellement sur la méthode de production selon Google

- Le contenu IA n'est ni pénalisé ni favorisé automatiquement

- E-E-A-T reste le framework de référence, mais ses critères d'évaluation restent opaques

- Les secteurs YMYL subissent un examen bien plus strict malgré cette déclaration générique

- Aucune métrique quantifiable n'est fournie pour mesurer cette « qualité »

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Partiellement. On observe effectivement que du contenu IA bien travaillé performe correctement sur des requêtes informationnelles longue traîne. Pas de pénalité systématique. Mais affirmer que la méthode ne compte jamais ? [À vérifier] — plusieurs cas documentés montrent des chutes de trafic sur des sites ayant massivement basculé vers l'IA générative sans édition humaine.

Le problème : Mueller ne distingue pas entre « contenu 100% automatisé publié tel quel » et « contenu assisté par IA puis retravaillé par un expert ». Ces deux approches produisent des résultats radicalement différents en termes de profondeur et d'originalité. Google peut-il réellement les évaluer de la même façon ? J'en doute.

Quelles nuances cette position officielle omet-elle ?

Première nuance : la détectabilité. Google affirme ne pas pénaliser l'IA, mais ses algorithmes peuvent-ils identifier les patterns linguistiques typiques des LLM ? Probablement. Et si ces patterns corrèlent avec des signaux de faible qualité — manque de sources, généralités, structure prévisible — le contenu sera déclassé. Pas parce qu'il est IA, mais parce qu'il est médiocre.

Deuxième nuance : la scalabilité. Un site qui publie 500 articles IA par mois envoie des signaux de comportement différents d'un site qui publie 10 articles travaillés. Google analyse aussi les patterns de publication, la cohérence thématique, la diversité des formats. Ignorer ces dimensions est naïf.

Dans quels cas cette règle ne s'applique-t-elle clairement pas ?

Premier cas : les secteurs YMYL. Un contenu santé généré par IA sans signatures d'experts médicaux sera systématiquement déclassé, peu importe sa qualité rédactionnelle. Google vérifie l'autorité de l'auteur, les affiliations institutionnelles, les certifications. La méthode de production devient secondaire face à ces critères d'autorité.

Deuxième cas : le contenu dupliqué ou quasi-dupliqué. Si votre IA reformule des sources existantes sans apport original, Google le détectera. Là encore, ce n'est pas l'IA qui pose problème, mais l'absence de valeur ajoutée. Sauf que l'IA facilite justement ce type de production à grande échelle — ce que Mueller ne mentionne pas.

Impact pratique et recommandations

Que faut-il faire concrètement si vous utilisez l'IA pour produire du contenu ?

Éditez systématiquement le contenu généré. Un article IA brut contient presque toujours des généralités, des imprécisions, voire des erreurs factuelles. Ajoutez des exemples concrets, des données chiffrées, des études de cas. Injectez de l'expertise réelle.

Vérifiez la profondeur vs concurrence. Si les top 10 traitent un sujet en 2000 mots avec infographies et vidéos, votre article IA de 800 mots ne tiendra pas. La qualité est relative à l'environnement concurrentiel — Google compare, il ne note pas dans l'absolu.

Intégrez des signaux d'autorité : signatures d'auteurs identifiables, bios complètes, liens vers profils LinkedIn ou sites personnels. Google évalue de plus en plus l'entité « auteur » comme facteur de confiance, surtout en YMYL.

Quelles erreurs éviter absolument avec du contenu assisté par IA ?

Ne publiez jamais de contenu IA sans fact-checking rigoureux. Les LLM hallucinent régulièrement des statistiques, des dates, des citations. Une seule erreur factuelle flagrante peut détruire la crédibilité de tout le site aux yeux des Quality Raters.

Évitez la publication massive et simultanée. Un site qui passe de 10 à 200 articles en un mois envoie un signal d'alarme. Échelonnez, variez les formats, alternez contenu IA et contenu 100% humain. Maintenez une cohérence de rythme éditorial.

Ne négligez pas le maillage interne et la structure. Le contenu IA produit souvent des silos thématiques incohérents. Google évalue la cohérence globale du site — un amas d'articles déconnectés performera mal même si chaque article pris isolément est « correct ».

Comment mesurer si votre contenu IA respecte les standards de qualité ?

Comparez vos métriques de temps passé sur la page et taux de rebond avant/après migration vers l'IA. Si le temps chute significativement, votre contenu n'engage pas — peu importe ce que Google en pense officiellement.

Analysez les featured snippets et positions zéro. Si votre contenu IA ne décroche jamais ces placements alors que votre contenu humain précédent y parvenait, c'est un signal clair de dégradation qualitative perçue par Google.

Surveillez les Core Web Vitals et performances techniques. Le contenu IA massif s'accompagne souvent d'une négligence technique — pages plus lourdes, images non optimisées. Google évalue la qualité globale de l'expérience, pas seulement le texte.

- Éditer systématiquement tout contenu IA avant publication — jamais de brut

- Fact-checker chaque donnée chiffrée, citation ou référence technique

- Ajouter des exemples concrets, études de cas et expertise originale

- Intégrer des signaux d'autorité : auteurs identifiables avec bios complètes

- Analyser la profondeur vs concurrence sur chaque requête ciblée

- Échelonner les publications pour éviter les pics suspects de volume

- Vérifier la cohérence du maillage interne et de la structure globale

- Monitorer temps passé, taux de rebond et décrochage de featured snippets

❓ Questions frequentes

Google pénalise-t-il automatiquement le contenu généré par IA ?

Peut-on publier du contenu IA sans édition humaine ?

Les secteurs YMYL sont-ils traités différemment pour le contenu IA ?

Comment Google détecte-t-il qu'un contenu est généré par IA ?

Quelle est la différence entre contenu IA acceptable et contenu IA pénalisé ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.