Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ La méthode de production du contenu importe-t-elle vraiment pour Google ?

- □ Le système de contenu utile de Google peut-il vraiment distinguer l'intention éditoriale ?

- □ Le robots.txt suffit-il vraiment à contrôler le crawl de zones spécifiques de votre site ?

- □ Comment Google Extended permet-il de bloquer l'indexation pour Bard et Vertex AI ?

- □ Le robots.txt est-il vraiment respecté par tous les crawlers ?

- □ Les robots meta tags permettent-ils vraiment un contrôle précis de l'indexation ?

- □ Les CMS intègrent-ils vraiment les nouvelles options SEO aussi rapidement que Google le prétend ?

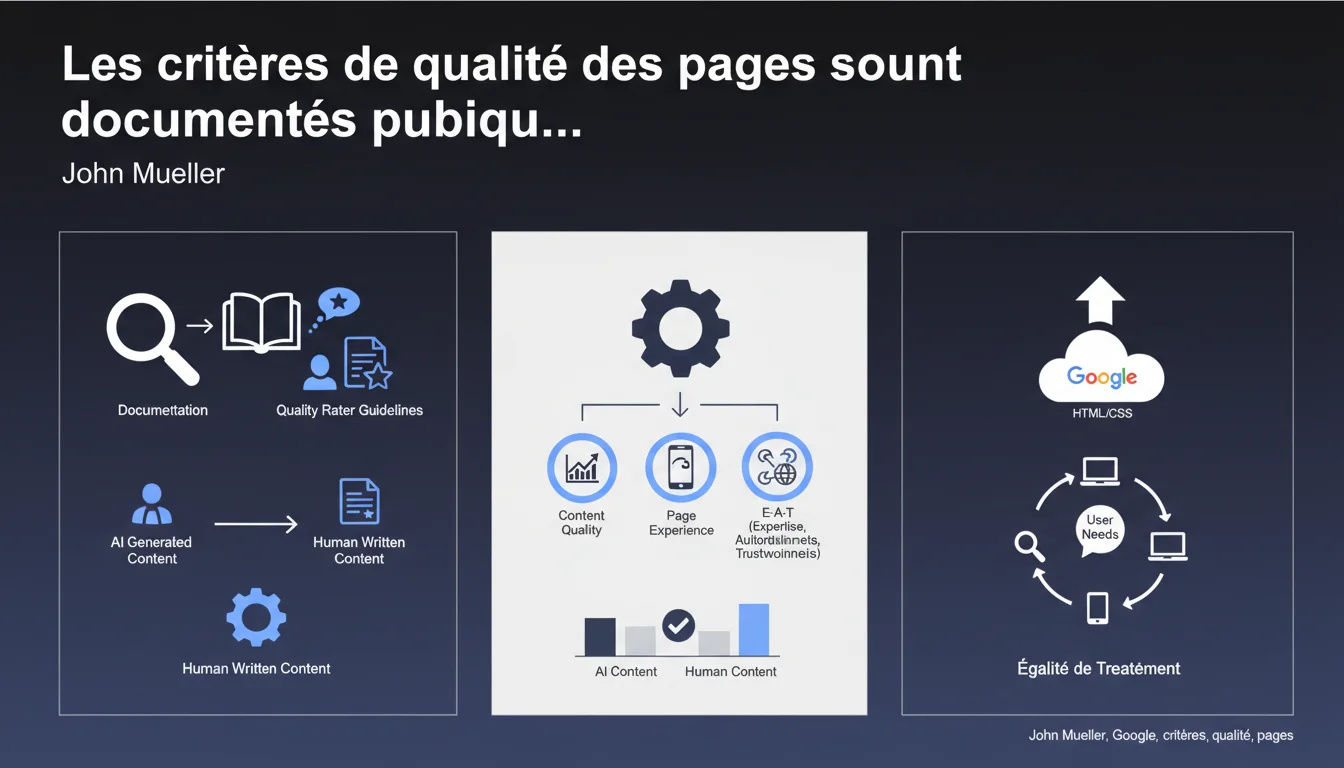

Google affirme documenter publiquement tous les critères utilisés pour évaluer la qualité des pages, que le contenu soit généré par IA ou non. Ces informations se trouvent dans la documentation Search et les directives des quality raters. L'affirmation mérite d'être nuancée : certains signaux restent volontairement flous ou évoluent sans communication claire.

Ce qu'il faut comprendre

Où Google documente-t-il vraiment ses critères de qualité ?

Google publie deux ressources principales : la documentation officielle Search (Search Central) qui couvre les bases techniques et éditoriales, et les Search Quality Rater Guidelines, un manuel de 170+ pages destiné aux évaluateurs humains.

Les Quality Rater Guidelines détaillent ce que Google considère comme un contenu de haute qualité : expertise, autorité, fiabilité (E-E-A-T), utilité pour l'utilisateur, absence de manipulation. Ces critères s'appliquent indépendamment du mode de production du contenu.

Cette documentation couvre-t-elle tous les signaux de classement ?

Non. Elle expose les principes directeurs et les attentes qualitatives, mais n'explique pas comment chaque signal algorithmique est pondéré. Exemple concret : Google documente l'importance de l'E-E-A-T, mais ne révèle pas précisément comment Helpful Content System mesure cette expertise.

La distinction est cruciale. Vous savez ce que Google recherche (contenu utile, expertise démontrée, expérience utilisateur fluide), mais pas exactement comment l'algorithme le détecte ni quelle pondération il applique.

Le contenu généré par IA est-il traité différemment ?

Officiellement non — et Mueller le rappelle ici. Google prétend évaluer le résultat final, pas la méthode de production. Un article IA bien sourcé, vérifié, apportant une perspective unique peut théoriquement surpasser un contenu humain médiocre.

Le problème ? Dans la pratique, l'IA produit souvent des patterns détectables : redondance sémantique, absence de nuance, formulations génériques. Les algorithmes de détection de spam et Helpful Content captent ces signaux sans forcément les nommer publiquement.

- E-E-A-T reste le socle : expertise, expérience, autorité, fiabilité

- Les Quality Rater Guidelines décrivent les attentes qualitatives, pas les mécanismes algorithmiques

- La documentation explique le quoi, rarement le comment ni le poids des signaux

- Contenu IA ou humain : même grille d'évaluation théorique, réalité terrain plus nuancée

Avis d'un expert SEO

Cette transparence annoncée correspond-elle à la réalité terrain ?

Partiellement. Google documente effectivement ses attentes générales — c'est indéniable. Les Quality Rater Guidelines sont publiques, détaillées, mises à jour régulièrement. Mais qualifier cette documentation de "complète" relève de l'optimisme.

Concrètement ? Vous saurez que Google valorise l'expertise démontrée, mais pas comment HCU (Helpful Content Update) pondère précisément un by-line détaillé vs une bio d'auteur minimale. Vous lirez que la vitesse compte, mais pas le seuil exact où un LCP de 2,6s devient pénalisant. [A vérifier] : l'impact réel de certains signaux E-E-A-T reste largement basé sur des corrélations, pas des confirmations officielles.

Quelles informations critiques restent volontairement floues ?

Les pondérations et les seuils. Google documente rarement les valeurs chiffrées ou les combinaisons de signaux. Exemple : on sait que les backlinks comptent, mais pas comment l'algorithme arbitre entre 50 liens moyens et 5 liens excellents sur un sujet YMYL.

Autre zone grise : les mises à jour d'algorithmes. Google communique sur les Core Updates ou Spam Updates après déploiement, rarement avant. Les ajustements mineurs (et ils sont constants) ne font l'objet d'aucune documentation. Vous apprenez par observation, test, corrélation — pas par lecture officielle.

Le contenu IA illustre parfaitement cette ambiguïté. Google affirme ne pas discriminer, mais les sites IA massifs (fermes de contenu automatisé) ont pris des claques monumentales lors des derniers HCU. Coïncidence ou détection de patterns ? Aucune documentation ne le précise.

Dans quels cas cette documentation est-elle insuffisante ?

Pour tout ce qui relève du SEO technique avancé et des cas limites. Exemple : Google documente le crawl budget en termes vagues, mais ne fournit aucun seuil pour les sites de 100K vs 1M pages. Vous devez extrapoler via les logs serveur.

Même chose pour le spam. Les Spam Policies énoncent des interdictions (cloaking, redirections trompeuses), mais ne définissent pas précisément où se situe la ligne. Un interstitiel promotionnel léger passe-t-il ? Faut-il un délai de 3 secondes ou 5 avant l'affichage ? Silence radio.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette documentation ?

Lis les Quality Rater Guidelines au moins une fois par an. Pas en diagonale — vraiment. Elles révèlent la philosophie produit de Google : ce que l'équipe Search considère comme un résultat de qualité. Utilise-les comme grille d'audit : ton contenu répond-il aux critères d'expertise ? Démontre-t-il une expérience réelle ?

Ensuite, croise cette documentation avec tes données terrain. Compare les recommandations E-E-A-T avec les pages top 3 sur tes requêtes cibles. Observe les écarts : quand les docs Google et la SERP divergent, c'est souvent que d'autres signaux (autorité de domaine, backlinks, CTR) compensent ou dominent.

Pour le contenu IA : respecte les mêmes standards que pour le contenu humain. Ajoute systématiquement une couche d'expertise humaine — analyse personnelle, données propriétaires, angle unique. L'IA peut rédiger la structure, mais l'éditorialisation finale doit démontrer une compréhension fine du sujet.

Quelles erreurs éviter absolument ?

Ne traite pas la documentation Google comme un mode d'emploi exhaustif. C'est un cadre, pas une recette. Trop de SEO appliquent mécaniquement les guidelines sans comprendre le contexte algorithmique global. Résultat : un contenu "conforme" sur le papier mais sans traction organique.

Évite aussi de négliger les signaux non documentés. Google ne mentionne pas explicitement l'importance du taux de clic (CTR) organique, pourtant les tests A/B sur les balises title montrent un impact mesurable. Idem pour le temps de session ou le pogosticking. Ces métriques comportementales comptent, même si elles n'apparaissent pas dans les docs officielles.

Dernière erreur classique : publier du contenu IA brut en pensant que l'absence de pénalité officiellement annoncée te protège. Les Helpful Content Updates ont visé en priorité les sites avec du contenu générique à faible valeur ajoutée — souvent produit en masse via IA. Si ton texte ressemble à 10 000 autres, peu importe qu'il soit techniquement "correct".

Comment vérifier que ton site respecte ces critères ?

Fais un audit E-E-A-T rigoureux. Pour chaque page stratégique : qui est l'auteur ? Ses credentials sont-elles visibles et vérifiables ? Le contenu cite-t-il des sources primaires fiables ? Y a-t-il des preuves d'expérience réelle (données originales, études de cas, témoignages) ?

Teste la perception utilisateur via des panels ou des outils type Hotjar. Un contenu peut techniquement cocher toutes les cases Google et pourtant frustrer les visiteurs. Le pogosticking (retour immédiat aux SERPs) est un signal d'alerte : même si Google ne le documente pas clairement, un taux de rebond élevé sur requête informationnelle pose question.

- Audite chaque page contre les critères E-E-A-T des Quality Rater Guidelines

- Vérifie que les auteurs affichent des credentials vérifiables (bio, liens LinkedIn/Twitter, publications)

- Ajoute des sources primaires pour toute affirmation factuelle (études, données officielles)

- Teste le contenu IA avec un regard critique : apporte-t-il un angle unique ou reformule-t-il l'existant ?

- Compare tes top pages avec les positions 1-3 sur tes requêtes cibles — note les écarts qualitatifs

- Monitore les Core Web Vitals et l'expérience mobile (PageSpeed Insights, Search Console)

- Analyse les métriques comportementales (temps de session, pages/visite) via GA4

❓ Questions frequentes

Les Quality Rater Guidelines sont-elles un facteur de classement direct ?

Google pénalise-t-il spécifiquement le contenu généré par IA ?

Combien de critères de qualité Google utilise-t-il réellement ?

Faut-il prioriser E-E-A-T sur tous les types de contenu ?

La documentation Google suffit-elle pour optimiser un site correctement ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.