Declaration officielle

Autres déclarations de cette vidéo 15 ▾

- □ Les fluctuations de classement sont-elles vraiment normales ou cachent-elles un problème technique ?

- □ Google utilise-t-il vraiment un seul index mondial pour tous les pays ?

- □ Faut-il encore se fier aux résultats de la requête site: pour diagnostiquer l'indexation ?

- □ L'engagement utilisateur influence-t-il réellement le classement Google ?

- □ Pourquoi les pages à fort trafic pèsent-elles plus dans le score Core Web Vitals ?

- □ Google segmente-t-il vraiment les sites par type de template pour évaluer la Page Experience ?

- □ Combien de liens internes faut-il placer par page pour optimiser son SEO ?

- □ Pourquoi la structure en arbre de votre maillage interne compte-t-elle vraiment pour Google ?

- □ Pourquoi la structure d'URL n'a-t-elle aucune importance pour Google ?

- □ Pourquoi les positions Search Console ne reflètent-elles pas la réalité du classement ?

- □ Google distingue-t-il vraiment 'edit video' et 'video editor' comme des intentions différentes ?

- □ Le balisage FAQ doit-il obligatoirement figurer sur la page indexée pour générer un rich snippet ?

- □ Les liens en footer ont-ils la même valeur SEO que les liens dans le contenu ?

- □ L'indexation mobile-first a-t-elle un impact sur vos classements Google ?

- □ Faut-il vraiment qu'un robots.txt inexistant retourne un 404 pour éviter de bloquer Googlebot ?

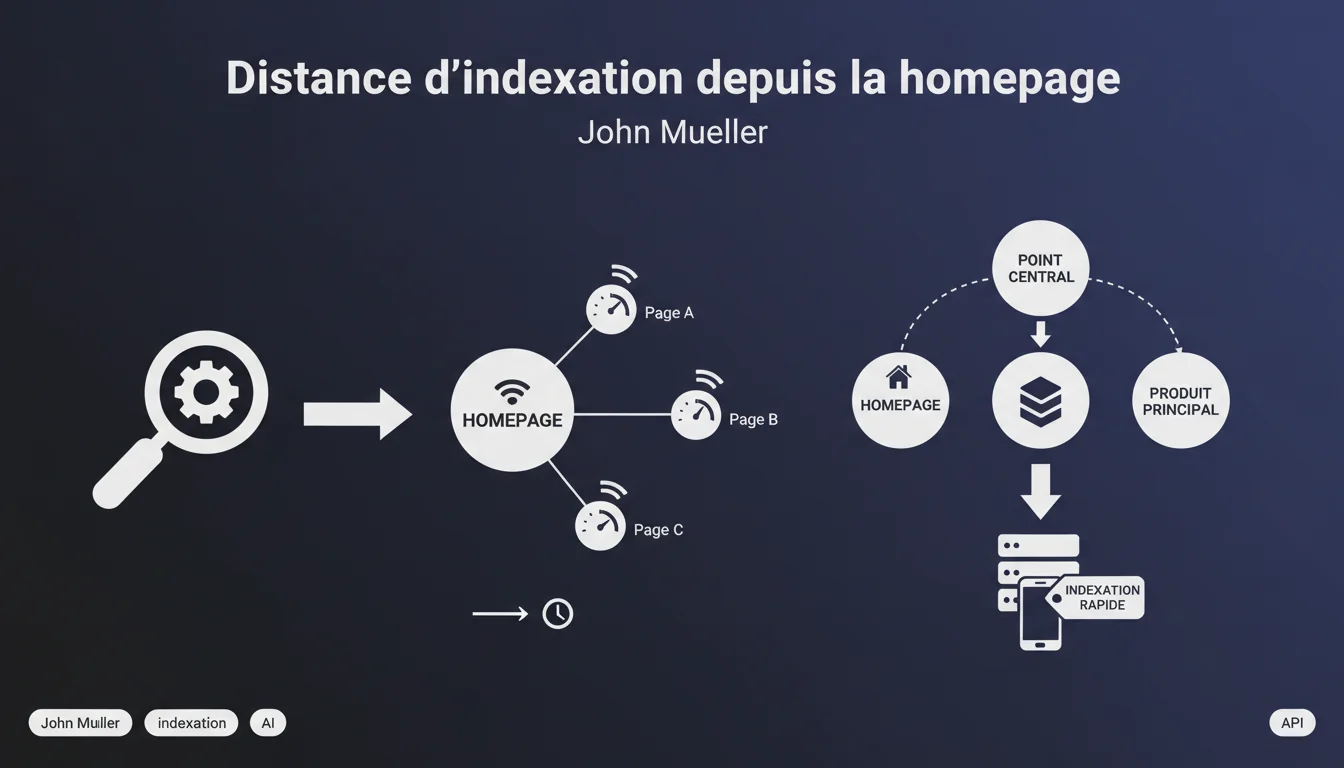

Google indexe plus rapidement les pages proches de la homepage car c'est généralement le point central du crawl. Cette logique s'applique à la plupart des sites, mais certains architectures peuvent avoir un autre point focal — une catégorie majeure ou un produit phare. La profondeur de clic reste un signal fort pour la priorisation du crawl.

Ce qu'il faut comprendre

Pourquoi la homepage est-elle le point de départ du crawl ?

Pour Googlebot, la homepage représente la porte d'entrée principale d'un site. C'est souvent la page qui accumule le plus de backlinks externes et qui bénéficie de la meilleure autorité. Le robot explore donc prioritairement les liens situés à proximité directe de cette page.

Cette logique explique pourquoi une page accessible en 1 ou 2 clics depuis la racine sera découverte et indexée bien plus vite qu'une page enfouie à 5 ou 6 niveaux de profondeur. Le budget crawl se concentre naturellement sur les zones les plus accessibles.

Tous les sites fonctionnent-ils selon ce schéma ?

Non — et c'est là que Mueller introduit une nuance importante. Sur certains sites, la homepage n'est qu'une vitrine générique. Le vrai point focal peut être une catégorie stratégique ou un produit vedette qui attire l'essentiel du trafic et des liens.

Dans ce cas, Googlebot adapte son comportement. Il comprend que le centre de gravité du site se situe ailleurs et ajuste ses priorités de crawl en conséquence. L'algorithme n'est pas rigide — il détecte où se concentre l'activité.

Quelle est la mécanique technique derrière cette priorisation ?

La distance d'indexation repose sur plusieurs signaux combinés : profondeur de clic, liens internes, PageRank interne, fréquence de mise à jour. Une page liée directement depuis la homepage hérite d'une partie de son autorité via le maillage interne.

Plus une page est proche du point central, plus elle reçoit de « jus SEO » et plus Googlebot la visite fréquemment. À l'inverse, une page orpheline ou trop profonde risque de rester invisible pendant des semaines, voire de ne jamais être indexée.

- La homepage est le point de départ par défaut du crawl pour la majorité des sites

- La profondeur de clic influence directement la vitesse d'indexation

- Certains sites ont un point focal alternatif (catégorie, produit) reconnu par Google

- Le maillage interne distribue l'autorité et guide Googlebot vers les pages prioritaires

- Une page trop enfouie peut rester hors index pendant des semaines

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Oui, et c'est même l'un des rares principes SEO qui se vérifie systématiquement. Tous les audits montrent une corrélation directe entre profondeur de clic et vitesse d'indexation. Les pages à 1-2 clics de la home apparaissent dans l'index en quelques heures à quelques jours. Celles à 5-6 clics peuvent attendre des semaines.

La nuance apportée par Mueller sur les « points focaux alternatifs » reflète aussi la réalité de sites comme Amazon ou Booking, où certaines catégories surperforment la homepage en termes de trafic et de liens. Google sait s'adapter — mais encore faut-il que ces pages alternatives aient une autorité mesurable.

Quelle est la limite pratique de cette règle ?

Le problème, c'est qu'on ne contrôle pas directement comment Google identifie ce fameux « point central ». Mueller reste flou : « pour certains sites, cela peut être une catégorie ou un produit principal ». D'accord, mais quels signaux déclenchent cette reconnaissance ? [À vérifier]

Concrètement, si vous avez une catégorie stratégique qui génère 60 % du trafic mais reste à 3 clics de la home, rien ne garantit que Googlebot la traitera comme un point focal. Il faudra sans doute forcer la main via le maillage interne et une meilleure visibilité structurelle.

Faut-il en déduire qu'une architecture plate est toujours préférable ?

Pas systématiquement. Une architecture trop plate dilue la hiérarchie sémantique et rend le site confus pour l'utilisateur comme pour le moteur. L'objectif n'est pas de tout mettre à 1 clic de la home, mais de s'assurer que les pages stratégiques sont accessibles rapidement.

Soyons honnêtes : la plupart des sites e-commerce ou médias ont des centaines de milliers de pages. Impossible de tout remonter. L'enjeu, c'est de prioriser intelligemment et de surveiller les pages qui stagnent en profondeur malgré leur importance business.

Impact pratique et recommandations

Comment réduire la distance d'indexation des pages stratégiques ?

Commence par cartographier ton site avec un crawler (Screaming Frog, Oncrawl, Botify). Identifie les pages à fort enjeu business qui se trouvent à 4 clics ou plus de la home. Ensuite, crée des liens internes directs depuis des pages proches de la racine.

Les menus, footers, et zones de navigation transversales sont tes alliés. Un lien depuis le menu principal réduit instantanément la profondeur à 1 clic. Utilise aussi des blocs de liens contextuels dans le contenu des pages piliers pour distribuer l'autorité vers les sous-pages.

Quelles erreurs structurelles freinent l'indexation ?

L'erreur classique : des catégories importantes cachées derrière plusieurs niveaux de filtres ou de pagination. Chaque clic supplémentaire ralentit le crawl. Autre piège fréquent : les pages orphelines — techniquement dans le site, mais absentes du maillage interne.

Vérifie aussi les liens JavaScript non détectés par Googlebot en mode HTML pur. Si ton architecture repose sur du JS client-side sans fallback, certaines pages risquent de rester invisibles même si elles sont « proches » en théorie.

Comment vérifier que Google reconnaît mon point focal alternatif ?

Surveille les logs serveur et la Search Console. Si une catégorie ou un produit reçoit autant de crawl que la homepage — voire plus — c'est bon signe. Analyse aussi la fréquence de crawl sur ces URLs et compare avec les autres sections du site.

Si les données montrent que Googlebot ignore ta page stratégique malgré son importance business, c'est que le signal n'est pas passé. Il faut renforcer le maillage interne, les backlinks externes vers cette page, et éventuellement la remonter dans l'arborescence.

- Crawler le site et identifier les pages stratégiques à 4+ clics de profondeur

- Ajouter des liens directs depuis le menu, footer ou pages piliers

- Vérifier l'absence de pages orphelines dans les sections importantes

- Tester le rendu JavaScript pour détecter les liens invisibles en HTML pur

- Analyser les logs serveur pour repérer les zones sous-crawlées

- Monitorer l'évolution de la profondeur de clic après optimisation

- Renforcer le maillage interne vers les points focaux alternatifs

❓ Questions frequentes

Une page à 5 clics de la homepage peut-elle quand même être indexée rapidement ?

Le sitemap XML permet-il de contourner le problème de profondeur ?

Comment savoir si Google a identifié un point focal alternatif sur mon site ?

Faut-il tout mettre à 1 clic de la homepage pour optimiser l'indexation ?

Les liens en JavaScript sont-ils pris en compte dans le calcul de profondeur ?

🎥 De la même vidéo 15

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.