Declaration officielle

Autres déclarations de cette vidéo 15 ▾

- □ Les fluctuations de classement sont-elles vraiment normales ou cachent-elles un problème technique ?

- □ Google utilise-t-il vraiment un seul index mondial pour tous les pays ?

- □ Faut-il encore se fier aux résultats de la requête site: pour diagnostiquer l'indexation ?

- □ L'engagement utilisateur influence-t-il réellement le classement Google ?

- □ Pourquoi les pages à fort trafic pèsent-elles plus dans le score Core Web Vitals ?

- □ Google segmente-t-il vraiment les sites par type de template pour évaluer la Page Experience ?

- □ Combien de liens internes faut-il placer par page pour optimiser son SEO ?

- □ La distance depuis la homepage influence-t-elle vraiment la vitesse d'indexation ?

- □ Pourquoi la structure d'URL n'a-t-elle aucune importance pour Google ?

- □ Pourquoi les positions Search Console ne reflètent-elles pas la réalité du classement ?

- □ Google distingue-t-il vraiment 'edit video' et 'video editor' comme des intentions différentes ?

- □ Le balisage FAQ doit-il obligatoirement figurer sur la page indexée pour générer un rich snippet ?

- □ Les liens en footer ont-ils la même valeur SEO que les liens dans le contenu ?

- □ L'indexation mobile-first a-t-elle un impact sur vos classements Google ?

- □ Faut-il vraiment qu'un robots.txt inexistant retourne un 404 pour éviter de bloquer Googlebot ?

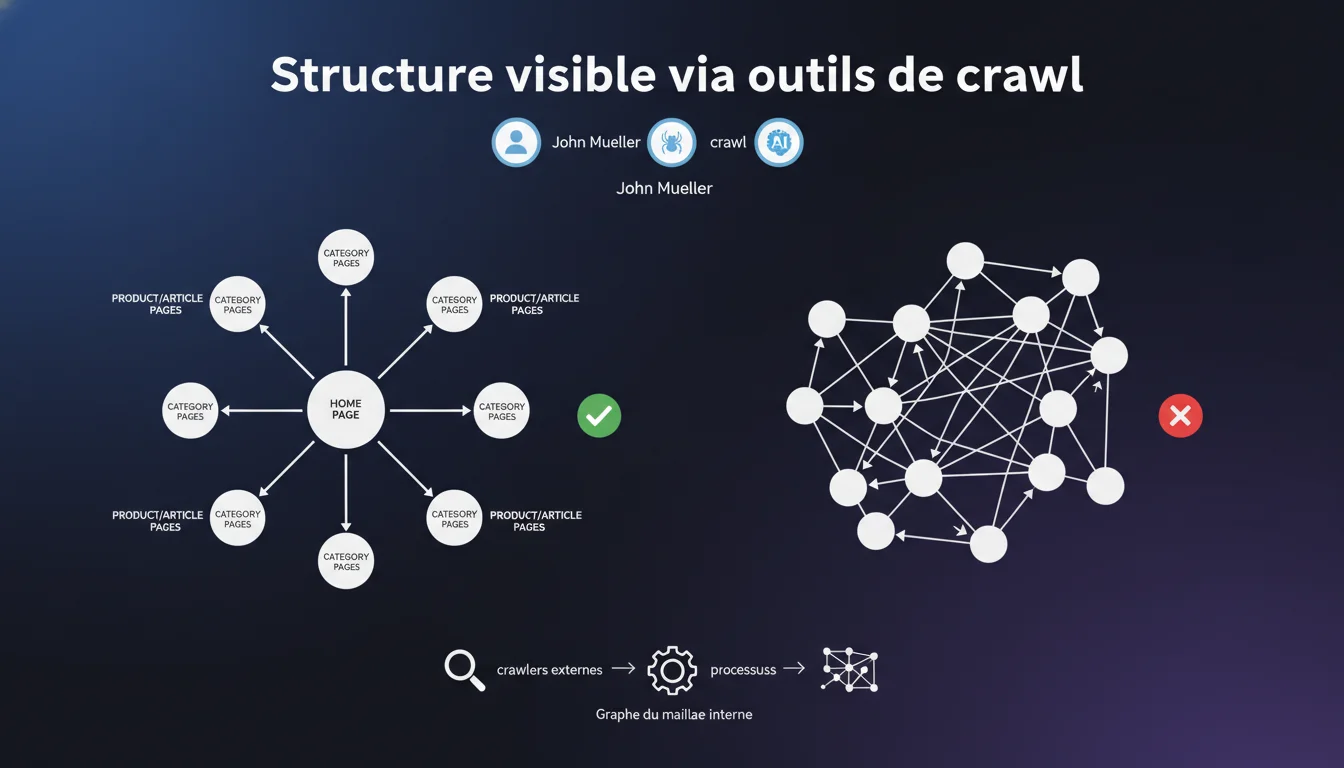

Google recommande de visualiser son maillage interne avec des crawlers externes pour vérifier qu'il ressemble à un arbre avec ramifications, pas à un maillage où tout pointe vers tout. Une structure anarchique dilue la compréhension de la hiérarchie par le moteur et nuit au crawl efficace.

Ce qu'il faut comprendre

Que signifie concrètement une « structure en arbre » ?

Mueller parle d'un point central — typiquement la homepage — d'où partent des ramifications progressives. Chaque niveau hiérarchique se déploie logiquement : catégories principales, sous-catégories, fiches produits ou articles.

L'image inverse ? Un graphe où chaque page renvoie vers 15 autres pages sans logique apparente. Le crawler perd le fil, Google ne saisit pas quelle page prime sur quelle autre.

- Point central : homepage ou hub thématique fort

- Ramifications : niveaux de profondeur cohérents (1→2→3)

- Éviter : maillage circulaire où tout est relié à tout

Pourquoi Google insiste-t-il sur l'usage de crawlers externes ?

Parce que Search Console ne montre pas le graphe du maillage. Screaming Frog, OnCrawl, Botify ou Gephi génèrent une visualisation — et c'est souvent la douche froide.

Vous découvrez des pages orphelines, des clusters mal reliés, des silos percés de partout. Sans cette vue d'ensemble, impossible de diagnostiquer la désorganisation.

Quelle est l'implication directe pour le crawl budget ?

Une structure anarchique gaspille les ressources de crawl. Googlebot passe du temps sur des pages peu stratégiques parce que le maillage les survalorise artificiellement.

À l'inverse, un arbre bien conçu canalise le flux de PageRank interne et guide le bot vers les contenus prioritaires. Résultat : indexation plus rapide, fraîcheur mieux capturée.

Avis d'un expert SEO

Cette recommandation est-elle réellement appliquée sur le terrain ?

Soyons honnêtes : la majorité des sites e-commerce ou éditoriaux ont un maillage en pelote de laine, pas en arbre propre. Filtres à facettes, cross-selling agressif, widgets « articles similaires » partout — tout ça génère des interconnexions qui noient la hiérarchie.

Pourtant, certains de ces sites rankent correctement. Pourquoi ? Parce que Google tolère un certain désordre si la profondeur de clic reste raisonnable et que les pages stratégiques reçoivent assez de jus interne. Mais cette tolérance ne signifie pas optimum.

Quelles nuances faut-il apporter à la métaphore de l'arbre ?

Un arbre pur — strictement hiérarchique sans aucun lien transversal — est rarement optimal pour l'UX ou le SEO moderne. Les silos étanches empêchent la distribution du PageRank entre thématiques connexes.

Ce que Mueller vise, c'est l'excès inverse : le maillage tentaculaire où chaque page renvoie vers 20 autres « au cas où ». Le bon équilibre ? Une ossature arborescente renforcée par quelques ponts stratégiques entre silos — pas une toile d'araignée.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Sites médias ou agrégateurs de contenu : la logique éditoriale impose souvent un maillage contextuel dense. Un article peut légitimement renvoyer vers 10 autres articles connexes. Google s'adapte si la pertinence thématique est forte.

Marketplace complexes : filtres, comparateurs, pages dynamiques — impossible de maintenir un arbre pur. Là, l'enjeu bascule sur le contrôle du crawl via robots.txt, canonical, nofollow sélectif. [À vérifier] : Google n'a jamais clarifié de seuil quantitatif à partir duquel un maillage devient « trop dense ».

Impact pratique et recommandations

Comment auditer concrètement votre structure de maillage ?

Crawlez votre site avec Screaming Frog, OnCrawl ou Sitebulb. Exportez le graphe des liens internes et visualisez-le avec Gephi ou l'outil natif du crawler.

Identifiez le point central : est-ce bien la homepage ? Les catégories majeures sont-elles directement reliées ? Repérez les nœuds isolés (pages orphelines) et les clusters mal connectés.

- Crawler le site en mode « follow internal links only »

- Générer un graphe de maillage (format CSV ou GEXF)

- Identifier les pages à forte centralité (hubs naturels)

- Repérer les pages orphelines ou mal reliées

- Vérifier que la profondeur de clic maximale reste sous 3-4 clics depuis la home

Quelles erreurs critiques faut-il éviter ?

Première erreur : ajouter des liens partout « pour faire du maillage ». Un footer avec 50 liens vers des catégories aléatoires ne crée pas de structure — il crée du bruit.

Deuxième erreur : négliger les ancres de liens internes. Une structure parfaite avec des ancres génériques (« cliquez ici », « en savoir plus ») perd une partie de son efficacité sémantique.

Troisième erreur : croire qu'un plan de site XML compense un maillage anarchique. Le sitemap aide à l'indexation initiale, pas à la compréhension de la hiérarchie ni à la distribution du PageRank.

Que faut-il faire concrètement pour améliorer sa structure ?

Définissez vos pages piliers (hubs thématiques) et assurez-vous qu'elles sont à 1 clic de la home. Depuis chaque pilier, déployez les sous-catégories ou articles de manière logique.

Limitez les liens transversaux au strict nécessaire : pertinence contextuelle uniquement. Un lien « produits similaires » doit rester dans la même catégorie, pas pointer vers l'ensemble du catalogue.

Révisez régulièrement votre maillage après ajout de contenu. Un site qui grandit organiquement finit toujours par dériver vers le chaos si personne ne surveille.

❓ Questions frequentes

Quel outil gratuit permet de visualiser rapidement un graphe de maillage interne ?

Un site e-commerce avec filtres à facettes peut-il avoir une structure en arbre propre ?

Faut-il supprimer tous les liens transversaux entre silos pour respecter la structure en arbre ?

Google pénalise-t-il un site dont le maillage n'est pas en arbre ?

Quelle profondeur de clic maximale Google recommande-t-il ?

🎥 De la même vidéo 15

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.