Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Les ccTLDs imposent-ils vraiment un ciblage géographique automatique impossible à contourner ?

- □ Hreflang : HTML ou sitemap XML, quelle méthode choisir pour votre référencement international ?

- □ Peut-on vraiment utiliser des balises noscript dans le <head> sans pénalité SEO ?

- □ Pourquoi Google distingue-t-il le HTML source du DOM rendu ?

- □ Les iframes dans le <head> peuvent-ils vraiment casser votre SEO technique ?

- □ La Search Console affiche-t-elle vraiment les variations d'impressions en temps réel ?

- □ Comment tester le user-agent Googlebot directement dans Chrome sans extension tierce ?

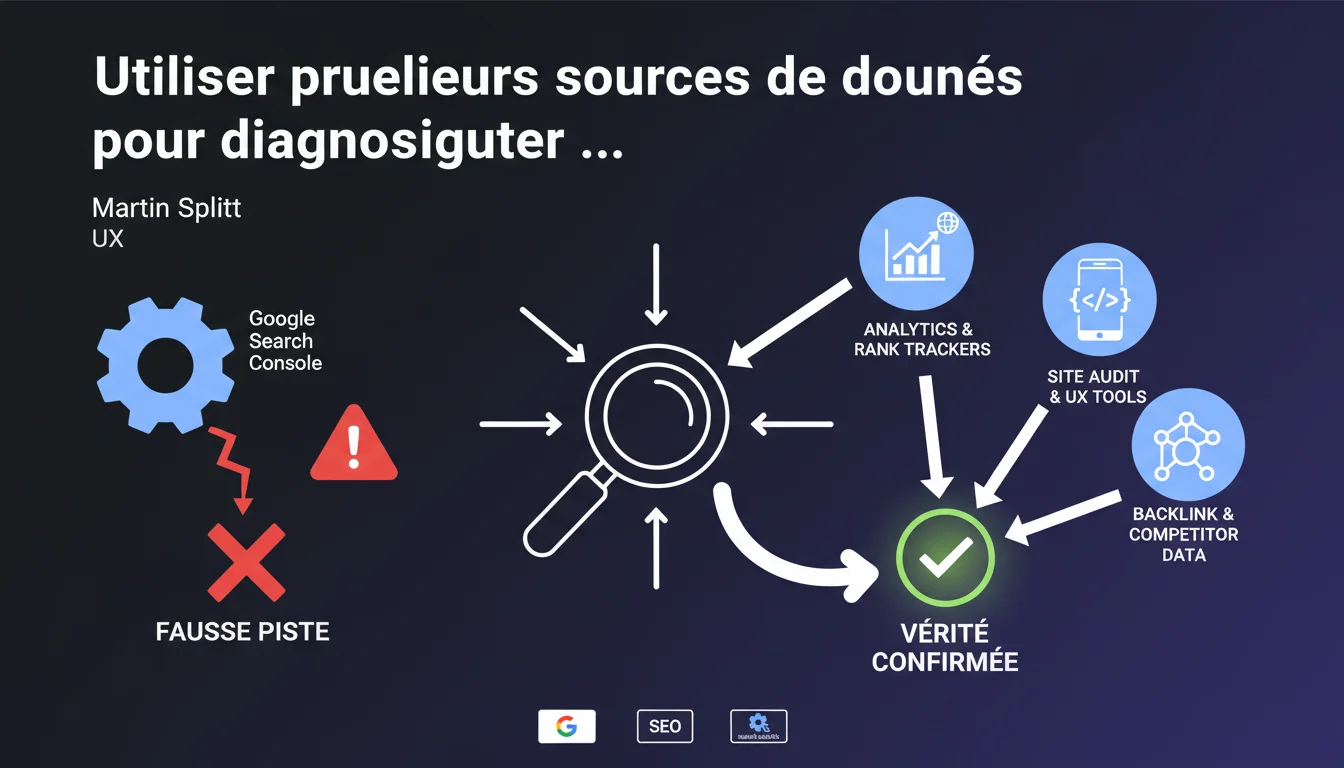

Google déconseille de se reposer uniquement sur Search Console pour diagnostiquer un problème SEO. Martin Splitt insiste : il faut systématiquement croiser avec des outils tiers pour éviter les fausses pistes et valider les hypothèses. Une approche mono-source, c'est la garantie de passer à côté du vrai problème.

Ce qu'il faut comprendre

Pourquoi Google met-il en garde contre l'usage exclusif de Search Console ?

Parce que Search Console n'est qu'une fenêtre partielle sur ce que voit réellement Google. Les données y sont agrégées, parfois retardées, et certaines métriques cruciales — comme le comportement utilisateur réel ou la concurrence — n'y figurent tout simplement pas.

Un problème technique détecté dans GSC peut masquer un souci plus profond — ou être un symptôme sans gravité. Sans recul externe, on risque de traiter la conséquence au lieu de la cause.

Quelles sont les limites concrètes de Search Console ?

GSC ne montre pas tout le trafic organique, seulement celui qui passe par Google Search. Les données sont échantillonnées au-delà d'un certain seuil, ce qui biaise les analyses sur les gros sites. Les rapports de performance agrègent parfois des requêtes différentes sous une même ligne.

Autre point : GSC ne capte pas les signaux concurrentiels. Impossible de savoir si votre baisse de trafic vient d'un problème technique ou d'un concurrent qui a simplement mieux optimisé ses contenus.

Que signifie « croiser les sources » pour un praticien SEO ?

Concrètement : confronter les données GSC avec Google Analytics (ou GA4), un outil de crawl (Screaming Frog, Oncrawl), un tracker de positions (SEMrush, Ahrefs), et éventuellement des logs serveur. Chaque source apporte un angle différent.

Un exemple typique : GSC indique une chute d'impressions, mais Analytics montre que le trafic global reste stable. Conclusion probable ? Le problème vient d'un glissement de mots-clés ou d'une cannibalisation, pas d'un désindexage massif.

- Search Console : vision de ce que Google indexe et comment il positionne vos pages

- Analytics : comportement utilisateur réel, taux de rebond, conversions

- Outils de crawl : détection des erreurs techniques (404, redirections, balises manquantes)

- Trackers de positions : suivi précis des fluctuations par mot-clé et concurrent

- Logs serveur : fréquence réelle de passage de Googlebot, pages crawlées vs ignorées

Avis d'un expert SEO

Cette recommandation est-elle vraiment nouvelle ou juste du bon sens ?

Soyons honnêtes : tout SEO expérimenté croise déjà ses sources depuis des années. Ce qui est intéressant ici, c'est que Google l'officialise publiquement. Ça veut dire qu'ils sont conscients des limites de GSC — et qu'ils ne veulent pas être tenus responsables des mauvais diagnostics qui en découlent.

Mais cette déclaration reste vague. Martin Splitt ne précise pas quels outils externes privilégier, ni comment arbitrer quand deux sources se contredisent. C'est du conseil générique qui laisse le praticien seul face à l'interprétation. [A vérifier] si Google compte enrichir GSC pour combler ces lacunes ou s'ils considèrent que c'est au SEO de se débrouiller.

Dans quels cas peut-on se fier uniquement à Search Console ?

Presque jamais — sauf peut-être pour des vérifications ponctuelles comme un problème de couverture d'index évident (pages en erreur 4xx, blocage robots.txt). Mais même là, un crawl externe confirmera plus vite si le problème est généralisé ou isolé.

Le danger, c'est de tomber dans le piège inverse : multiplier les outils sans structurer l'analyse. Résultat ? On noie les données pertinentes dans le bruit. Il faut une méthodologie claire : partir d'une hypothèse, choisir les sources qui la valident ou l'infirment, puis croiser.

Quels écarts flagrants observe-t-on entre GSC et la réalité terrain ?

Un classique : GSC indique une position moyenne de 8, mais votre tracker montre une volatilité énorme (entre 3 et 25) selon les jours. GSC lisse les données, masquant les fluctuations brutales qui peuvent expliquer une baisse de trafic.

Autre cas fréquent : GSC remonte un problème de Core Web Vitals sur des URLs qui ne reçoivent quasiment aucun trafic. Sans croiser avec Analytics, on risque de perdre du temps à optimiser des pages sans impact business.

Impact pratique et recommandations

Comment organiser un diagnostic SEO multi-sources efficace ?

Commence par définir l'hypothèse avant de plonger dans les outils. Exemple : "Le trafic baisse de 30% depuis 2 semaines". Vérifie d'abord GSC (couverture, erreurs d'indexation, positions), puis Analytics (pages impactées, taux de rebond), puis un crawl (problèmes techniques récents).

Ensuite, confronte les chronologies. Si GSC montre une chute d'impressions le 10, que ton crawl révèle un changement de template le 8, et qu'Analytics confirme une hausse du taux de rebond le 11, tu tiens probablement ton coupable.

Quels outils externes privilégier pour croiser avec GSC ?

Pour l'analyse technique : Screaming Frog (audit ponctuel) ou Oncrawl (suivi continu). Pour les positions : SEMrush ou Ahrefs, qui permettent aussi de surveiller les concurrents. Pour le comportement utilisateur : GA4 évidemment, couplé à Hotjar si tu veux aller plus loin.

Les logs serveur restent sous-exploités alors qu'ils révèlent ce que Googlebot fait réellement — et pas ce qu'on suppose qu'il fait. Botify ou OnCrawl intègrent cette analyse, mais ça demande un accès serveur et un minimum de compétences techniques.

Quelles erreurs éviter dans le croisement de données ?

Ne jamais comparer des périodes incohérentes entre outils. GSC agrège par date de clic, Analytics par date de session — un décalage de quelques jours peut fausser toute l'analyse. Harmonise les plages temporelles avant de tirer des conclusions.

Autre piège : croire qu'une métrique externe contredit GSC alors qu'elle mesure autre chose. GSC donne la position moyenne dans les SERPs, pas le CTR réel ni le trafic effectif. Un outil comme Ahrefs estime le trafic, mais c'est une projection — pas une vérité absolue.

- Définir une hypothèse claire avant d'ouvrir les outils

- Comparer les mêmes plages de dates entre GSC, Analytics et outils tiers

- Vérifier la cohérence entre les métriques (impressions GSC vs sessions Analytics)

- Utiliser un crawl pour confirmer tout problème technique détecté dans GSC

- Croiser avec un tracker de positions pour détecter les variations masquées par la moyenne GSC

- Consulter les logs serveur en cas de doute sur le comportement réel de Googlebot

- Documenter chaque étape du diagnostic pour éviter de tourner en rond

Le croisement de données n'est pas une option, c'est la base d'un diagnostic SEO fiable. GSC seul, c'est comme conduire avec un seul rétroviseur — tu vois une partie de la route, mais tu rates les angles morts.

Mais attention : multiplier les outils sans méthodologie rigoureuse crée plus de confusion qu'autre chose. Si tu n'as pas encore structuré ton processus de diagnostic ou si la complexité de ton site rend l'analyse chronophage, l'accompagnement d'une agence SEO spécialisée peut te faire gagner un temps précieux — et surtout éviter les fausses pistes qui coûtent cher en ressources.

❓ Questions frequentes

Peut-on se passer de Search Console si on a déjà Analytics et un outil de crawl ?

Pourquoi GSC et Analytics montrent-ils parfois des écarts de trafic importants ?

Combien de temps faut-il pour qu'une modification apparaisse dans Search Console ?

Quel est le minimum d'outils à combiner pour un diagnostic fiable ?

Comment savoir si un problème vient de Google ou de mon site ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.