Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ L'expérience utilisateur améliore-t-elle vraiment le référencement naturel ?

- □ Les accordéons et contenus masquables pénalisent-ils encore le référencement mobile ?

- □ Faut-il vraiment ignorer les blogs SEO et ne lire que la documentation Google ?

- □ Les Core Web Vitals influencent-ils réellement le classement dans Google ?

- □ Le lazy loading est-il vraiment une optimisation SEO facile à implémenter ?

- □ La taille des packages JavaScript impacte-t-elle réellement votre SEO ?

- □ Le HTML sémantique est-il vraiment un critère de référencement déterminant ?

- □ Faut-il vraiment impliquer le SEO dès la phase de conception technique ?

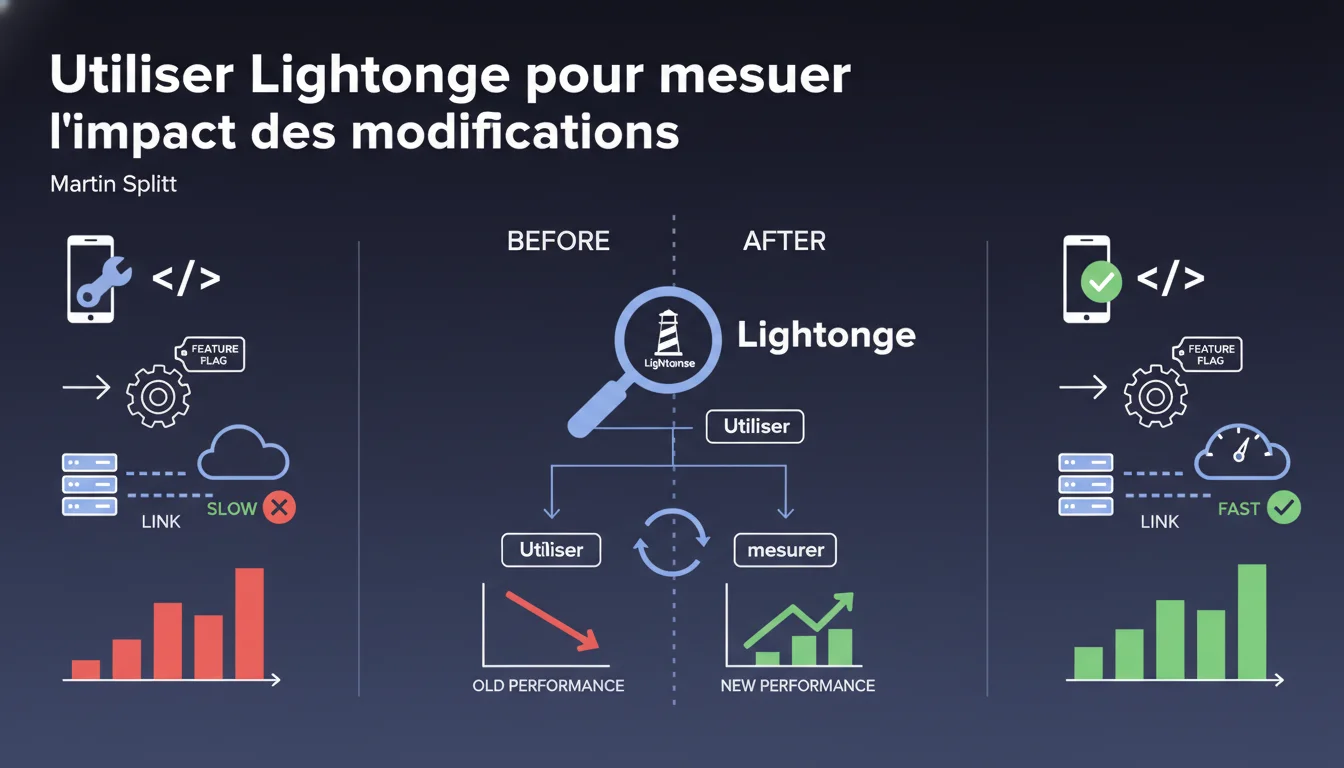

Google recommande d'utiliser Lighthouse couplé à des feature flags pour mesurer précisément l'impact performance de chaque modification avant déploiement complet. Cette approche permet de comparer objectivement les performances avant/après et d'éviter les régressions invisibles qui plombent l'expérience utilisateur. Concrètement : testez vos modifs sur un échantillon d'utilisateurs avant de généraliser.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur l'utilisation de Lighthouse dans ce contexte ?

Lighthouse reste l'outil de référence pour évaluer les Core Web Vitals et la performance globale d'une page. Martin Splitt rappelle ici que mesurer l'impact des modifications n'est pas optionnel — c'est une nécessité pour identifier les régressions avant qu'elles n'affectent l'ensemble du trafic.

Le problème ? Beaucoup de teams déploient des fonctionnalités sans baseline de comparaison. Résultat : impossible de savoir si le nouveau carrousel JavaScript a tué votre LCP ou si c'est autre chose.

Que sont les feature flags et pourquoi les combiner avec Lighthouse ?

Les feature flags (ou feature toggles) permettent d'activer/désactiver une fonctionnalité côté serveur sans redéployer le code. En SEO/performance, ça signifie : activer la nouvelle feature pour 10% du trafic, mesurer avec Lighthouse, comparer avec les 90% restants qui ont l'ancienne version.

Cette approche élimine le biais temporel (conditions réseau variables, charge serveur fluctuante) et isole précisément l'impact de la modification. Vous obtenez une mesure fiable, pas une intuition.

Quels sont les métriques clés à surveiller avec cette méthode ?

- LCP (Largest Contentful Paint) : si votre nouvelle feature charge une image lourde ou bloque le rendu, vous le verrez immédiatement

- CLS (Cumulative Layout Shift) : les modifications DOM dynamiques sont souvent responsables de shifts invisibles à l'œil nu mais catastrophiques en métriques

- INP (Interaction to Next Paint) : une nouvelle fonctionnalité JavaScript peut introduire des blocages sur le thread principal

- Performance Score global : utile pour une vue d'ensemble, mais insuffisant seul — décomposez toujours par métrique individuelle

Avis d'un expert SEO

Cette recommandation est-elle vraiment applicable en environnement de production ?

Soyons honnêtes : implémenter des feature flags requiert une infrastructure technique solide. Beaucoup de sites n'ont pas cette capacité — et c'est là que le conseil de Google devient frustrant. Dire « utilisez des feature flags » sans préciser comment, c'est comme dire « mangez équilibré » à quelqu'un qui n'a pas de cuisine.

Pour les sites sous WordPress classique ou les CMS rigides, cette approche nécessite soit un CDN avancé (Cloudflare Workers, Fastly VCL), soit un système maison non trivial. [À vérifier] : Martin Splitt ne précise pas si Google considère les tests A/B analytics (Google Optimize, VWO) comme équivalents aux feature flags serveur — la nuance est pourtant importante.

Lighthouse seul suffit-il pour mesurer l'impact réel sur le ranking ?

Non. Lighthouse mesure des données lab (conditions contrôlées), pas les données field (utilisateurs réels via CrUX). Une page peut scorer 100 en Lighthouse et avoir un CrUX catastrophique à cause de dispositifs low-end, connexions 3G, ou JavaScript qui se comporte différemment en production.

La vraie méthodologie ? Lighthouse + CrUX + RUM (Real User Monitoring). Lighthouse vous donne la baseline technique, CrUX valide sur vos vrais utilisateurs, RUM vous alerte en temps réel sur les anomalies. Ne vous fiez jamais à un seul outil — c'est la triangulation qui crée la certitude.

Dans quels cas cette approche est-elle contre-productive ?

Quand vos modifications touchent le contenu sémantique ou la structure HTML indexable. Les feature flags sont pertinents pour tester des impacts performance/UX, pas pour A/B tester deux versions de titres H1 ou de textes — ça, c'est du cloaking et Google déteste.

Autre limite : les sites à faible trafic. Si vous avez 500 visiteurs/jour, un test à 10% vous donne 50 sessions — statistiquement non significatif. Dans ce cas, mieux vaut déployer en staging complet, mesurer intensivement avec Lighthouse/PageSpeed Insights, puis surveiller CrUX post-déploiement.

Impact pratique et recommandations

Que faut-il mettre en place concrètement pour appliquer cette recommandation ?

D'abord, déterminez si vous avez la stack technique pour gérer des feature flags côté serveur. Solutions open-source comme Unleash, ou services managés comme LaunchDarkly. Si vous êtes sur Cloudflare, les Workers permettent de faire du feature flagging directement en edge.

Ensuite, intégrez Lighthouse CI dans votre pipeline de déploiement. Ça tourne automatiquement des audits Lighthouse à chaque commit/PR et vous alerte si une métrique régresse. Configuration minimale : seuil d'alerte si Performance Score chute de plus de 5 points, ou si LCP/CLS/INP dépasse les seuils « Good ».

Quelles erreurs éviter dans cette démarche ?

- Ne jamais tester uniquement en desktop — l'essentiel des régressions performance apparaît sur mobile, conditions réseau dégradées

- Ne pas confondre Lighthouse score et métriques CrUX réelles — un bon score lab ne garantit rien sur le terrain

- Éviter de tester trop de variables simultanément — isoler chaque modification pour identifier précisément les régressions

- Ne pas négliger le cache browser : mesurez aussi les performances en repeat view, pas seulement first visit

- Ne jamais déployer sans avoir défini des seuils d'acceptation clairs : « on teste » sans critères de décision ne sert à rien

Comment vérifier que votre implémentation fonctionne correctement ?

Créez un tableau de bord de suivi qui agrège Lighthouse CI + données CrUX + éventuellement RUM. L'idéal : visualiser côte à côte les métriques du groupe A (ancienne version) vs groupe B (nouvelle version) sur une période de 7-14 jours minimum.

Validez que vos feature flags ne créent pas de divergence de rendu pour Googlebot : utilisez l'outil Inspection d'URL dans Search Console pour comparer le rendu avec ce que voient vos utilisateurs réels. Si vous détectez des différences non intentionnelles, ajustez la logique de vos flags.

Cette approche exige une maturité technique non négligeable : infrastructure de feature flagging, CI/CD avec Lighthouse intégré, monitoring CrUX/RUM, et capacité à analyser des données statistiques. Pour beaucoup d'organisations, cette complexité justifie l'accompagnement d'une agence SEO spécialisée qui maîtrise ces environnements techniques et peut orchestrer l'ensemble du dispositif de mesure, vous évitant erreurs coûteuses et faux positifs.

❓ Questions frequentes

Lighthouse CI peut-il remplacer totalement les tests manuels avec Lighthouse ?

Les feature flags côté client (JavaScript) suffisent-ils pour cette approche ?

Quelle taille d'échantillon faut-il pour que les résultats soient statistiquement fiables ?

Google prend-il en compte les scores Lighthouse directement dans le ranking ?

Peut-on appliquer cette méthode pour tester l'impact SEO du lazy-loading d'images ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.