Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ L'expérience utilisateur améliore-t-elle vraiment le référencement naturel ?

- □ Les accordéons et contenus masquables pénalisent-ils encore le référencement mobile ?

- □ Faut-il vraiment ignorer les blogs SEO et ne lire que la documentation Google ?

- □ Les Core Web Vitals influencent-ils réellement le classement dans Google ?

- □ Le lazy loading est-il vraiment une optimisation SEO facile à implémenter ?

- □ Faut-il vraiment utiliser Lighthouse avec des feature flags pour mesurer l'impact SEO de vos modifications ?

- □ Le HTML sémantique est-il vraiment un critère de référencement déterminant ?

- □ Faut-il vraiment impliquer le SEO dès la phase de conception technique ?

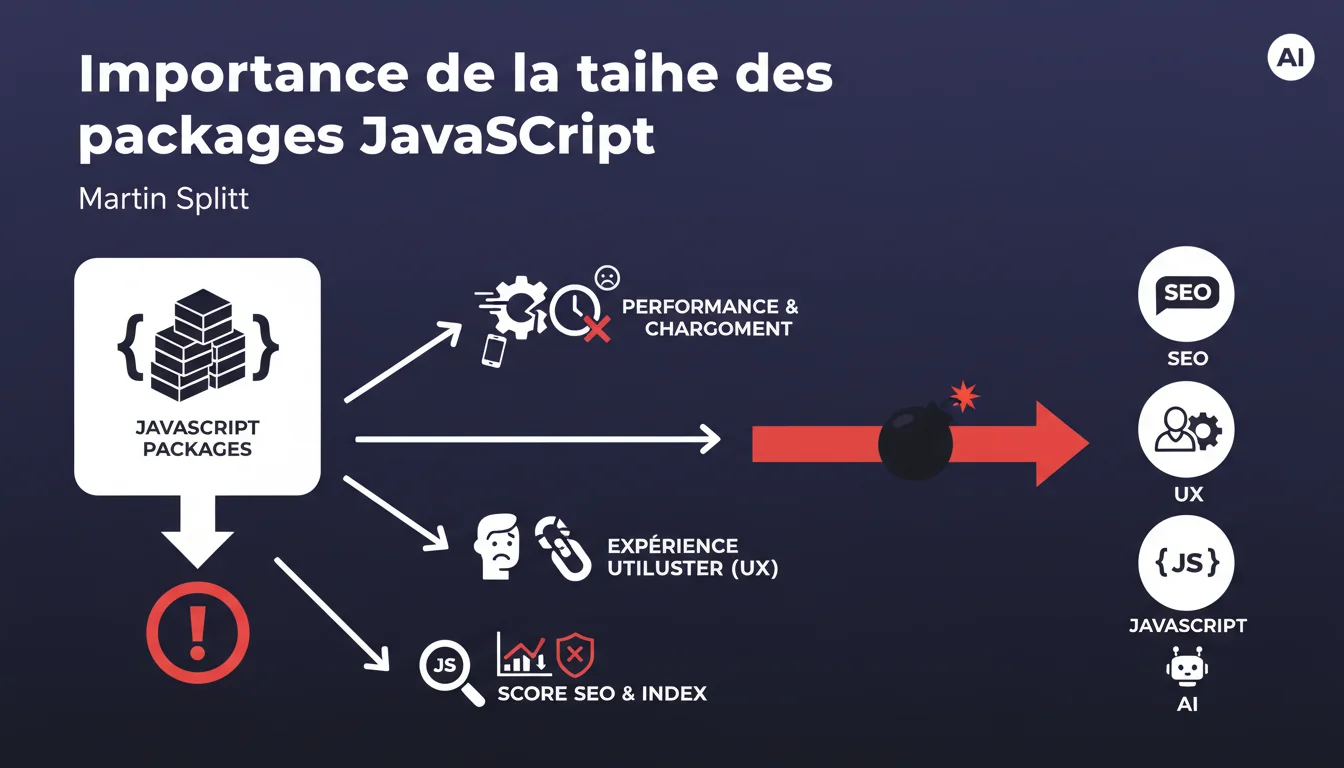

Les packages JavaScript volumineux dégradent les performances, ralentissent le chargement et détériorent l'expérience utilisateur. Google confirme que cet impact se répercute directement sur le score SEO et l'index rating. Optimiser la taille de vos scripts n'est plus optionnel.

Ce qu'il faut comprendre

Pourquoi Google s'intéresse-t-il à la taille de vos fichiers JavaScript ?

Le moteur de recherche ne se contente plus d'analyser votre contenu textuel. Il évalue désormais l'expérience utilisateur complète, et les scripts trop lourds sabotent cette expérience avant même qu'elle ne commence.

Un package JavaScript de plusieurs centaines de kilooctets retarde l'affichage, bloque le rendu, et fait exploser les métriques de performance. Les utilisateurs patientent, rebondissent, et Google enregistre tout ça.

Qu'est-ce qu'un « package JavaScript » dans ce contexte ?

On parle ici de l'ensemble des fichiers .js chargés par une page : frameworks (React, Vue), bibliothèques tierces (analytics, chat, publicité), et votre propre code applicatif. Chaque dépendance s'additionne.

Le problème ne vient pas du nombre de fichiers, mais de leur poids cumulé et de leur impact sur le temps de parsing et d'exécution. Un bundle de 500 Ko minifié reste 500 Ko que le navigateur doit télécharger, décompresser, parser et exécuter.

Comment cet impact se traduit-il concrètement en « score SEO » ?

Google reste évasif sur le terme « index rating », mais on sait que les Core Web Vitals influencent directement le classement depuis leur intégration comme signal de ranking. Un JavaScript lourd dégrade LCP, FID et CLS.

Les pages qui échouent sur ces métriques subissent une pénalité relative : elles ne disparaissent pas, mais perdent du terrain face à des concurrents plus rapides sur des requêtes compétitives.

- Performance : Le temps de chargement augmente proportionnellement à la taille des scripts

- Core Web Vitals : LCP et FID sont les premières victimes des bundles trop lourds

- Expérience utilisateur : Un site lent génère plus de rebonds, ce qui envoie un signal négatif à Google

- Index rating : Terme flou de Google, probablement lié à la qualité globale de la page dans l'index

- Impact SEO cumulatif : La dégradation technique se traduit par une perte de visibilité progressive

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même un euphémisme. Les audits SEO révèlent systématiquement que les sites les plus lents sont aussi ceux qui embarquent le plus de JavaScript non optimisé. La corrélation entre bundles volumineux et chute de trafic organique est documentée.

Par contre, Google reste vague sur l'« index rating ». Ce terme n'apparaît nulle part ailleurs dans la documentation officielle. [À vérifier] s'il s'agit d'un score interne ou d'une simplification de Splitt pour désigner la qualité globale d'une URL dans l'index.

Quelles nuances faut-il apporter à cette affirmation ?

Tous les kilooctets de JavaScript ne se valent pas. Un script chargé en defer ou async qui s'exécute après le rendu initial impacte moins les Core Web Vitals qu'un bundle bloquant dans le <head>.

De même, un site avec 300 Ko de JS mais un cache navigateur agressif et une compression Brotli performera mieux qu'un concurrent à 150 Ko mal configuré. Le poids brut n'est qu'un indicateur parmi d'autres.

Dans quels cas cette règle s'applique-t-elle différemment ?

Les applications web monopage (SPA) embarquent naturellement plus de JavaScript qu'un site statique. Google les pénalise-t-il systématiquement ? Non, mais elles doivent compenser par du Server-Side Rendering ou du pré-rendu pour maintenir des performances acceptables.

Les sites à fort engagement (outils SaaS, plateformes interactives) peuvent se permettre un JS plus lourd si l'expérience justifie le temps de chargement initial. Encore faut-il que les utilisateurs ne rebondissent pas avant la fin du parsing.

Impact pratique et recommandations

Que faut-il faire concrètement pour alléger vos packages JavaScript ?

Commencez par un audit de poids avec Lighthouse ou WebPageTest. Identifiez les scripts qui pèsent le plus et leur utilité réelle. Beaucoup de sites chargent des bibliothèques entières pour utiliser une seule fonction.

Ensuite, passez au code splitting : ne chargez que le JS nécessaire à la page en cours, pas l'intégralité de votre application. Les frameworks modernes (Next.js, Nuxt) gèrent ça nativement si vous les configurez correctement.

Enfin, activez la compression Brotli côté serveur et vérifiez que vos bundles sont bien minifiés et tree-shaked. Un gain de 40-50 % sur le poids final est courant avec ces optimisations.

Quelles erreurs éviter lors de l'optimisation JavaScript ?

Ne supprimez pas aveuglément des scripts sans tester l'impact fonctionnel. Un tag analytics mal configuré après optimisation, c'est pire qu'un JS un peu lourd mais fonctionnel.

Évitez aussi de charger des polyfills pour des navigateurs que vos utilisateurs n'utilisent plus. En 2025, cibler IE11 n'a plus de sens pour 99 % des sites, mais beaucoup gardent ces dépendances par habitude.

- Auditer le poids total des scripts avec Lighthouse, WebPageTest ou Coverage DevTools

- Identifier et supprimer les dépendances inutilisées ou redondantes

- Implémenter le code splitting pour charger le JS par route ou par fonctionnalité

- Minifier et compresser (Gzip ou Brotli) tous les fichiers JavaScript

- Passer les scripts non critiques en defer ou async

- Utiliser un CDN avec cache agressif pour les bibliothèques tierces

- Surveiller les Core Web Vitals en production pour valider l'impact des optimisations

- Mettre en place un budget de performance pour éviter la régression

Comment vérifier que vos optimisations portent leurs fruits ?

Surveillez vos Core Web Vitals dans la Search Console. Si vos URLs passent de « Mauvais » à « Bon », l'optimisation fonctionne. Comparez aussi vos positions organiques avant/après sur des requêtes compétitives.

Attention au délai : Google met parfois plusieurs semaines à réévaluer vos performances après une optimisation. Ne paniquez pas si vous ne voyez rien bouger immédiatement.

❓ Questions frequentes

Quelle taille de JavaScript est considérée comme « trop volumineuse » par Google ?

Les scripts chargés en async ou defer sont-ils moins pénalisants ?

Un site SPA (React, Vue) est-il automatiquement pénalisé par Google ?

Faut-il supprimer tous les scripts tiers pour améliorer son SEO ?

Les outils de build modernes suffisent-ils à optimiser automatiquement le JavaScript ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.