Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Comment exploiter Google Search Console pour détecter vos pages à fort potentiel inexploité ?

- □ Comment identifier vos pages qui gaspillent leur potentiel de trafic dans Search Console ?

- □ Faut-il vraiment reformuler son contenu en fonction des requêtes des utilisateurs ?

- □ Comment mesurer efficacement l'impact réel de vos optimisations SEO dans Search Console ?

- □ Comment identifier les opportunités de contenu à fort potentiel grâce à la demande croissante ?

- □ La Search Console peut-elle vraiment orienter votre stratégie SEO ?

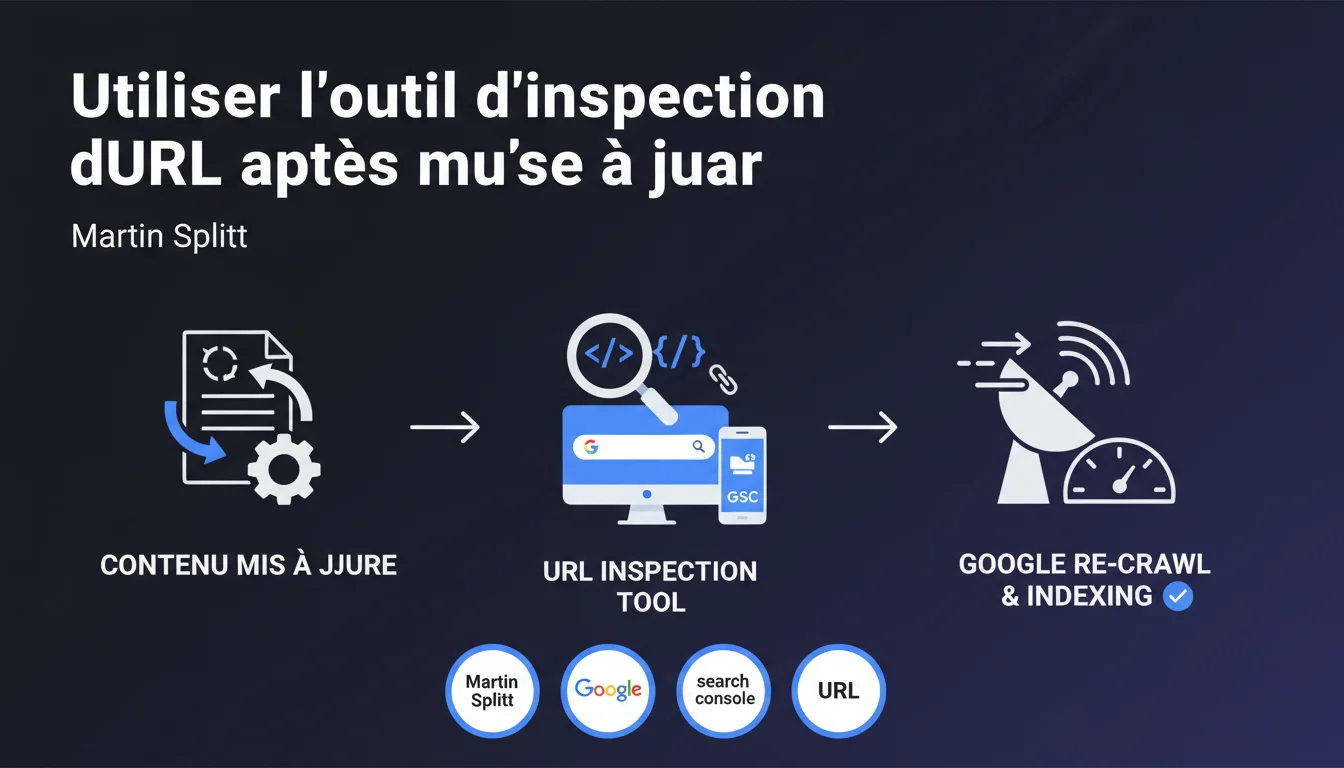

Google recommande d'utiliser l'outil d'inspection d'URL de Search Console pour demander une nouvelle analyse après publication d'un contenu mis à jour. Cette pratique vise à accélérer la prise en compte des modifications par le moteur de recherche. Reste à savoir si cette démarche est systématiquement nécessaire ou si elle relève du cargo cult SEO.

Ce qu'il faut comprendre

Pourquoi Google pousse-t-il l'outil d'inspection d'URL ?

L'outil d'inspection d'URL permet de soumettre manuellement une page à Googlebot pour une nouvelle analyse. Concrètement, cela envoie un signal à Google : « Hé, cette page a changé, viens voir. »

Sans cette action, Google découvrira les modifications lors de son prochain passage naturel sur la page — ce qui peut prendre quelques heures, quelques jours ou parfois plusieurs semaines selon la fréquence de crawl de votre site.

Cette déclaration s'applique-t-elle à tous les types de modifications ?

Martin Splitt parle de « contenu mis à jour », mais reste volontairement vague. S'agit-il d'une refonte complète d'un article ? D'une simple correction orthographique ? D'un ajout de paragraphe ?

La logique voudrait que l'outil soit réservé aux modifications substantielles : nouveau contenu éditorial, changements structurels, ajouts de sections importantes. Pas pour chaque virgule déplacée.

Quelle est la différence entre demander une indexation et attendre le crawl naturel ?

La demande via l'outil d'inspection d'URL accélère le processus, mais ne garantit rien. Google reste maître de décider s'il indexe ou non la version mise à jour.

Le crawl naturel, lui, dépend de la popularité de la page, de sa fréquence de mise à jour historique et du crawl budget alloué au site. Sur un site dynamique avec une bonne autorité, la différence peut être minime.

- L'outil d'inspection d'URL ne crée pas de priorité absolue — il suggère à Google de repasser

- Google peut toujours choisir de ne pas indexer la nouvelle version si elle n'apporte rien

- Sur un site avec un crawl budget serré, cette demande peut être stratégique

- L'outil a des quotas de soumission — impossible de l'utiliser à l'échelle industrielle

Avis d'un expert SEO

Cette recommandation est-elle alignée avec les pratiques terrain ?

Dans la réalité, beaucoup de sites bien crawlés voient leurs mises à jour indexées en quelques heures sans aucune intervention manuelle. Les pages stratégiques avec un bon historique de fraîcheur n'ont souvent pas besoin de ce coup de pouce.

À l'inverse, sur des sites à faible autorité ou avec des milliers de pages, chaque demande d'inspection peut faire gagner du temps. Le problème ? Les quotas de Search Console limitent drastiquement le nombre de demandes quotidiennes. [À vérifier] : Google ne communique pas officiellement sur ces quotas, mais les retours terrain évoquent entre 10 et 20 URLs par jour selon les sites.

Quels sont les risques de surutiliser cet outil ?

Premier écueil : croire que chaque petite modification mérite une demande d'indexation. C'est du temps perdu et ça dilue l'efficacité de l'outil sur les vraies priorités.

Second piège — et c'est là que ça coince : si vous soumettez massivement des pages de faible qualité ou avec peu de changements substantiels, vous risquez de polluer les signaux envoyés à Google. Le moteur pourrait finir par ignorer vos demandes futures.

Dans quels cas cette pratique devient-elle contre-productive ?

Sur un site d'actualité avec plusieurs dizaines de publications par jour, impossible de tout soumettre manuellement. Le jeu n'en vaut pas la chandelle.

De même, pour des ajustements mineurs (correction typo, ajout d'un lien interne secondaire), attendre le crawl naturel reste la meilleure option. Soyons honnêtes : Google finira par repasser de toute façon.

Impact pratique et recommandations

Quand faut-il vraiment utiliser l'outil d'inspection d'URL ?

Réservez cet outil aux modifications stratégiques : refonte complète d'un article clé, ajout d'un chapitre substantiel, correction d'informations obsolètes sur une page à fort trafic.

Si votre contenu mis à jour vise à reprendre une position perdue ou à exploiter une actualité, la demande d'indexation devient pertinente. Dans tous les autres cas, le crawl naturel suffira.

Comment optimiser l'efficacité de vos demandes de réindexation ?

Première règle : ne soumettez que des pages dont la mise à jour apporte une valeur réelle. Google ne réagit pas mieux à une demande si le contenu reste faible.

Ensuite, assurez-vous que la page est accessible, rapide et correctement balisée. Une demande d'indexation sur une page avec des erreurs techniques sera ignorée ou rejetée.

- Vérifiez que la page n'est pas bloquée par le robots.txt ou une balise noindex

- Testez la vitesse de chargement — une page lente pénalise l'indexation

- Consultez le rendu HTML via l'outil d'inspection pour détecter d'éventuels problèmes JavaScript

- Privilégiez les pages à fort impact SEO (trafic, conversions, positions stratégiques)

- Gardez une trace des URLs soumises pour éviter les doublons inutiles

Faut-il systématiser cette démarche dans un processus éditorial ?

Pour un blog ou un site média, intégrer cette étape dans le workflow de publication peut avoir du sens — à condition de rester sélectif. Tous les articles ne méritent pas ce traitement.

Sur des sites e-commerce avec des milliers de fiches produits, mieux vaut optimiser le maillage interne et la fraîcheur du sitemap XML plutôt que de tenter des soumissions manuelles à grande échelle.

❓ Questions frequentes

Combien de demandes d'indexation peut-on soumettre par jour ?

Une demande d'indexation garantit-elle que la page sera effectivement indexée ?

Faut-il demander une réindexation après chaque modification mineure ?

L'outil d'inspection d'URL remplace-t-il le sitemap XML ?

Peut-on soumettre plusieurs versions d'une même URL si elle continue d'évoluer ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 02/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.