Declaration officielle

Ce qu'il faut comprendre

Quel est le contexte de cette déclaration de Google ?

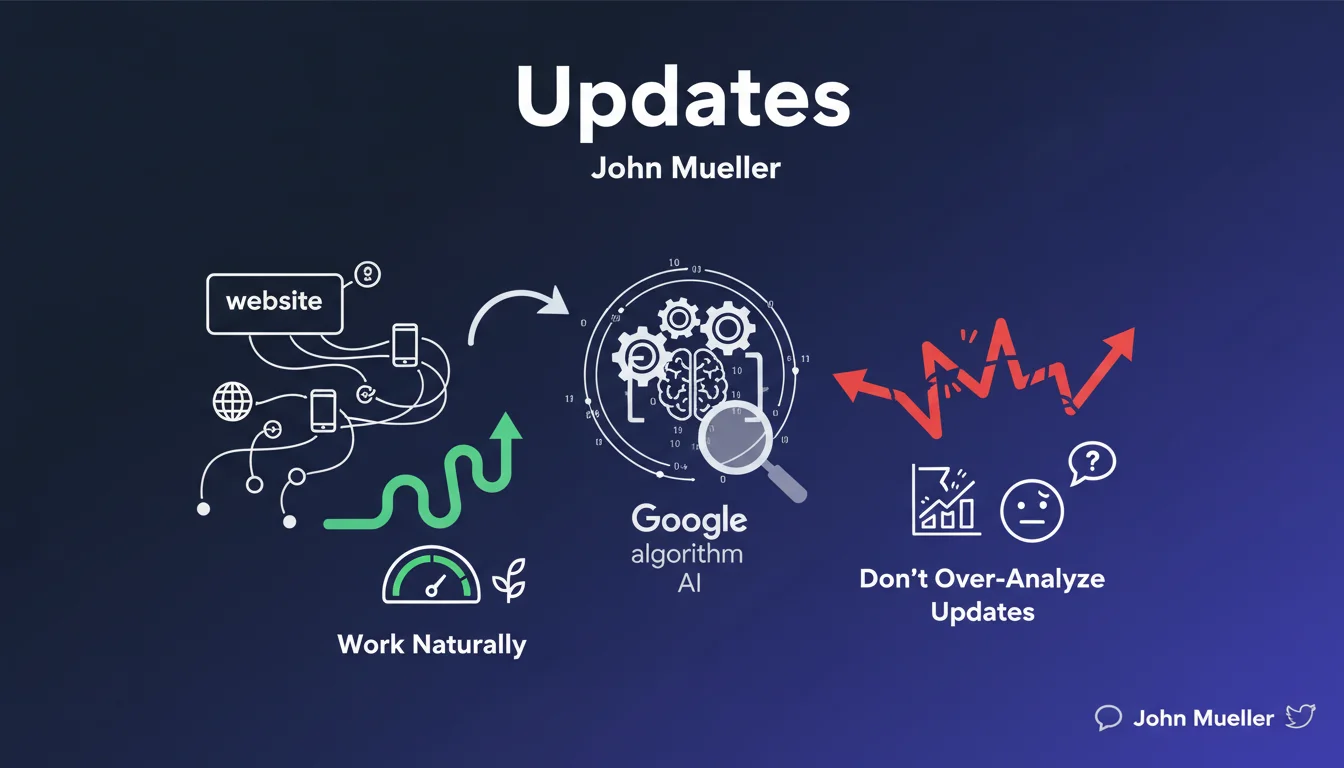

John Mueller a répondu à une question d'un internaute concernant l'algorithme LSTM sur Twitter. Sa recommandation est claire : travailler sur son site web de manière "naturelle" sans chercher constamment à décrypter les moindres évolutions algorithmiques de Google.

Cette position s'inscrit dans la communication habituelle de Google qui encourage les webmasters à se concentrer sur la qualité du contenu et l'expérience utilisateur plutôt que sur l'optimisation technique pure.

Que signifie concrètement travailler "naturellement" pour Google ?

Pour Google, une approche "naturelle" signifie créer du contenu pour les utilisateurs avant tout. Cela implique de répondre aux questions des visiteurs, d'offrir une navigation fluide et de publier des informations pertinentes et à jour.

L'idée sous-jacente est de ne pas sur-optimiser ou manipuler artificiellement les signaux de classement. Google préfère que les sites se développent organiquement en fonction des besoins réels des utilisateurs.

Pourquoi Google encourage-t-il cette approche plutôt que la compréhension technique ?

Les algorithmes de Google sont devenus extrêmement complexes avec l'intégration du machine learning et de l'intelligence artificielle. Des centaines de facteurs de classement interagissent de manière dynamique et contextuelle.

Cette complexité rend le reverse engineering quasi impossible. Google souhaite également éviter que les SEO se concentrent sur l'exploitation de failles algorithmiques au détriment de la qualité réelle.

- La complexité algorithmique a augmenté exponentiellement avec l'IA

- Le reverse engineering des mises à jour est devenu inefficace

- Google privilégie une approche centrée utilisateur plutôt que technique

- Les signaux de classement varient selon le contexte et la requête

Avis d'un expert SEO

Cette recommandation de Google est-elle vraiment applicable en pratique ?

La position de John Mueller est partiellement idéaliste. Certes, la complexité algorithmique rend difficile la compréhension exhaustive du fonctionnement de Google. Mais ignorer totalement les mécanismes SEO reviendrait à naviguer à l'aveugle.

Dans la réalité, un équilibre intelligent est nécessaire. Les praticiens SEO doivent comprendre les principes fondamentaux (indexation, crawl, structure technique) tout en évitant l'obsession de chaque micro-signal algorithmique.

Quelles sont les limites de l'approche "naturelle" préconisée ?

L'approche naturelle fonctionne bien pour le contenu éditorial et l'expérience utilisateur. Mais elle ne couvre pas les aspects techniques fondamentaux : structure des URL, données structurées, vitesse de chargement, architecture de l'information.

Sans compréhension SEO minimale, un site peut avoir un excellent contenu mais rester invisible. Les bases techniques ne sont pas intuitives et nécessitent une expertise spécifique qui ne vient pas "naturellement".

Dans quels cas l'analyse algorithmique reste-t-elle pertinente ?

L'analyse des tendances algorithmiques générales reste précieuse. Observer les effets des Core Updates, comprendre l'évolution vers l'E-E-A-T ou l'importance croissante des Core Web Vitals permet d'anticiper les priorités de Google.

La différence est de chercher des principes directeurs plutôt que des formules magiques. Les patterns observés sur des milliers de sites après une mise à jour révèlent des orientations stratégiques exploitables, contrairement au reverse engineering de signaux individuels.

Impact pratique et recommandations

Comment appliquer concrètement cette approche équilibrée ?

La stratégie optimale consiste à maîtriser les fondamentaux SEO sans tomber dans l'obsession algorithmique. Établissez une base technique solide puis concentrez-vous sur la création de valeur réelle pour vos visiteurs.

Investissez dans la compréhension de votre audience : quelles questions se posent-ils ? Quels problèmes cherchent-ils à résoudre ? Cette approche centrée utilisateur s'aligne naturellement avec les objectifs de Google.

Quelles erreurs faut-il absolument éviter ?

L'erreur principale serait de négliger totalement les aspects techniques sous prétexte de "naturel". Un site mal structuré, lent ou non crawlable restera invisible même avec du contenu exceptionnel.

À l'inverse, évitez de sur-optimiser chaque détail en fonction de suppositions algorithmiques. Cette approche est chronophage, souvent inefficace et peut créer du contenu artificiel qui dégrade l'expérience utilisateur.

Quelle stratégie adopter pour un SEO durable et efficace ?

Construisez votre stratégie sur des fondations techniques robustes puis laissez le contenu se développer naturellement selon les besoins de votre audience. Cette double approche maximise vos chances de succès à long terme.

Auditez régulièrement vos performances techniques tout en évaluant la pertinence et l'engagement de vos contenus. Les données Analytics et Search Console vous guideront mieux que les hypothèses algorithmiques.

- Établir une base technique solide : crawlabilité, indexation, vitesse, mobile-first

- Implémenter les données structurées pertinentes pour votre secteur

- Créer du contenu répondant aux intentions de recherche réelles de votre audience

- Optimiser l'expérience utilisateur : navigation intuitive, design responsive, temps de chargement

- Analyser les métriques d'engagement plutôt que chercher des signaux algorithmiques

- Suivre les Core Updates pour identifier les tendances générales, pas les détails

- Prioriser la qualité et l'expertise (E-E-A-T) dans vos contenus

- Éviter la sur-optimisation et les tentatives de manipulation algorithmique

💬 Commentaires (0)

Soyez le premier à commenter.