Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que le filtre Panda et pourquoi cette contradiction pose problème ?

Google Panda est un filtre algorithmique lancé en 2011 pour pénaliser les sites à faible qualité de contenu. Il cible notamment les contenus dupliqués, superficiels ou sans valeur ajoutée.

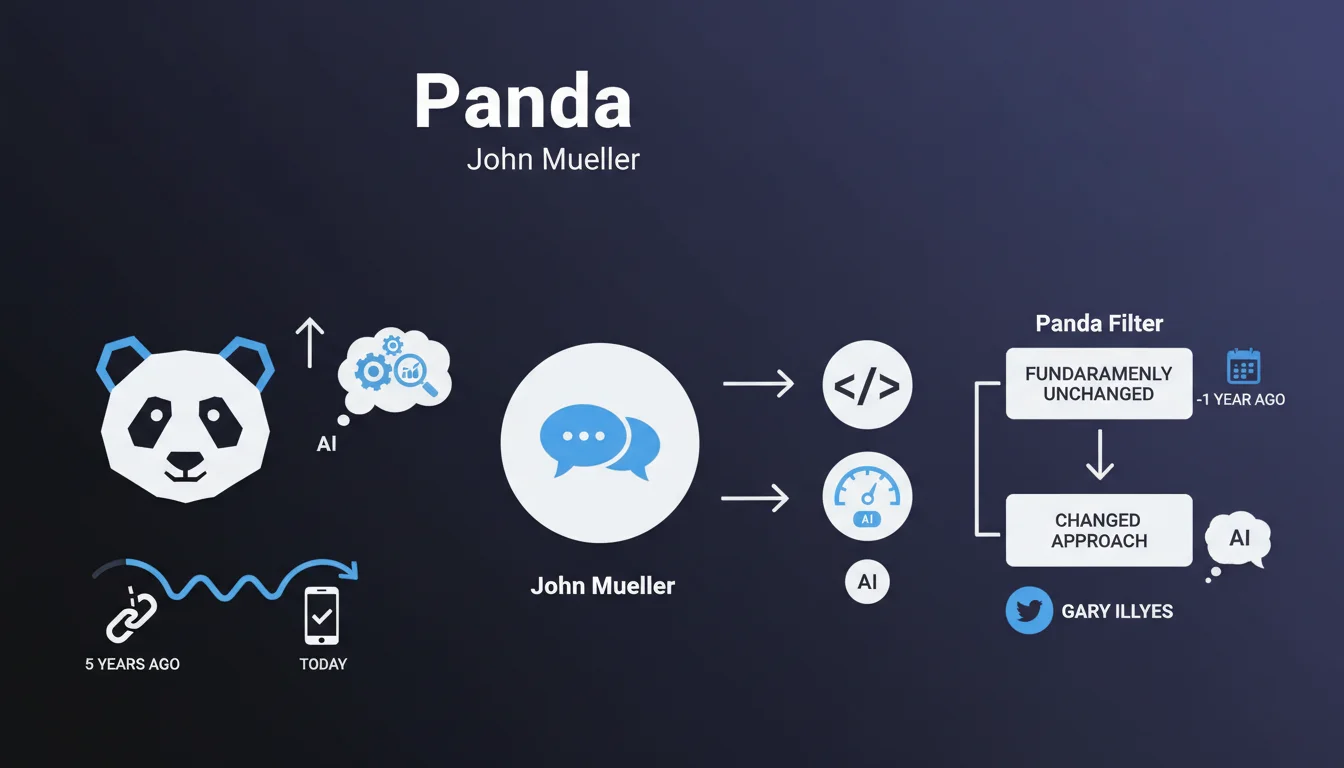

La contradiction entre les déclarations de Gary Illyes (qui affirme que Panda a évolué) et John Mueller (qui affirmait un an avant que rien n'avait fondamentalement changé) crée une confusion importante pour les praticiens SEO. Cette incohérence rend difficile l'élaboration de stratégies fiables.

Comment Google a-t-il intégré Panda dans son algorithme principal ?

Depuis 2016, Panda n'est plus un filtre séparé mais fait partie intégrante de l'algorithme principal de Google. Cela signifie que ses mises à jour sont continues et non plus ponctuelles.

Cette intégration rend les fluctuations moins visibles mais potentiellement plus fréquentes. Les sites peuvent être impactés à tout moment sans annonce officielle préalable.

Pourquoi les communications de Google sont-elles devenues moins fiables ?

Les déclarations contradictoires des porte-paroles de Google reflètent soit une évolution réelle mais mal communiquée, soit une volonté de maintenir le flou sur le fonctionnement exact des algorithmes.

Pour les professionnels SEO, cela impose de ne plus se fier uniquement aux déclarations officielles mais de privilégier l'observation des résultats réels et les tests empiriques.

- Panda est intégré dans l'algorithme principal depuis 2016

- Les mises à jour sont désormais continues et silencieuses

- Les déclarations officielles peuvent être contradictoires ou obsolètes

- La qualité du contenu reste le critère fondamental visé par Panda

- Les impacts sont moins brutaux mais potentiellement plus fréquents

Avis d'un expert SEO

Ces contradictions reflètent-elles un changement réel ou une simple confusion ?

Après 15 ans d'observation, je constate que ces contradictions révèlent surtout une évolution réelle mais progressive de Panda. Google a probablement affiné ses critères de qualité sans bouleverser la logique fondamentale du filtre.

La déclaration de Gary Illyes suggère que les seuils et signaux utilisés par Panda ont évolué, notamment avec l'intégration du machine learning et de critères plus nuancés. Mais le principe reste identique : identifier et dévaloriser les contenus de faible qualité.

Peut-on encore baser sa stratégie SEO sur les déclarations officielles de Google ?

Ma recommandation est claire : non, pas exclusivement. Les déclarations de Google doivent être considérées comme des orientations générales, pas comme des vérités absolues.

Les praticiens SEO doivent privilégier une approche empirique basée sur les tests, les données analytics et l'observation des SERPs. Les contradictions entre porte-paroles Google montrent qu'ils ne maîtrisent pas tous les détails ou choisissent de rester volontairement flous.

Quels signaux Panda surveille-t-il réellement aujourd'hui ?

Bien que Google reste discret, les observations montrent que Panda moderne évalue probablement : la profondeur du contenu, le temps d'engagement, le taux de rebond, la fraîcheur des informations, et la couverture exhaustive des sujets traités.

L'algorithme a également intégré des signaux liés à l'expertise et l'autorité (prémices de E-E-A-T), rendant le filtre plus sophistiqué qu'à ses débuts. Les critères purement quantitatifs (longueur, densité) ont laissé place à des analyses sémantiques et comportementales.

Impact pratique et recommandations

Que faut-il concrètement optimiser pour être protégé de Panda ?

La priorité absolue reste la qualité intrinsèque du contenu. Chaque page doit apporter une véritable valeur ajoutée, répondre complètement à l'intention de recherche et offrir une expérience utilisateur optimale.

Concentrez-vous sur la création de contenus originaux, approfondis et expertisés. Éliminez systématiquement les pages faibles : contenu dupliqué, pages trop courtes sans valeur, catégories vides ou générées automatiquement.

Comment auditer son site pour détecter les contenus à risque Panda ?

Utilisez Google Analytics pour identifier les pages avec un fort taux de rebond et un faible temps de lecture. Ces métriques indiquent souvent un contenu qui ne répond pas aux attentes.

Analysez également vos pages avec peu de trafic organique persistant malgré un bon positionnement. Cela peut signaler un problème de qualité perçue par Google. Effectuez des tests utilisateurs pour valider la pertinence réelle de vos contenus.

Quelles erreurs critiques éviter absolument ?

Ne cherchez pas à manipuler la longueur artificiellement en ajoutant du contenu inutile. Panda détecte le remplissage et la dilution d'information. Privilégiez toujours la concision et la pertinence.

Évitez la sur-optimisation sémantique : bourrer vos textes de synonymes et mots-clés associés sans logique naturelle est contre-productif. Google analyse désormais la cohérence sémantique globale.

- Réaliser un audit de contenu complet tous les 6 mois minimum

- Identifier et supprimer ou améliorer les pages à faible performance

- Créer uniquement du contenu avec une valeur ajoutée claire

- Mesurer l'engagement utilisateur (temps sur page, taux de rebond, profondeur)

- Privilégier la profondeur et l'expertise plutôt que le volume

- Éliminer tout contenu dupliqué ou très similaire entre pages

- Mettre à jour régulièrement les contenus obsolètes

- Structurer l'information de manière claire et hiérarchisée

- Solliciter des retours utilisateurs sur l'utilité réelle du contenu

💬 Commentaires (0)

Soyez le premier à commenter.