Declaration officielle

Ce qu'il faut comprendre

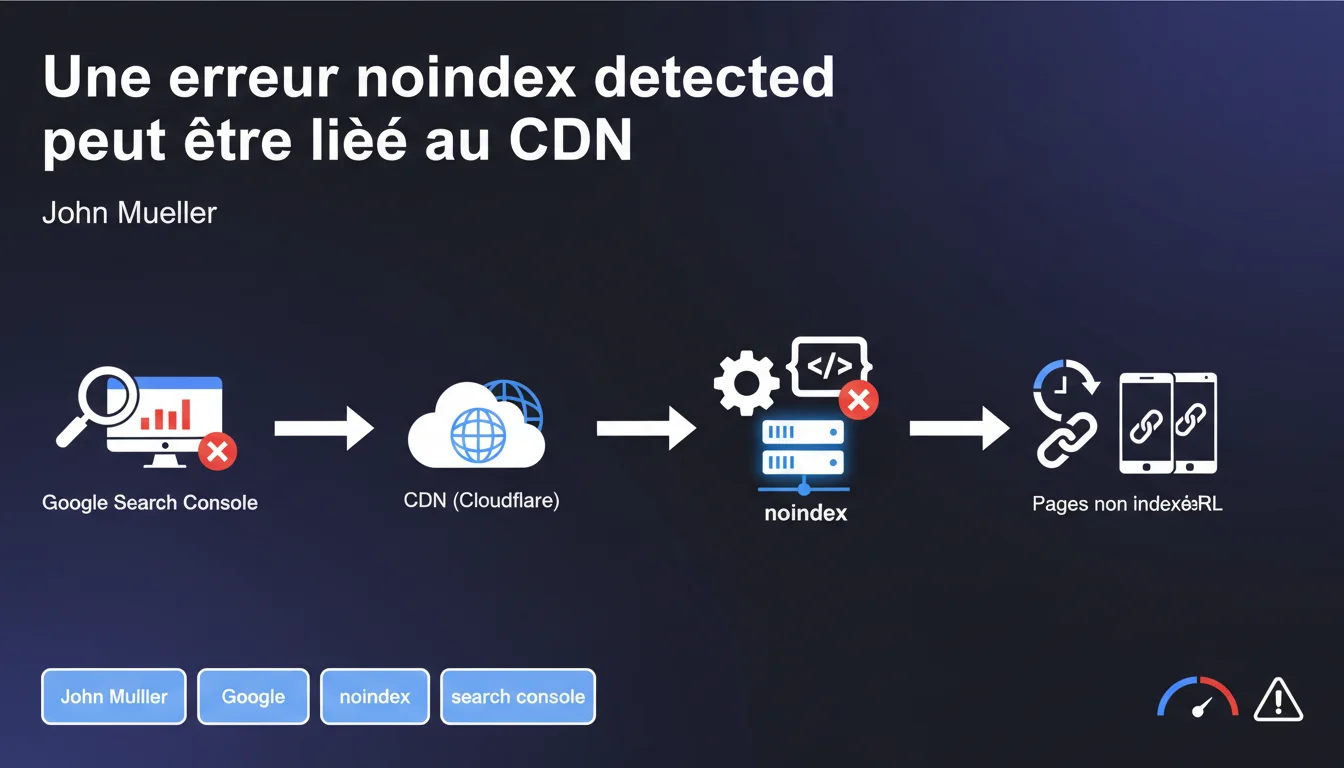

La Google Search Console signale parfois des erreurs « noindex detected in X-Robots-Tag HTTP header » sur des pages qui ne contiennent pourtant aucune directive de ce type dans leur code source. Ce phénomène déconcertant peut avoir des conséquences graves sur l'indexation de vos contenus.

John Mueller, de chez Google, a identifié deux causes principales à ce problème : les réseaux de diffusion de contenu (CDN) comme Cloudflare, et les URLs très anciennes encore présentes dans l'index. Le CDN, qui sert d'intermédiaire entre votre serveur et les visiteurs, peut injecter des en-têtes HTTP supplémentaires que vous n'avez pas configurés.

Cette situation est particulièrement problématique car elle échappe au contrôle direct du webmaster. Les directives d'indexation ajoutées par le CDN prennent le dessus sur vos intentions réelles.

- Le problème se manifeste dans la Search Console par des erreurs noindex sur des pages censées être indexables

- Le CDN peut injecter des en-têtes X-Robots-Tag sans que vous en ayez conscience

- Les anciennes URLs conservées dans l'index de Google peuvent également présenter ce symptôme

- L'erreur n'est pas visible dans le code HTML source mais uniquement dans les en-têtes HTTP

Avis d'un expert SEO

Cette observation de Mueller est totalement cohérente avec ce que nous constatons régulièrement sur le terrain. Les CDN comme Cloudflare disposent de règles de cache et de sécurité qui peuvent interférer avec les directives d'indexation, notamment via leurs Page Rules ou leurs paramètres de sécurité avancés.

Il est particulièrement important de noter que certaines configurations de sécurité CDN peuvent déclencher automatiquement des directives noindex pour des pages considérées comme sensibles ou suspectes. Les règles de pare-feu applicatif (WAF) et les protections contre le scraping peuvent également générer ce type d'en-têtes pour certains bots, y compris parfois Googlebot.

La mention des anciennes URLs par Mueller mérite également réflexion. Google conserve parfois dans son index des versions historiques d'URLs qui avaient des directives noindex, même après leur suppression. Ce phénomène peut persister plusieurs semaines, voire mois.

Impact pratique et recommandations

- Inspectez les en-têtes HTTP réels de vos pages en utilisant curl ou l'onglet Network des outils de développement, pas uniquement le code HTML

- Vérifiez votre configuration CDN (Cloudflare, Fastly, Akamai, etc.) : examinez toutes les Page Rules, règles WAF et paramètres de sécurité qui pourraient injecter des en-têtes

- Testez avec différents user-agents : vérifiez si Googlebot reçoit les mêmes en-têtes que les navigateurs classiques

- Utilisez l'outil d'inspection d'URL de la Search Console pour voir exactement ce que Google reçoit lors du crawl

- Désactivez temporairement votre CDN en mode test pour identifier si le problème vient effectivement de cette couche

- Supprimez et redemandez l'indexation des anciennes URLs problématiques via la Search Console pour forcer un recrawl complet

- Documentez votre configuration CDN : créez un registre de toutes les règles actives impactant les en-têtes HTTP

- Configurez des alertes Search Console pour être notifié immédiatement en cas de nouvelles erreurs noindex détectées

Les erreurs noindex liées aux CDN représentent un problème technique complexe qui nécessite une compréhension approfondie de l'architecture web, des en-têtes HTTP et des configurations CDN avancées. Cette problématique illustre parfaitement la complexité croissante du SEO technique moderne.

La résolution de ces dysfonctionnements demande une expertise multidisciplinaire combinant SEO, développement web et infrastructure réseau. Si vous rencontrez ce type d'erreurs persistantes ou si vous souhaitez mettre en place une surveillance proactive de votre architecture technique, l'accompagnement par une agence SEO spécialisée peut s'avérer précieux pour diagnostiquer rapidement ces problèmes invisibles et garantir l'indexabilité optimale de vos contenus stratégiques.

💬 Commentaires (0)

Soyez le premier à commenter.