Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- 0:38 Comment Google Search Console peut-il réellement booster votre trafic organique ?

- 0:56 Search Console et Analytics : deux outils pour quelles données SEO distinctes ?

- 2:05 Combien de temps vos données Search Console restent-elles vraiment accessibles ?

- 2:05 Faut-il vraiment aligner les requêtes Search Console avec vos mots-clés cibles ?

- 2:05 Pourquoi Google recommande-t-il de séparer l'analyse de la recherche d'images et de la recherche web ?

- 6:00 Comment vérifier que vos pages sont réellement indexées par Google ?

- 8:54 Les rich results augmentent-ils vraiment la visibilité dans les résultats de recherche ?

- 8:54 L'expérience de page joue-t-elle vraiment un rôle déterminant dans le classement Google ?

- 9:20 Pourquoi Google recommande-t-il de vérifier le rapport de couverture d'index en priorité ?

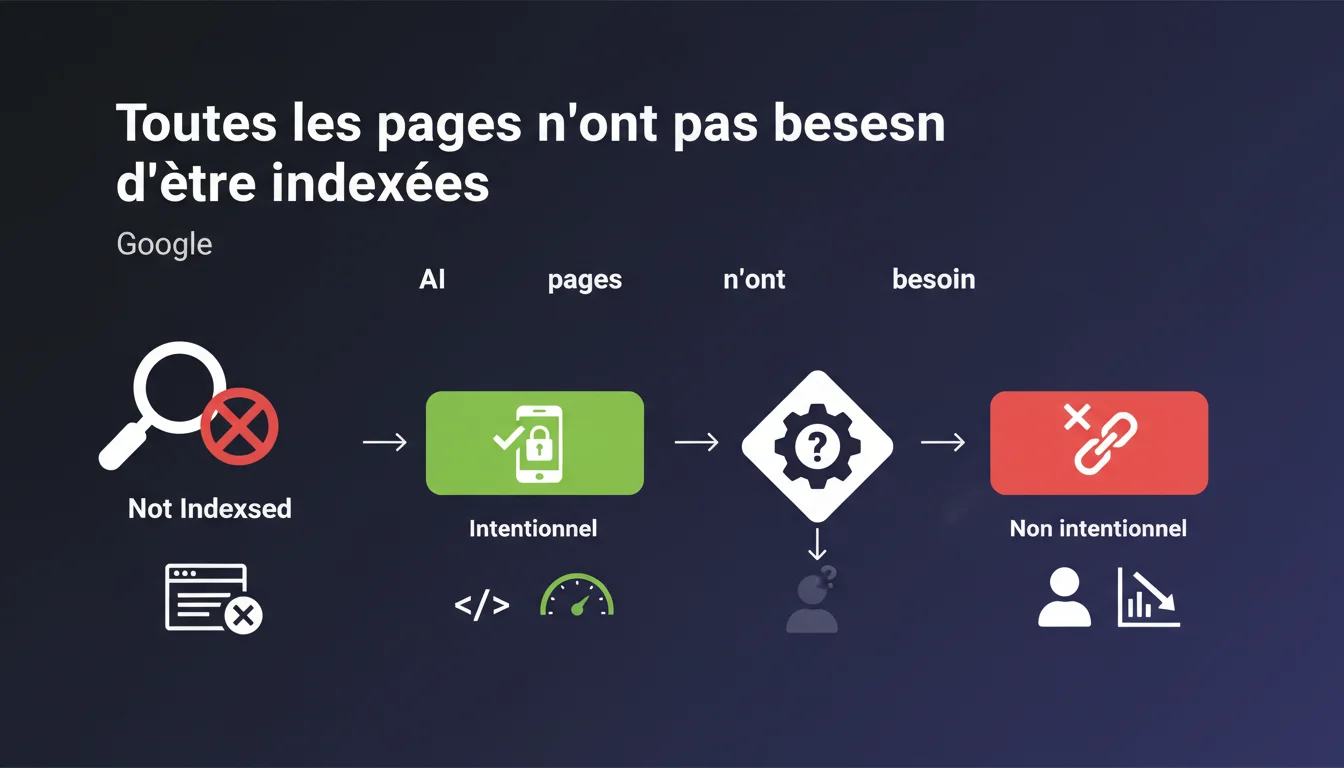

Google rappelle que toutes les pages n'ont pas vocation à être indexées, mais insiste sur un point : les gestionnaires de sites doivent maîtriser leur statut d'indexation. L'enjeu n'est pas d'indexer à tout prix, mais de savoir précisément quelles pages sont indexées ou non, et pourquoi. Un contrôle conscient plutôt qu'un laisser-aller.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur le fait que toutes les pages n'ont pas besoin d'être indexées ?

Google gère des milliards de pages. Chaque URL crawlée et indexée consomme des ressources — pour le moteur, mais aussi pour votre crawl budget. Indexer des pages à faible valeur ajoutée (facettes de filtres, pages de résultats de recherche interne, contenus dupliqués) dilue la pertinence globale de votre site.

Le message est clair : l'indexation sélective n'est pas un problème, c'est une stratégie. Mais elle doit être maîtrisée, pas subie.

Qu'est-ce qu'un état non indexé intentionnel versus accidentel ?

Un état non indexé intentionnel, c'est quand vous bloquez volontairement une page via robots.txt, noindex, canonical vers une autre URL, ou authentification. Vous contrôlez.

Un état non indexé accidentel, c'est quand Google décide seul de ne pas indexer une page — souvent via la mention "Découverte, actuellement non indexée" ou "Explorée, actuellement non indexée" dans la Search Console. Là, c'est flou : est-ce un problème de qualité, de crawl budget, de duplication ? Google ne le dit pas toujours clairement.

Quels sont les risques d'une indexation non maîtrisée ?

Si vous ne savez pas quelles pages sont indexées, vous perdez le contrôle de votre stratégie SEO. Des pages stratégiques peuvent rester invisibles pendant des mois. Des pages inutiles peuvent polluer l'index et consommer du crawl budget au détriment de vos contenus prioritaires.

Pire : vous ne pouvez pas optimiser ce que vous ne surveillez pas. Un audit régulier de l'indexation devient indispensable.

- Toutes les pages n'ont pas besoin d'être indexées — c'est une réalité technique et stratégique.

- L'enjeu principal : savoir quelles pages sont indexées et pourquoi.

- Un état non indexé peut être intentionnel (contrôlé par vous) ou accidentel (décision opaque de Google).

- La maîtrise de l'indexation passe par un monitoring régulier via la Search Console et des outils tiers.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, mais avec une nuance de taille : Google simplifie. Dans la pratique, la frontière entre "non indexé intentionnel" et "non indexé accidentel" est parfois floue. La Search Console classe certaines pages en "Découverte, actuellement non indexée" sans explication claire. [A vérifier] : est-ce un problème de qualité, de crawl budget, de contenu dupliqué, ou simplement une question de priorité algorithmique ?

Sur des sites de plusieurs milliers de pages, on observe régulièrement des pages stratégiques qui restent hors index pendant des semaines, sans raison technique évidente. Google ne donne pas toujours de feedback actionnable.

Dans quels cas une indexation totale reste-t-elle pertinente ?

Sur un site éditorial de taille réduite (blog, site vitrine), indexer toutes les pages peut avoir du sens — à condition que chaque page apporte une valeur unique. Mais dès qu'on bascule sur un e-commerce, un site de petites annonces, ou un portail d'information dense, l'indexation totale devient contre-productive.

Le problème : beaucoup de CMS génèrent des URLs inutiles (pages de tag, archives par date, filtres multiples). Si vous ne les bloquez pas activement, vous diluez votre pertinence et consommez du crawl budget pour rien.

Quelles erreurs fréquentes découlent d'une mauvaise gestion de l'indexation ?

Première erreur : laisser Google décider seul. Certains sites laissent des milliers de pages orphelines ou dupliquées se faire crawler sans aucune directive. Résultat : des budgets de crawl gaspillés, des contenus stratégiques sous-crawlés.

Deuxième erreur : sur-optimiser dans l'autre sens. Certains SEO bloquent tout par peur de la dilution, y compris des pages qui pourraient capter du trafic longue traîne. L'équilibre est délicat.

Impact pratique et recommandations

Que faut-il faire concrètement pour maîtriser son indexation ?

Première action : auditer l'état actuel. Exportez la liste des URLs indexées via la Search Console (section Couverture), comparez avec votre sitemap et votre arborescence réelle. Identifiez les pages indexées qui ne devraient pas l'être, et inversement.

Deuxième action : définir une stratégie d'indexation claire. Quelles sections du site doivent être indexées ? Lesquelles doivent être bloquées (facettes, archives, pages de tri) ? Documentez vos choix dans une matrice d'indexation.

Quelles erreurs éviter absolument ?

Ne bloquez jamais une section entière via robots.txt sans réfléchir aux conséquences. Le robots.txt empêche le crawl, mais ne garantit pas la désindexation si des backlinks externes pointent vers ces URLs. Utilisez plutôt noindex pour les pages à exclure définitivement.

Évitez aussi de laisser des pages orphelines accessibles uniquement via sitemap. Si Google ne trouve pas de lien interne vers une page, il peut la juger peu importante et la laisser hors index, même si elle figure dans votre sitemap.

Comment vérifier que mon site est conforme à cette logique ?

Utilisez la Search Console pour monitorer régulièrement les statuts "Découverte, actuellement non indexée" et "Explorée, actuellement non indexée". Si ces statuts concernent des pages stratégiques, investiguez : problème de qualité ? de duplication ? de maillage interne ?

Complétez avec un outil de crawl comme Screaming Frog ou Oncrawl pour croiser les données : quelles pages sont crawlables mais non indexées ? Quelles pages indexées génèrent zéro trafic depuis 6 mois ?

- Exporter la liste des URLs indexées depuis la Search Console et la comparer à votre arborescence cible.

- Définir une matrice d'indexation claire : quelles sections indexer, lesquelles bloquer.

- Utiliser noindex (et non robots.txt) pour exclure proprement les pages inutiles de l'index.

- Renforcer le maillage interne vers les pages stratégiques pour signaler leur importance à Google.

- Monitorer régulièrement les statuts "Découverte/Explorée, actuellement non indexée" dans la Search Console.

- Nettoyer les pages orphelines ou les intégrer dans le maillage interne si elles ont de la valeur.

❓ Questions frequentes

Comment savoir si une page non indexée l'est volontairement ou par décision de Google ?

Une page en "Découverte, actuellement non indexée" peut-elle être indexée plus tard ?

Faut-il soumettre toutes les pages importantes via un sitemap ?

Peut-on forcer l'indexation d'une page via la Search Console ?

Bloquer une page via robots.txt empêche-t-il son indexation ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.