Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- 0:38 Comment Google Search Console peut-il réellement booster votre trafic organique ?

- 0:56 Search Console et Analytics : deux outils pour quelles données SEO distinctes ?

- 2:05 Combien de temps vos données Search Console restent-elles vraiment accessibles ?

- 2:05 Faut-il vraiment aligner les requêtes Search Console avec vos mots-clés cibles ?

- 2:05 Pourquoi Google recommande-t-il de séparer l'analyse de la recherche d'images et de la recherche web ?

- 6:00 Comment vérifier que vos pages sont réellement indexées par Google ?

- 6:18 Faut-il vraiment indexer toutes les pages de son site ?

- 8:54 Les rich results augmentent-ils vraiment la visibilité dans les résultats de recherche ?

- 8:54 L'expérience de page joue-t-elle vraiment un rôle déterminant dans le classement Google ?

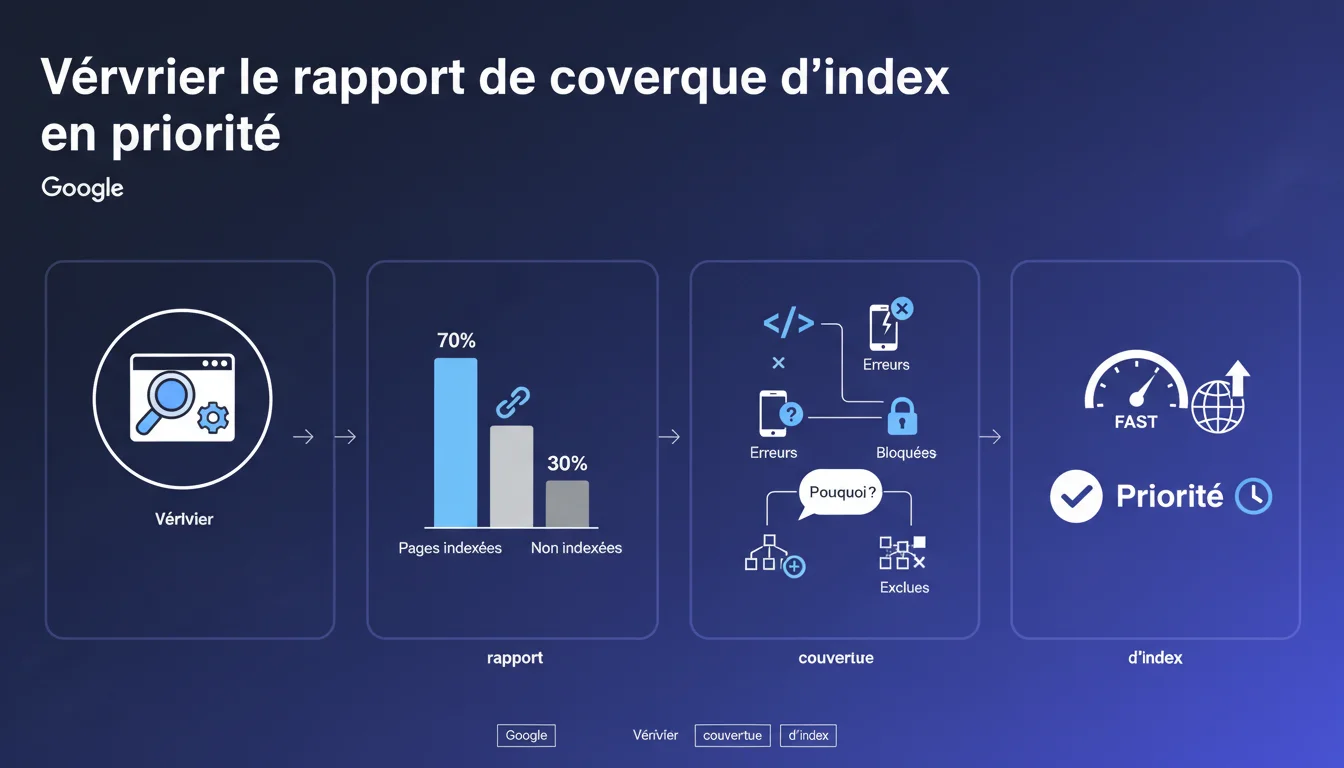

Google insiste : le rapport de couverture d'index est le premier outil à consulter pour diagnostiquer l'état d'indexation de votre site. Il révèle combien de pages sont indexées, lesquelles sont exclues, et surtout pourquoi. C'est le point de départ de tout audit SEO sérieux.

Ce qu'il faut comprendre

Qu'est-ce que le rapport de couverture d'index exactement ?

Le rapport de couverture d'index dans la Search Console affiche l'état d'indexation de chaque URL que Google a découverte sur votre site. Il classe les pages en quatre catégories : erreur, valide avec avertissements, valide, et exclue.

Ce rapport détaille les raisons pour lesquelles certaines pages ne sont pas indexées — balise noindex, redirection, contenu dupliqué, erreurs serveur, crawl budget dépassé, etc. C'est un diagnostic en temps quasi réel de la santé technique de votre site.

Pourquoi Google insiste-t-il sur ce rapport en particulier ?

Parce que l'indexation est le prérequis à toute visibilité organique. Si vos pages ne sont pas indexées, peu importe la qualité de votre contenu ou votre netlinking — vous n'existerez pas dans les SERP.

Google centralise dans ce rapport des signaux qui relèvent de plusieurs dimensions : accessibilité technique, directives d'indexation, qualité du contenu, architecture du site. C'est le tableau de bord qui réconcilie crawl, indexation et erreurs techniques.

Quels sont les pièges à éviter lors de l'analyse ?

Le rapport peut afficher des milliers de pages « Exclues », ce qui panique souvent les débutants. Sauf que toutes les exclusions ne sont pas problématiques — une page bloquée par robots.txt volontairement, ou un paramètre URL dynamique sans intérêt, c'est normal.

L'erreur classique : se focaliser sur le nombre total de pages indexées sans vérifier lesquelles le sont réellement. Parfois, Google indexe des facettes, des pages de tags inutiles, tout en excluant vos fiches produits stratégiques.

- Vérifier en priorité les pages à fort potentiel business — pas seulement le volume total

- Identifier les erreurs récurrentes qui touchent des clusters de pages (soft 404, erreurs serveur 5xx)

- Croiser avec le sitemap XML pour repérer les URLs soumises mais non indexées

- Analyser les tendances temporelles — une chute brutale du nombre de pages indexées signale un problème critique

- Ne pas négliger les avertissements : une page indexée malgré un problème peut perdre du ranking

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Dans 80% des audits SEO, les premiers gains viennent de la correction de problèmes d'indexation — pages stratégiques bloquées par erreur, duplications massives, canonicals mal configurés. Le rapport de couverture détecte ces anomalies en quelques clics.

Le problème, c'est que Google présente ce rapport comme un outil d'entrée de gamme, alors qu'il demande une vraie expertise pour être interprété correctement. Les messages d'erreur sont parfois cryptiques, et certaines exclusions justifiées ressemblent à des bugs pour un œil non averti.

Quelles nuances faut-il apporter à cette directive ?

Le rapport de couverture reste une vue partielle. Il ne dit rien sur la qualité du positionnement des pages indexées, ni sur leur performance en termes de CTR ou de conversions. Une page indexée mais noyée en page 12 n'a aucune valeur business.

Autre point : Google ne communique pas toujours les vraies raisons d'une exclusion. Une page marquée « Explorée, actuellement non indexée » peut relever d'un problème de qualité perçue par l'algorithme — mais ça, le rapport ne le dit jamais explicitement. [À vérifier] systématiquement avec une analyse de logs serveur pour croiser les données.

Dans quels cas ce rapport devient-il insuffisant ?

Sur les gros sites (e-commerce, médias), le rapport Search Console atteint vite ses limites — délais de remontée des données, agrégation approximative, impossibilité de filtrer finement par typologie de page. Il faut alors basculer sur des outils tiers ou des analyses de logs.

Pour les sites internationaux avec plusieurs versions linguistiques, le rapport mélange parfois les hreflang et rend l'interprétation confuse. Et sur les sites à fort crawl budget (millions de pages), Google n'explore qu'un échantillon — le rapport ne reflète alors qu'une fraction de la réalité.

Impact pratique et recommandations

Que faut-il faire concrètement avec ce rapport ?

Commencez par exporter les données et segmentez-les par type d'URL — catégories, fiches produits, articles, pages techniques. Identifiez les pages à forte valeur business qui ne sont pas indexées, et remontez les causes une par une.

Ensuite, croisez avec votre sitemap XML : toute URL soumise mais absente du rapport ou marquée « Introuvable (404) » signale un problème de cohérence entre votre vision du site et celle de Google. Corrigez les redirections, vérifiez les canonicals, débloquez les règles robots.txt erronées.

Quelles erreurs éviter lors de l'optimisation ?

Ne supprimez pas aveuglément toutes les pages exclues. Certaines exclusions sont volontaires et saines — pages de remerciement, résultats de recherche interne, URLs avec paramètres de session. L'objectif n'est pas d'indexer 100% du site, mais de garantir que les bonnes pages le sont.

Autre piège : corriger une erreur technique sans surveiller la réindexation. Google peut mettre plusieurs semaines à revisiter une page après correction. Utilisez l'outil « Demander une indexation » avec parcimonie — en abuser déclenche des throttlings.

Comment vérifier que mon site est conforme aux attentes de Google ?

Mettez en place un monitoring hebdomadaire du rapport de couverture. Créez des alertes sur les erreurs critiques (erreurs serveur 5xx, soft 404) et surveillez les variations brutales du nombre de pages indexées. Un bon indicateur : le ratio pages indexées / pages soumises dans le sitemap doit rester stable dans le temps.

Testez régulièrement l'indexabilité de vos nouvelles pages avec l'outil « Inspection d'URL ». Si Google indique « URL non présente sur Google », vérifiez les balises meta robots, le fichier robots.txt, et la profondeur de l'URL dans l'arborescence.

- Exporter et segmenter les données du rapport par typologie de page

- Identifier les pages stratégiques non indexées et diagnostiquer les causes

- Croiser avec le sitemap XML pour détecter les incohérences

- Corriger les erreurs techniques (redirections, canonicals, balises noindex involontaires)

- Mettre en place un monitoring hebdomadaire avec alertes sur les erreurs critiques

- Utiliser l'outil « Inspection d'URL » pour tester les nouvelles pages importantes

- Analyser les logs serveur si des écarts importants persistent malgré les corrections

❓ Questions frequentes

Quelle différence entre « Exclue » et « Explorée, actuellement non indexée » ?

Combien de temps Google met-il à réindexer une page après correction ?

Le rapport de couverture remplace-t-il l'analyse de logs serveur ?

Faut-il viser 100% de pages indexées dans le rapport ?

Pourquoi certaines pages indexées n'apparaissent-elles pas dans le rapport ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.