Declaration officielle

Ce qu'il faut comprendre

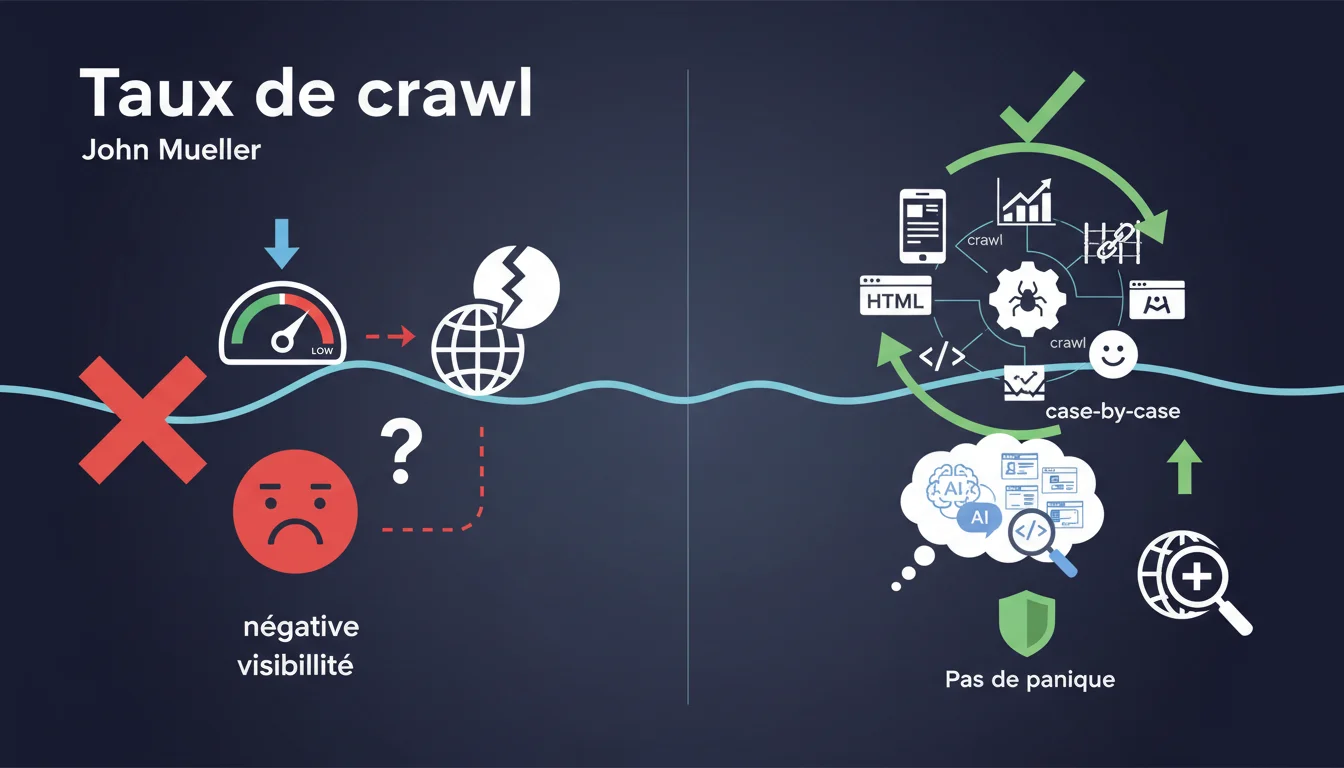

Le taux de crawl (ou crawl rate) représente la fréquence et le volume de pages que les robots de Google explorent sur votre site web durant une période donnée. Beaucoup de praticiens SEO surveillent cette métrique avec attention, parfois avec une anxiété excessive.

Google confirme ici qu'une diminution temporaire du taux de crawl n'est pas un indicateur de pénalité ou de dégradation imminente de votre visibilité dans les résultats de recherche. Cette variation peut être totalement normale et sans conséquence négative.

Il est crucial de comprendre que Google ajuste son crawl en fonction de nombreux paramètres : la fraîcheur de votre contenu, la qualité perçue de votre site, sa vitesse de réponse, et même des facteurs externes comme la charge globale des serveurs de Google.

- Une baisse de crawl ne signifie pas automatiquement une pénalité

- Chaque site web est unique avec ses propres patterns de crawl

- Les fluctuations sont normales et font partie du comportement standard de Googlebot

- Le crawl s'adapte dynamiquement aux caractéristiques de votre site

- La corrélation entre taux de crawl et rankings n'est pas directe

Avis d'un expert SEO

Cette déclaration est parfaitement cohérente avec ce que nous observons quotidiennement sur les sites que nous analysons. Trop de SEO créent une corrélation erronée entre volume de crawl et performance SEO, alors que la réalité est bien plus nuancée.

Dans la pratique, nous constatons effectivement que des sites peuvent maintenir ou même améliorer leur visibilité malgré une baisse temporaire du crawl. L'inverse est aussi vrai : un taux de crawl élevé ne garantit pas de meilleurs rankings. Ce qui compte vraiment, c'est que Google crawle vos pages stratégiques au bon moment.

Cependant, une nuance importante s'impose : si votre taux de crawl chute drastiquement ET que vous publiez régulièrement du nouveau contenu qui n'est pas indexé rapidement, alors oui, il y a un problème à investiguer. La baisse peut révéler des problèmes techniques sous-jacents (temps de réponse serveur, erreurs 5xx, budget crawl gaspillé sur des pages inutiles).

Impact pratique et recommandations

Face aux fluctuations du taux de crawl, voici les actions concrètes à mettre en œuvre pour optimiser la situation sans paniquer inutilement.

- Analysez les tendances sur le long terme (3-6 mois) plutôt que les variations quotidiennes dans la Search Console

- Vérifiez que vos pages stratégiques et votre nouveau contenu sont bien crawlés régulièrement

- Optimisez votre budget crawl en bloquant les pages sans valeur SEO (filtres, résultats de recherche interne, pages paginées inutiles)

- Améliorez les temps de réponse serveur si vous constatez des ralentissements dans les logs

- Utilisez les sitemaps XML stratégiquement pour prioriser vos pages importantes

- Surveillez les erreurs serveur (5xx) qui peuvent faire baisser le crawl volontairement par Google

- Évitez de sur-réagir à une baisse ponctuelle : attendez au moins 2-3 semaines avant d'investiguer

- Concentrez-vous sur la qualité et la fraîcheur du contenu plutôt que sur le volume de crawl brut

- Utilisez l'outil d'inspection d'URL pour forcer l'indexation de vos pages critiques si nécessaire

💬 Commentaires (0)

Soyez le premier à commenter.