Declaration officielle

Ce qu'il faut comprendre

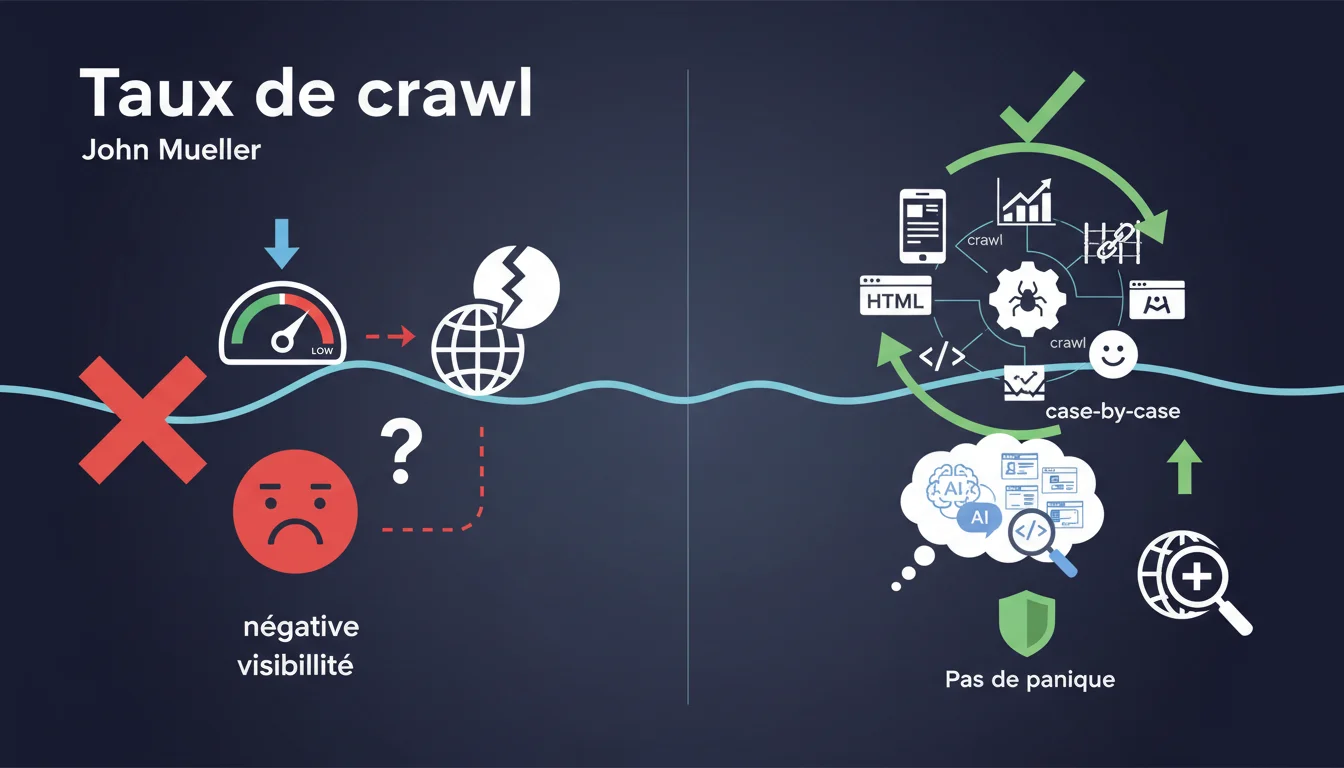

Qu'est-ce que le taux de crawl et pourquoi Google permet-il de le modifier ?

Le taux de crawl (ou crawl rate) désigne la fréquence et le nombre de pages que Googlebot explore sur votre site dans un laps de temps donné. Google propose dans la Search Console une fonctionnalité permettant de limiter ce taux, principalement pour éviter de surcharger les serveurs moins performants.

Cette option est particulièrement utile pour les sites hébergés sur des infrastructures limitées en ressources, où un crawl trop intensif pourrait ralentir voire mettre hors service le site pour les visiteurs réels. Cependant, il s'agit d'une limitation volontaire qui peut aussi freiner l'indexation de vos contenus.

Quel est le délai réel de prise en compte selon John Mueller ?

Selon les déclarations officielles, lorsque vous modifiez le paramètre de taux de crawl dans la Search Console, Google prend environ 24 heures pour appliquer effectivement ce changement. Ce délai n'est pas instantané car il doit se propager à travers l'infrastructure distribuée de crawl de Google.

Cette information est cruciale pour les interventions d'urgence : si votre serveur est sous pression à cause d'un crawl trop intensif, la modification du paramètre ne vous sauvera pas immédiatement. Il faudra envisager des solutions techniques complémentaires (robots.txt, limitation au niveau serveur).

Où trouver cette fonctionnalité dans la Search Console actuelle ?

La fonction de modification du taux de crawl n'est plus accessible via les menus classiques de la nouvelle Search Console. Elle reste néanmoins disponible via une URL directe, ce qui suggère que Google la maintient pour des cas spécifiques mais n'encourage pas son utilisation courante.

- Le délai d'application d'un changement de taux de crawl est d'environ 24 heures

- Cette fonction est désormais cachée dans la nouvelle interface Search Console

- Google régule naturellement son crawl pour ne pas surcharger les serveurs

- Modifier ce paramètre peut ralentir l'indexation de vos nouveaux contenus

- La limitation n'est pertinente que pour les infrastructures fragiles

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Avec 15 ans d'expérience, je confirme que ce délai de 24 heures est effectivement observé dans la pratique. J'ai constaté sur de nombreux projets que les modifications du taux de crawl ne produisent pas d'effet immédiat, ce qui peut être problématique lors de situations critiques.

Plus révélateur encore : le fait que Google ait masqué cette fonctionnalité dans les menus de la nouvelle Search Console est un signal fort. Cela indique que Google souhaite décourager les webmasters d'intervenir manuellement, car l'algorithme de crawl adaptatif fonctionne généralement mieux que les réglages manuels.

Dans quels cas exceptionnels cette fonctionnalité reste-t-elle pertinente ?

Dans la majorité des cas, toucher au taux de crawl est contre-productif. Google a développé des algorithmes sophistiqués qui détectent la capacité de réponse de votre serveur et adaptent automatiquement l'intensité du crawl. Intervenir manuellement risque de limiter inutilement la découverte de vos contenus.

Les seuls cas légitimes concernent des situations d'infrastructure très contraintes : hébergement mutualisé bas de gamme, migration technique en cours, serveur avec limitations strictes imposées par l'hébergeur. Même dans ces cas, la solution durable consiste à améliorer l'infrastructure plutôt qu'à brider le crawl.

Quelles alternatives plus efficaces existent pour gérer la charge du crawl ?

Plutôt que de limiter globalement le taux de crawl, il existe des approches plus chirurgicales et efficaces. L'optimisation du fichier robots.txt permet d'exclure les sections non stratégiques (filtres, paramètres URL inutiles, pages de pagination excessive). Le budget de crawl est ainsi concentré sur les contenus à forte valeur.

L'amélioration de la performance serveur (mise en cache, CDN, optimisation base de données) et l'utilisation de logs serveur pour identifier les patterns de crawl inefficaces sont également des leviers puissants. Ces solutions augmentent votre capacité sans sacrifier votre potentiel d'indexation.

Impact pratique et recommandations

Que faire si votre serveur subit une charge excessive due au crawl ?

Si vous constatez que Googlebot met votre serveur sous pression, n'agissez pas dans la précipitation. Commencez par analyser vos logs serveur pour identifier précisément quelles sections sont sur-crawlées et si ce crawl est légitime ou causé par des boucles d'URL.

Pour une action immédiate (sans attendre 24h), utilisez les directives au niveau serveur : limitation de requêtes par IP, mise en cache agressive, ou temporairement un délai dans robots.txt. La modification du taux dans Search Console ne doit être qu'un complément, pas la solution principale.

Quelles erreurs critiques faut-il absolument éviter ?

L'erreur la plus fréquente consiste à limiter le crawl par réflexe sans avoir vérifié si le problème venait réellement de Googlebot. Souvent, la charge serveur provient d'autres bots (scraping, concurrents, bots malveillants) ou de problèmes de code qui génèrent des requêtes inutiles.

Autre piège : limiter le crawl sur un site qui lance régulièrement de nouveaux contenus ou produits. Vous risquez de créer un goulot d'étranglement où vos pages stratégiques mettent des semaines à être indexées, vous faisant perdre des opportunités de trafic pendant la période la plus importante.

- Analysez d'abord vos logs serveur pour identifier la source réelle de la charge

- Optimisez votre robots.txt pour exclure les sections non stratégiques

- Améliorez la performance technique (cache, CDN) avant de limiter le crawl

- Ne modifiez le taux de crawl que si votre infrastructure est réellement limitée

- Surveillez l'impact sur votre indexation après toute modification

- Anticipez le délai de 24 heures et prévoyez des solutions d'urgence alternatives

- Documentez chaque changement pour pouvoir revenir en arrière si nécessaire

Comment mettre en place une stratégie de crawl optimale sur le long terme ?

La gestion optimale du budget de crawl nécessite une approche technique multidimensionnelle : architecture de site rationalisée, maillage interne stratégique, élimination du contenu dupliqué, et surveillance continue des métriques d'exploration via Search Console.

Cette expertise requiert une analyse fine des données de crawl, une compréhension approfondie des mécanismes d'indexation et une capacité à corréler ces éléments avec vos objectifs business. Pour les sites de taille significative ou avec des enjeux SEO importants, ces optimisations peuvent rapidement devenir complexes à orchestrer.

💬 Commentaires (0)

Soyez le premier à commenter.