Declaration officielle

Ce qu'il faut comprendre

Quelle est la différence entre les robots publicitaires et les robots de recherche de Google ?

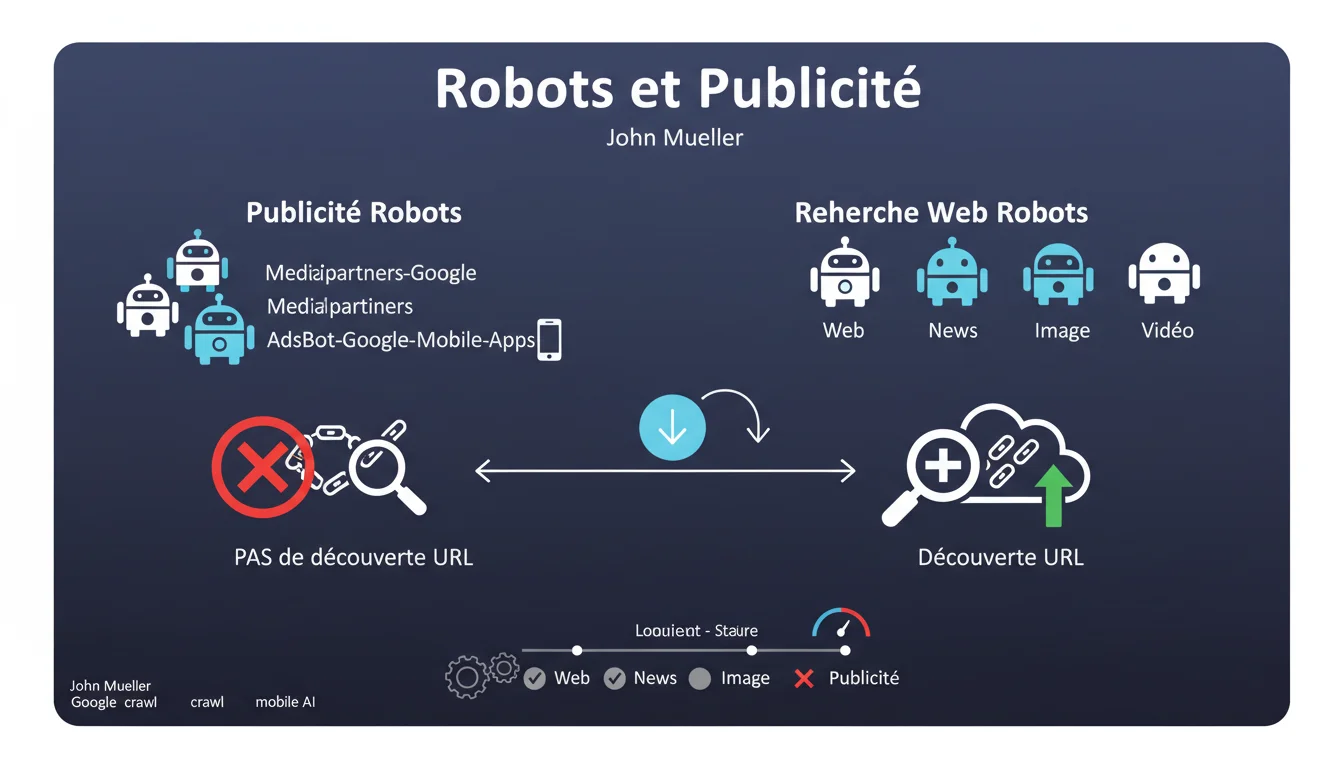

Google utilise plusieurs types de robots distincts selon leurs missions. Les robots publicitaires comme Mediapartners-Google et AdsBot-Google sont spécialisés dans l'analyse du contenu pour le ciblage publicitaire AdWords et AdSense.

En revanche, les robots de recherche web (Googlebot pour le web, les images, les vidéos ou les actualités) sont responsables de l'exploration, de la découverte et de l'indexation des pages. Cette séparation des rôles est fondamentale pour comprendre comment fonctionne l'écosystème Google.

Pourquoi cette distinction est-elle importante pour le SEO ?

Cette clarification signifie qu'autoriser uniquement les robots publicitaires dans votre fichier robots.txt ne permettra jamais à vos pages d'être indexées. Seul Googlebot (le robot de recherche) peut découvrir et transmettre de nouvelles URL à l'index de Google.

Si vous bloquez Googlebot tout en autorisant les robots publicitaires, vos pages resteront invisibles dans les résultats de recherche, même si elles peuvent afficher des publicités AdSense correctement ciblées.

Quels sont les noms exacts des robots concernés par cette limitation ?

Les robots publicitaires mentionnés incluent Mediapartners-Google, Mediapartners, AdsBot-Google et AdsBot-Google-Mobile-Apps. Aucun de ces agents ne contribue à la découverte de nouvelles URL.

Les robots capables de découvrir du contenu sont exclusivement ceux dédiés à la recherche : Googlebot, Googlebot-News, Googlebot-Image et Googlebot-Video.

- Les robots publicitaires (Mediapartners, AdsBot) ne découvrent pas de nouvelles pages

- Seuls les robots de recherche (Googlebot) peuvent indexer du contenu

- Bloquer Googlebot empêche l'indexation, même si les robots publicitaires sont autorisés

- Cette séparation est intentionnelle et structurelle chez Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce que nous observons sur le terrain ?

Absolument. Cette clarification de John Mueller confirme ce que les professionnels SEO observent depuis des années. Les sites qui bloquent Googlebot mais autorisent les robots publicitaires ne voient jamais leurs nouvelles pages indexées, même après des mois.

Cette distinction explique également pourquoi certains sites monétisés avec AdSense peuvent fonctionner sans problème publicitaire tout en ayant des problèmes d'indexation sévères. Les deux systèmes sont véritablement indépendants dans leur fonctionnement.

Quelles nuances faut-il apporter à cette règle ?

Il est important de comprendre que cette limitation concerne uniquement la découverte initiale de nouvelles URL. Une fois qu'une page est connue de Google via Googlebot, les robots publicitaires peuvent bien sûr y accéder pour analyser le contenu.

Par ailleurs, cette règle ne signifie pas que les robots publicitaires sont inutiles. Leur rôle dans le ciblage contextuel des publicités reste crucial pour les éditeurs utilisant AdSense, mais ce rôle est totalement distinct du processus d'indexation SEO.

Dans quels cas cette information change-t-elle nos pratiques ?

Cette déclaration est particulièrement critique pour les sites qui tentent de gérer finement leurs autorisations robots.txt. Certains webmasters pensent à tort pouvoir améliorer leurs revenus publicitaires en autorisant uniquement les robots AdSense.

Impact pratique et recommandations

Comment vérifier la configuration des robots sur mon site ?

Commencez par examiner votre fichier robots.txt pour identifier toutes les directives User-agent et leurs règles associées. Vérifiez que Googlebot n'est pas bloqué, même partiellement.

Utilisez ensuite l'outil d'inspection d'URL de la Search Console pour tester l'accès de Googlebot à vos pages stratégiques. Cet outil vous indiquera clairement si des blocages empêchent l'exploration et l'indexation.

Quelles erreurs de configuration faut-il absolument éviter ?

L'erreur la plus fréquente consiste à bloquer Googlebot tout en autorisant les robots publicitaires, pensant que cela suffira à l'indexation. C'est une configuration qui garantit l'échec de votre stratégie SEO.

Autre erreur : autoriser uniquement des versions spécifiques de Googlebot (comme Googlebot-Mobile) en bloquant la version générale. Pour une couverture d'indexation optimale, il faut autoriser l'ensemble des robots de recherche de Google.

- Vérifiez que Googlebot (version générale) est autorisé dans robots.txt

- Autorisez également Googlebot-Image, Googlebot-Video et Googlebot-News selon vos contenus

- Ne comptez jamais sur les robots publicitaires pour l'indexation

- Testez régulièrement l'accessibilité de vos pages via la Search Console

- Documentez toutes vos règles robots.txt pour éviter les modifications accidentelles

- Surveillez les logs serveur pour identifier les patterns de crawl réels

Que faire si vous avez des besoins complexes de gestion des robots ?

Les configurations robots.txt peuvent rapidement devenir complexes, notamment sur les sites de grande envergure ou les plateformes e-commerce avec des milliers de pages. Une erreur de syntaxe ou une règle mal ordonnée peut bloquer l'indexation de sections entières.

Pour les sites avec des enjeux SEO importants, il est souvent judicieux de s'appuyer sur une expertise SEO spécialisée capable d'auditer finement vos configurations, d'identifier les blocages subtils et de mettre en place une stratégie de crawl optimisée. Un accompagnement personnalisé permet d'éviter les erreurs coûteuses et d'assurer que votre architecture technique soutient réellement vos objectifs de visibilité.

💬 Commentaires (0)

Soyez le premier à commenter.