Declaration officielle

Ce qu'il faut comprendre

Pourquoi Google rappelle-t-il cette interdiction maintenant ?

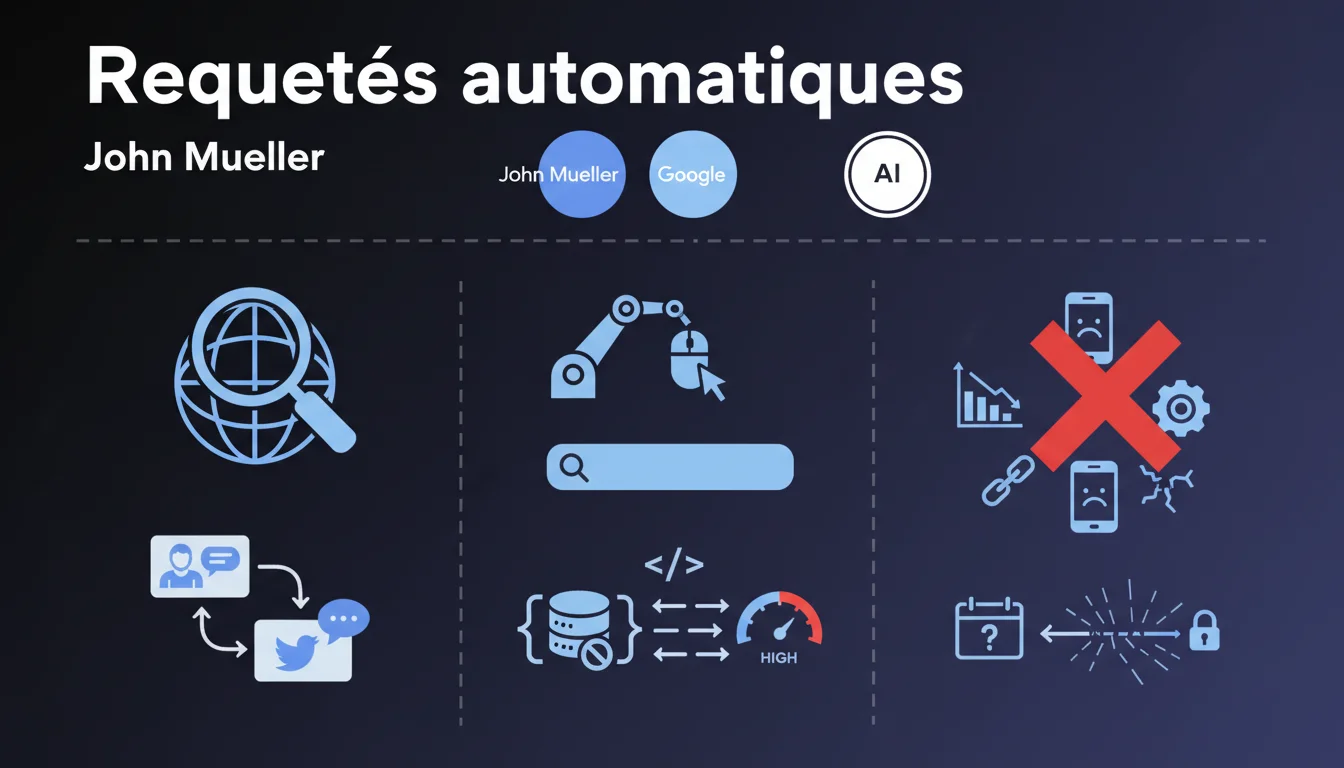

Google a toujours interdit dans ses conditions d'utilisation le scraping automatisé de ses pages de résultats (SERP). Ce rappel public de John Mueller et Gary Illyes n'est pas anodin : il suggère qu'une action de répression pourrait être imminente.

Le scraping consiste à utiliser des outils automatisés pour interroger massivement le moteur de recherche et extraire les données des résultats. Cette pratique surcharge les serveurs de Google et peut biaiser certaines métriques de recherche.

Quels outils SEO sont concernés par cette restriction ?

Potentiellement, des centaines d'outils utilisent cette technique pour fonctionner. Cela inclut les logiciels de suivi de positionnement, les outils d'analyse concurrentielle, les plateformes de recherche de mots-clés, et même certaines fonctionnalités d'audit SEO.

Tous les services qui affichent vos positions dans les SERP en temps réel ou qui analysent les résultats Google pour une requête donnée dépendent de cette pratique. L'impact pourrait donc être massif sur l'écosystème SEO.

Quelle est la différence entre scraping interdit et utilisation légitime ?

Google fait la distinction entre l'utilisation normale par un utilisateur humain et les requêtes automatisées massives. Les APIs officielles comme Google Search Console ou Google Custom Search restent des canaux légitimes.

- Interdit : Envoyer des milliers de requêtes automatiques pour extraire les résultats de recherche

- Interdit : Utiliser des bots pour simuler des recherches humaines à grande échelle

- Toléré : Utiliser les APIs officielles fournies par Google avec leurs limitations

- Acceptable : Consulter manuellement les résultats comme un utilisateur normal

- Recommandé : S'appuyer sur Google Search Console pour les données de positionnement

Avis d'un expert SEO

Cette menace de blocage est-elle réellement crédible et applicable ?

Après 15 ans dans le SEO, j'ai vu Google faire de nombreux rappels similaires sans toujours passer à l'action. Cependant, le contexte actuel est différent : Google a les moyens techniques de détecter et bloquer efficacement le scraping grâce à ses avancées en machine learning.

Le timing est révélateur. Avec la montée des modèles d'IA qui consomment massivement des données, Google cherche à protéger son écosystème. Ce n'est probablement pas un simple avertissement cette fois-ci.

Quelles sont les véritables motivations de Google derrière cet avertissement ?

Au-delà de l'argument officiel sur la charge serveur, Google cherche à contrôler l'accès à ses données. Les outils de scraping permettent aux SEO d'analyser les SERP sans générer de revenus publicitaires pour Google.

Il y a aussi une dimension concurrentielle : Google souhaite que les professionnels du SEO dépendent davantage de ses outils propriétaires comme Search Console, où il contrôle quelles données sont partagées et dans quelle mesure.

Existe-t-il des zones grises où le scraping reste toléré ?

Dans la pratique, Google ne peut pas bloquer instantanément tous les outils. Les services qui utilisent le scraping de manière modérée et distribuée, en simulant un comportement humain crédible, continueront probablement à fonctionner un certain temps.

Les gros acteurs du SEO comme SEMrush, Ahrefs ou Moz ont probablement des arrangements informels ou des ressources techniques suffisantes pour s'adapter rapidement. Ce sont les petits outils et les scripts maison qui risquent le plus.

Impact pratique et recommandations

Quels outils faut-il auditer en priorité dans votre stack SEO ?

Commencez par identifier tous les outils que vous utilisez pour le suivi de positionnement et l'analyse concurrentielle. Vérifiez leur documentation pour comprendre comment ils collectent leurs données.

Contactez directement les éditeurs de vos outils principaux pour leur demander quelle est leur stratégie d'adaptation. Les solutions pérennes utiliseront des APIs officielles ou des méthodologies conformes.

- Lister tous les outils de rank tracking utilisés dans votre organisation

- Vérifier si vos outils proposent des alternatives via API Google Search Console

- Identifier les scripts personnalisés ou outils maison qui scrapent Google

- Tester des alternatives conformes comme les données GSC directes

- Évaluer les solutions qui utilisent des panels d'utilisateurs réels plutôt que du scraping

- Diversifier vos sources de données pour ne pas dépendre d'une seule méthode

- Documenter vos processus de reporting pour faciliter une transition si nécessaire

Comment adapter votre méthodologie de suivi de positionnement ?

Privilégiez désormais Google Search Console comme source primaire pour vos données de positionnement. Même si elle ne fournit pas tous les mots-clés, elle reste la source la plus fiable et parfaitement conforme.

Explorez les outils qui utilisent des données déclaratives (panels d'utilisateurs réels) plutôt que du scraping. Ces méthodologies, bien que différentes, peuvent fournir des insights complémentaires sans violer les guidelines.

Que faire si vos outils actuels cessent de fonctionner ?

Anticipez en préparant dès maintenant un plan de continuité. Identifiez au moins deux alternatives pour chaque outil critique dans votre workflow. Ne vous mettez pas en situation de dépendance totale.

Renforcez votre utilisation de Google Search Console et Google Analytics 4. Créez des dashboards personnalisés qui combinent plusieurs sources de données conformes pour compenser les limitations individuelles.

💬 Commentaires (0)

Soyez le premier à commenter.