Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ 301 vs 302 : les redirections temporaires font-elles vraiment perdre du PageRank ?

- □ Pourquoi les redirections 307 et 308 sont-elles inutiles pour le SEO classique ?

- □ Faut-il vraiment abandonner les meta refresh pour vos redirections ?

- □ Les redirections JavaScript sont-elles réellement suivies par Google ?

- □ Faut-il vraiment rediriger chaque URL individuellement lors d'une migration de domaine ?

- □ Pourquoi les fusions et divisions de domaines provoquent-elles des fluctuations SEO prolongées ?

- □ Faut-il abandonner les redirections géographiques pour préserver votre crawl budget ?

- □ Les interstitiels avec redirections bloquent-ils vraiment Googlebot ?

- □ Faut-il vraiment des redirections bidirectionnelles entre versions mobile et desktop pour éviter les problèmes d'indexation ?

- □ Pourquoi l'URL Inspection Tool affiche-t-il un code 200 même après redirection ?

- □ Faut-il vraiment utiliser des redirections 302 entre les versions mobile et desktop ?

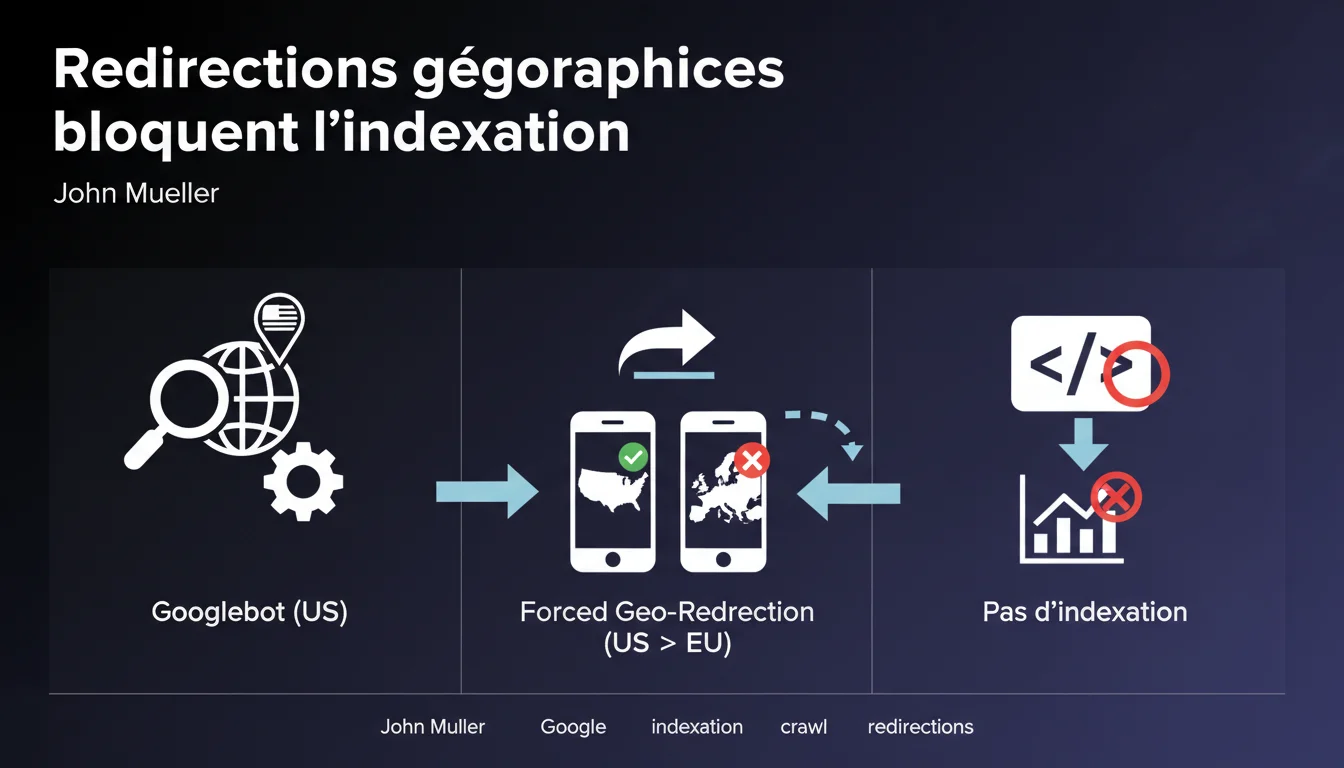

Googlebot crawle majoritairement depuis les États-Unis, même pour indexer des sites européens. Si vos redirections géographiques bloquent l'accès US à vos contenus européens, Google ne pourra pas les indexer. La géolocalisation serveur peut donc créer un angle mort critique dans votre stratégie d'indexation.

Ce qu'il faut comprendre

Pourquoi Googlebot crawle-t-il depuis les États-Unis pour des sites européens ?

Google centralise une partie significative de son infrastructure de crawl aux États-Unis pour optimiser ses ressources et maintenir une cohérence dans l'indexation globale. Même si Google dispose de datacenters répartis mondialement, le crawl primaire — celui qui détermine l'indexation initiale — s'effectue souvent depuis des IPs américaines.

Cette configuration technique crée un paradoxe : votre site peut être parfaitement accessible pour vos utilisateurs européens tout en restant invisible pour le bot qui doit l'indexer. C'est particulièrement problématique pour les sites e-commerce multi-pays qui implémentent des redirections automatiques basées sur la géolocalisation IP.

Comment les redirections géographiques bloquent-elles concrètement l'indexation ?

Une redirection géographique classique détecte l'origine de la requête (via l'IP) et renvoie l'utilisateur vers la version locale appropriée. Si un visiteur US tente d'accéder à votresite.fr/produit-europeen, il sera redirigé vers votresite.com/us-version.

Le problème ? Googlebot arrive avec une IP américaine. Il suit la redirection et n'accède jamais au contenu européen original. Résultat : la page européenne n'entre jamais dans l'index, ou pire, elle est remplacée par la version US dans les résultats de recherche français.

Quelles sont les configurations à risque ?

- Redirections 301/302 automatiques basées uniquement sur l'IP de connexion sans possibilité de contournement

- Géolocalisation serveur stricte qui bloque purement et simplement l'accès depuis certaines régions

- Sites multi-pays sans hreflang combinés à des redirections forcées — double peine pour l'indexation

- Détection IP côté serveur (Apache/Nginx) sans fallback pour les user-agents spécifiques

- CDN avec geo-routing strict configuré sans exception pour Googlebot

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. J'ai observé ce phénomène à de nombreuses reprises sur des sites internationaux. Le cas classique : un site .fr qui redirige systématiquement les IPs US vers un .com, et dont les pages françaises disparaissent progressivement de l'index malgré un contenu de qualité.

Ce qui surprend souvent les équipes techniques, c'est que Search Console ne signale pas explicitement ce type de blocage. Les pages apparaissent simplement comme "découvertes mais non indexées" sans explication claire. Il faut croiser les logs serveur avec les rapports d'indexation pour identifier le pattern.

Quelles nuances faut-il apporter à cette affirmation ?

Google ne crawle pas exclusivement depuis les US, mais la proportion est suffisamment élevée pour que ce soit le comportement par défaut à anticiper. [À vérifier] la répartition exacte varie selon les régions et les types de sites — Google n'a jamais communiqué de chiffres précis.

Autre point souvent négligé : même si Googlebot parvient à accéder à votre contenu via un chemin détourné (sitemap, lien interne depuis une page non redirigée), l'expérience de crawl dégradée peut affecter votre budget de crawl et ralentir l'indexation. Une page accessible mais difficile à atteindre sera moins fréquemment actualisée.

Dans quels cas cette règle ne s'applique-t-elle pas totalement ?

Si vous utilisez des redirections JavaScript côté client plutôt que serveur, Googlebot peut techniquement accéder au contenu initial avant que la redirection ne s'exécute. Mais cette solution introduit d'autres problèmes : latence de rendu, incohérence entre le crawl mobile et desktop, impact sur les Core Web Vitals.

Les sites qui implémentent correctement les annotations hreflang combinées à une détection user-agent peuvent autoriser Googlebot à accéder à toutes les versions tout en redirigeant les utilisateurs réels. C'est techniquement plus propre, mais ça nécessite une configuration serveur soignée.

Impact pratique et recommandations

Comment vérifier si vos redirections bloquent Googlebot ?

Première étape : testez l'accès à vos URLs européennes depuis une IP américaine. Utilisez un VPN ou un service de test géolocalisé, et observez le comportement de redirection. Si vous êtes systématiquement renvoyé vers une version US/internationale, Googlebot vit la même expérience.

Deuxième diagnostic : analysez vos logs serveur en filtrant les requêtes Googlebot. Vérifiez quelles URLs sont effectivement crawlées et comparez avec vos pages stratégiques européennes. Un écart significatif indique un problème d'accessibilité.

Troisième vérification : dans Search Console, examinez le rapport "Couverture" pour les pages marquées "Découvertes - actuellement non indexées". Croisez cette liste avec vos pages géo-redirigées. Si elles sont surreprésentées, vous avez votre réponse.

Quelle solution technique privilégier ?

La configuration optimale combine plusieurs éléments. D'abord, implémentez une détection user-agent côté serveur qui autorise explicitement Googlebot (et Bingbot, etc.) à accéder à toutes les versions sans redirection forcée.

Ensuite, déployez des balises hreflang correctement configurées sur toutes vos pages internationales. Googlebot pourra ainsi comprendre la structure multi-pays et afficher la bonne version selon la langue/région de recherche, même s'il crawle depuis les US.

Enfin, plutôt que des redirections serveur 301/302, préférez une bannière de suggestion JavaScript : "Vous semblez être en France, préférez-vous la version française ?". L'utilisateur garde le contrôle, et Googlebot accède au contenu original sans obstacle.

- Auditer les règles de redirection géographique dans la configuration serveur (Apache .htaccess, Nginx conf, CDN rules)

- Whitelister les user-agents des moteurs de recherche pour éviter les redirections forcées

- Vérifier la présence et la validité des balises hreflang sur toutes les versions internationales

- Tester l'accès aux URLs critiques via des IPs de différents pays (US, UK, DE, etc.)

- Analyser les logs pour confirmer que Googlebot crawle effectivement les versions européennes

- Implémenter une solution de suggestion plutôt que de redirection automatique pour l'UX

- Monitorer l'indexation des pages géo-spécifiques dans Search Console après modifications

❓ Questions frequentes

Peut-on simplement whitelister les IPs de Googlebot pour résoudre le problème ?

Les balises hreflang suffisent-elles sans modifier les redirections ?

Une redirection JavaScript côté client évite-t-elle le problème ?

Comment savoir si mes pages européennes sont effectivement bloquées ?

Cette problématique concerne-t-elle aussi les sites mono-pays avec versions linguistiques ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.