Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Le SEO technique est-il vraiment encore indispensable pour le référencement ?

- □ Search Console est-elle vraiment efficace pour diagnostiquer vos problèmes SEO ?

- □ Pourquoi Google privilégie-t-il systématiquement la page d'accueil dans son processus d'indexation ?

- □ La duplication de contenu provient-elle vraiment toujours de copié-collé exact ?

- □ Faut-il vraiment sacrifier le volume de trafic au profit de la pertinence ?

- □ Les feedbacks utilisateurs sont-ils plus révélateurs que le trafic pour juger la qualité d'une page ?

- □ La qualité SEO se résume-t-elle vraiment à aider l'utilisateur à accomplir sa tâche ?

- □ Faut-il vraiment miser sur une perspective unique pour ranker dans une niche saturée ?

- □ Faut-il vraiment supprimer les pages à faible trafic de votre site ?

- □ Faut-il vraiment fusionner et rediriger du contenu régulièrement pour améliorer son SEO ?

- □ Faut-il vraiment traiter toutes les erreurs d'exploration de la même manière ?

- □ Faut-il vraiment aligner le title et le H1 pour performer en SEO ?

- □ Faut-il utiliser l'IA générative pour rédiger ses contenus SEO ?

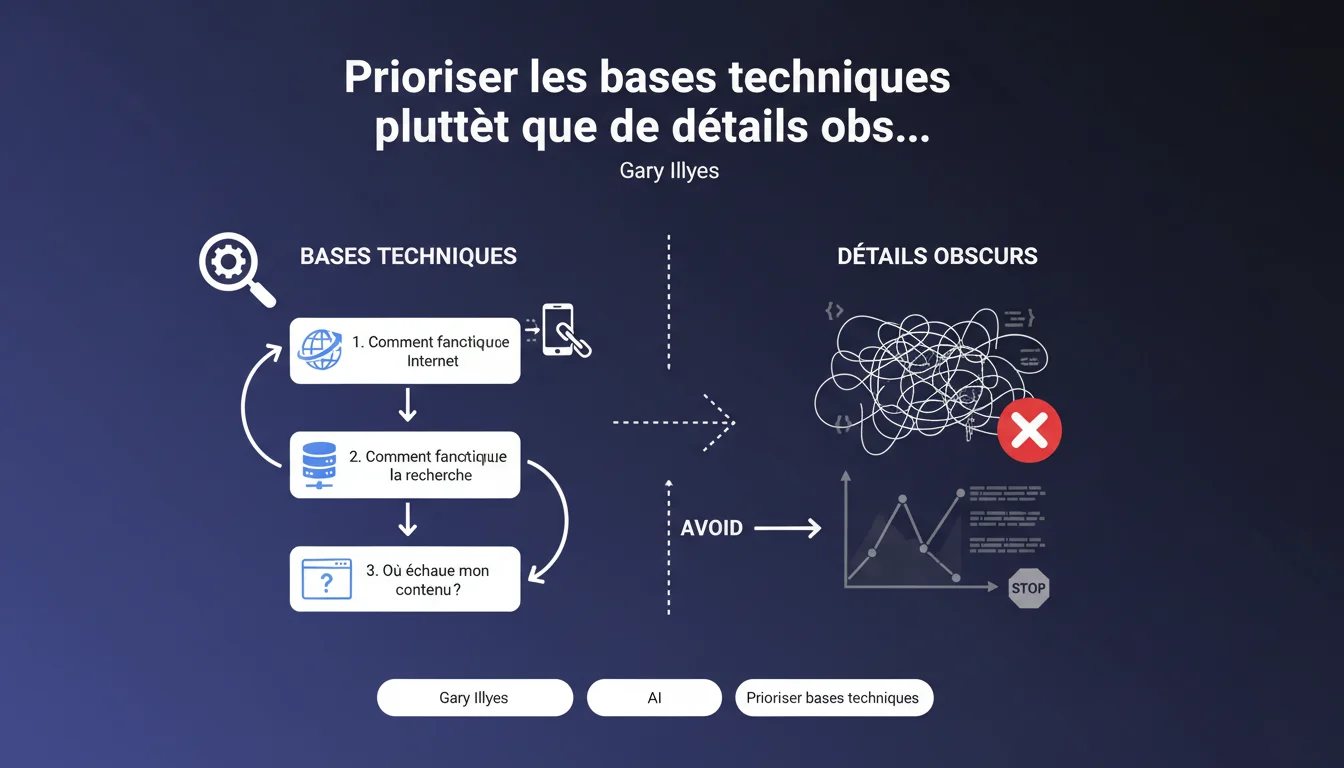

Gary Illyes rappelle que les bases techniques (fonctionnement d'Internet, du crawl, de l'indexation) priment sur l'optimisation de détails ésotériques. L'approche recommandée : identifier méthodiquement où le processus échoue plutôt que de multiplier les micro-optimisations. Un retour aux fondamentaux qui interroge la pertinence de certaines pratiques avancées.

Ce qu'il faut comprendre

Que veut dire Google par « détails techniques étranges » ?

Google vise ici les optimisations marginales sur lesquelles certains SEO passent un temps disproportionné : micro-ajustements de balises obscures, sur-optimisation de paramètres serveur exotiques, débats sans fin sur des attributs HTML secondaires.

Le message est clair — avant de peaufiner des détails, il faut maîtriser le parcours complet : DNS, serveur, rendu, crawl, indexation, ranking. Si une page n'est pas indexée, optimiser son schema markup ne servira strictement à rien.

Pourquoi cette insistance sur les « bases » ?

Parce que la majorité des problèmes SEO proviennent d'erreurs fondamentales : robots.txt mal configuré, temps de réponse serveur catastrophiques, contenu en JavaScript non rendu, canonicalisation bancale.

Google observe probablement que trop de sites négligent ces fondations tout en s'acharnant sur des optimisations de second ordre. L'écart entre l'effort investi et l'impact obtenu est souvent démesuré.

Comment identifier où le processus échoue ?

L'approche méthodique consiste à remonter la chaîne : le Googlebot peut-il accéder à la page ? Le contenu est-il visible dans le HTML rendu ? La page est-elle indexable ? Le contenu répond-il à une intention de recherche ?

Chaque étape doit être validée séquentiellement. Si le crawl échoue, inutile d'analyser le contenu. Si l'indexation est bloquée, les optimisations on-page sont superflues.

- Vérifier systématiquement la chaîne complète : DNS → serveur → crawl → rendu → indexation → ranking

- Prioriser les blocages structurels avant les optimisations marginales

- Comprendre le fonctionnement d'Internet (requête HTTP, DNS, CDN, cache) pour diagnostiquer efficacement

- Utiliser Search Console et les logs serveur pour identifier les points de rupture

- Accepter qu'une optimisation de détail n'aura aucun impact si les fondamentaux sont défaillants

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, mais avec une nuance majeure — Google simplifie. Dans la réalité, les « bases » ne sont pas toujours suffisantes sur des marchés ultra-concurrentiels. Quand tous les acteurs maîtrisent les fondamentaux, ce sont justement les détails qui font la différence.

Le problème, c'est que beaucoup de SEO sautent des étapes. Ils optimisent des micro-données alors que leur site a un temps de réponse de 3 secondes. Ils débattent de l'attribut « decoding » des images alors que 40% de leurs pages ne sont pas indexées. C'est ce déséquilibre que Google pointe.

Dans quels cas les détails techniques deviennent-ils décisifs ?

Sur des sites déjà solides techniquement, les optimisations avancées peuvent effectivement générer des gains mesurables : fine-tuning du crawl budget, optimisation du Critical Rendering Path, stratégies de prérendu sophistiquées.

Mais ces cas concernent une minorité de sites. Pour la majorité, le ROI est ailleurs — accessibilité, performance brute, architecture logique, contenu pertinent. [À vérifier] : Google ne donne aucune métrique pour définir où placer le curseur entre « bases » et « détails ».

Quels risques à suivre ce conseil trop littéralement ?

Se limiter aux « bases » peut conduire à sous-estimer l'importance de certains signaux que Google considère désormais comme fondamentaux : Core Web Vitals, HTTPS, mobile-first, structured data pour certaines features.

Le discours de Google reste délibérément flou sur ce qui relève du « basique » versus du « détail étrange ». Résultat : chacun interprète selon son niveau ou ses intérêts. Ce qui est « bizarre » pour Google ne l'est peut-être pas pour un site e-commerce gérant 100 000 références.

Impact pratique et recommandations

Que faut-il faire concrètement après cette déclaration ?

Commence par un audit technique séquentiel : documente chaque étape du parcours de Googlebot sur tes pages stratégiques. Utilise les logs serveur pour vérifier que le crawl se déroule normalement, Search Console pour détecter les erreurs d'indexation.

Ensuite, priorise impitoyablement. Liste tous les chantiers techniques envisagés et classe-les selon leur impact sur le processus de base (crawl, rendu, indexation). Tout ce qui ne bloque pas directement ces étapes passe en second plan.

Quelles erreurs éviter face à ce conseil ?

Ne confonds pas « se concentrer sur les bases » avec « faire le minimum syndical ». Les bases incluent des sujets complexes : gestion du budget de crawl sur un gros site, stratégie de rendu JavaScript, architecture d'information scalable.

Autre piège — ignorer totalement les optimisations avancées sous prétexte qu'elles sont « obscures ». Si ton site maîtrise déjà les fondamentaux, c'est précisément le moment d'aller plus loin. Le conseil de Google s'adresse surtout aux sites qui mettent la charrue avant les bœufs.

Comment vérifier que mon site respecte les priorités ?

- Analyser les logs serveur pour confirmer que Googlebot accède normalement aux pages importantes

- Vérifier dans Search Console que le taux d'indexation des pages stratégiques est proche de 100%

- Tester le rendu réel via l'outil d'inspection d'URL (pas seulement le code source)

- Auditer les temps de réponse serveur et Core Web Vitals — si c'est rouge, tout le reste attend

- Contrôler la cohérence des directives : robots.txt, meta robots, canonicals, sitemap XML

- Identifier les contenus orphelins ou mal maillés — une page invisible du crawl n'existe pas

- S'assurer que les ressources critiques (CSS, JS, fonts) ne sont pas bloquées au crawl

❓ Questions frequentes

Qu'est-ce qu'un « détail technique étrange » selon Google ?

Les optimisations avancées (schema markup, prerendering) sont-elles inutiles ?

Comment savoir si je dois me concentrer sur les bases ou aller plus loin ?

Google va-t-il sanctionner les sites qui sur-optimisent les détails ?

Cette déclaration change-t-elle la stratégie SEO à adopter ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.