Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Le SEO technique est-il vraiment encore indispensable pour le référencement ?

- □ Faut-il arrêter d'obseder sur les détails techniques obscurs en SEO ?

- □ Search Console est-elle vraiment efficace pour diagnostiquer vos problèmes SEO ?

- □ Pourquoi Google privilégie-t-il systématiquement la page d'accueil dans son processus d'indexation ?

- □ Faut-il vraiment sacrifier le volume de trafic au profit de la pertinence ?

- □ Les feedbacks utilisateurs sont-ils plus révélateurs que le trafic pour juger la qualité d'une page ?

- □ La qualité SEO se résume-t-elle vraiment à aider l'utilisateur à accomplir sa tâche ?

- □ Faut-il vraiment miser sur une perspective unique pour ranker dans une niche saturée ?

- □ Faut-il vraiment supprimer les pages à faible trafic de votre site ?

- □ Faut-il vraiment fusionner et rediriger du contenu régulièrement pour améliorer son SEO ?

- □ Faut-il vraiment traiter toutes les erreurs d'exploration de la même manière ?

- □ Faut-il vraiment aligner le title et le H1 pour performer en SEO ?

- □ Faut-il utiliser l'IA générative pour rédiger ses contenus SEO ?

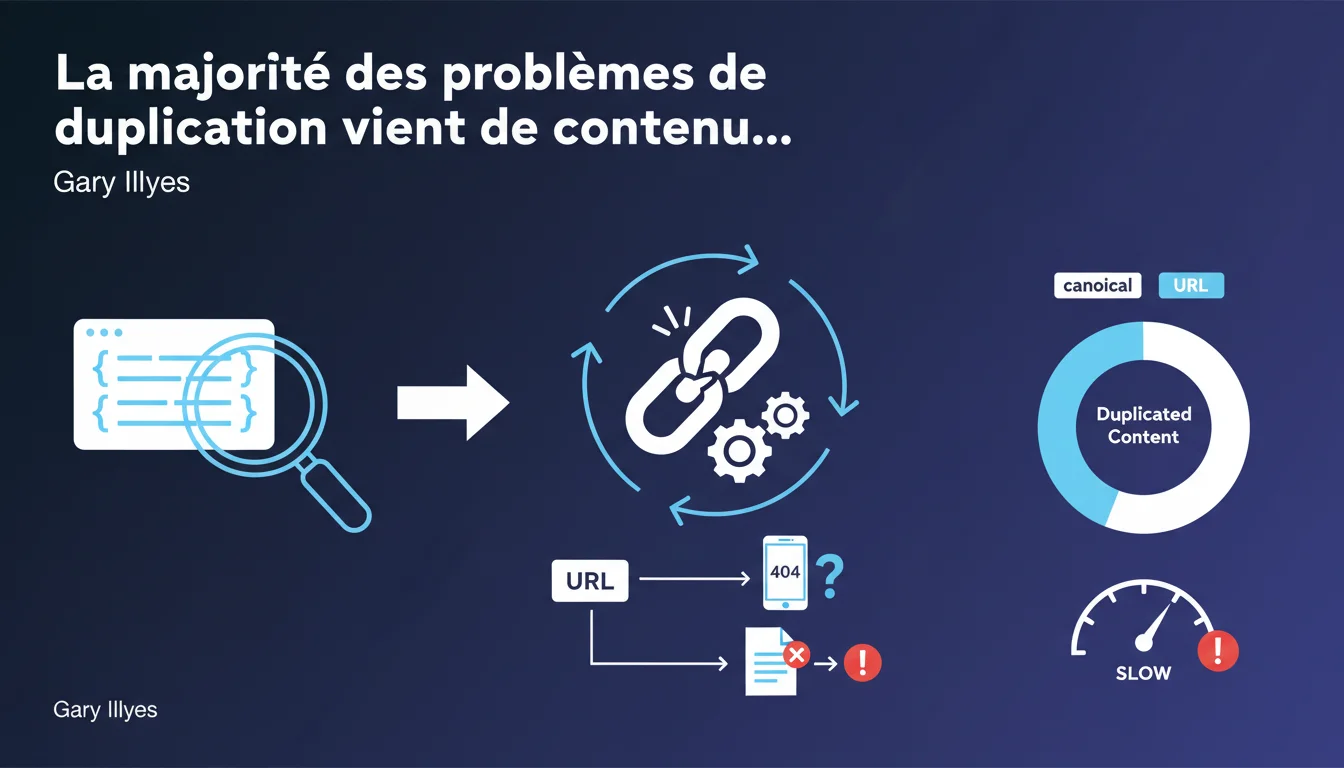

Google affirme que la majorité des problèmes de canonicalisation naissent d'un contenu dupliqué lettre pour lettre, souvent causé par des erreurs de configuration technique. L'exemple donné : un site qui ne renvoie pas de 404 pour les URL aléatoires, générant ainsi des milliers de pages identiques. C'est un rappel brutal que les fondations techniques priment sur les subtilités sémantiques.

Ce qu'il faut comprendre

Qu'entend Google par « duplication lettre pour lettre » ?

Gary Illyes parle ici de contenu strictement identique — pas de similarité sémantique, pas de reformulation, mais du copié-collé pur et dur. Le moteur détecte plusieurs URL qui servent exactement le même HTML, mot pour mot.

C'est crucial de comprendre la nuance : Google ne parle pas de « thin content » ou de pages qui se ressemblent. Il pointe du doigt les duplications techniques créées par une architecture bancale. L'exemple du 404 absent est révélateur — un site qui génère une page par défaut pour toute URL inventée multiplie les versions identiques sans même s'en rendre compte.

Pourquoi les configurations incorrectes créent-elles autant de duplication ?

Les CMS modernes, les paramètres d'URL, les versions HTTP/HTTPS, les trailing slashes, les sous-domaines — chaque couche technique peut générer des variantes d'URL pointant vers le même contenu. Si le serveur ne gère pas ces cas avec des redirections propres ou des balises canonical, Google voit des dizaines de pages identiques.

L'absence de 404 pour les URL aléatoires est un cas particulier redoutable. Certains CMS mal configurés affichent la page d'accueil ou une page générique au lieu de renvoyer un code d'erreur. Résultat ? Des milliers d'URL crawlables avec du contenu dupliqué.

Quelle est la différence avec la duplication partielle ou sémantique ?

Google fait une distinction nette. La duplication exacte déclenche un problème de canonicalisation — le moteur doit choisir quelle URL indexer parmi plusieurs identiques. C'est un casse-tête algorithmique pur.

La similarité sémantique — deux pages qui traitent du même sujet avec des mots différents — relève d'un autre mécanisme. Ici, Google ne doit pas choisir une URL canonique, mais évaluer la pertinence et l'originalité. Les enjeux et les solutions diffèrent radicalement.

- Duplication exacte : Problème de canonicalisation, souvent d'origine technique

- Configuration serveur : Absence de 404, redirections manquantes, gestion des paramètres d'URL défaillante

- Impact crawl : Gaspillage de budget de crawl sur des pages identiques

- Distinction clé : Contenu lettre pour lettre ≠ contenu similaire ou proche

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment la majorité des cas terrain ?

D'expérience, oui — mais avec des nuances. La plupart des audits techniques révèlent des duplications bêtes : www vs non-www, HTTP vs HTTPS, URL avec session ID, paramètres de tri ou de pagination mal gérés. Ces erreurs représentent facilement 70-80% des problèmes de canonicalisation observés.

Soyons honnêtes : les problèmes de duplication « intelligente » (spin de contenu, reformulation automatique) existent, mais ils sont minoritaires. Ce que Google pointe du doigt, c'est le fait que la majorité des sites ont encore des fondations pourries avant même de parler de stratégie éditoriale.

L'exemple du 404 absent est-il représentatif ?

C'est un cas extrême, mais pas si rare. On le voit surtout sur des CMS custom ou des sites migrés à la va-vite. Un développeur qui configure un fallback « user-friendly » sans comprendre les implications SEO crée un gouffre de pages fantômes.

Le problème s'aggrave avec les sites qui génèrent des URL dynamiques : filtres, recherches internes, sessions utilisateurs. Si chaque combinaison aléatoire génère une page au lieu d'une erreur, le crawler de Google s'embourbe dans des millions de variantes identiques. [À vérifier] sur votre propre site : testez des URL aléatoires et vérifiez le code de réponse HTTP.

Quelles limites cette déclaration a-t-elle ?

Gary Illyes parle de « majorité », pas de « totalité ». Il reste des cas où la duplication partielle ou la cannibalisation sémantique posent problème — même si Google ne les classe pas sous « canonicalisation ».

Autre point : cette déclaration ne dit rien sur l'impact réel. Avoir 10 URL dupliquées sur un site de 100 pages est catastrophique. En avoir 1000 sur un site de 500 000 pages peut être négligeable si elles sont bloquées en robots.txt. Le contexte compte autant que la cause.

Impact pratique et recommandations

Comment détecter la duplication exacte sur votre site ?

Première étape : crawler votre site avec Screaming Frog, Oncrawl ou Sitebulb. Activez la détection de contenu dupliqué et analysez les clusters de pages identiques. Comparez les hash MD5 ou SHA-1 du contenu HTML — c'est imparable pour repérer les copies exactes.

Testez ensuite les URL aléatoires. Inventez des chemins qui n'existent pas et vérifiez le code de réponse HTTP. Si vous obtenez du 200 au lieu du 404, vous avez un problème structurel. Vérifiez aussi les variantes d'URL : avec/sans trailing slash, avec paramètres GET inutiles, préfixes www, protocoles HTTP/HTTPS.

Quelles solutions techniques appliquer en priorité ?

Configurez correctement les codes de réponse HTTP. Toute URL inexistante doit renvoyer un 404 ou 410. Si vous devez proposer une page de secours (recherche interne, suggestions), utilisez un code 404 avec un corps HTML utile — oui, c'est possible et recommandé.

Mettez en place des redirections 301 pour unifier les variantes d'URL : www vers non-www (ou l'inverse), HTTP vers HTTPS, trailing slash standardisé. Consolidez les versions canoniques dès la couche serveur, avant même que Google ne crawle.

Utilisez la balise canonical pour les cas où la redirection n'est pas possible (pagination, paramètres de tri, versions imprimables). Mais attention : canonical est une suggestion, pas une directive absolue. La configuration serveur prime toujours.

Comment vérifier que les corrections fonctionnent ?

Rechargez votre sitemap et soumettez-le dans la Search Console. Surveillez le rapport de couverture d'index : les pages en « détectées, non indexées » ou « exclues par balise canonical » doivent diminuer progressivement.

Vérifiez aussi le crawl budget. Si Google crawle moins de pages dupliquées, il consacre plus de ressources au contenu unique. Les logs serveur vous donnent une vision précise de l'activité de Googlebot avant/après vos corrections.

- Crawlez le site avec un outil SEO et identifiez les contenus dupliqués lettre pour lettre

- Testez des URL aléatoires et vérifiez qu'elles renvoient bien un code 404

- Unifiez les variantes d'URL (www, HTTPS, trailing slash) avec des redirections 301

- Configurez les balises canonical pour les cas où la redirection n'est pas adaptée

- Bloquez en robots.txt les URL dynamiques inutiles (filtres, paramètres de session)

- Surveillez la Search Console : rapport de couverture, pages exclues, erreurs de canonicalisation

- Analysez les logs serveur pour mesurer l'impact sur le crawl de Googlebot

❓ Questions frequentes

Toutes les duplications de contenu sont-elles pénalisées par Google ?

La balise canonical suffit-elle à régler tous les problèmes de duplication ?

Comment savoir si Google a bien pris en compte mes corrections de duplication ?

Un site qui affiche la page d'accueil pour toute URL invalide est-il vraiment pénalisé ?

Dois-je bloquer en robots.txt toutes les URL avec paramètres pour éviter la duplication ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/11/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.