Declaration officielle

Ce qu'il faut comprendre

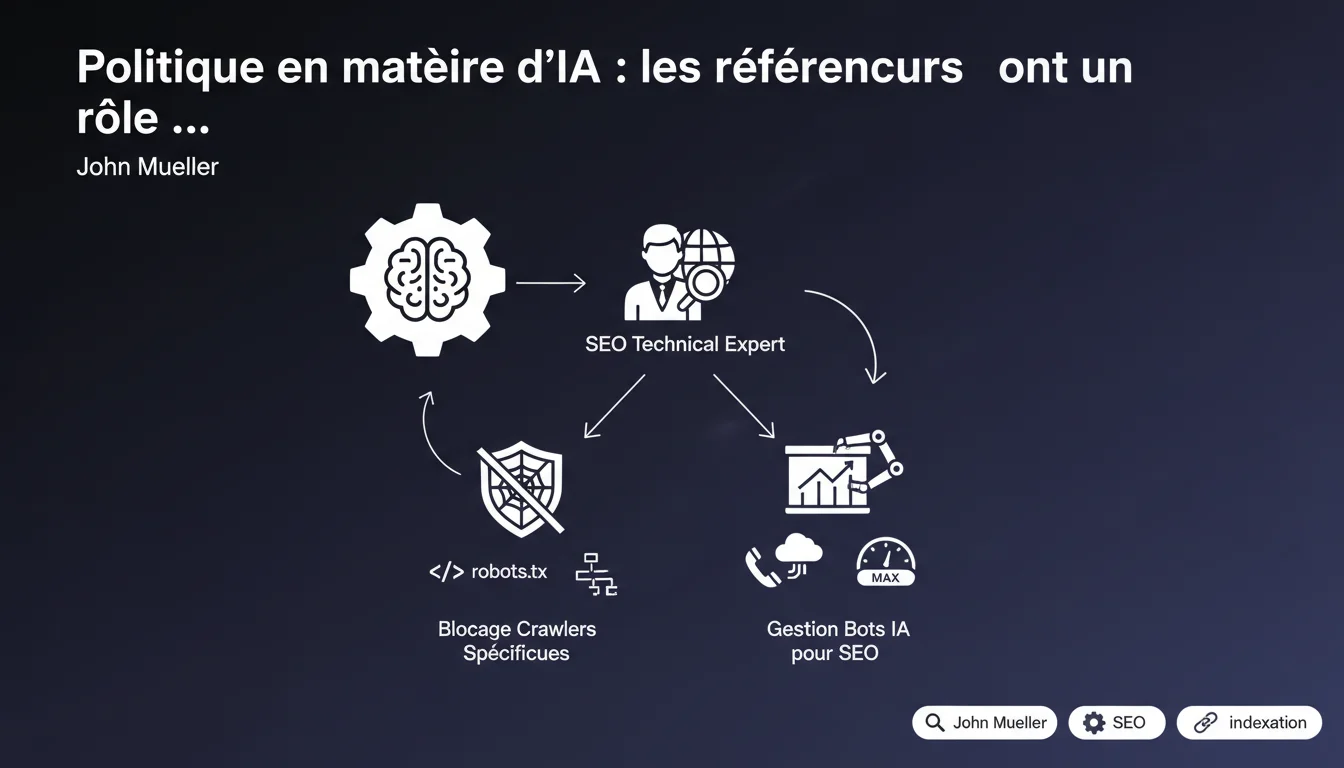

Google reconnaît officiellement que les référenceurs techniques occupent une position stratégique dans la gestion des robots d'indexation IA. Cette déclaration souligne leur rôle d'expert conseil auprès des clients face aux enjeux croissants de l'intelligence artificielle.

Les SEO disposent d'une connaissance approfondie des mécanismes de crawl et des outils de contrôle comme le fichier robots.txt, le meta robots, ou encore le fichier robots.txt étendu pour les bots IA spécifiques (GPTBot, Google-Extended, etc.).

Cette expertise leur permet de conseiller stratégiquement leurs clients sur la manière de gérer l'accès de ces nouveaux crawlers. Il s'agit d'un équilibre délicat entre protection du contenu et visibilité.

- Les référenceurs techniques sont légitimes pour orienter les décisions d'entreprise concernant l'IA

- La maîtrise du robots.txt et des directives de crawl devient un atout stratégique majeur

- Le blocage sélectif des bots IA doit être réfléchi pour ne pas nuire au référencement naturel

- Une approche nuancée est nécessaire selon les objectifs business de chaque client

Avis d'un expert SEO

Cette déclaration est particulièrement cohérente avec l'évolution du marché que j'observe depuis 2023. Les référenceurs qui comprennent les implications de l'IA sur le crawl budget et la visibilité ont effectivement un avantage consultatif majeur.

Cependant, il faut nuancer cette position. Bloquer systématiquement les bots IA peut sembler protecteur à court terme, mais pourrait priver un site de visibilité dans les futurs outils de recherche augmentée par IA (SGE, Copilot, Perplexity). La décision doit être alignée avec la stratégie globale du client.

J'observe également que certains secteurs (édition, création de contenu premium) ont davantage intérêt à restreindre l'accès, tandis que d'autres (e-commerce, services locaux) bénéficient d'une exposition maximale. Le conseil doit être contextualisé selon le modèle économique.

Impact pratique et recommandations

- Auditer immédiatement votre fichier robots.txt actuel pour identifier quels bots IA ont actuellement accès à votre contenu

- Documenter tous les user-agents IA connus : GPTBot (OpenAI), Google-Extended (Google), CCBot (Common Crawl), anthropic-ai, Claude-Web, etc.

- Établir une politique claire avec vos clients sur leur positionnement vis-à-vis de l'IA générative : protection maximale ou exposition contrôlée ?

- Ne jamais bloquer Googlebot classique si vous souhaitez maintenir votre référencement organique traditionnel

- Tester le blocage progressif : commencer par bloquer Google-Extended et observer l'impact sur le trafic et les positions sur 2-3 mois

- Monitorer les logs serveur pour identifier les nouveaux bots IA qui apparaissent régulièrement (nouveaux acteurs du marché)

- Créer des segments différenciés : certaines sections du site peuvent être ouvertes aux bots IA (contenu promotionnel) tandis que d'autres sont protégées (contenu premium)

- Documenter vos recommandations avec des scénarios business : impact potentiel du blocage vs. exposition, selon le modèle de revenus du client

- Former vos clients aux enjeux : ils doivent comprendre que cette décision a des implications sur leur visibilité future dans les outils IA

- Réviser la stratégie trimestriellement car l'écosystème des bots IA évolue rapidement, avec de nouveaux acteurs et de nouvelles règles

La mise en place d'une stratégie cohérente de gestion des crawlers IA nécessite une expertise technique pointue et une veille constante. Les implications sont à la fois techniques (configuration serveur, robots.txt, headers HTTP) et stratégiques (positionnement business, protection de la propriété intellectuelle).

Pour les entreprises qui souhaitent optimiser finement cette dimension émergente du SEO, notamment dans des secteurs sensibles ou avec des enjeux de contenu premium, l'accompagnement par une agence SEO spécialisée permet de bénéficier d'une analyse personnalisée et d'une stratégie adaptée aux objectifs spécifiques, tout en évitant les erreurs de configuration qui pourraient impacter négativement le référencement traditionnel.

💬 Commentaires (0)

Soyez le premier à commenter.