Declaration officielle

Ce qu'il faut comprendre

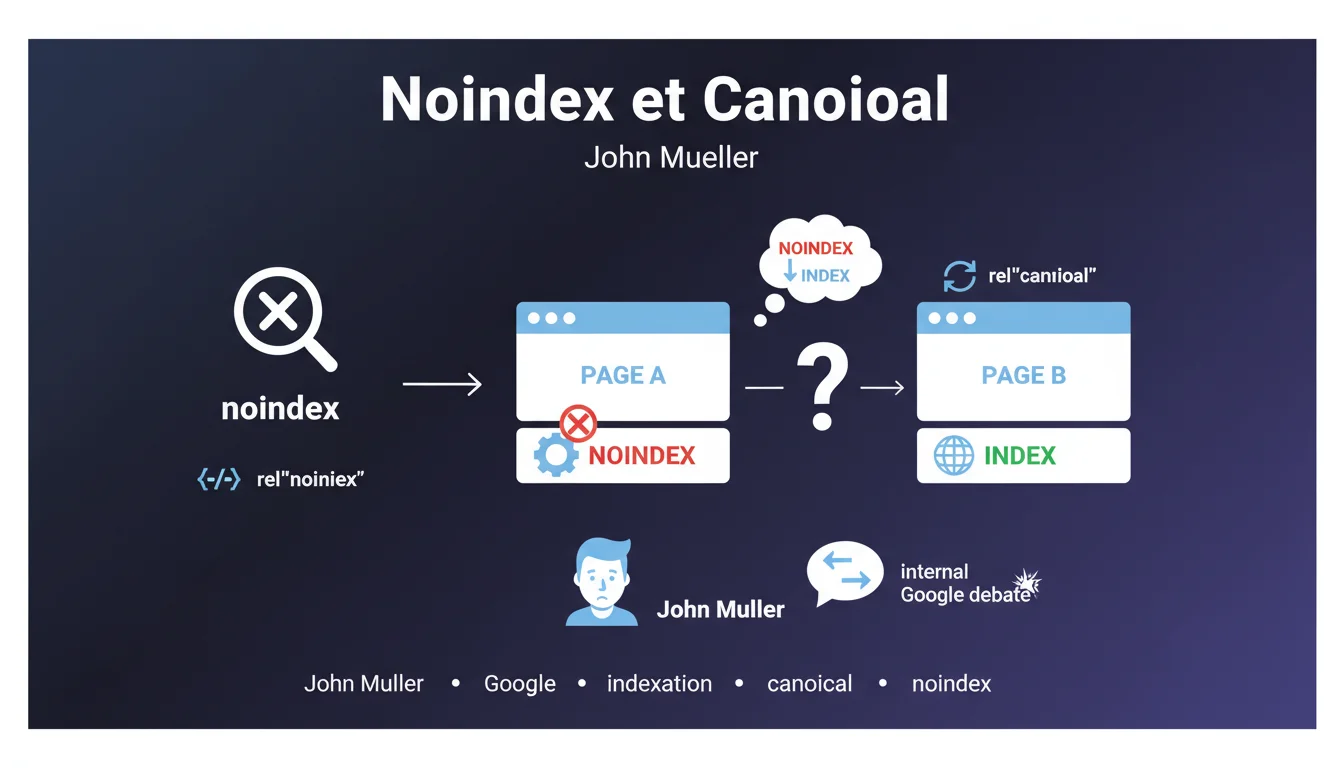

Google confirme officiellement que l'utilisation simultanée de balises canonical et meta robots noindex crée des signaux contradictoires pour le moteur de recherche. Le premier directive indique "cette page est un duplicata, voici l'original à indexer", tandis que le second affirme "n'indexe pas cette page". Cette contradiction génère une ambiguïté d'interprétation pour Googlebot.

La situation se complique encore davantage lorsqu'on ajoute une directive Disallow dans le robots.txt. Techniquement, si une URL est bloquée par robots.txt, le crawler ne peut pas accéder à la page et donc ne peut pas lire la balise canonical présente dans le code HTML. Cependant, Google conserve parfois en mémoire des informations précédemment crawlées, ce qui peut créer des comportements imprévisibles.

Ces directives contradictoires posent particulièrement problème sur les sites à grande échelle où l'automatisation des tâches SEO ne permet pas toujours une gestion granulaire page par page. Les systèmes de gestion de contenu peuvent appliquer des règles globales qui se superposent involontairement.

- Canonical + noindex = signaux contradictoires à éviter

- Disallow bloque le crawl donc empêche la lecture du canonical

- Ces doublons de directives arrivent fréquemment sur les gros sites

- Google peut interpréter ces signaux de manière incohérente

- La gestion manuelle page par page n'est pas toujours possible à grande échelle

Avis d'un expert SEO

Cette recommandation de Google est techniquement correcte mais pragmatiquement nuancée. Dans un monde idéal, chaque page aurait une seule directive claire. Dans la réalité des sites e-commerce de milliers de pages, des plateformes multilingues ou des sites générés dynamiquement, ces superpositions de directives sont quasi inévitables et parfois même souhaitables comme filet de sécurité.

L'expérience terrain montre que Google est plus tolérant que ne le suggère cette déclaration. Le moteur a développé une certaine capacité à hiérarchiser ces signaux : généralement, le noindex l'emporte sur le canonical, et le Disallow bloque effectivement tout le reste. Les vrais problèmes surviennent surtout lors de changements fréquents de ces directives ou lorsqu'elles alternent dans le temps sur une même URL.

Impact pratique et recommandations

Suite à cette clarification officielle, voici les actions concrètes à mettre en œuvre pour optimiser la gestion de vos directives d'indexation :

- Auditer vos combinaisons de directives : utilisez Screaming Frog ou Sitebulb pour identifier les pages ayant simultanément canonical + noindex

- Établir une hiérarchie de décision claire : documentez quelle directive utiliser selon le cas (duplicata = canonical, contenu privé = noindex, ressources inutiles = disallow)

- Pour les pages à désindexer : utilisez uniquement noindex, n'ajoutez pas de canonical vers une autre page

- Pour les vrais duplicatas : utilisez uniquement canonical, ne mettez pas de noindex

- Pour bloquer des sections entières : privilégiez le robots.txt Disallow, mais soyez conscient que cela empêche la lecture de toute autre directive

- Cas des URLs paramétrées : préférez la gestion via Google Search Console (paramètres d'URL) plutôt que de multiplier les directives

- Documenter les exceptions : si votre CMS impose des doublons de directives, documentez-les et surveillez leur comportement dans la Search Console

- Tester avant déploiement : sur les gros sites, testez vos règles sur un échantillon avant le déploiement massif

💬 Commentaires (0)

Soyez le premier à commenter.